CaraNet: Context Axial Reverse Attention Network for Segmentation of Small Medical Objects

CaraNet:用于分割小医疗对象的上下文轴向反向注意网络

Aug 2021

论文:https://arxiv.org/abs/2108.07368

代码:https://github.com/AngeLouCN/CaraNet

摘要:

准确可靠地分割医学图像对疾病的诊断和治疗具有重要意义。这是一项极具挑战性的任务,因为物体的大小、形状和扫描方式各不相同。近年来,许多卷积神经网络(CNN)被设计用于分割任务,并取得了很大的成功。然而,很少有研究充分考虑了物体的大小,因此大多数研究在小物体的分割上表现不佳。这对疾病的早期发现有重大影响。这篇文章就提出了一种上下文轴向保留注意网络(CaraNet),与最新的模型相比,它可以提高小目标的分割性能。作者测试了CaraNet在脑肿瘤(BraTS 2018)和息肉(Kvasir-SEG, CVC-ColonDB, CVC-ClinicDB, CVC300和etis - laribpolyypdb)分割。CaraNet不仅达到了顶级的平均Dice分割精度,而且在小医疗对象分割方面也显示出了明显的优势。

问题动机:

近年来,各种卷积神经网络(CNNs)在医学图像分割中表现出了良好的性能。然而,大多数cnn关注的是提高整体分割性能,而不考虑对小型医疗对象的分割性能。然而对微小医疗物体的检测对疾病的早期发现和降低死亡率具有重要意义。例如,对于脑瘤,存活率会随着脑瘤的增大而降低。因此,在肿瘤很小的时候就进行检测是非常重要的。尽管许多神经网络在医学图像分割中表现出良好的性能,但在分割小目标时存在漏检率高的问题。为了解决这一问题,作者提出了一种新的基于注意的深度神经网络,即上下文轴向反向注意网络(CaraNet)。

贡献可以总结如下:

1、 作者提出了一种新的神经网络—CaraNet—来解决小型医疗对象的分割问题。

2、 介绍了一种评估网络在小型医疗对象上的性能的方法。

3、 实验表明,在息肉的分割性能方面,CaraNet优于大多数当前模型(例如,来自MICCAI’20的PraNet),并在整体和小物体上大幅提高了最先进的水平。

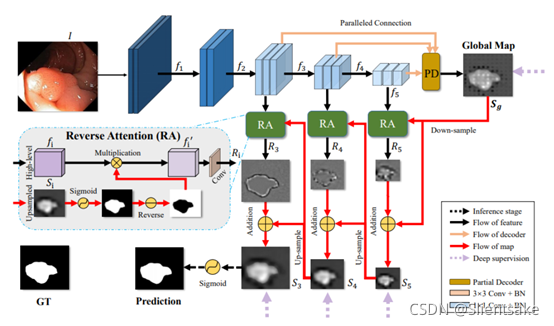

PraNet:

息肉的精确分割是一项具有挑战性的任务,主要有两个原因:(i)同一类型的息肉具有不同的大小、颜色和纹理;(ii) 息肉与其周围粘膜之间的边界不清晰。为了解决这些问题,提出了一种基于并行反向注意力的网络(名为 PraNet)来精确分割结肠镜图像中的息肉。

他的动机源于这样一个事实:在息肉标注过程中,临床医生首先粗略地定位息肉,然后根据局部特征准确地勾勒出轮廓。因此,就认为区域和边界是区别正常组织和息肉的两个关键特征。

通过并行部分解码器(PDD)在高层聚合特征,从而获取上下文信息并生成全局映射图Sg,该图只能捕捉息肉组织的相对粗略位置。(问题)

为了进一步挖掘边界线索,作者反复利用反向注意力(RA)模块来建立区域和边界线索之间的关系。由于区域和边界之间的这种迭代的交互机制,模型能够校正预测结果中一些不一致的区域。(方法)

基于并行的部分解码器的特征聚合(PPD模块):

与高级特征相比,低级特征由于其更大的空间分辨率而需要更多的计算资源,但是对性能的贡献较小。

基于Res2Net的backbone网络提取5个层次的特征,其中f1和f2为低级特征,f3、f4和f5是高级特征。通过并行连接来聚合高级特征,如图所示的PD部分就是基于并行的部分解码器,从而得到全局映射图Sg。

反向注意力模块(RA):

全局映射图Sg来自最深的卷积神经网络层,它只能捕捉息肉组织的相对粗略位置,而没有结构细节。为解决该问题,提出了一种通过擦除前景对象的方式逐步挖掘有区别的息肉区域的策略。

通过该策略最终可以将不精确和粗略的估计细化为准确而完整的边缘预测图。

模型方法:

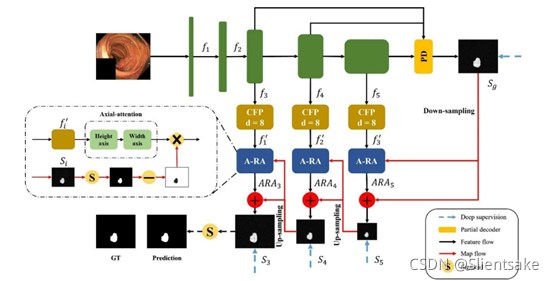

图1显示了CaraNet的架构,它使用一个并行部分解码器来生成高级语义全局地图,以及一组上下文和轴向反向注意操作来检测全局和局部特征信息。

图一:它包含三个上下文模块(CFP)和轴向反向注意模块(A-RA)。S是sigmoid函数。

①、并行部分解码器:

目前,最流行的分割模型是基于U-Net,它从编码器中收集所有级别特征图。实验表明,低级特征的计算代价更大,但对提高分割性能的贡献更小。因此,作者使用了一个并行部分解码器来聚合高级特征。如图1所示,使用Res2Net作为骨干网来提取低级和高级特征。使用部分解码器聚合高层次的特性。部分解码器获取特征然后可以从从部分解码器得到全局信息。

Res2Net:

左边是最基本的卷积模块。右图是针对中间的3x3卷积进行的改进,首先对经过1x1输出后的特征图按通道数均分为s(图中s=4)块,每一部分是xi,i ∈ {1,2,…,s}。每一个xi都会具有相应的3x3卷积,由Ki表示。用yi表示Ki的输出。xi与Ki-1的输出相加,然后送入Ki。为了在增加s的同时减少参数,省略了x1的3×3卷积,这样也可以看做是对特征的重复利用。

这样做计算负载不增加,特征提取能力更强大,Res2Net也可以嵌入到不同的特征提取网络中。

②、上下文模块:

为了从高级特征中获取上下文信息,作者使用了一个信道特征金字塔(Channel-wise Feature Pyramid, CFP)模块来获取多尺度特征信息。设定CFP的扩张速率d=8,所以每个通道的膨胀率是{1,2,4,8},经过上下文模块后,可以获得多尺度的高级特征。

③、轴向反向注意模块:

轴向反向注意模块包括两部分:轴向注意路径和反向注意路径。全局特征只能捕捉到组织的大致位置,没有结构细节。因此,作者通过应用反向注意来擦除前景对象,逐步挖掘识别组织区域。反向操作可以表示为:

(从全1矩阵E中减去输入的反向运算符)

对于另一条路径,作者使用轴向注意来保持全局连接并有效计算。在轴向注意中,网络可以通过计算水平轴和垂直轴来提取全局依赖关系和局部表示。ARA模块的输出可以表示为:

AAi是从轴向注意路线出发的特征。

④、深监督:

采用加权并集交叉(IoU)和加权交叉熵(BCE)作为损失函数来计算全局损失和局部(像素级)损失。损失函数可以表示为:

第一项表示基于全局约束和局部(像素级)约束的加权IoU损失。

第二项表示二进制交叉熵(BCE)损失。

为了训练CaraNet模型,作者对三侧输出(即:S3、S4和S5)以及全局特征Sg进行了深监督。在计算损失之前,作者将输出上采样到与地面真实标签相同的大小,因此,全局损失可以表示为:

小目标分割分析:

由于输入到分割模型的所有图像的大小必须是固定的,所以对象的大小是由对象中的像素数和整个图像的大小决定的。因此,用对象的像素数与整个图像的像素数的比率(比例)来考虑对象的大小。然后,根据目标的大小对分割模型的性能进行评价。尤其关注小领域:那些比例小于5%的领域。

对于一个分割模型,首先得到测试数据的平均Dice系数。计算直方图相似,把整个范围的大小值对象的测试数据为一系列的间隔,连续,不重叠的,和相同的长度,然后计算dice系数的平均值的数据落入每个区间的大小值。区间平均系数具有平滑的曲线,在噪声存在时更稳定。

实验与结果:

息肉分割:

选用几个数据集与六种最先进的医学图像分割方法比较:UNet, U-Net++, ResUNetmod, ResUNet++,SFA和PraNet。

作者随机从Kvasir和CVC-ClinicDB中选择80%的图像作为训练集,其余的作为测试集。除了mean Dice和mean IoU,还选择了其他四个度量指标:

加权dice、 结构测量、增强一致性指标、MAE(平均绝对误差)、

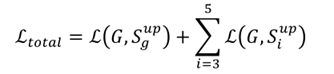

表一:定量结果:Kvasir, CVC-ClinicDB, CVC-ColonDB, ETIS, CVC-T (EndoScene测试数据集)。

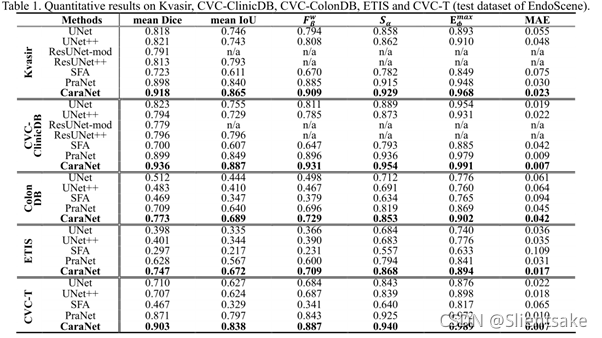

图二:性能比较。x轴为息肉比例大小(%);y轴是dice系数的平均值。蓝色是CaraNet,橙色是PraNet。

在小目标分割分析中,作者只将CaraNet与PraNet进行比较,因为PraNet的性能与作者的最接近,而其他分割方法的整体准确率明显低于CaraNet和PraNet。(注:结肠镜数据集大小的波动是由息肉的类型、边界和成像质量引起的)

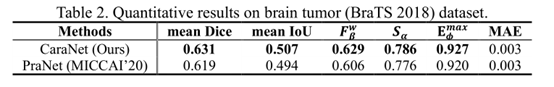

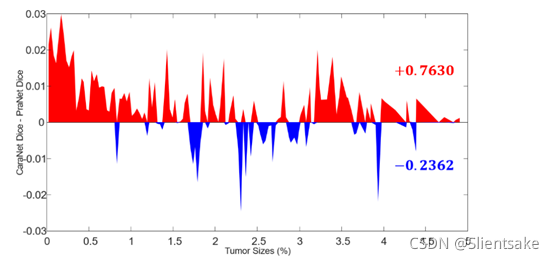

脑肿瘤分割实验:

为了进一步评估CaraNet在小目标分割中的有效性,作者进行了不同的实验,这次使用的是brain tumor (BraTS 2018)数据集。因为息肉数据集缺少非常小的对象(最小值约为0.11%),并且没有足够的小样本(如Kvasir和CVC-ClinicDB,在图2中,小尺寸范围内的点较少)。脑瘤数据集来自BraTS 2018数据库,通过将“T1ce”来源的2D图像切片,并使用“NET”类型标签创建。作者随机选取60%的图像作为训练集,其余的作为测试集。共3231张图像,肿瘤大小比例在0.01% - 4.91%之间。表2和图3显示了比较结果。出于同样的原因,作者将CaraNet与PraNet进行了比较。显然, CaraNet表现得更好,特别是在极小的情况下(图3中范围为0.01% - 0.1%)。

图3。脑瘤数据集的性能与大小。x轴为肿瘤的比例大小(%);y轴是CaraNet和PraNet的平均Dice系数结果的差值。红色表示CaraNet的Dice值大于PraNet的Dice值;蓝色则相反。右边的值表示所有红色和蓝色微分值的和。

提出新的或突破性的工作:

作者提出了一种新的基于深度学习的分割模型- CaraNet,它结合了轴向反向注意和通道特征金字塔(CFP)模块。该方法有助于提高小型医学目标的分割性能。通过实验,CaraNet在整体上大大超越了大多数尖端模型,并在息肉和脑肿瘤的小物体分割性能上有了较大的进步。还介绍了根据目标的大小来评估分割模型的过程。

总结:

在这个研究中,作者提出了一种新的神经网络,CaraNet,用于小型医学目标分割。从整体分割精度来看,可以发现CaraNet至少比所有先进的方法高出2%(平均dice精度)。而对于包含大量小息肉的ETIS早期诊断数据集,CaraNet的平均dice准确率为74.7%,比PraNet高出约12%。