Combining Markov Random Fields and Convolutional Neural Networks for Image Synthesis

基于马尔科夫随机场和卷积神经网络的图像合成

from CVPR2016

Abstract

本文将马尔科夫随机场与深度卷积神经网络结合用于2D图像的合称,其中MRF会作用于CNN提取的高阶特征,在抽象层面上调整图像的输出,可用于写实性以及艺术性的图像合成。其中MRF正则化的使用可有效减少过度激活导致的伪影、减少基于倒置CNN导致纹理合成的失真现象,从而让生成的图像更加合理。

而且与传统的MRF区别在于,MRF结合CNN的方式使得整个模型对局部特征的匹配更贴切同时还保有一定的灵活性,实际的生成效果远超传统MRF方法。

Section I Introduction

图像变换合成一直是计算机视觉和图形学的一个经典研究问题,是很多应用的基础工作,比如作为图像编辑工具、在心理实验中生成刺激.激励等。

本文主要关注于数据驱动的图像合成:对于给定的某张图片,是否可以自动申城一系列相似但结构不同的变体,而变形程度可由用户控制,如改变图像细节、维度等。

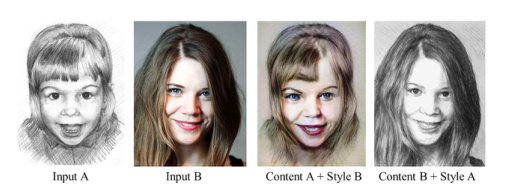

在早期研究中,通常将参考图像分为content image和style image,最终合成兼具二者的风格化图像。比如Fig1展示了选用AB两张图进行合成,无论将A作为contentB作为style还是反过来,本文都取得了很好的迁移效果,尤其是对于眼部、嘴巴等微观结构,几乎完全保留了下来。

早期的数据驱动合成方法大部分基于马尔科夫随机场,认为图像最相关的部分依赖于局部的特征分布,通过局部k*k范围内的像素点来学习该patch可能的特征,一般通过最近邻算法得到,但 基于MRF的纹理合成一个很大的问题在于会导致patch内的图像发生变形,即使搜索空间在较高维度依旧不能抑制变形的发生。

考虑到模型泛化性和不变形我们考虑借助具有辨别能力的深度卷积神经网络来辨别图像的复杂特征及非线性变换,替代MRF中的最近邻搜索。

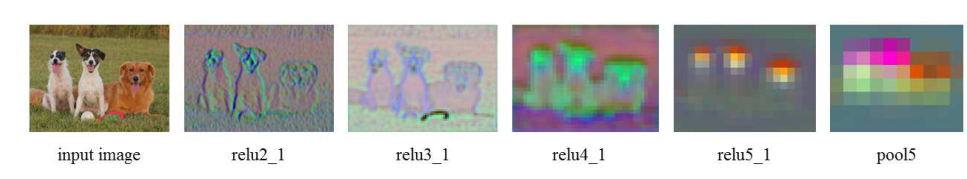

但连续的卷积-池化操作导致CNN在特征提取过程中不断丢失细节信息,使得最终的特征表达代表高级语义特征但十分粗糙,如Fig2的可视化结果。

随后再经过一个inversion过程将最大激活对应的类别作为输出会导致输出效果很魔幻,而我们需要合成的图像几乎复现原content image的特征信息。

近期Gatys的Neural Style Transfer在这一方面取得了突破进展,他们借助预训练的VGG网络,在此前已基于上百万张图片训练的结果来提取图像的高级特征表述来引导图像进行风格迁移。随后内容特征通过s生成图像与content image的loss函数进行惩罚从而保留content内容。

Neural Style的另一个贡献在于发现Gram Matrix可以很好的表征图像的纹理特征从而代表了一张图的风格信息,从而通过学习Gram Matrix代表的风格可以实现任意类型的风格迁移。但对于局部细节信息的相互关联保留较为困难,尤其是对照片等进行pixel的高保真迁移,Neural Style Transfer基于不同层捕获的相关性信息用在这方面就太弱了。

因此本文使用MRF代替Gram Matrix在保留content的基础上进行风格的匹配。

这样既可以利用CNN强大的特征提取能力,又可以通过MRF对生成图像的空间布局进行限制,减少变形。技术实现上添加了额外的MRF energy term,用来模拟CNN特征金字塔中的马尔可夫周期。最终把基于MRF的方法在写实图片和艺术图片上均进行了测试,CNN提供的语义信息提升了内容匹配的效果,MRF的局部空间限定减少了细节方面的变形,使得比Gatys的风格迁移效果关联性更强,更适合用于照片的风格迁移。

# Section II Related Work

Image synthesis with neural networks

神经网络强大的特征提取能力在一些识别任务中取得了惊人的成果,因此也有学者将其应用于生成任务中,基于CNN提取到的特征进行图像的重建,如Gatys基于CNN就已经比传统的纹理合成效果更佳;而进一步衍生的生成对抗网络,借助生成器和判别器之间的博弈可以生成更佳逼真的图像,以上都是神经网络用于图像合成的成功实践。

MRF-based image synthesis

MRF是传统的非参数化图像合成方法,通过图像像素之间的相互作用低阶的马尔科夫随机场可用来描述像素之间的关系。但合成时如何选择匹配的patch,以及局部的统计信息有时不足以表征整体的纹理特征,这些都是MRF自身的局限性,信息的缺失往往使得像素之间关联性不那么强,虽然multi-resolution一定程度上改进了MRF但还不足以捕获图像的长程依赖关系;而CNN中的LSTM模型可以弥补这一不足。

# Section III Model

下面具体阐述如何将MRF与CNN结合。

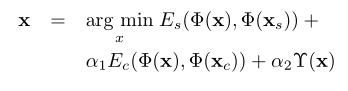

Xs代表style image,Xc代表content image,生成图像用x代表,在使得x与Xc尽可能匹配的优化过程中,通过寻找Xs中匹配度最高的patch进行迁移。x的损失函数表征如下:

其中Es代表style loss,基于MRF计算得到,

而phi(s)则是x某层的feature map;

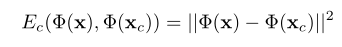

Ec代表content loss,依旧计算生成图与content image之间的square distance,

最后的gamma(x)是重建图像中施加的平滑约束项。

因此可以看看到,变化之处就在于Esstyleloss和平滑项的计算。

MRF loss function

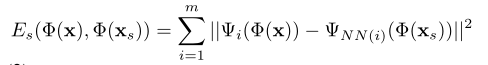

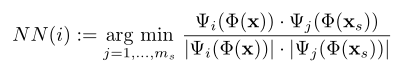

首先将style image提取的一系列纹理特征patch组成一个集合,每一张patch都有一个索引值,patch大小为kxkxC,从而 energy function计算为:

对于生成图的每一个patch都会从style image的patch集合中找到相关性最强的patch,也就是二者欧氏距离最近的来进行风格迁移。这样确保重建的图像与style image在视觉上尽可能的相近。

**Content loss function:**

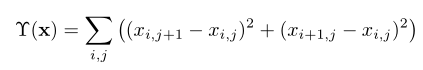

**Regularizer:**

在网络训练过程中,相当一部分浅层信息被丢失,这就使得图像重建时出现很多噪声和不自然的地方,因此为了提升重建图像的平滑程度增加了这一正则化项,具体形式为:

Minimization:优化与Gatys原文中一样,使用L-BFGS,content loss和style loss权重分别为0.1和0.001。

Section IV Analysis

实验主要对比了基于MRF的风格迁移算法在patch匹配性和最终的迁移效果。

Part A Neural Matching

非参数化的图像格成非常关键的一点在于如何将待合成的部分与example匹配,比如Fig3进行的是car的匹配对比,可以看到基于pixel的匹配方式很容易受到外观变化的影响,而基于CNNrelu3_1和relu4_1提取的特征进行query寻找的效果是最好的,因此把这两层作为生成MRFpatch的搜索层。

Part B Neural Blending

style 的优化是一个线性的融合,本文实验发现基于神经网络patch进行融合比使用pixel的patch融合效果更好,通过Fig4可以看出直观对比,对于A.B分别作为content和style patch,可以看到不同层融合的结果与纯像素融合的对比结果,relu3_1和relu4_1融合效果最佳,浅层的relu2_1更贴近pixel融合的结果,而纯粹靠平均像素进行融合会产生很多伪影;而过深的层次(relu4_1)由于细节信息的缺失融合效果也比较模糊因此选取中间层既有抵抗噪声的鲁棒性同时插值也不至于过度失真。

Part C Effect of the MRF Prior

可以看到单纯基于patch融合还是会有变形发生,这就需要添加平滑项来约束,fig5展示了添加这一正则化项后对局部一致性的提升。

Section V Implementation Details

实验细节相关

network:VGG-19,

style layer:relu3_1,relu4_1 for MRF Patch

content layer:relu4_2

patch :3x3

training:384*384 3 minutes(Titan X GPU)

Section VI Results

Fig6展示了基于MRF的style Transfer与Gatys迁移算法的结果对比,将人脸头像风格化为毕加索的《自画像》风格与Wassily Kandinsky的 Composition VIII风格,可以看到都产生了很有趣的风格化结果。但Gatys的 row1眼睛有些许不自然,包含过多变形的细节,本文的迁移效果更自然一些。

Fig7展示了对照片图像的迁移结果,与Gatys变形的结果相比,本文实现效果更加真实。

通过Fig8本文与Gatys的细节对比可以看出,红框圈出的patch部分本文在内容和风格上的匹配性更好,对于car并没有可以匹配的style patch本文通过纹理综合进行迁移,因此更适合偏艺术风格的迁移创作可能一定程度上偏离原图内容信息。

总结一下,本文与Gatys的不同之处在于:

(1)首先通过MRF匹配patch的方式进行风格迁移,从而增加空间上的约束,借助CNN提取到的高级语义信息时可借助MRF解决倒置重建困难的问题;

(2)其次,Gatys使用Gram Matrix计算风格信息可能会导致伪影,因为不同的纹理可能其gram matrix计算结果相同,还可能会引起风格特征发生改变,而本文则完全进行的是style patch的复制,忠实度更高。

[要注意,Gatys并不是本文patch=1x1的情况]

Limitations

但本文依旧存在一些局限,比如Fig9的情况下Gatys的迁移效果更好,因为本文通过reshuffle对各个模块进行洗牌可能会导致细节内容的丢失,对于细节成分多的content image以及对称性较强的图像如建筑等效果不佳。

本文表现较好的情况在于像人脸、汽车等允许一定程度变形的情况。

尽管本文将风格迁移应用于照片做了一些拓展,但未来如何对写实图片进行更准确的风格化迁移仍是一个值得研究的方向。

Section VII Conclusions

本文的工作在Gatys的基础上利用MRF进行纹理合成,而不是Gram Matrix,这样一定程度上可以更匹配原风格图像,局限在于可能会丢失细节信息导致变形。

但借助MRF可以使得照片等写实图像的迁移效果关联性更强,尽管对图像结构有一定要求,因此更适合艺术图像的风格迁移。

未来本文还会继续研究如何更高效的利用基于大型数据集预训练网络中间层学到的特征进行风格迁移,或者探索生成式的网络训练。