文章目录

简介

这其实是我们团队参加比赛,然后调研到的文章,做总结的是我的队友,不得不说,总结得简明扼要,而且易懂。她不写博客所以我分享一下,希望我们的分享有些帮助。

论文信息

题目

MULTI-TASK SELF-SUPERVISED LEARNING FOR ROBUST SPEECH RECOGNITION

用于语音识别的多任务自我监督学习

内容摘要

尽管人们对无监督学习的兴趣日益浓厚,但从未标记的音频中提取有意义的知识 仍然是一个挑战。为了朝这个方向迈出一步,我们最近提出了一种与问题无关的 语音编码器(PASE),该编码器将卷积编码器与多个神经网络(称为工作者)结 合在一起,以解决自我监督的问题(即不需要手动操作的问题)。 PASE 被显示为捕获相关的语音信息,包括说话者的声纹和音素。本文提出了 PASE +,它是 PASE 的改进版本,可在嘈杂和混响环境中实现健壮的语音识别。为此, 我们采用了在线语音失真模块,该模块会以各种随机干扰来污染输入信号。然后, 我们提出一种经过修订的编码器,可以通过有效地结合递归和卷积网络来更好地 学习短期和长期语音动态。 最后,我们改进了自我监督中使用的工作集,以鼓励更好的合作。

TIMIT,DIRHA 和 CHiME-5 的结果表明,PASE +明显优于以前版本的 PASE 和常见的声学功能。 有趣的是,PASE +可以学习适用于高度不匹配的声学条件的可转换表示形式。 索引词-自我监督学习,语音识别 voice-print 声纹 phoneme 音素:是根据语音的自然属性划分出来的最小语音单位,依据音节里 的发音动作来分析,一个动作构成一个音素。音素分为元音与辅音两大类。如汉 语音节啊(ā)只有一个音素,爱(ài)有两个音素,代(dài)有三个音素等。

论文背景

应用背景

越来越受欢迎的一个相关领域是自我监督学习,其中目标是通过对输入数据应用 已知的转换从信号本身[5,6]中计算出来的。与完全不受监督的方法相反,在自 我监督中,可以通过要求模型恢复已知的信号转换(不需要人的情况下廉价地获 得)来轻松地将专家派生的先验合并到训练过程中。

技术现状

自我监督学习最初是在计算机视觉社区中通过解决各种辅助任务来学习表示的, 这些辅助任务包括为灰度图像着色[7]或解决图像斑块中的难题[8]。自我监督学 习也已成功地应用于语言建模中,从而产生了诸如 BERT [9,10]之类的模型。最近, 类似的范例已用于推断音频表示[11、12],包括具有互信息的学习语音表示[13、 14]。 尽管取得了新的进展,但将自我监督的学习应用于语音仍然是一个挑战。语音信 号需要一个复杂的层次结构(样本→音素→音节→单词→句子→语义内容),其 中包含不同时标的相关信息。语音的特征还在于,由于扬声器内和扬声器间的差 异、干扰,不同的语言、声学环境或录音设置,导致可变性很大。因此,在没有 5

任何监督指导的情况下很难推断出相关的潜在结构。

自我监督的学习在计算机视觉和语言建模方面成功迁移,但在语音方面的迁移运 用仍然是挑战。

论文主要工作

我们最近尝试使用多任务自我监督方法来学习语音表示形式,导致我们开发了与 问题无关的语音编码器(PASE)[15]。学习有意义的语音信息,例如说话者的身 份,音素和情绪。基本假设是,每个自我监督任务都会提供语音信号的不同“视 图”,并且通过将不同的窥视结合为唯一表示,该模型可以更好地学习全面的表 示。PASE 依赖于卷积编码器,然后是小型神经网络的集成,称为工作集,经过 共同培训可以解决多个自我监督的任务。

我们的初始 PASE 变体在一些小型语音 任务中提供了可喜的结果,但是,它并未明确设计来学习强大的抗噪声和混响功 能。本文中,我们使用 PASE +改进了后者,这是 PASE 的修订版,可显着提高其 在挑战性语音中的性能识别任务。改进之处包括开发了在线语音失真模块,该模 块使用混响,加性噪声,时间/频率掩蔽,削波和重叠语音将干净的语音片段转 换为受污染的变体。然后,我们将卷积编码器与准递归神经网络(QRNN)结合 使用[16 ]。

QRNN 可以使用跨时间步长的卷积门和最小的循环池功能,以非常有 效的方式学习长期依赖关系。最后,我们介绍了几位新颖的工作集,他们估计了 多种已知的语音转换,并从原始的干净信号中提取了自我监督的真实目标。这样, 我们不仅利用了数据扩充的优势,而且还鼓励我们的编码器执行降噪并学习失真 不变的功能。 我们的方法不同于早期基于 DNN 的声学特征提取器[17],因为它们以监督的方式 利用共享的语音知识,而 PASE 仅依赖原始信号和自我监督的学习。

在 TIMIT, DIRHA 和 CHiME-5 数据集上报告的结果表明,PASE +可以显着改善 PASE 并优于传 统的手工功能。为了提高可重复性,我们已公开提供 PASE 代码和预先训练的模型。

开发 PASE+编码器来学习强大的抗噪声和混响功能,并在次环境下学习有意义的 语音信息,例如说话者的身份,音素和情绪

论文工作介绍

文章框架

框架梗概:

摘要

1.简介

2.使用 PASE +进行自我监督的学习

- 在线语音污染(干扰)

- PASE +编码器

- 工作集(回归任务+基本任务)

- 自我监督训练

3.文集和 ASR 设置

4.成果

5.结论

6.致谢

核心工作

1、PASE+整体框架。 蓝色部分是在 PASE 的基础上改进的部分。

一旦以自我监督的方式进行了预训练,PASE +既可以用作独立的特征提取器(具 有固定的权重),也可以用作解决某些目标任务(例如语音识别)的目标声学模 型的一部分(具有监督的训练)。 如图 1 所示,PASE +配备了语音失真模块,将原始样本转换为更高级别表示的语 音编码器,以及由共享编码特征馈送并合作解决不同自我监督的一组十二个集合 任务。

2、如何以自我监督的方式对 PASE +进行预训练

2.1 干扰模块 目的:提高鲁棒性 实现方式:以几种失真人为地污染输入语音(有关摘要,请参见表 2.1)。

意义:在成果部分中,证明污染模块很重要,并且是第一次在自我监督的训练方 案中使用。

2.2 PASE+编码器

基本结构: 第一层基于 Sinc-Net [22],使用一组实现矩形带通滤波器的参数化 Sinc 函数对原 始输入波形进行卷积。

随后的层由七个卷积块组成(图 1)。每个块采用一维卷积,然后进行批归一化 (BN)[23]和多参数整流线性单元(PReLU)激活[24]。卷积集模拟在普通语音特 征提取器中实现的,偏移 10 毫秒的滑动窗口。 PASE+改进部分:

•跳过连接:最终表示是中间卷积层发现的特征的总和,这些特征被线性投影和

下采样以匹配输出嵌入序列的维数和长度。跳过连接引入了编码器体系结构中的 快捷方式,该快捷方式将不同级别的抽象往返于最终表示,并改善了梯度流。

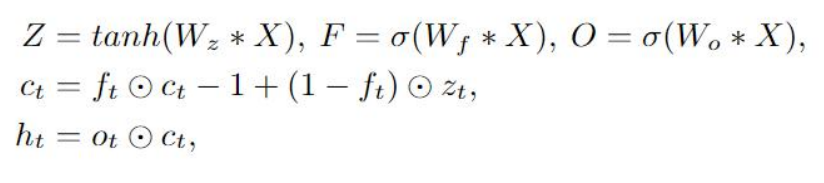

•准 RNN:QRNN——有效地学习长期依赖关系。 QRNN 基于通过一维卷积和极简循环池函数实现的乘法门,如以下等式所示:

其中 Z,F 和 O 是由 W 参数化的乘法门,*和 表示卷积和逐元素乘积,而 ct 和 ht 分别是单元的状态和隐藏状态向量。 QRNN 门不依赖先前的计算,可以针对所有时间步长并行计算。 QRNN 的性能类

似于更传统的 LSTM 或 GRU 模型,具有较低的计算负荷[16]。据我们所知,QRNN 首次在多任务自我监督的环境中使用。

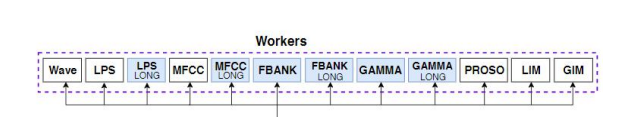

2.3 工作集

工作者被实现为小型前馈神经网络(通常是一个具有 256 个隐藏单元的隐藏层), 可以解决十二个自监督任务,定义为回归或二进制分类问题。故意限制其能力, 以鼓励编码器发现高级功能,即使建模能力有限的分类器也可以成功利用这些功 能。重要的是,受工人监督的目标是从原始干净信号中提取的,而不是从失真版 本中提取的。这样,我们强制 PASE +执行隐式去噪并学习强大的功能。

2.3.1 回归问题 目的:使语音特征(用作标签)和网络预测之间的均方误差(MSE)最小化。

原理:利用众所周知的语音转换将一些先验知识注入到编码器中。

如何扩展回归器:

•添加更多特征 •估计更长的上下文:PASE +估算所有语音功能以及它们的一阶和二阶导数。此

外,我们不是仅估计当前特征,而是在七个相邻帧的上下文窗口内共同估计多个 特征。这样,我们可以帮助我们的变量从更大的上下文中嵌入信息。

•在更长的窗口上预测特征:我们进一步增加了新的 worker,他们估计上述功能 是通过 200 毫秒的较长分析窗口而不是通常使用的 25

毫秒来计算的其他回归变 量(参见图 1 中的 long workers)。我们发现这很有用,因为它使我们的代表更

了解本地环境中语音信号的平均特征。

2.3.2 二分类问题

目的:从语音信号中捕获更高级别的信息。

这些任务依赖于预定义的采样策略,该策略从 PASE 编码表示库中提取锚点,正 样本和负样本。所采用的神经网络是简单的二进制分类器,经过训练可以使锚和 正表示之间的相互信息最大化。相互信息是一种非常有意义的差异度量,可以捕 获随机变量之间的复杂非线性关系[26,27]。根据采用的抽样策略,我们可以推 论不同的任务。在 PASE +中使用的是:

•局部信息最大化(LIM):如[14]中所建议,我们从锚相同句子中提取的 PASE 特征中提取正样本,并从另一个随机句子中提取负样本。即鉴于 PASE +中的接收 域很大,每个编码的帧都嵌入了一个相对较大的上下文。由于说话者身份是局部 随机特征序列中的可靠常数因子,因此该工作者可以学习如何区分说话者。

•全局信息最大化(GIM):与 LIM 不同,该工作者依赖于全局信息。锚点和正 10

表示是通过平均从属于同一句子的 2 秒长块中提取的所有 PASE 功能而获得的。 否定的是从另一句获得的。GIM 鼓励 PASE 学习包含有关输入序列的高级信息的 表示形式,这些表示形式希望与 LIM.2.4 所学习的表示形式互补。

2.4 自我监督训练

反向传播优化总损失,计算为每个工作集的平均值。

我们进行了实验,为每个工 作人员增加了动态权重,例如,探索了超量最大化的使用[28]。但是,与较简单 的未加权平均损失相比,所考虑的方法在我们的框架中没有提供任何好处。所有 的神经网络都使用 Adam [29]进行了优化,使用的初始学习率为 1000,该学习率 使用多项式调度程序进行了下降调整[30]。我们使用 32 个波形块的微型批次, 一次 2 秒长。该系统迭代了 200 次。

数据集

在 LibriSpeech 数据集的 50 个小时的一部分中进行自我监督训练[31]。目标语音 识别实验是使用不同的域外数据集进行的。第一组实验是使用 TIMIT [32]进行的。 与原始清洁版本一起,我们使用噪声序列和实际冲激响应[33](与用于自我监督 训练的那些不同)生成了 TIMIT 的受污染版本。为了评估我们在更大数据集上的 方法,我们还采用了 DIRHA 数据集[19]。训练和验证集基于原始 WSJ-5k 语料库 (由 83 位说话者说出的 7138 个句子)在家庭环境中模拟。该测试集由六个美国 扬声器在家庭环境中录制的 409 个 WSJ 句子组成,其 aT60 为 0.7 秒,平均 SNR 为 10 dB。最后,使用 CHiME-5 数据集[34]进行了一组实验,该数据集基于晚餐 聚会的真实记录。 CHiME-5 是一项具有挑战性的任务,其特征是噪音,混响, 重 叠 和 对 话 语 音 。 这 项 工 作 使 用 混 合 HMM-DNN 语 音 识 别 器 。 使 用 PyTorch-Kalditoolkit [35]分别使用六层多层感知器和 lightGRU [36]进行 TIMIT 和 DIRHA 实验。TIMIT 上报告的性能是在不同种子下运行每个实验 3 次所获得的平 均电话错误率(PER%)。 CHiME-5 的结果基于 Kaldi [37],并依赖于在 PASE +功 能上训练的时延神经网络(TDNN)[38,39]声学模型。

论文实验

干预措施有效性的证明 & PASE+强大性能

添加在线失真不仅可以改善嘈杂环境中的性能,还可以改善干净环境中的性能。 数据增强可充当强大的正则化器,尤其是在监督分类器使用像 TIMIT 这样的小型 数据集。

在第四行(+ QRNN)和第五行(Skipconnection)中,我们显示了由于修改了编 码器而带来的改进。从表中可以看出,QRNN 对噪声和混响条件(其中嵌入更长 的上下文更为重要)有重大影响。当将表示的维数从 100 增加到 256 时,我们也 发现了一些好处(请参见第 256 章)。这项工作并非旨在压缩信号,而是以一种 可以被以下监督分类器更好地利用的形式进行表示。增加维度有助于更好地弄清 表征语音变化的最重要因素。

最后,我们报告了采用更多工作人员时所取得的成果。这导致了实质性的改进, 证实了添加更多相关的自我监督任务的重要性。即使某些回归器(例如 MFCC, FBANK,Gammatone)估计的语音表示高度相关,我们仍能观察到一些好处。我 们认为这可能会增加另一个正则化效果,有助于学习更鲁棒的表示形式。总体而 言,拟议的 PASE +明显优于我们之前的版本,在干净场景下相对改进了 9.5%, 在嘈杂条件下相对提高了 17.7%。

与标准语音特征比较

将 PASE +与语音识别中最流行的手工制作功能进行比较。比较了 MFCC,FBANK 和 Gammatone,以及这三个串联的功能,以及 TIMIT(Rev + Noise)和 DIRHA 上 的 PASE +功能。

我们在一项极具挑战性的任务(如 CHiME-5)上的研究结果证实了自我监督的 PASE +功能在高度失配和逼真的声学环境中的可移植性。

总结

文章结语

这项工作研究了一种用于鲁棒语音识别的多任务自我监督方法。提出的PASE +体系结构基于在线语音失真模块,卷积编码器和 QRNN 层以及一组解决自我监 督问题的工作集,结果证明 PASE +在不同的语音识别任务上(与冷冻砝码一起使 用时)的性能明显优于标准声学功能,并且在通过目标声学模型目标进行端到端 优化时(此处针对语音识别进行了优化),PASE 还提供了显着水平的可传递性。

我们的系统接受了来自 LibriSpeech 子集的人工失真信号的训练,并提供了 即使在看不见且现实的嘈杂环境中,即使在具有挑战性的声学场景中也具有良好 的性能。这项工作研究了纯自我监督表示的潜力。

自然的扩展将是对半监督框架的探索,其中可以将其他受监督的工作人员 (例如,语音或说话者识别器)与自监督的工作人员结合起来,以学习更好的表 示形式。我们相信,随着当今计算机视觉和自然语言处理的发展,未来的语音处 理技术将从这种预训练的模型中受益更多。根据车载实验的证据支持,在未来的 工作中,我们将探索其在其他下游任务(例如说话者,情感和语言识别)以及序 列到序列神经语音识别中的可用性。