Introduction

(1)Motivation:

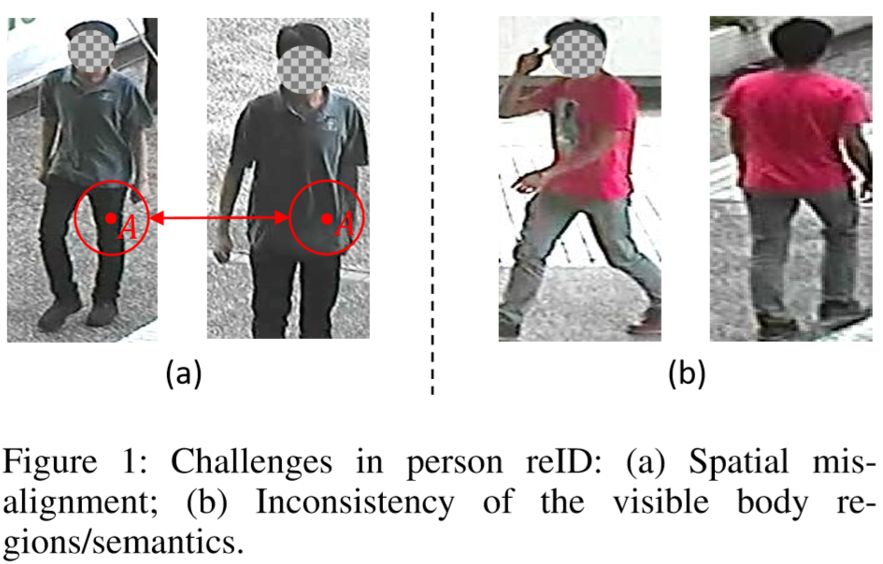

当前的reid存在语义不对齐的问题,如下图:

图(a)显示了不同图片的相同位置对应了行人的不同身体部位;图(b)显示了不同图片呈现的部位不一样,有些是正面有些是背面等。

(2)Contribution:

提出了一个语义对齐网络(Semantics Aligning Network,SAN),介绍了对齐纹理生成子任务。该网络包含一个ReID编码器SA-Enc和一个重构对齐语义纹理的解码器SA-Dec。

The Semantics Aligning Network(SAN)

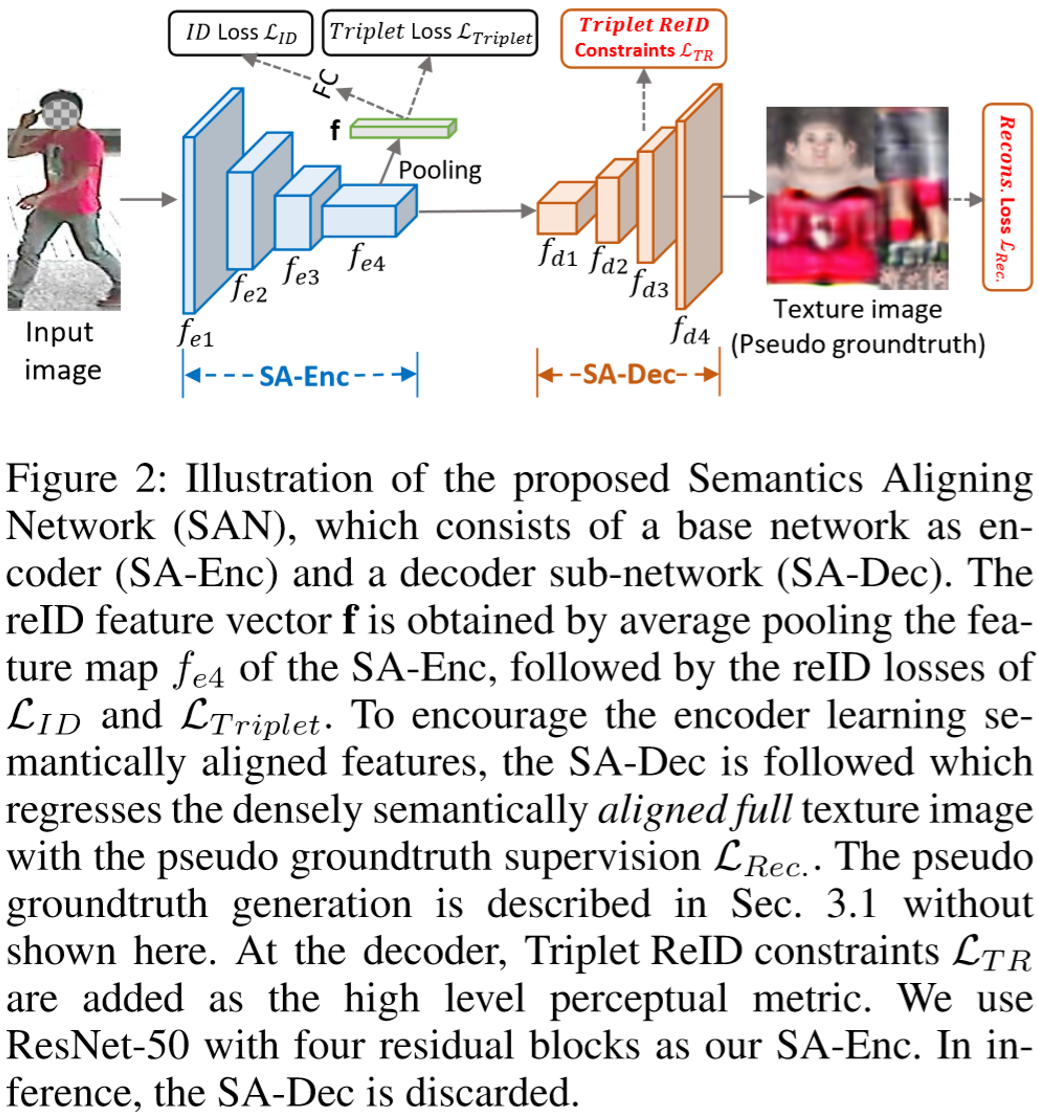

(1)网络框架:

网络框架包含了两部分,SA-Enc用于编码行人的特征,SA-Dec用于生成语义对齐后的纹理图片,解码器理解为把3D的行人展开为2D图片,该图片包含的区域特征已经完全对齐了。SA-Enc模块最终输出的特征映射为![]() ,进行平均池化得到特征向量

,进行平均池化得到特征向量![]() ,损失函数采用ID损失和三元组损失。SA-Dec采用非ReID的数据集进行训练(忽略ReID的监督),损失函数应用三元组损失和重构损失。

,损失函数采用ID损失和三元组损失。SA-Dec采用非ReID的数据集进行训练(忽略ReID的监督),损失函数应用三元组损失和重构损失。

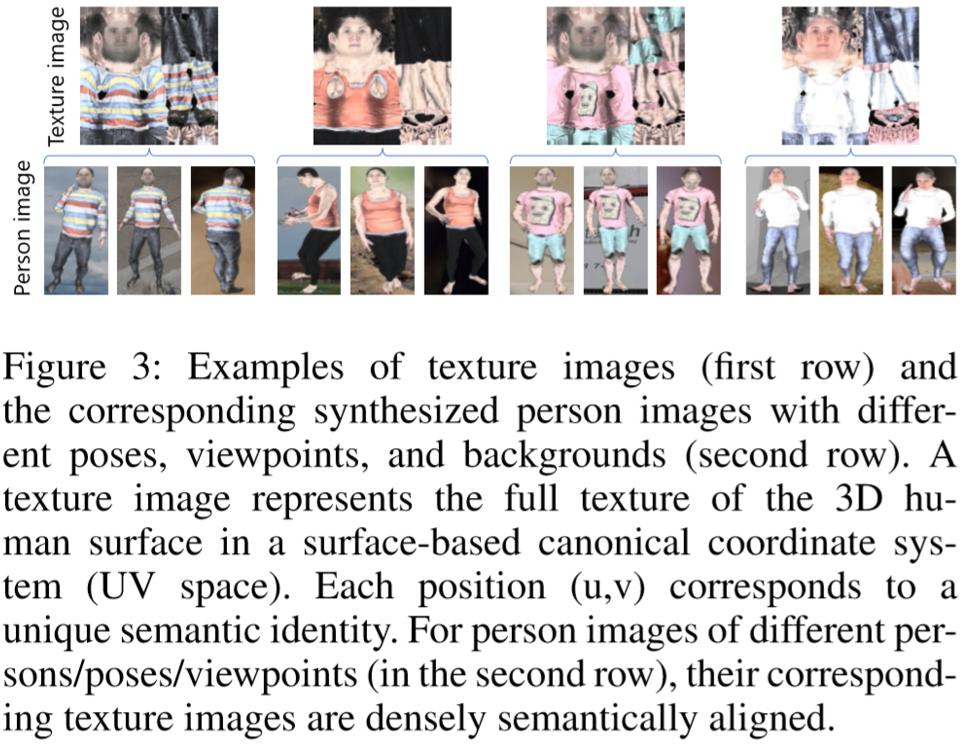

(2)Densely Semantically Aligned Texture Image

行人纹理图包含了一个人的3D样貌,如下图所示:

伪纹理图像的生成:作者采用了去掉ReID监督的SAN网络,即SAN-PG网络,生成图片对应的纹理图像。为了训练SAN-PG,作者基于SURREAL数据集合成了Paired-Image-Texture数据集(PIT),合成方法如下图。通过给出纹理图、3D人体模型、背景图,得到行人生成图。

(3)SAN:

① SA-Enc:采用了ResNet50的四个残差模块。损失函数采用了交叉熵(ID)损失和三元组损失。

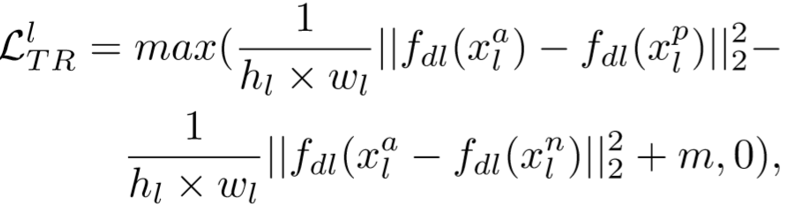

② SA-Dec:损失函数采用了重构损失![]() ,最小化生成的纹理图和真实纹理图的距离。解码器不仅需要生成纹理图,还需要能够判别行人的ID,因此衡量了解码器每一层的每一个纹理区域的特征距离,损失函数采用的三元组损失,第 l 个模块的损失计算如下:

,最小化生成的纹理图和真实纹理图的距离。解码器不仅需要生成纹理图,还需要能够判别行人的ID,因此衡量了解码器每一层的每一个纹理区域的特征距离,损失函数采用的三元组损失,第 l 个模块的损失计算如下:

其中![]() 为该特征映射的分辨率。

为该特征映射的分辨率。

(4)优化:

第一步:只使用重构损失,采用PIT数据集训练SAN-PG;

第二步:SAN采用SAN-PG的权重进行初始化,再对SAN进行训练,同时进行ReID和对齐纹理图的生成。

Experiment

(1)实验设置:

数据集:CUHK03、Market1501、DukeMTMC-reID、MSMT17、Partial REID、Partial-iLIDS;

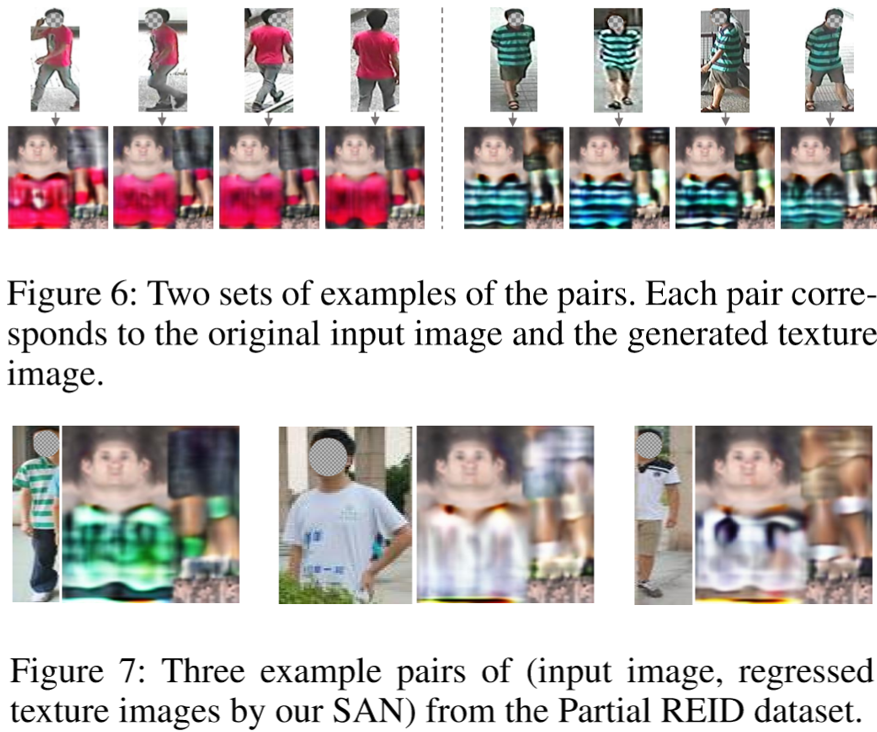

(2)方法效果图:

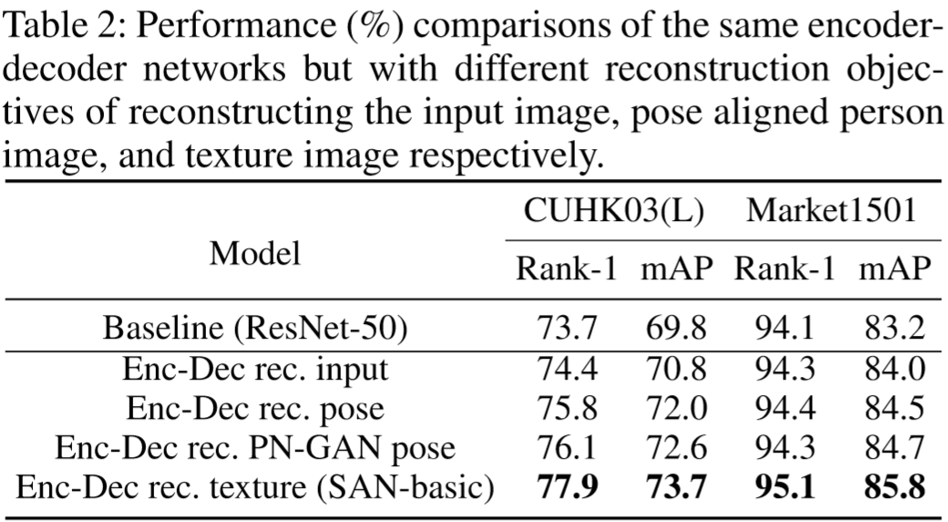

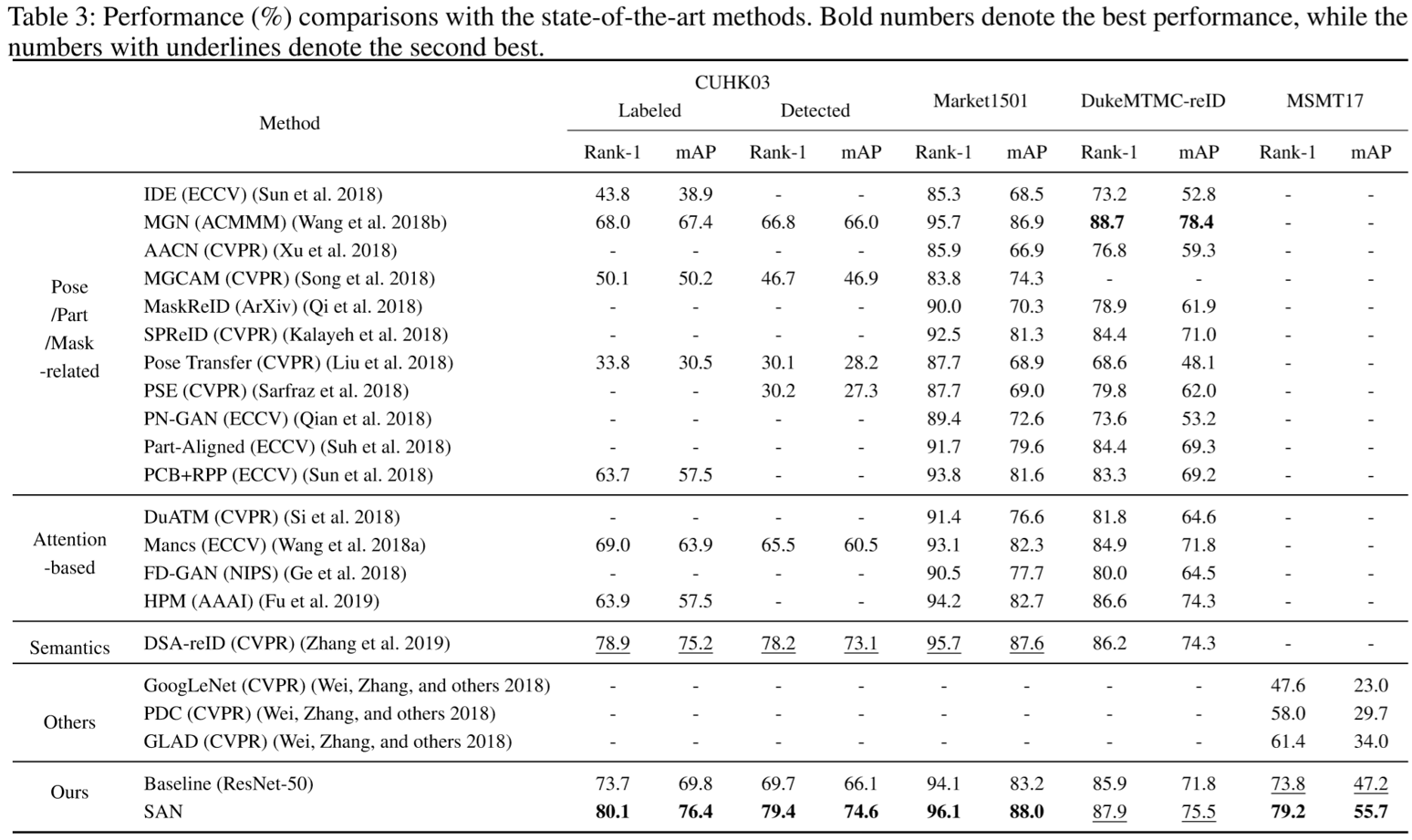

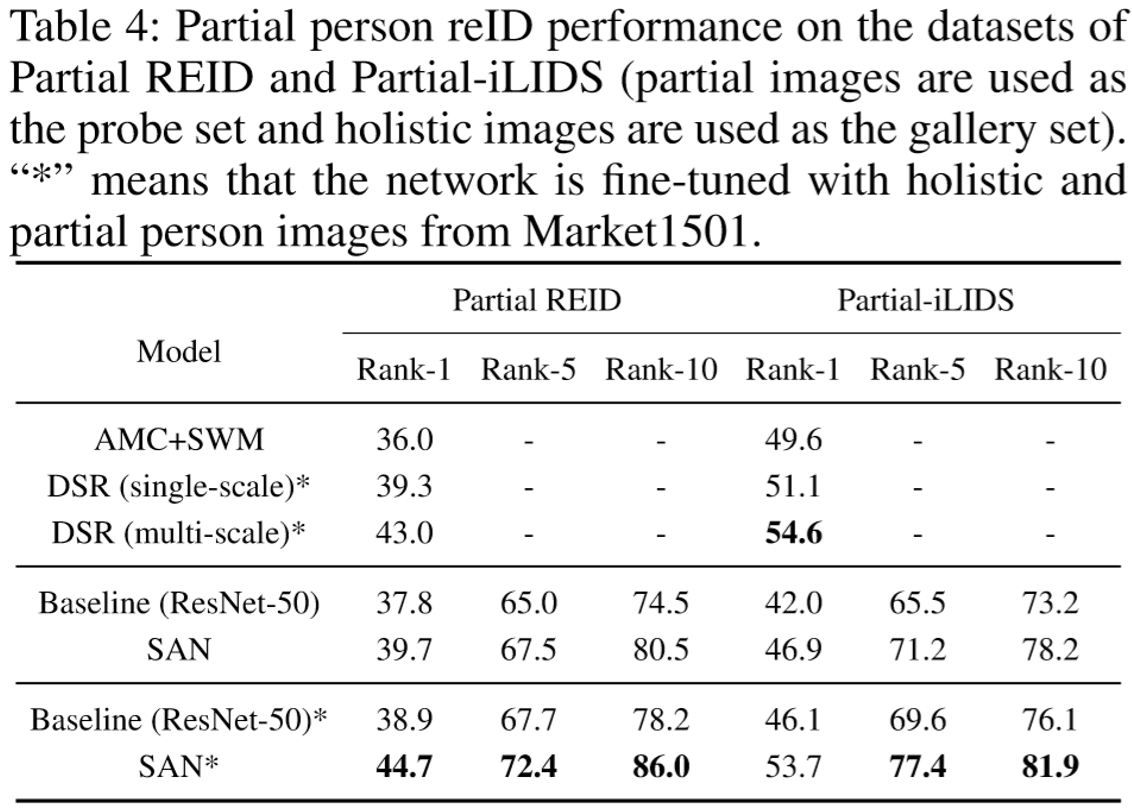

(3)实验结果: