Algoritmo de convergência de segunda ordem

Independentemente do método de descida mais íngreme anterior ou do método do gradiente ideal, todos eles são convergência linear (de primeira ordem) e, neste capítulo, discutiremos o algoritmo de otimização de convergência de segunda ordem.

Este tipo de algoritmo não apenas acelera a velocidade de convergência, mas também garante que a solução ótima seja encontrada em um passo finito.

Do ponto de vista do entendimento, se um algoritmo pode encontrar a solução ótima da função quadrática dentro de um número finito de etapas, dizemos que o algoritmo é convergente de segunda ordem.

Conceitos de fundo relacionados

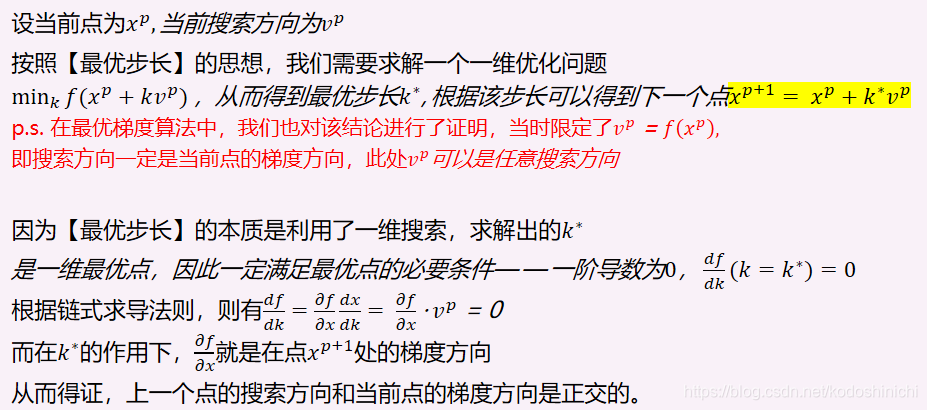

Propriedades de algoritmo de tamanho de passo ideal

Na postagem do blog "[Otimização] Algoritmo de gradiente irrestrito" , primeiro descrevemos a estrutura geral do algoritmo de gradiente e, em seguida, determinamos a forma iterativa do método de descida mais íngreme; então, para fazer a escolha do comprimento do passo k adaptativo, nós introduzido A ideia do tamanho de passo ideal (cada iteração de uma pesquisa unidimensional no tamanho de passo k) tem sido o método de gradiente ideal.

Ao final do artigo, concluímos que “ as direções de busca de dois pontos adjacentes no método do gradiente ótimo devem ser ortogonais ”.

Essa conclusão será usada em algoritmos subsequentes e precisamos promovê-la:

- Usando o algoritmo da ideia de [tamanho ideal do passo], a direção do gradiente deste ponto de iteração deve ser ortogonal à direção da pesquisa anterior.

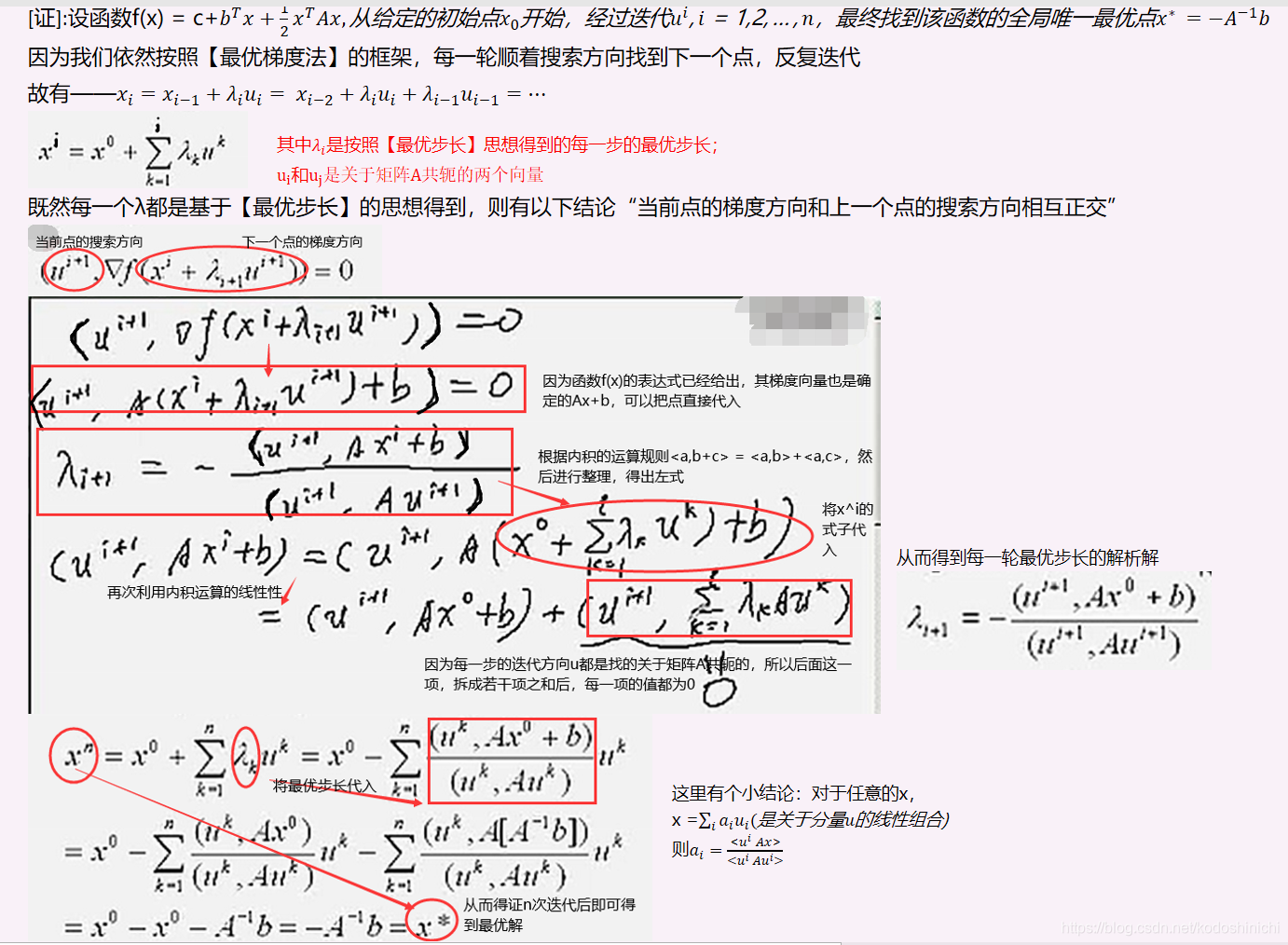

【provar】

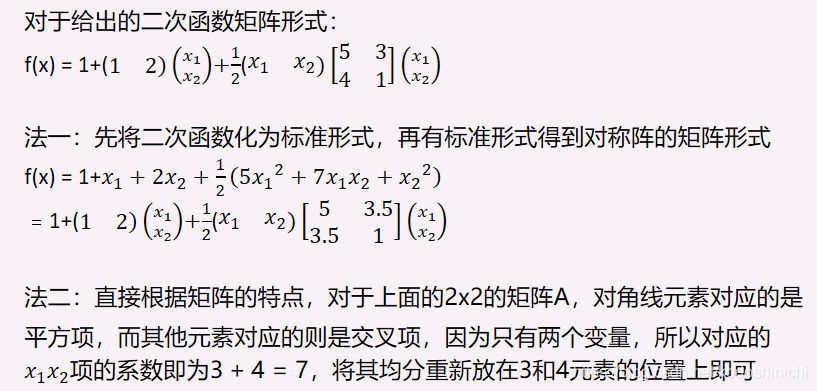

Função quadrática e seu conceito

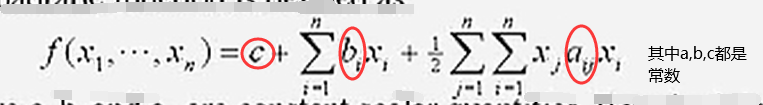

1. Definição ——

Combinação de termo constante, primeiro termo e termo quadrático

(1) Forma padrão

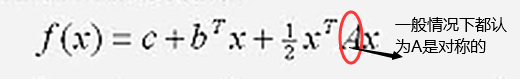

(2) Forma vetorial de matriz

Em outras palavras, a matriz A sempre pode ser escrita na forma simétrica, porque através da conversão da "forma padrão do vetor da matriz", a matriz A pode sempre ser transformada em uma forma de matriz simétrica:

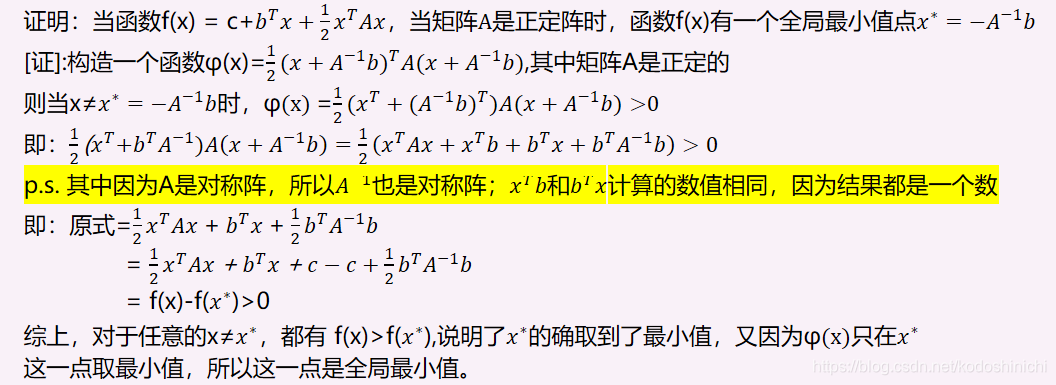

2. Natureza

(1) Se a matriz A é definida positiva, então a função quadrática correspondente f (x) é considerada uma função quadrática definida positiva.

ps Aqui você pode comparar a definição e classificação das formas quadráticas.

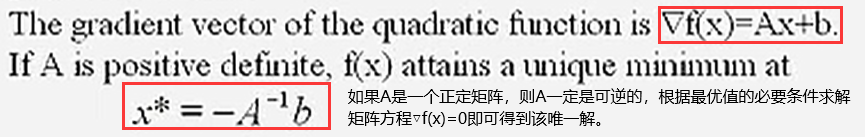

(2) Para a função quadrática, de acordo com a regra de derivação da matriz, o vetor gradiente pode ser obtido; se A é uma matriz definida positiva, então a função quadrática definida positiva f (x) tem uma solução mínima única .

【provar】

Direção do conjugado complexo

1. Definição de conjugação

(1) Ortogonalidade de vetores

Se o resultado da operação de produto interno de dois vetores for 0, os dois vetores são considerados ortogonais entre si .

u T v = <u, v> = 0 u ^ Tv = <u, v> = 0vocêT v=<vc ,v>=0

(2) Conjugado mútuo.

Defina uma matriz positiva definida A. Se dois vetores uev satisfazem que u e Av são ortogonais, então os vetores uev são conjugados em relação à matriz A.

u TA v = <u, A v> = 0 u ^ TAv = <u, Av> = 0vocêT Av=<vc ,A v>=0

particularmente, se um determinado conjunto de vetores U.1, U2, ..., Un-, e tem UITAuJ= 0 (I ≠ J), então em queum conjunto de vetores U.1, U2, ..., uné sobre o conjugado mútuodamatriz A; obviamente, um conjunto de vetores sobre o conjugado da mesma matrizdeve ser linearmente independente.

A ortogonalidade pode ser considerada como uma forma especial de conjugado . Quando a matriz A assume a matriz identidade I, u T Av = u T v.

Para qualquer dada matriz definida positiva A, devemos encontrar o conjugado mútuo Dois vetores; na discussão de No algoritmo de convergência de segunda ordem neste capítulo, usaremos a direção desse tipo de vetor especial como a direção de busca , e não mais usaremos a direção do gradiente.

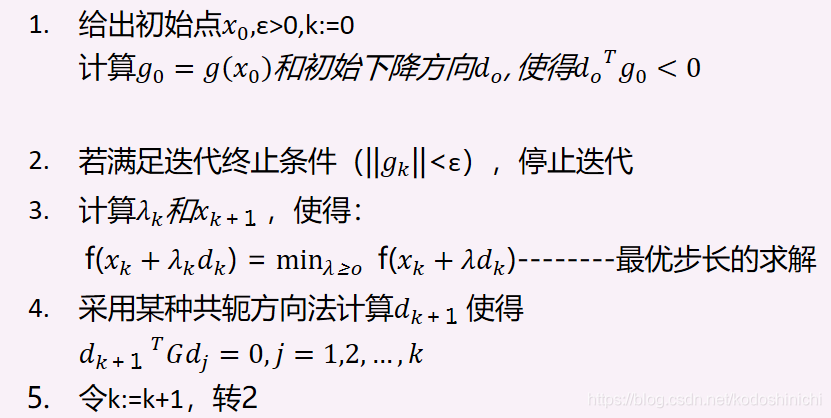

2. Idéia do algoritmo

A estrutura do algoritmo geral é consistente com o [Método do Gradiente Ótimo], exceto que a direção de pesquisa conjugada é usada para substituir a direção do gradiente interno do anterior.

3. Conclusões e Teoremas

- Teorema: O algoritmo obtido usando a direção conjugada como direção de busca em cada etapa da otimização é convergente de segunda ordem.

Como dissemos no início, ao discutir [Convergência de segunda ordem], precisamos apenas verificar se o algoritmo pode encontrar uma solução ótima de uma função quadrática definida positiva dentro de um número finito de passos .

- Conclusão: Através da prova acima, não é difícil descobrir que [escolha do ponto inicial] e [ordem de arranjo da direção de busca conjugada] não têm efeito no algoritmo.

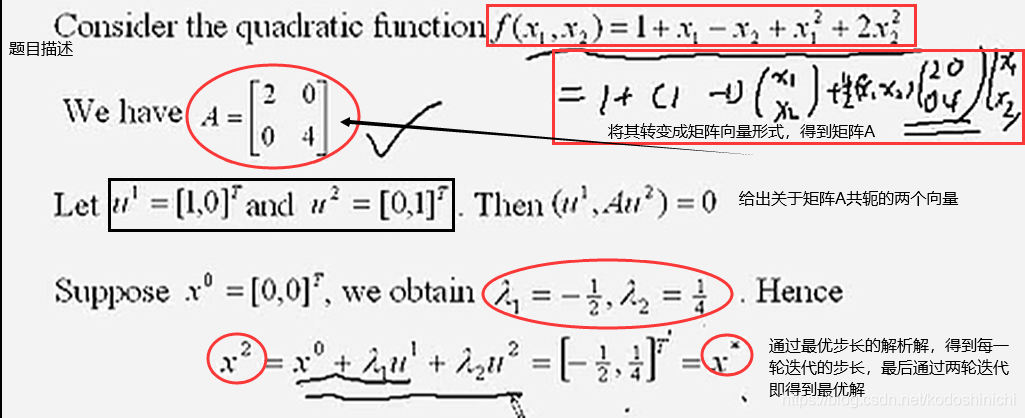

4. Exemplo

Neste exemplo, os dois vetores conjugados são dados, basta usar o algoritmo para calcular através das condições fornecidas; o acompanhamento explicará como resolver os dois vetores sobre o conjugado de uma determinada matriz.

Método de direção de conjugado complexo

O método de direção conjugada é um termo geral para uma classe de algoritmos, usado para descrever aqueles métodos cujas direções de pesquisa são conjugadas entre si . Podemos obter o método de direção conjugada modificando o algoritmo discutido anteriormente, como [Método do gradiente ideal].

A chave para o método de direção do conjugado é encontrar dois vetores sobre o conjugado de uma dada matriz.

1. Avalie se o

método do gradiente conjugado está entre o método de descida mais íngreme e o método de Newton, e só precisa usar as informações derivadas de primeira ordem; ele supera as deficiências da "velocidade de convergência lenta" do método de descida mais íngreme, e também evita o "segundo armazenamento e cálculo" do método de Newton. A deficiência de "derivada de ordem e alto custo" é um dos algoritmos mais eficazes para resolver grandes problemas de otimização (não) linear.

- Não é necessário armazenamento de matriz

- Tem uma taxa de convergência mais rápida

- Convergência de segunda ordem

2. Método geral de direção do conjugado

Método do gradiente conjugado

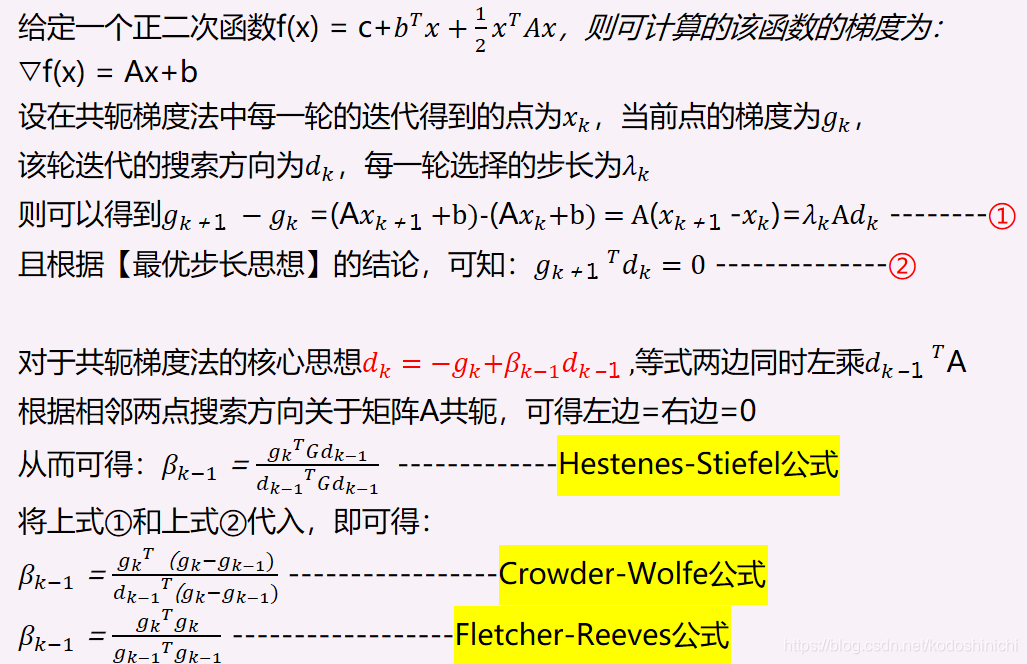

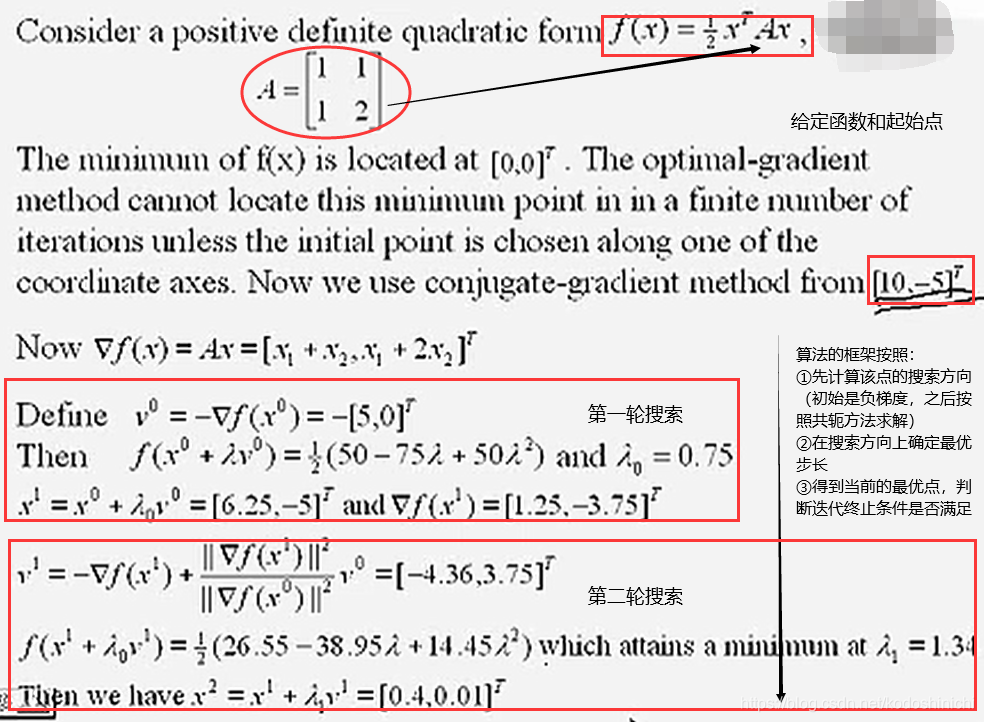

O algoritmo de gradiente conjugado é um algoritmo de direção conjugada típico, e cada uma de suas direções de pesquisa é conjugada entre si. Essas direções de pesquisa d k são a combinação da direção do gradiente negativo -g k e a direção de pesquisa d k-1 da iteração anterior . Portanto, a capacidade de armazenamento é pequena e o cálculo é conveniente.

dk = - gk + β k - 1 dk - 1, onde β é o coeficiente de combinação d_k = -g_k + β_ {k-1} d_ {k-1}, onde β é o coeficiente de combinaçãodk=- gk+bk - 1dk - 1, Que é o β é um número de linhas de ligação de grupo

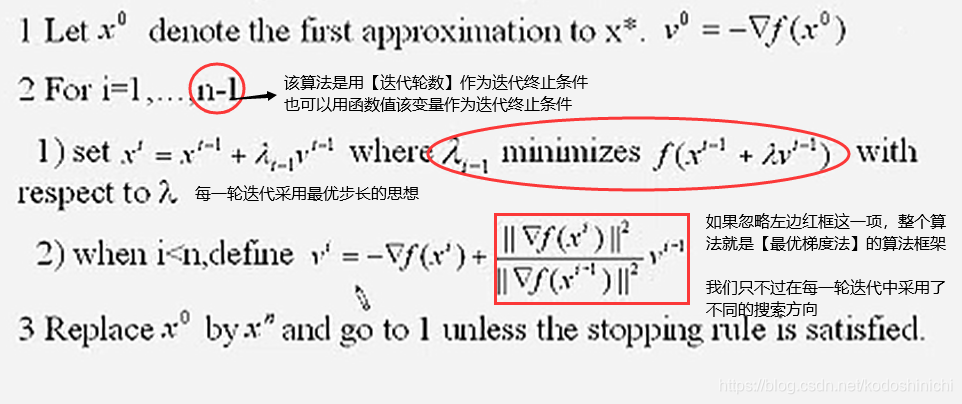

1. Algoritmo de gradiente de conjugado FR (Fletcher-Reeves)

ps Anteriormente, discutimos que o método de direção conjugada pode convergir para a solução ótima em etapas finitas para funções quadráticas definidas positivas, mas o algoritmo acima não é apenas aplicável a funções quadráticas;

portanto, a terceira etapa [ use o ponto encontrado atual x n novamente É necessário substituir o ponto original x 0 e então iniciar uma nova iteração .

Quando esses algoritmos são implementados com o auxílio de computadores, haverá erros de cálculo . Portanto, mesmo que um problema de otimização de função quadrática positiva seja resolvido, pode haver a possibilidade de "não conseguir convergir em uma etapa finita", portanto, a terceira etapa do algoritmo acima é totalmente necessário.

2. Breve compreensão O

algoritmo acima é viável para qualquer função. Podemos usar o caso especial da função quadrática positiva para verificar a ideia de resolver a direção conjugada:

no algoritmo acima, usamos a fórmula FR para calcular o dado matriz Dois vetores que são conjugados são o algoritmo de gradiente conjugado FR.

3. Exemplo

4. Avaliação

Em cada iteração, embora apenas as informações relevantes da primeira derivada sejam usadas, o gradiente ainda precisa ser calculado e a quantidade de cálculo ainda é relativamente complicada.

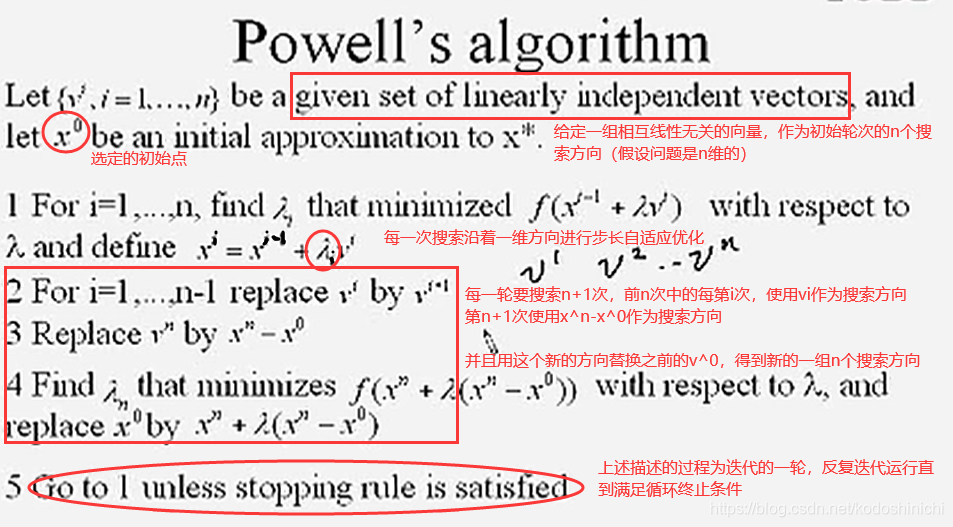

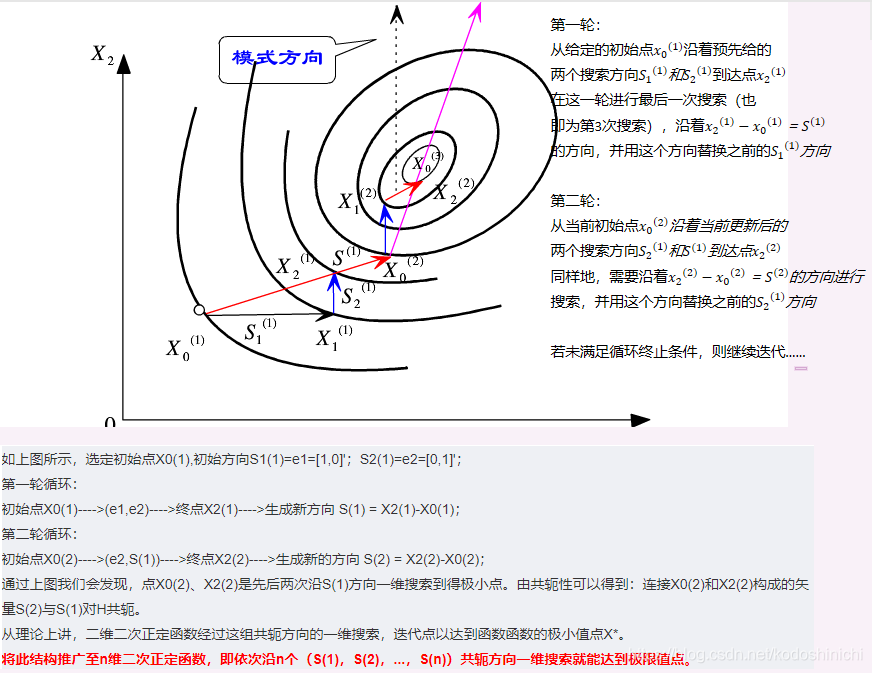

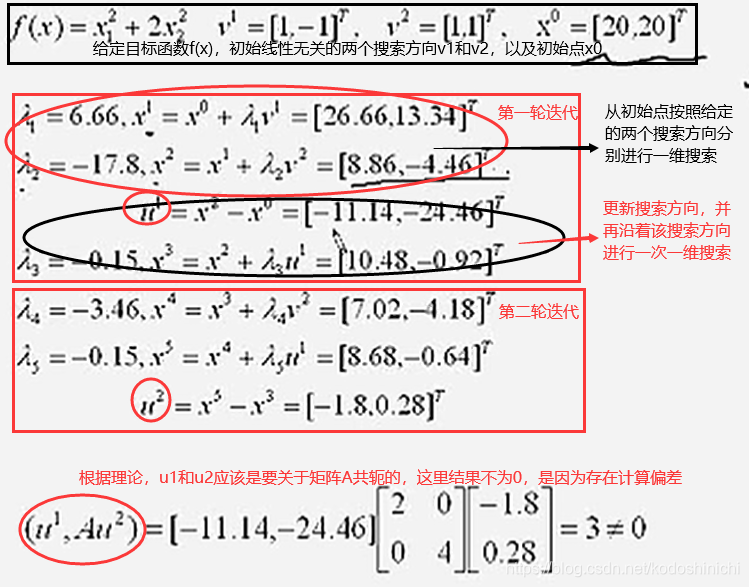

Algoritmo de Powell

O núcleo do algoritmo de Powell é a esperança: dois vetores que são conjugados podem ser encontrados sem resolver o gradiente.

Ele acredita que se os dois pontos x 1 ex 2 são uma busca unidimensional para encontrar dois vetores ao longo da mesma direção de busca em diferentes pontos iniciais, então no problema de otimização da função quadrática, o vetor x 2 -x 1 é Deveria ser ortogonal ao vetor v.

1. Ideia e estrutura do algoritmo.

Resumindo: para um problema de otimização irrestrita n-dimensional, quando a condição de término do loop fornecida não for atendida, ele continuará a realizar rodadas de iterações, e cada iteração executará n + Uma otimização unidimensional pesquisa, a n + 1ª pesquisa será realizada ao longo da direção de x n -x 0 , e esta nova direção [x n -x 0 ] será usada para substituir a direção de pesquisa v 0 inicial .

2. Diagrama do processo do algoritmo

Fonte da figura "Compreensão aprofundada do algoritmo de otimização de Powell"

A postagem do blog fornecida no link acima discute a teoria e o processo de otimização do algoritmo de Powell em detalhes.Os leitores que precisam de um conhecimento profundo do algoritmo de Powell podem dar uma olhada na postagem do blog original para entender.

3. Exemplos

Método Quasi-Newton

1. Visão geral das ideias de algoritmo

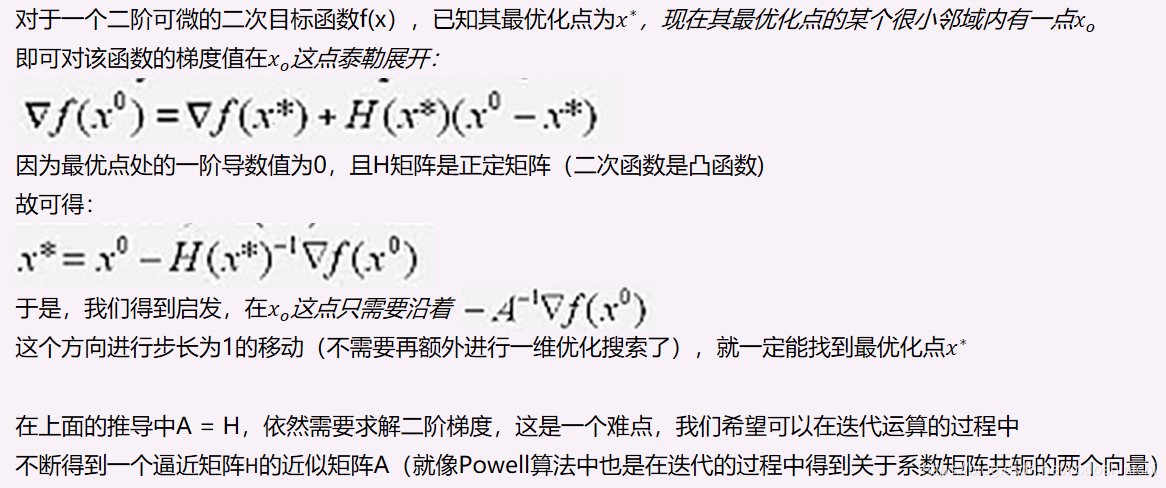

A aplicação bem-sucedida do método de Newton para problemas de otimização reside no uso da informação de curvatura da matriz de Hessan, mas o cálculo da matriz de Hessan é muito trabalhoso, e nem todas as funções objetivo têm matrizes de Hessan, então pensamos sobre

se só pode usar a função objetivo A informação do valor e a primeira derivada constrói o valor aproximado da curvatura da função objetivo , acelerando assim a velocidade de convergência do [método quase Newton].

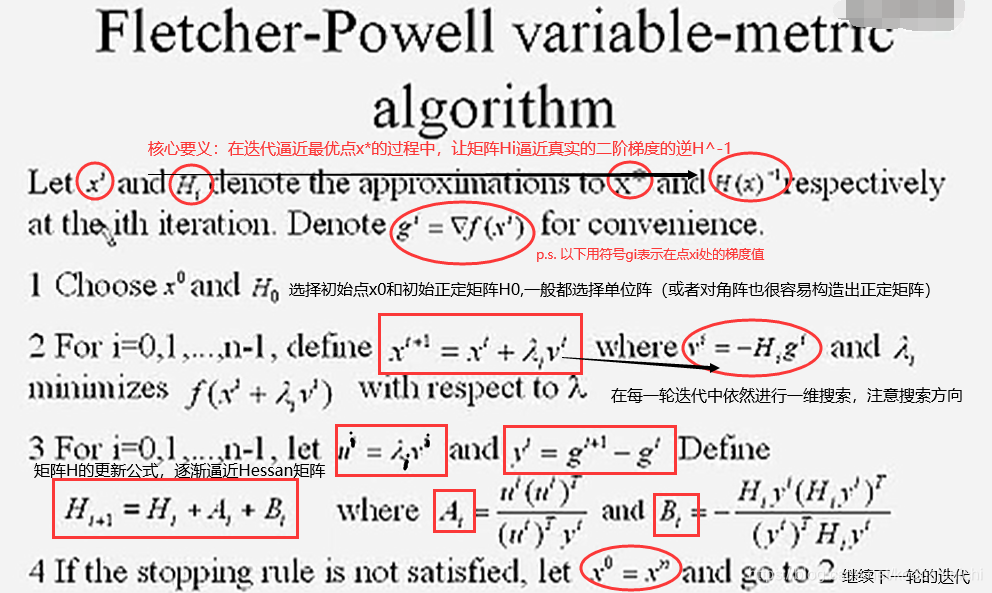

2. Método FP quase Newton