Haga clic en el texto azul

Síganos

¡AI TIME da la bienvenida a todos los entusiastas de la IA para que se unan!

Canal en vivo de Bilibili

Escanee el código QR para seguir la cuenta oficial de AI TIME Bilibili y programar una cita para la transmisión en vivo

6 de septiembre de 2023 15:00-17:00

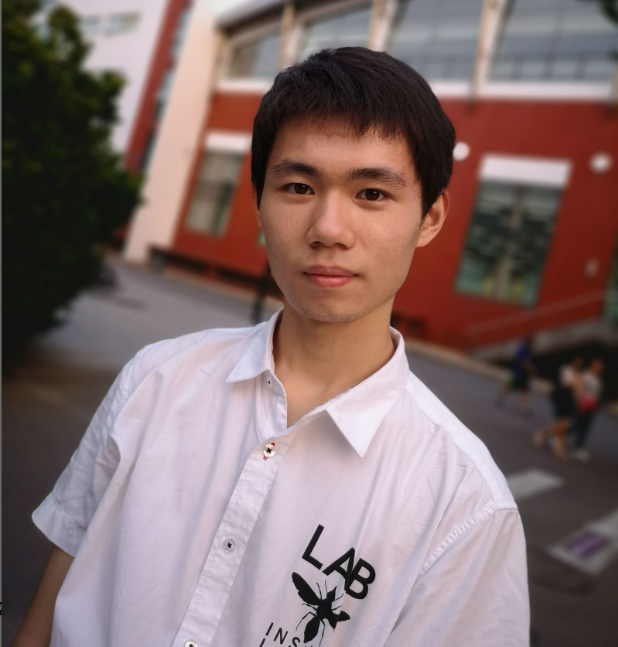

Tang Tian Yi

Estudiante de segundo año de maestría en la Escuela Hillhouse de Inteligencia Artificial de la Universidad Renmin de China, bajo su supervisor el profesor Zhao Xin. Se centra principalmente en investigaciones relacionadas con grandes modelos de lenguaje y generación de texto. Ha publicado más de diez artículos relacionados en conferencias sobre procesamiento del lenguaje natural como ACL, EMNLP, NAACL y COLING. El modelo de preentrenamiento de código abierto MVP se ha descargado más de 250.000 veces en Hugging Face, y el kit de herramientas de código abierto "TextBox" ha recibido más de 1.000 estrellas en GitHub.

Página de inicio personal: https://steventang1998.github.io/

luo haoran

Soy estudiante de doctorado de segundo año en la Facultad de Ciencias de la Computación de la Universidad de Correos y Telecomunicaciones de Beijing y mi supervisor es el profesor E Haihong. Las direcciones de investigación incluyen principalmente gráficos de conocimiento, modelos de preentrenamiento a gran escala y redes neuronales de gráficos. Se han publicado trabajos de investigación relevantes en congresos y revistas como ACL y AAAI. Durante mucho tiempo se ha desempeñado como revisor de ACL, AAAI, EMNLP, COLING y otras conferencias.

Página de inicio personal: https://lhrlab.github.io/

Li Yunxin

Estudiante de doctorado de segundo año en la Escuela de Ciencias de la Computación y Tecnología del Instituto de Tecnología de Harbin (Shenzhen), cuyo supervisor es el profesor Hubota. Las direcciones de investigación incluyen principalmente la comprensión de contenido multimodal y el razonamiento conjunto, la interacción persona-computadora y los modelos de lenguaje multimodal de gran tamaño. Se han publicado trabajos de investigación relevantes en conferencias y revistas como ACL, KDD, ACM MM y TMM.

Página de inicio personal: https://yunxinli.github.io/

Xiaomin

Es estudiante de doctorado de cuarto año en el grupo de investigación del profesor Zong Chengqing del Instituto de Automatización de la Academia de Ciencias de China, y su supervisor es el investigador Zhou Yu. Las principales direcciones de investigación son el resumen multimodal y los modelos de lenguajes grandes multimodales.

Agenda del evento e información de presentación de informes.

15:00-15:20

Tang Tian Yi

Modelo de generación de texto previo al entrenamiento supervisado de múltiples tareas MVP + método de generación de texto visualmente mejorado EN VIVO

15:20-15:40

luo haoran

Aprendizaje de representación integrado previo al entrenamiento para gráficos de conocimiento hiperrelacionales

15:40-16:00

Li Yunxin

Fundamentación de modelos de lenguaje en imágenes para razonamiento multimodal

16:00-16:20

Xiaomin

CFSum: una red de contribución de gruesa a fina para el resumen multimodal

16:20-17:00

Panel

1. ¿Cómo mejorar la interpretabilidad de la inferencia de modelos multimodales? Mientras se busca la interpretabilidad de la inferencia, ¿cómo equilibrar el rendimiento y la capacidad de explicación del modelo para satisfacer las necesidades de las aplicaciones prácticas?

2. ¿Cómo equilibrar las compensaciones y la autoridad entre diferentes informaciones modales para lograr la eficacia del razonamiento colaborativo? ¿Cómo proteger mejor la seguridad de la información en términos de privacidad de datos?

3. ¿Cuáles son las direcciones de desarrollo de la generación de texto de modelo grande controlable? ¿Cómo medir la controlabilidad para cumplir con las amplias expectativas sociales para la generación de textos de modelos grandes?

…………

Asistente de WeChat de AI TIME

Artículos recomendados de números anteriores.

¡Recuerda seguirnos! ¡Nuevos conocimientos cada día!

Acerca de TIEMPO AI

AI TIME se originó en 2019, con el objetivo de impulsar el espíritu de especulación científica, invitar a personas de todos los ámbitos de la vida a explorar las cuestiones esenciales de la teoría, los algoritmos y las aplicaciones de escenarios de la inteligencia artificial, fortalecer la colisión de ideas y conectar a los académicos globales de la IA. Expertos y entusiastas de la industria, con la esperanza de En forma de debate, exploramos la contradicción entre la inteligencia artificial y el futuro de la humanidad, y exploramos el futuro del campo de la inteligencia artificial.

Hasta la fecha, AI TIME ha invitado a más de 1300 oradores nacionales y extranjeros, ha celebrado más de 600 eventos y ha sido visto por más de 6 millones de personas.

Te conozco

pase a ver

Vaya

~

¡ Haz clic para leer el texto original y reservar una transmisión en vivo!