En primer lugar, ¿cuál es Perceptrón

Las redes neuronales artificiales Perceptrón es un hito en el perceptrón, el nombre es un poco engañoso, ya que es fundamental tomar decisiones. Perceptrón es en realidad un concepto básico de las neuronas, cuánto de ella no puede tener el concepto de red, es una máquina automática para tomar decisiones.

referencia https://blog.csdn.net/why19940926/article/details/78720641

En segundo lugar, ¿cuál es la sola capa Perceptron

Antes de la introducción de una sola capa Perceptron, necesitamos introducir dos conceptos: lineal lineal separables e inseparables.

separabilidad lineal : separabilidad lineal puede ser una función lineal que está separada de las dos muestras, como el espacio de dos dimensiones en una línea recta, plano espacio tridimensional y un espacio de alta dimensional en una función lineal. Medios se pueden dividir en los llamados error separados.

Linealmente inseparable : linealmente inseparable se refiere a se producen los errores de clasificación cuando parte de la muestra dividido por el hiperplano lineal.

referencia https://blog.csdn.net/why19940926/article/details/78720641

De una sola capa perceptrón se puede utilizar para distinguir linealmente separables de datos, y será capaz de converger en un número finito de iteraciones.

De una sola capa perceptrón se puede utilizar para simular la función lógica, negación lógica NOT, NOR lógica de la XOR, o NAND lógica OR lógica, lógica AND y NAND y similares, pero no se puede utilizar para simular lógica XOR XOR (problema XOR es linealmente inseparable ).

Nota: una sola capa de perceptrón con una sola neurona es diferente.

En tercer lugar, el principio de una sola capa Perceptron

3.1 El principio básico

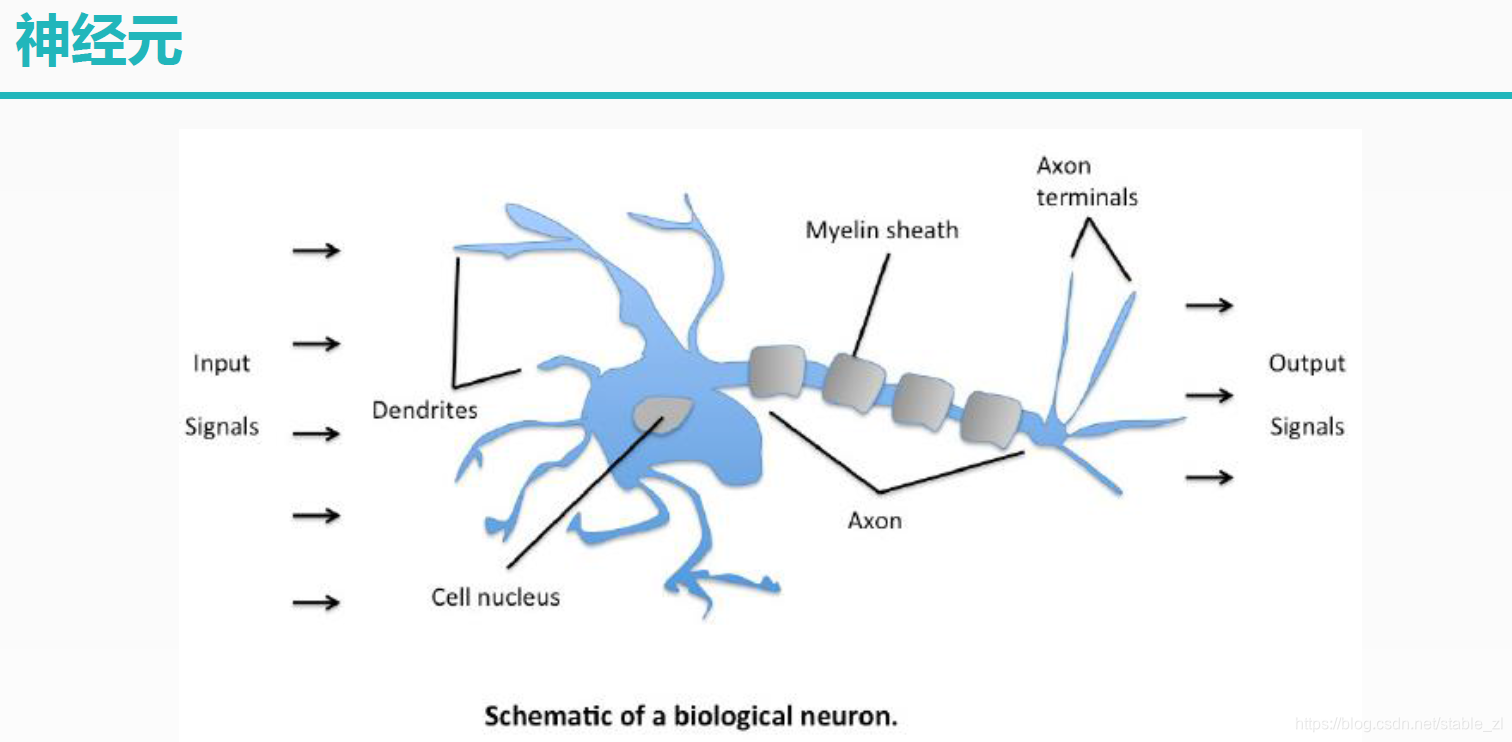

red neuronal artificial es el simulado red cuerpo humano neural puede verse que la neurona consta de tres partes, la entrada, medio, de salida, entrada y salida pueden tener una pluralidad de, en el medio de un proceso realizado.

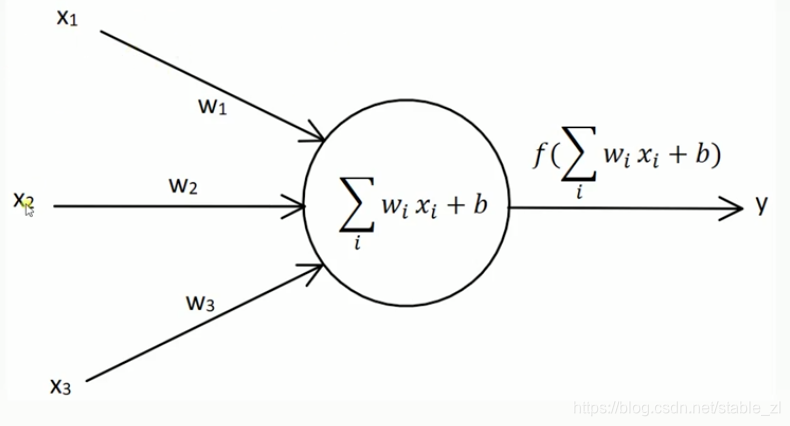

El más simple es una red de percepción neural de una sola capa, puede haber una pluralidad de entradas, el procesamiento do intermedio, la salida final.

x1, x2, x3 son el nodo de entrada

y es un nodo de salida

w1, w2, w3 es el peso correspondiente al valor de

b es un factor de sesgo (típicamente, se puede reemplazar una porción como factor de entrada b, y su valor es 1, entonces la adición de un peso correspondiente para constituir b)

3.2 El principio

Entrada: X

Tasa de aprendizaje: LR

función de activación: responsable de la operación vuelve a consecuencia de O,

f (X) = {1, X> 0;

0, X = 0;

-1, X <0}

w Error: lr × (salida esperada Y - los resultados en función de activación O) × X

perceptron de una sola capa se repite el cálculo de errores W_c, entonces la corriente obtenida por adición de nuevo W1 W0, W1 y luego en la nueva función de activación, si no se requiere, para calcular detuvo de nuevo hasta que una condición de convergencia se satisface cálculo.

condiciones de convergencia:

1, un pequeño error es menor que un valor predeterminado Mogg

2, el cambio de peso entre dos iteraciones es muy pequeña

3, llega a un número máximo predeterminado de iteraciones