sección de grandes volúmenes de datos 5 Zhou

1.Hadoop configuración del sistema

1.1 configuración del entorno

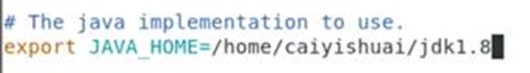

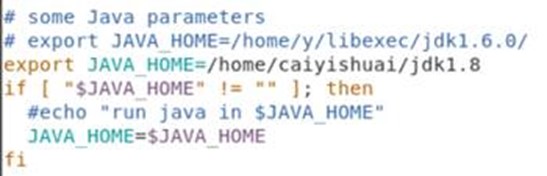

Tenemos que configurar dos archivos: hadoop-env.sh y yarn-env.sh , configuración JAVA_HOME variable.

-

vi hadoop-env.sh , modificado en lo siguiente:

-

yarn-env.sh VI , un aumento: Exportación del JAVA_HOME = / home / user1 / jdk1.8 .

1.2 disposición de núcleo-site.xml

Agregue el siguiente al archivo:

<Propiedad>

<Nombre> fs.defaultFS </ name>

<Valor> hdfs: // maestro: 9000 </ value>

</ Property>

<Propiedad>

<Nombre> hadoop.tmp.dir </ name>

<Valor> / home / user1 / hadoopdata </ value>

</ Property>

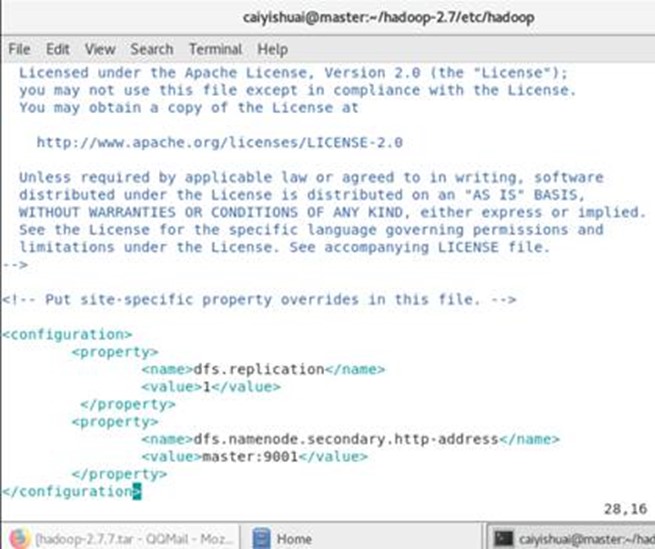

1.3 Configuración hdfs-site.xml

Agregue el siguiente al archivo:

<Propiedad>

<Nombre> dfs.replication </ name>

<Valor> 1 </ value>

<! - Conjunto DFS número de copias, y nos ponen a 1 , en este caso, no hay seguridad de datos ->

</ Property>

<Propiedad>

<Nombre> dfs.namenode.secondary.http Dirección </ name>

<Valor> maestro: 9001 </ value>

<! - Conjunto secondnamenode dirección, que actualmente se calculan a NameNode nodo, este arreglo es muy razonable, pero teniendo en cuenta nuestra situación actual ->

</ Property>

1.4 disposición de hilo site.xml

Agregue el siguiente al archivo:

<Propiedad>

<Nombre> yarn.nodemanager.aux-services </ name>

<Valor> mapreduce_shuffle </ value>

</ Property>

<Propiedad>

<Nombre> yarn.nodemanager.aux-services.mapreduce_shuffle.class </ name>

<Valor> org.apache.hadoop.mapred.ShuffleHandler </ value>

</ Property>

<Propiedad>

<Nombre> yarn.resourcemanager.address </ name>

<Valor> maestro: 8032 </ value>

</ Property>

<Propiedad>

<name>yarn.resourcemanager.scheduler.address</name>

<value>master:8030</value>

</property>

<property>

<name>yarn.resourcemanager.resource-tracker.address</name>

<value>master:8035</value>

</property>

<property>

<name>yarn.resourcemanager.admin.address</name>

<value>master:8033</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>master:8088</value>

</property>

1.5 配置mapred-site.xml

先把模板文件另存为非模板文件:cp mapred-site.xml.template mapred-site.xml

在文件中添加如下内容

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

1.6 配置slaves文件

删除文件原内容,添加

slave0

slave1

2.拷贝hadoop文件包到其他节点。

scp -r hadoop-2.7 slave0:~

scp -r hadoop-2.7 slave1:~

3. 启动hadoop集群前准备

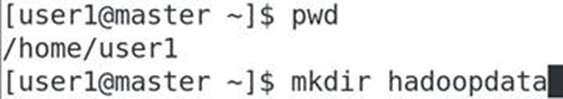

3.1在namenode上建立文件夹

按照core-site.xml文件,建立文件夹。

3.2格式化namenode

hadoop namenode –format

如果显示DEPRECATED: Use of this script to execute hdfs command is deprecated.Instead use the hdfs command for it.

原来从0.21.0版本以后,hadoop 命令换成了hdfs命令,上面的命令如同下面的命令

hdfs namenode –format

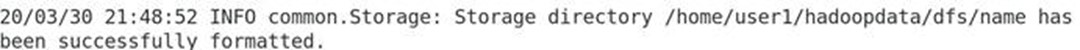

命令执行后如果看到这句:

说明格式化成功了。

如格式化不成功,下次格式化之前,需要删除在namenode上建立的文件夹hadoopdata,然后重新建立文件夹hadoopdata。

4.启动Hadoop集群

start-all.sh

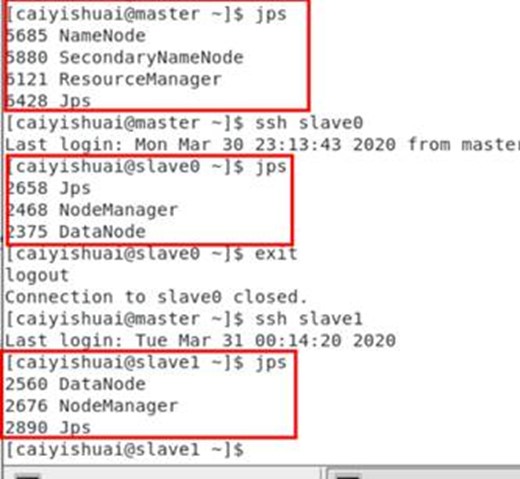

执行后,用jps检查java线程,master节点如图,slave节点如图:

如果不成功,检查配置文件。

测试:上传一个文件到集群 hadoop fs –put 文件名 /,然后检查:hadoop fs –ls /

5关闭集群

stop-all.sh

关闭虚拟机之前,请务必先关闭集群。