Diretório de artigos

O princípio do filebeat

O Filebeat funciona assim: quando você inicia o Filebeat, ele inicia uma ou mais entradas que ele procura no local especificado para os dados de log. Para cada log que o Filebeat encontra, o Filebeat inicia um coletor. Cada coletor lê um único log para novo conteúdo e envia os novos dados de log para o libbeat, que agregará os eventos e enviará os dados agregados para a saída configurada para Filebeat

Estrutura Filebeat: Consiste em dois componentes, entradas (entradas) e coletores (coletores), que trabalham juntos para rastrear arquivos e enviar dados de eventos para a saída especificada.O coletor é responsável por ler o conteúdo de um único arquivo. O harvester lê cada arquivo linha por linha e envia o conteúdo para a saída. Inicie um harvester para cada arquivo. O harvester é responsável por abrir e fechar os arquivos, o que significa que os descritores de arquivo permanecem abertos enquanto o harvester está em execução. Se um arquivo for excluído ou renomeado enquanto estiver sendo coletado, o Filebeat continuará lendo o arquivo. Um efeito colateral disso é que o espaço no disco é reservado até que o harvester seja desligado. Por padrão, o Filebeat mantém os arquivos abertos até que close_inactive seja alcançado

Kafka

Kafka é uma fila de mensagens, que é usada principalmente para processar filas de mensagens no estado de grandes quantidades de dados e geralmente é usada para processamento de logs. Por ser uma fila de mensagens, Kafkatambém possui as características correspondentes da fila de mensagens.

Os benefícios das filas de mensagens kafka

Desacoplamento de aplicativos

amortecedor

Corte de tráfego

Processamento assíncrono

Introdução ao zookeeper

É um framework de serviço distribuído e um subprojeto do Apache Hadoop. É usado principalmente para resolver alguns problemas de gerenciamento de dados frequentemente encontrados em aplicativos distribuídos, como: serviço de nomeação unificado, serviço de sincronização de estado, gerenciamento de cluster, gerenciamento distribuído de configuração do aplicativo itens, etc

Equivalente ao sistema de arquivos + mecanismo de notificação

Construir Filebeat+zookeeper+kafka+ELK

![[Falha na transferência da imagem do link externo, o site de origem pode ter mecanismo anti-leech, é recomendado salvar a imagem e carregá-la diretamente (img-mZ6j6dkT-1646744485306) (C:\Users\zhuquanhao\Desktop\Screenshot command collection\linux \filebeat+ELK\ 1.bmp)]](https://img-blog.csdnimg.cn/6d9ea1fab4bf4a738d95a5fd97865975.bmp?x-oss-process=image/watermark,type_d3F5LXplbmhlaQ,shadow_50,text_Q1NETiBA55av54uC55qE5pav5Zu-5Y2h,size_20,color_FFFFFF,t_70,g_se,x_16)

| Nome da CPU | IP | sistema | componentes |

|---|---|---|---|

| nó1 | 192.168.100.142 | centos7 | Elasticsearch, Elasticsearch-head, Kiabana |

| nó2 | 192.168.100.140 | centos7 | Elasticsearch, Elasticsearch-head |

| apache | 192.168.100.141 | centos7 | httpd, logstash, |

| filebeat1 | 192.168.100.145 | centos7 | tratador de zoológico, kafka |

| filebeat2 | 192.168.100.134 | centos7 | tratador de zoológico, kafka |

| arquivobeat3 | 192.168.100.144 | centos7 | tratador de zoológico, kafka |

Este experimento foi realizado no último experimento do ELK, portanto, não demonstrarei a implantação do ELK. Se precisar, você pode acessar meu último blog, que apresenta detalhadamente as etapas de implantação e do ELK.

Mais perto de casa, vamos começar esta experiência

1. Instale o zookeeper kafka (operar em fiebeat1 - 3)

(1) Descompacte e instale o pacote de armadura macia do zookeeper

[root@bogon opt]# tar zxvf apache-zookeeper-3.5.7-bin.tar.gz

[root@bogon opt]# mv apache-zookeeper-3.5.7-bin /usr/local/zookeeper-3.5.7

[root@bogon opt]# cd /usr/local/zookeeper-3.5.7/

[root@bogon conf]# cp zoo_sample.cfg zoo.cfg

[root@bogon conf]# vim zoo.cfg

![[Falha na transferência da imagem do link externo, o site de origem pode ter mecanismo anti-leech, é recomendado salvar a imagem e carregá-la diretamente (img-H834TMbN-1646744485308) (C:\Users\zhuquanhao\Desktop\Screenshot command collection\linux \filebeat+ELK\ 2.bmp)]](https://img-blog.csdnimg.cn/484b6c7f9be447d28be5fa110ff0e2fa.bmp?x-oss-process=image/watermark,type_d3F5LXplbmhlaQ,shadow_50,text_Q1NETiBA55av54uC55qE5pav5Zu-5Y2h,size_20,color_FFFFFF,t_70,g_se,x_16)

![[Falha na transferência da imagem do link externo, o site de origem pode ter mecanismo anti-leech, é recomendável salvar a imagem e carregá-la diretamente (img-apt6FqPr-1646744485309) (C:\Users\zhuquanhao\Desktop\Screenshot command collection\linux \filebeat+ELK\ 3.bmp)]](https://img-blog.csdnimg.cn/d1b58b0bf24947fe8190da27013a2d13.bmp?x-oss-process=image/watermark,type_d3F5LXplbmhlaQ,shadow_50,text_Q1NETiBA55av54uC55qE5pav5Zu-5Y2h,size_20,color_FFFFFF,t_70,g_se,x_16)

[root@bogon conf]# cd ..

[root@bogon zookeeper-3.5.7]# mkdir data logs

[root@bogon zookeeper-3.5.7]# echo 1 > data/myid

## 给每个机器指定对应的节点号

![[Falha na transferência da imagem do link externo, o site de origem pode ter mecanismo anti-leech, é recomendado salvar a imagem e carregá-la diretamente (img-F3ppSyS1-1646744485310) (C:\Users\zhuquanhao\Desktop\Screenshot command collection\linux \filebeat+ELK\ 4.bmp)]](https://img-blog.csdnimg.cn/ab52688066474180b5a53f262fc66ad7.bmp)

(2) Iniciar tratador

![[Falha na transferência da imagem do link externo, o site de origem pode ter mecanismo anti-leech, é recomendável salvar a imagem e carregá-la diretamente (img-qWS4Bs2h-1646744485311) (C:\Users\zhuquanhao\Desktop\Screenshot command collection\linux \filebeat+ELK\ 5.bmp)]](https://img-blog.csdnimg.cn/5826850c85db4e3a8f49a8dcce804536.bmp?x-oss-process=image/watermark,type_d3F5LXplbmhlaQ,shadow_50,text_Q1NETiBA55av54uC55qE5pav5Zu-5Y2h,size_20,color_FFFFFF,t_70,g_se,x_16)

Veja o status do zookeeper de três nós

![[Falha na transferência da imagem do link externo, o site de origem pode ter mecanismo anti-leech, é recomendado salvar a imagem e carregá-la diretamente (img-SuNV7Inf-1646744485312) (C:\Users\zhuquanhao\Desktop\Screenshot command collection\linux \filebeat+ELK\ 6.bmp)]](https://img-blog.csdnimg.cn/a7e5a5df02184e5497df2f391dae7d9c.bmp)

![[Falha na transferência da imagem do link externo, o site de origem pode ter mecanismo anti-leech, é recomendado salvar a imagem e carregá-la diretamente (img-0rPrdXQe-1646744485313) (C:\Users\zhuquanhao\Desktop\Screenshot command collection\linux \filebeat+ELK\ 7.bmp)]](https://img-blog.csdnimg.cn/f40e1e25eddc4421ae6079b9708d922d.bmp)

![[Falha na transferência da imagem do link externo, o site de origem pode ter mecanismo anti-leech, é recomendado salvar a imagem e carregá-la diretamente (img-DJ2A3Up9-1646744485313) (C:\Users\zhuquanhao\Desktop\Screenshot command collection\linux \filebeat+ELK\ 8.bmp)]](https://img-blog.csdnimg.cn/a094bfa7f2ee4fa0be937e8639c55bd4.bmp)

(2) Instale o kafka (opera em fiebeat1 - 3)

[root@bogon bin]# cd /opt/

[root@bogon opt]# tar zxvf kafka_2.13-2.7.1.tgz

[root@bogon opt]# mv kafka_2.13-2.7.1 /usr/local/kafka

(3) Modifique o arquivo de configuração

[root@bogon opt]# cd /usr/local/kafka/

[root@bogon kafka]# cd config/

[root@bogon config]# vim server.properties

![[Falha na transferência da imagem do link externo, o site de origem pode ter mecanismo anti-leech, é recomendado salvar a imagem e carregá-la diretamente (img-dbcHrWzq-1646744485314) (C:\Users\zhuquanhao\Desktop\Screenshot command collection\linux \filebeat+ELK\ 9.bmp)]](https://img-blog.csdnimg.cn/dfb82efcedd54b2a84d76f2eb32444ea.bmp?x-oss-process=image/watermark,type_d3F5LXplbmhlaQ,shadow_50,text_Q1NETiBA55av54uC55qE5pav5Zu-5Y2h,size_20,color_FFFFFF,t_70,g_se,x_16)

![[Falha na transferência da imagem do link externo, o site de origem pode ter um mecanismo anti-leech, é recomendado salvar a imagem e carregá-la diretamente (img-PnuQyrCb-1646744485315) (C:\Users\zhuquanhao\Desktop\Screenshot command collection\ linux\filebeat+ELK\10.bmp)]](https://img-blog.csdnimg.cn/e9f5095f879e4d04928320f99ca60938.bmp)

(4) Adicione comandos relevantes ao ambiente do sistema

[root@bogon kafka]# vim /etc/profile

[root@bogon kafka]# source /etc/profile

![[Falha na transferência da imagem do link externo, o site de origem pode ter mecanismo anti-leech, é recomendável salvar a imagem e carregá-la diretamente (img-kaRWjcwb-1646744485315) (C:\Users\zhuquanhao\Desktop\Screenshot command collection\linux \filebeat+ELK\ 11.bmp)]](https://img-blog.csdnimg.cn/339562cd587c4d0a87f9cf6fdfd31cbe.bmp?x-oss-process=image/watermark,type_d3F5LXplbmhlaQ,shadow_50,text_Q1NETiBA55av54uC55qE5pav5Zu-5Y2h,size_20,color_FFFFFF,t_70,g_se,x_16)

(5) Ativar kafka

![[Falha na transferência da imagem do link externo, o site de origem pode ter mecanismo anti-leech, é recomendado salvar a imagem e carregá-la diretamente (img-7FvpQyRp-1646744485316) (C:\Users\zhuquanhao\Desktop\Screenshot command collection\linux \filebeat+ELK\ 12.bmp)]](https://img-blog.csdnimg.cn/bb53f5acac4245a7a3e26ac20e112560.bmp)

criar tópico

(192.168.100.145)

![[Falha na transferência da imagem do link externo, o site de origem pode ter mecanismo anti-leech, é recomendável salvar a imagem e carregá-la diretamente (img-jSCpgJyn-1646744485317) (C:\Users\zhuquanhao\Desktop\Screenshot command collection\linux \filebeat+ELK\ 13.bmp)]](https://img-blog.csdnimg.cn/661acbde2dcd4d68975b3bbfdbeddbaa.bmp?x-oss-process=image/watermark,type_d3F5LXplbmhlaQ,shadow_50,text_Q1NETiBA55av54uC55qE5pav5Zu-5Y2h,size_20,color_FFFFFF,t_70,g_se,x_16)

tópico de teste

Mensagem de liberação (192.168.100.145)

![[Falha na transferência da imagem do link externo, o site de origem pode ter mecanismo anti-leech, é recomendado salvar a imagem e carregá-la diretamente (img-i1cwdlmF-1646744485317) (C:\Users\zhuquanhao\Desktop\Screenshot command collection\linux \filebeat+ELK\ 14.bmp)]](https://img-blog.csdnimg.cn/d8bb498a713f4cf390bcd97fe9ec5273.bmp?x-oss-process=image/watermark,type_d3F5LXplbmhlaQ,shadow_50,text_Q1NETiBA55av54uC55qE5pav5Zu-5Y2h,size_20,color_FFFFFF,t_70,g_se,x_16)

![[Falha na transferência da imagem do link externo, o site de origem pode ter mecanismo anti-leech, é recomendável salvar a imagem e carregá-la diretamente (img-4UW6S2ux-1646744485318) (C:\Users\zhuquanhao\Desktop\Screenshot command collection\linux \filebeat+ELK\ 15.bmp)]](https://img-blog.csdnimg.cn/301f2394efd54fc1af74471a878e4664.bmp)

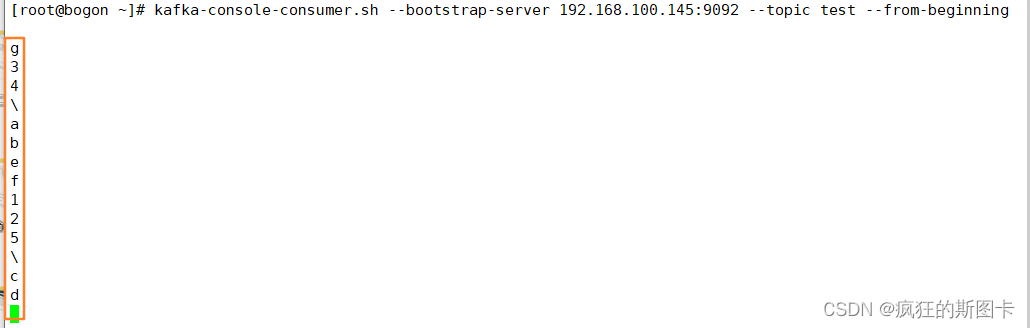

Consumindo mensagens (192.168.100.145)