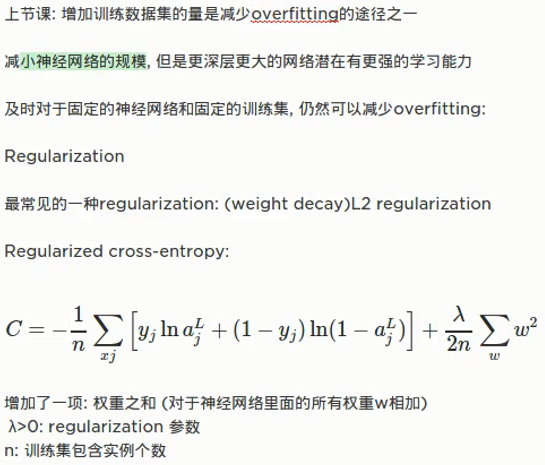

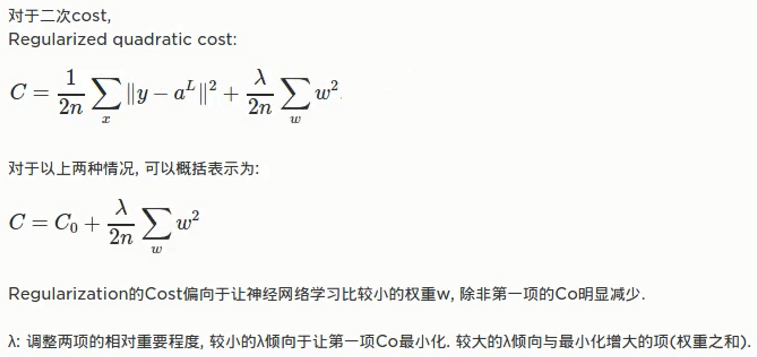

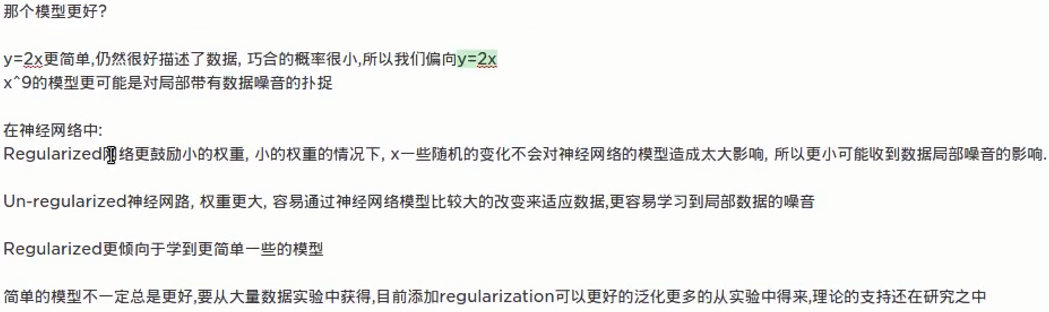

正則:

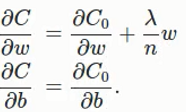

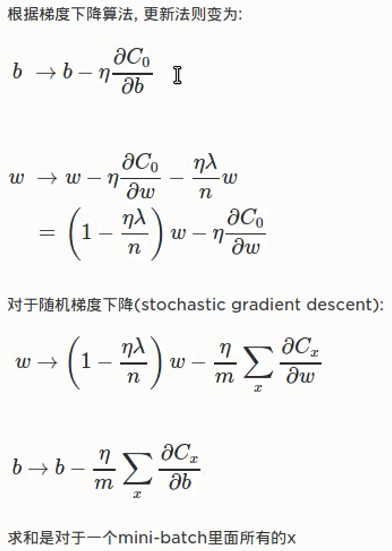

L2:

正則化重みは、縮小され、比が低下します。![]()

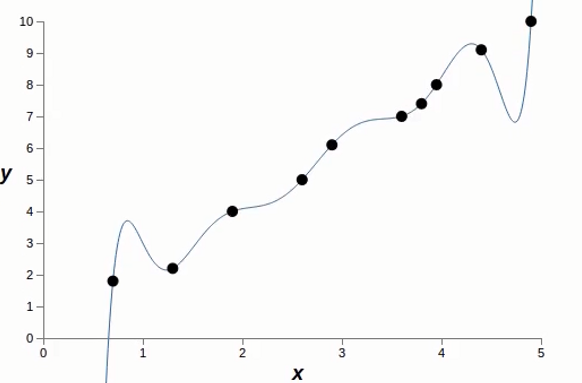

私たちは、最初のモデルを構築しました:

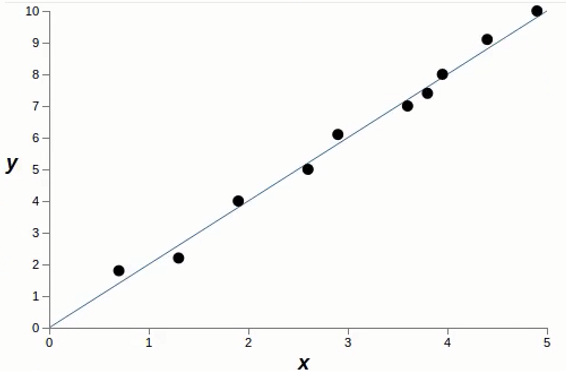

私たちは、第2のモデルを構築しました:

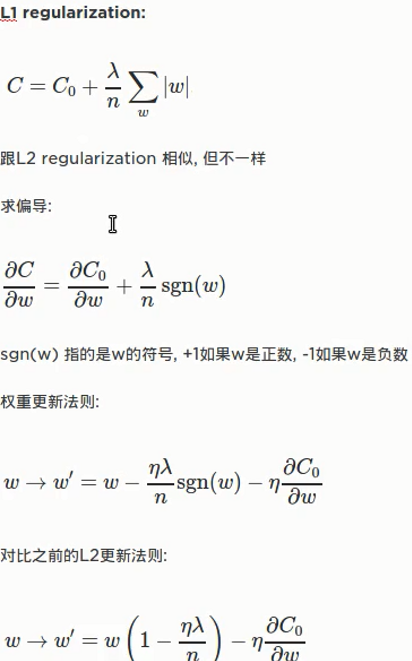

L1:

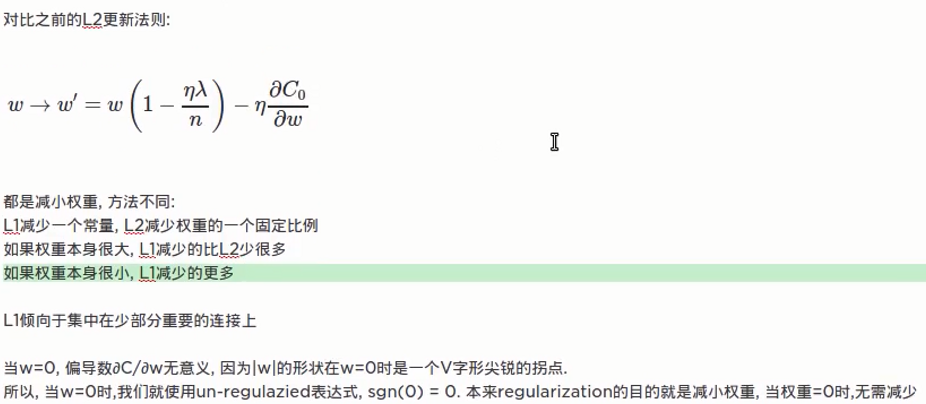

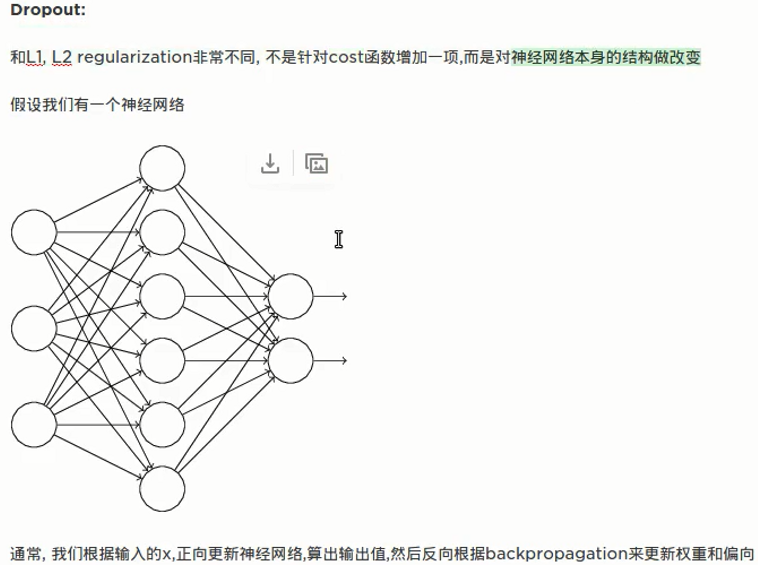

脱落:

半分を削除して前方を更新し、更新パラメータ(w及びB)の拡散を逆転、その後だけ削除神経回復、再ランダムに選択された削除の半分

オーバーフィッティングを削減する別の方法: