創作は簡単ではありませんが、どうか励まし、応援してください。

実生活では、多くの人がインターネット上に自分の情報を公開したくないと考えていますが、ファイルの処理、意思決定、注文の実行に人工知能機能を使用する必要がある場合はどうすればよいでしょうか? したがって、私たち自身または会社のプライベート GPT を構築することが非常に重要になります。

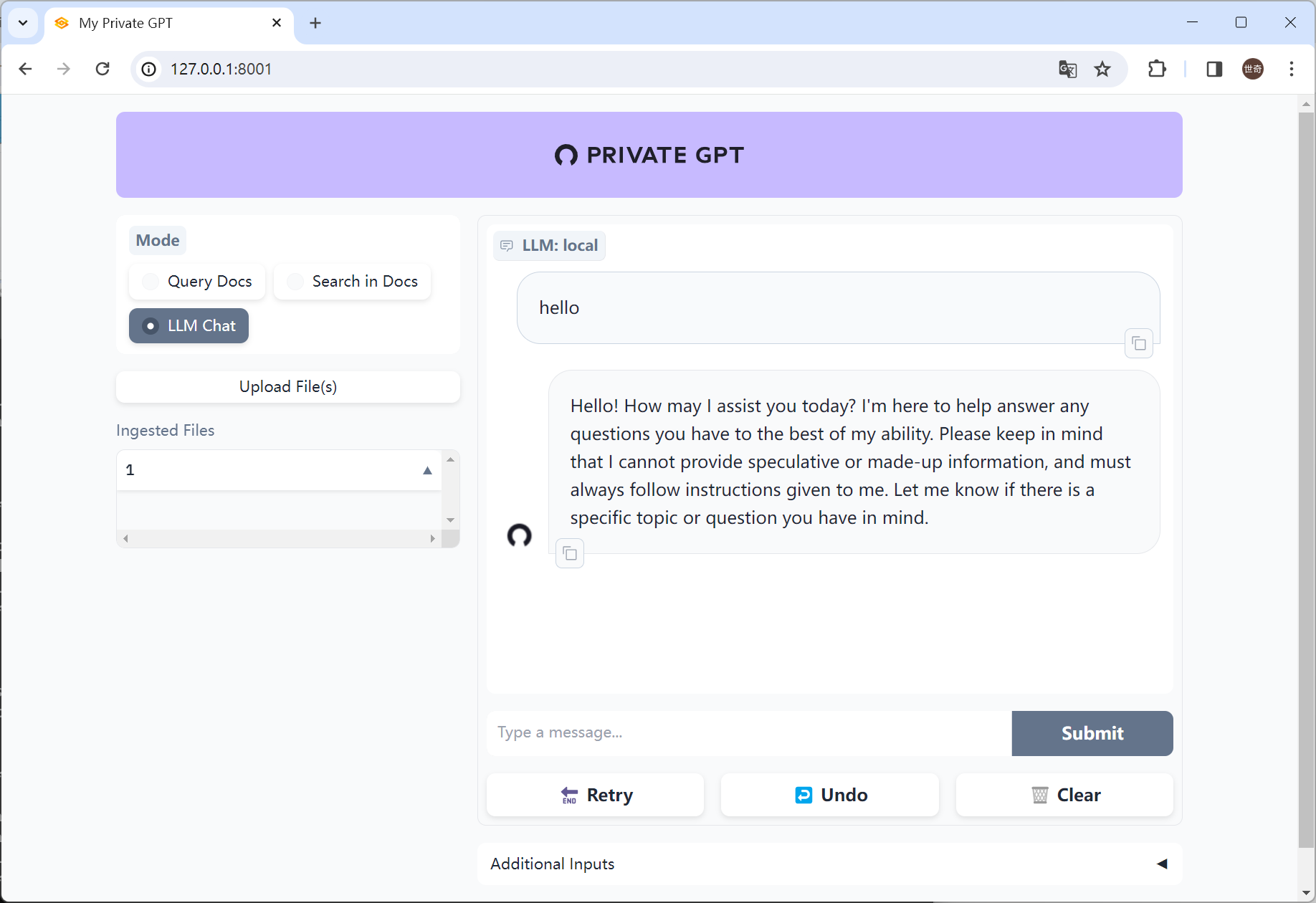

まずは効果を見てみましょう

1.

プライベート GPT をローカルに展開するための簡単なローカル インストール手順:

1. リポジトリのクローンを作成します:

git clone

git clone https://github.com/imartinez/privateGPT

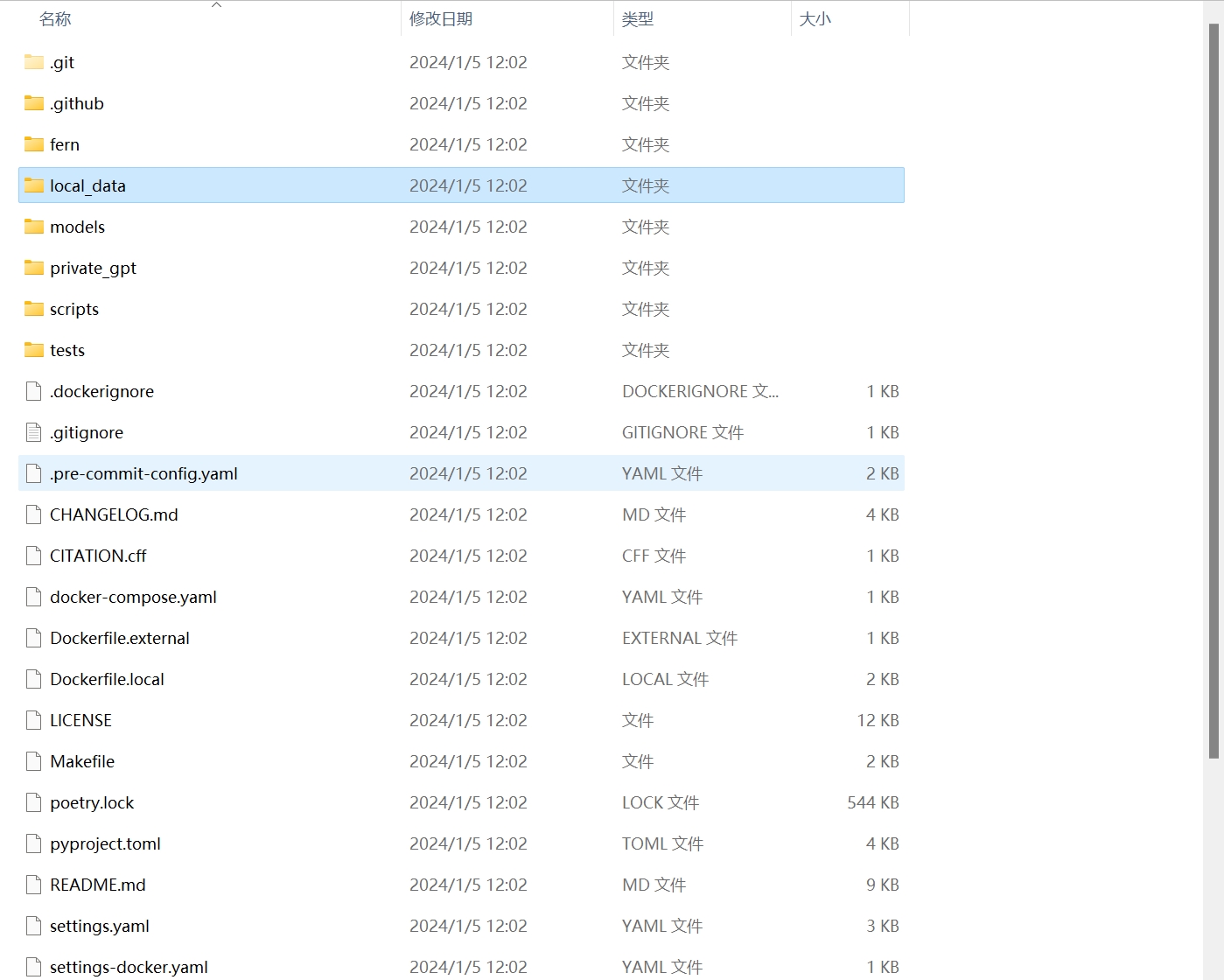

ファイルディレクトリ

2. Python をインストールします。

pyenv install 3.11

pyenv local 3.11(エラーが報告された場合は、python3.11 を直接インストールできます。)

古いバージョン 3.10 が以前にシステムにインストールされています。干渉を避けるために、システム変数パス: C:\Program から削除する必要があります。 Files\Python310\Scripts\; C:\Program Files\Python310\

3. 依存関係をインストールします。

poetry install --with ui,local

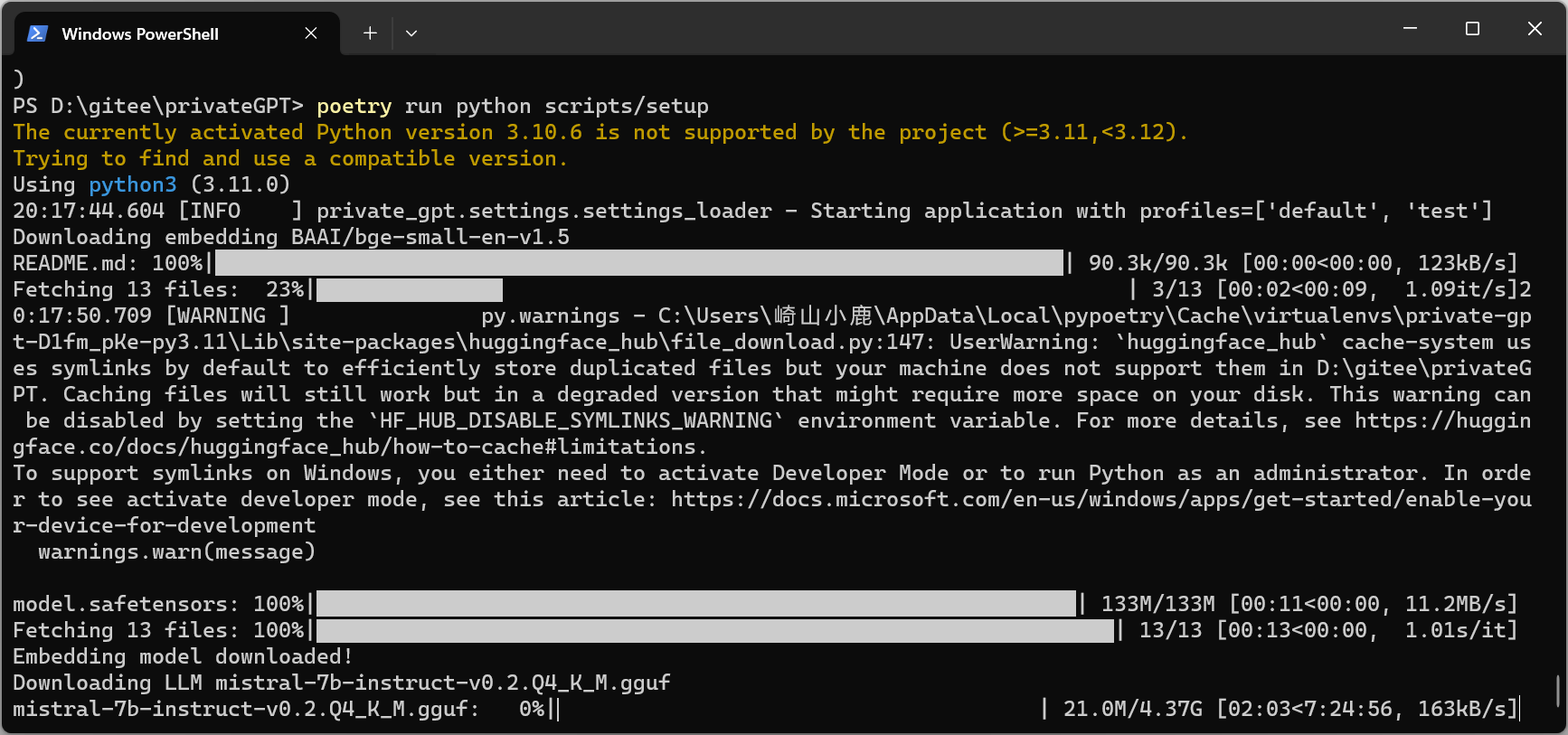

4. 埋め込みと LLM モデルをダウンロードします。

poetry run python scripts/setup

5. (オプション、PowerShell で実行) GPU を有効にします。

$env:CMAKE_ARGS='-DLLAMA_CUBLAS=on'; poetry run pip install --force-reinstall --no-cache-dir llama-cpp-python6. ローカルサーバーを実行します。

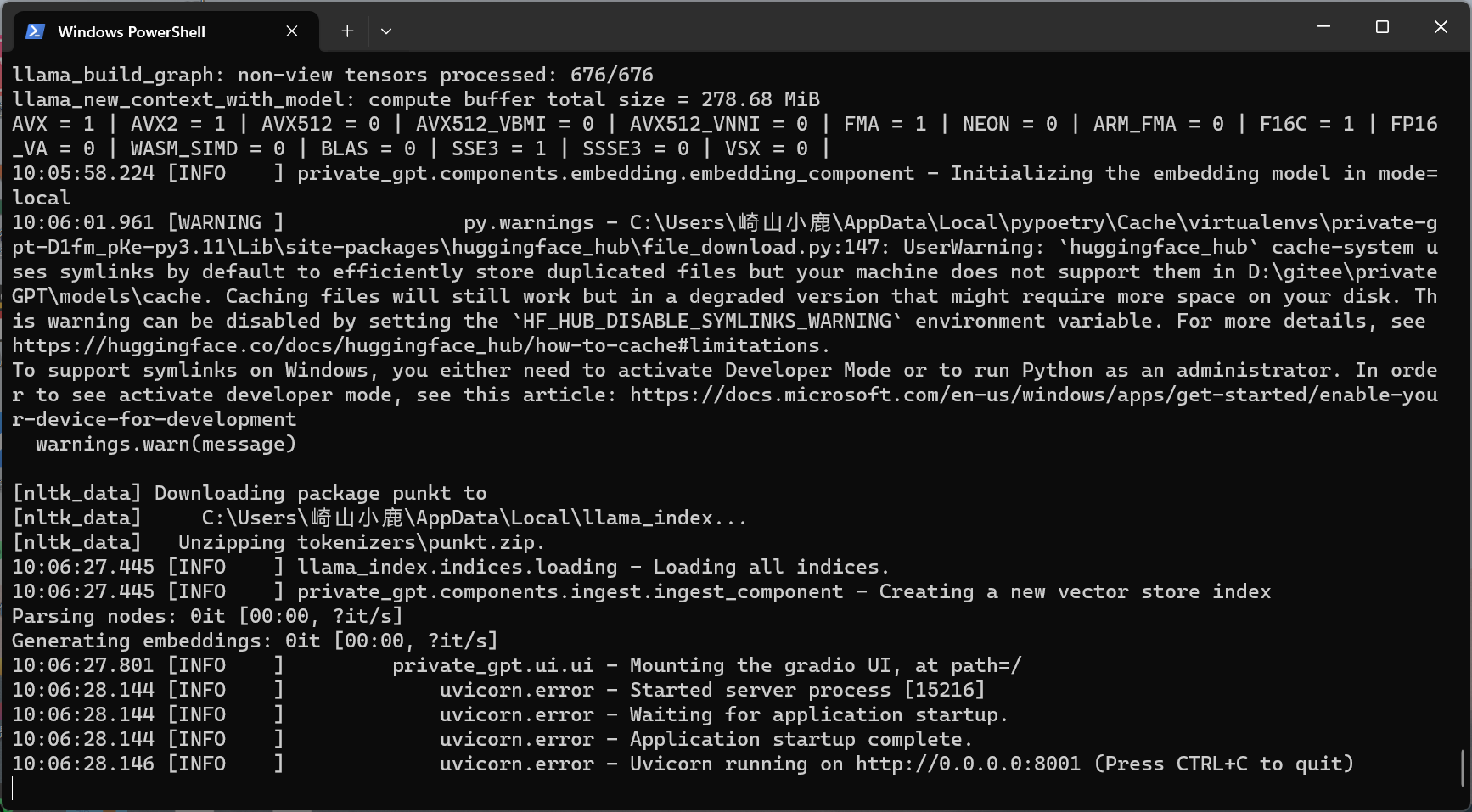

set PGPT_PROFILES=local

poetry run python -m private_gpt

7. UI に移動します。ブラウザで http://localhost:8001/ を開きます。

より詳しい情報: