まとめ

時系列分析は、天気予報、異常検知、行動認識などの幅広い用途において非常に重要です。このホワイト ペーパーでは、幅広い分析タスクに共通の重要な問題である時間変化モデリングに焦点を当てます。これまでのアプローチでは、これを 1D 時系列から直接実行しようとしていましたが、複雑な時間的パターンのため、これは非常に困難でした。時系列における複数の期間の観察に基づいて、複雑な時間的変化を期間内 ( intraperiod) と期間間の変化 ( interperiod-variation) に分割します。表現力における 1D 時系列の制限に対処するために、1D 時系列を複数期間ベースの 2D テンソルのセットに変換することで、時間的変動の分析を 2D 空間に拡張します。この変換により、期間内および期間間の変更を 2D テンソルの列と行にそれぞれ埋め込むことができるため、2D カーネルを使用して 2D 変更をモデル化することが容易になります。技術的には、時系列分析の一般的なバックボーンとしてTimesNetと を使用することを提案します。TimesBlockTimesBlock は、複数の周期性を適応的に発見し、単一の開始ブロックで変換された 2D テンソルから複雑な時間的変動を抽出できます。私たちが提案する TimesNet は、短期および長期の予測、代入、分類、異常検出を含む 5 つの主流の時系列分析タスクで最先端の結果を達成します。

序章

時系列分析は、天気予報のための気象要因予測、データマイニングのための欠損データ補完、産業メンテナンスのための監視データのための異常検出、行動認識のための軌跡分類など、実世界で広く使用されています。時系列分析はその実用的価値が非常に高いため、大きな注目を集めています。

言語やビデオなどの他のタイプの時系列データとは異なり、時系列は継続的に記録され、各時点で保存されるスカラー量はわずかです。通常、単一の時点だけでは分析に十分な意味情報を提供できないため、多くの研究では時間的変化に焦点を当てています。時間的変化はより有益であり、連続性、周期性、傾向などの時系列の固有の特性をよりよく反映しています。ただし、リアルタイムの時系列の変化には常に複雑な時間的パターンが含まれており、複数の変化 (上昇、下降、変動など) が互いに混在して重なり合うため、時間的変化のモデリングが非常に困難になります。

特に深層学習コミュニティでは、深層モデルの強力な非線形モデリング機能の恩恵を受けて、現実世界の時系列における複雑な時間的変動を捉えるための多くの研究が提案されています。メソッドの 1 つのクラスでは、リカレント ニューラル ネットワーク (RNN) を使用して、マルコフの仮定に基づいて連続する時点をモデル化します。ただし、これらの方法では長期的な依存関係を把握できないことが多く、その効率は逐次計算パラダイムの影響を受けます。別のクラスのメソッドは、時間次元 (TCN) で畳み込みニューラル ネットワークを利用して、変更情報を抽出します。さらに、1D コンボリューション カーネルの制限により、隣接する時点間の変化しかシミュレートできないため、長期的な依存問題を解決することはできません。最近では、アテンション機構を備えた Transformer がシーケンスモデリングに広く使用されています。時系列分析では、多くの Transformer ベースのモデルは、時点間のペアごとの時間依存性を捕捉するために、アテンション メカニズムまたはその変形を採用しています。しかし、時間的依存関係は複雑な時間的パターンの中に深く隠されている可能性があるため、注意メカニズムが分散した時点から信頼できる依存関係を直接見つけることは困難です。

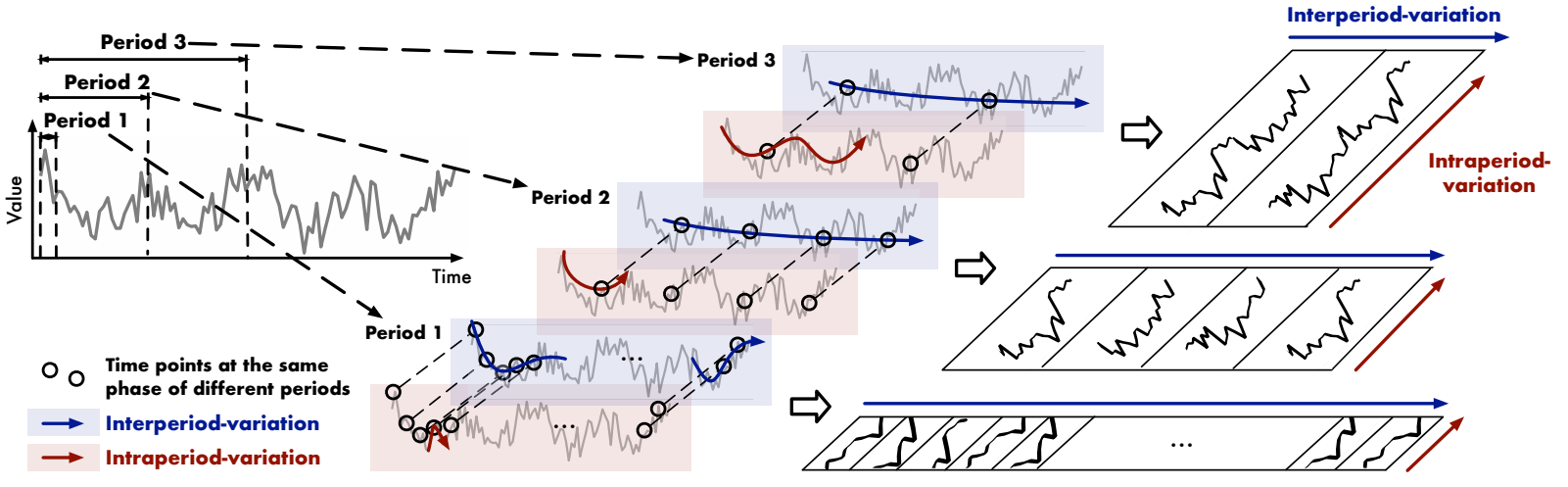

この論文では、複雑な時間的変動に対処するために、多重周期性という新しい次元から時系列を分析します。まず、現実世界の時系列は、気象観測の毎日および年間の変化、電力消費量の毎週および季節の変化など、複数の周期性を示すことが多いことが観察されています。これらの複数の期間は重なり合い、相互作用するため、モデリングの変更は困難になります。第二に、各期間について、各時点の変化は、隣接する領域の時間的パターンの影響を受けるだけでなく、隣接する期間の変化と高度に相関していることがわかります。明確にするために、これら 2 つのタイプの時間的変動をそれぞれ期間内変動および期間間変動と呼びます。前者は、一定期間にわたる短期間の時間パターンを示します。後者は、連続する期間にわたる長期的な傾向を反映している可能性があります。明示的な周期性のない時系列の場合、変動は期間内の変動によって支配され、無限の期間長を持つ時系列と同等であることに注意してください。

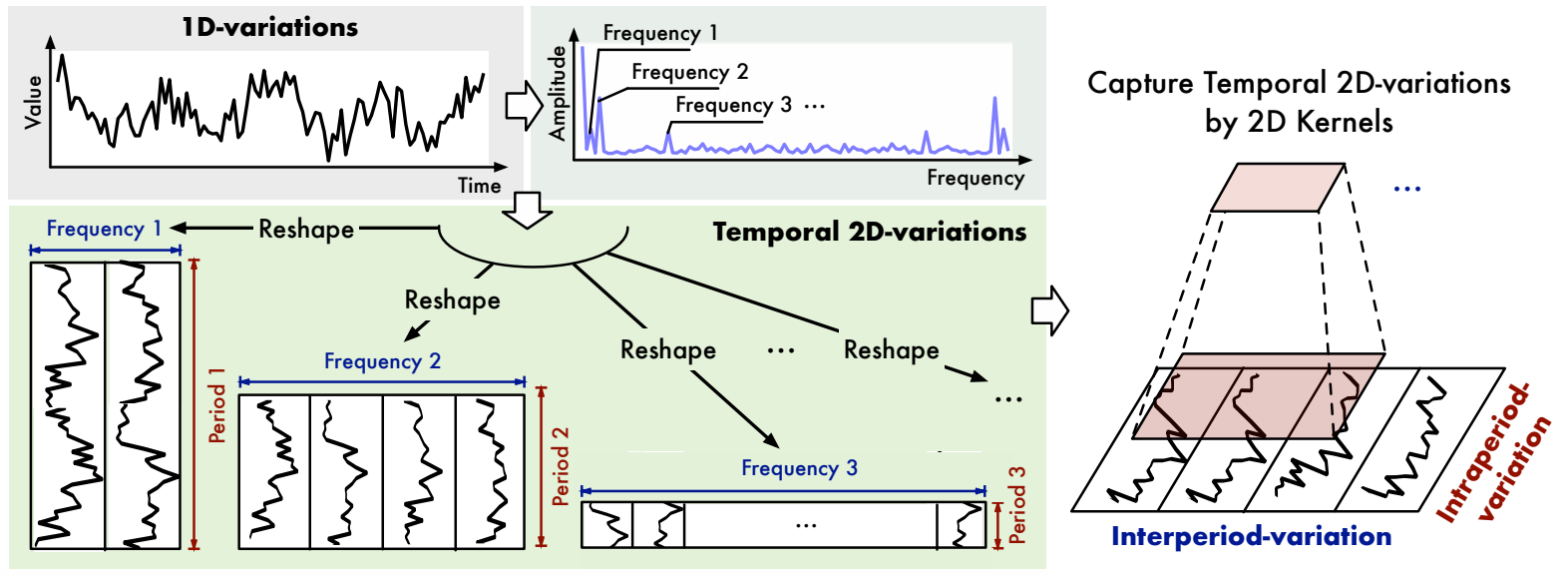

異なる期間は異なる期間内および期間間の変動をもたらすため、多重周期性は当然、時間変動をモデル化するためのモジュール式アーキテクチャにつながり、単一モジュールで期間固有の変動を捕捉します。さらに、この設計により、複雑な時間的パターンを解きほぐすことができるため、時間的変動のモデリングに有益です。ただし、1 次元の時系列では 2 つの異なるタイプの変化を同時に明確に示すことは困難であることに注意してください。この障害に対処するために、時間的変動の分析を 2 次元空間に拡張します。具体的には、以下の図に示すように、1 次元の時系列を 2 次元のテンソルに再形成できます。この場合、各列には期間内の時点が含まれ、各行には異なる期間間の同じステージの時点が含まれます。したがって、1 次元時系列を 2 次元テンソルのセットに変換することで、1 次元空間での表現力のボトルネックを打破し、同じ 2 次元で期間内および期間間の変化を取得することに成功します。空間を表現し、二次元の寸法変化を取得します。

図 1: 時系列の多重周期性と時間的 2 次元変化。各サイクルには、サイクル内変動とサイクル間変動の両方が含まれます。元の 1D 時系列を、複数の期間に基づいて 2D テンソルのセットに変換します。これにより、期間内および期間間の変動を統合できます。

技術的には、上記の動機に基づいて、私たちはこれまでのバックボーンを超えて、時系列分析のための新しいタスク一般モデルとして TimesNet を提案します。TimesBlock のサポートにより、TimesNet は時系列の複数の周期性を発見し、モジュール式アーキテクチャで対応する時間的変化を捕捉できます。具体的には、TimesBlock は、学習した期間に従って 1D 時系列を 2D テンソルのセットに適応的に変換し、初期ブロックを通じて 2D 空間の期間内および期間間の変化をさらにキャプチャできます。実験的に、TimesNet は、短期および長期の予測、代入、分類、異常検出を含む 5 つの主流分析タスクで一貫した最先端を実現しています。私たちの貢献は 3 つの側面に要約されます。

- 私たちは、期間内および期間間の複数周期的で複雑な相互作用を動機として、時間変動をモデル化するためのモジュール式アプローチを発見しました。1 次元の時系列を 2 次元空間に変換することで、期間内および期間間の両方の変化を視覚化できます。

- 私たちは、複数のサイクルを発見し、変換された 2D テンソルから開始ブロックを介して時間的な 2D 変化をキャプチャする、TimesBlock を備えた TimesNet を提案します。TimesNet は、タスクの汎用基本モデルとして、5 つの主流の時系列分析タスクで最先端の結果を達成します。詳細かつ洞察力に富んだ視覚化が含まれています。

関連作業

時系列分析の重要な問題として、時間変動のモデリングがよく研究されています。

多くの古典的な手法では、時間変動が ARIMA、Holt-Winter、Prophet などの事前定義されたパターンに従うと想定されています。ただし、リアルタイム時系列の変動は通常、事前定義されたパターンでカバーするには複雑すぎるため、これらの古典的な手法の実際的な適用可能性は制限されます。

近年、MLP、TCN、RNNに基づくものなど、時間モデリングのための多くのディープモデルが提案されています。技術的には、MLP ベースの方法は時間次元に沿って MLP を採用し、固定数の MLP レイヤーとして時間依存性をエンコードします。TCN ベースの手法は、時間次元に沿ってスライドするコンボリューション カーネルを通じて時間変動を捕捉します。RNN ベースの手法は、反復構造を利用し、タイム ステップ間の状態遷移を通じて暗黙的に時間的変動を捕捉します。これらの方法はいずれも、この論文で提案されている周期性に由来する時間的な 2 次元変動を考慮していないことに注意してください。

また、Transformers は時系列予測において極めて優れています。注意メカニズムを通じて、時点間の時間依存性を発見できます。特に、Autoformer は、学習したサイクルに基づいて時系列の依存関係を取得するための自動相関メカニズムを提供します。

さらに、複雑な時間パターンに対処するために、Autoformer は、入力シーケンスの季節部分とトレンド部分をキャプチャするための深い分解アーキテクチャも提案します。次に、FEDformer は専門家混合設計を採用して季節傾向の分解を強化し、周波数領域での注目度をまばらにします。これまでのアプローチとは異なり、時系列の複数の周期性を調査することで複雑な時間パターンを解明し、コンピューター ビジョンのバックボーンを使用して 2D 空間の時間的変動を初めて捉えます。

また、これまでのアプローチとは異なり、特定の分析タスクに限定されるのではなく、時系列分析タスクの一般的な基礎モデルを提案しようとしている点にも注目してください。

タイムズネット

上で述べたように、時系列の多重周期性に基づいて、さまざまな期間から派生した時間パターンを捕捉するためのモジュール式アーキテクチャを備えた TimesNet を提案します。期間ごとに、対応する期間内および期間間の変化を取得するために、TimesNet の TimesBlock を設計します。これは、1 次元の時系列を 2 次元空間に変換し、両方のタイプの変更を同時に実行できます。初期モジュールモデリング。

1次元の変化を2次元の変化に変換する

図1に示すように、各時点には、異なる周期間の隣接領域および同位相での2種類の時間的変動、すなわち周期内変動と周期間変動が同時に存在する。ただし、この原始的な 1 次元の時系列構造は、隣接する時点間の変化しか表現できません。この制限に対処するために、私たちは時間変化の 2 次元構造を探索します。これにより、期間内の期間間の変化を明示的に表現できるため、表現力に利点があり、その後の表現学習が容易になります。

具体的には、長さTTの場合T、記録されたCCC特徴量、元の 1 次元組織はX 1 D ∈ RT × C X_{1D} \in \mathbb{R}^{T \times C}バツ1D _∈RT × C、周期間の変化を表すためには、まず周期を発見する必要があります。理論的には、次のように高速フーリエ変換 (FFT) によって周波数領域の時系列を分析します。

A = Avg ( Amp ( FFT ( X 1 D ) ) ) , { f 1 , ⋯ , fk } = arg Topk f ∗ ∈ { 1 , ⋯ , [ T 2 ] } ( A ) , pi = ⌈ T fi ⌉ , i ∈ { 1 , ⋯ , k } \mathbf{A}=\オペレーター名{Avg}\left(\オペレーター名{Amp}\left(\オペレーター名{FFT}\left(\mathbf{X}_ {1 \mathrm{D}}\right)\right)\right),\left\{f_{1}, \cdots, f_{k}\right\}=\underset{f_{*} \in\left \{1, \cdots,\left[\frac{T}{2}\right]\right\}}{\arg \operatorname{Topk}}(\mathbf{A}), p_{i}=\left \lceil\frac{T}{f_{i}}\right\rceil, i \in\{1, \cdots, k\}あ=平均(アンプ( FFT( X1D _) ) )、{ f1、⋯、fk}=f∗∈ { 1 , ⋯、[2T] }arg _ボール( A ) 、p私は=⌈f私はT⌉、私∈{ 1 、⋯、k }

ここで、FFT ( ⋅ ) FFT(\cdot)FFT ( ⋅ )とAmp ( ⋅ ) Amp(\cdot)mp ( ⋅ )は、FFT と振幅値の計算を表します。A ∈ RA \in Rあ∈R は、 CCから取得される、各周波数の計算された振幅を表します。C次元 byA vg ( ⋅ ) Avg(\cdot)平均してvg ( ⋅ )が得られます。ご注意ください。j値A j A_jあj周波数がjjであることを示しますjの周期基底関数の強度jjj。周波数領域のスパース性を考慮し、無意味な高周波によって引き起こされるノイズを回避するため、top − k top-kトップ_ _−k振幅値、最重要周波数f 1 、⋯ 、fk {f1,\cdots,f_k}f1 、_⋯、fk正規化されていない振幅{ A f 1 , ⋯ , A fk } \{A_{f_1},\cdots,A_{f_k}\}{

Af1、⋯、あfk}、ここでkkkはハイパーパラメータであり、これらの選択された周波数もkkkサイクル長p 1 , ⋯ , pk {p_1,\cdots,p_k}p1、⋯、pk。周波数領域の共役的な性質により、{ 1 , ⋯ , [ T 2 ] } \{1,\cdots, [\frac{T}{2}]\} のみを考慮します。{

1 、⋯、[2T]} . 上記の方程式を次のように要約します。

A , { f 1 , ⋯ , fk } , { p 1 , ⋯ , pk } = 周期 ( X 1 D ) \mathbf{A},\left\{f_1, \cdots, f_k\right\},\left\{p_1, \cdots, p_k\right\}=\演算子名{期間}\left(\mathbf{X}_{1 \mathrm{D}}\right)あ、{

f1、⋯、fk}、{

p1、⋯、pk}=期間( X1D _)

選択した周波数{ f 1 , ⋯ , fk } \{f_1,\cdots,f_k\}{

f1、⋯、fk}と対応する周期の長さ{ p 1 , ⋯ , pk } \{p_1,\cdots, p_k\}{

p1、⋯、pk}、一次元時系列X 1 D ∈ RT × C X_{1D} \in \mathbb{R}^{T \times C} をバツ1D _∈RT × Cは、次の方程式によって複数の 2 次元テンソルに変換されます:

X 2 D i = Reshape pi , fi ( Padding ( X 1 D ) ) , i ∈ { 1 , ⋯ , k } , \mathbf{X }_{2 \mathrm{D}}^i=\operatorname{変形}_{p_i, f_i}\left(\operatorname{パディング}\left(\mathbf{X}_{1 \mathrm{D}}\ right)\right)、i \in\{1, \cdots, k\}、バツ2D _私は=形を変えるp私は、f私は(パディング( X1D _) )、私∈{

1 、⋯、k } ,

其中P 追加 ( ⋅ ) Padding(\cdot)パディング( ⋅ )は、Reshape pi , fi ( ⋅ ) \operatorname{Reshape}_{p_i, f_i}(\cdot) と互換性を持たせるために、時間次元に沿って時系列を 0 で埋めます。形を変えるp私は、f私は(⋅),其中 p i p_i p私は和 f i f_i f私は変換された 2D テンソルの行数と列数をそれぞれ表します。X 2 D i ∈ R pi × fi × C X_{2D}^{i} \in \mathbb{R}^{p_i \times f_i \times C} に注意してください。バツ2D _私は∈Rp私は× f私は× C はiiを意味しますi は周波数f 1 f_1f1変換された時系列。その列と行は対応する期間の長さpi p_iを表します。p私は以下にサイクル内変動とサイクル間変動を示します。最後に、図 2 に示すように、選択した周波数と推定周期に従って、2 次元テンソルのセット{ X 2 D 1 , ⋯ , X 2 D k } \{X_{2D}^1,\ cdots を取得します。 、X_{2D}^k\}{

X2D _1、⋯、バツ2D _k異なるサイクルから導出されたkkを表します。kの異なる時間の 2 次元変化。

図 2: 時系列の 2 次元構造を示す単変量の例。周期性を発見することで、元の 1D 時系列を構造化された 2D テンソルに変換でき、これを 2D カーネルで簡単に処理できます。時系列のすべての変数に対して同じ変形操作を実行することで、上記の手順を多変量時系列に拡張できます。

この変換により、変換された 2D テンソルに 2 種類の制限が導入されることにも注目してください。それは、隣接する時点 (列、期間内の変化) と隣接する期間 (行、期間間の変化) の局所性です。したがって、時間的な 2D 変動は 2D カーネルによって簡単に処理できます。

タイムズブロック

図 3 に示すように、TimesBlock を残りの接続の方法で編成します。具体的には、長さ T の 1 次元入力時系列X 1 D ∈ RT × C X_{1D} \in \mathbb{R}^{T \times C} の場合バツ1D _∈RT × Cでは、層X 1 D 0 = Embed ( X 1 D ) X_{1D}^{0} = Embed(X_{1D}) を埋め込むことから始めます。バツ1D _0=埋め込む( X _ _ _1D _)元の入力を深度特徴に投影しますX 1 D 0 ∈ RT × dmodel X_{1D}^0 \in \mathbb{R}^{T \times d_{model}}バツ1D _0∈RT × dモデル_ _ _ _。TimesNet の場合l層の入力はX 1 D l − 1 ∈ RT × dmodel X_{1D}^{l-1} \in \mathbb{R}^{T \times d_{model}} ですバツ1D _l − 1∈RT × dモデル_ _ _ _このプロセスは正式には次のように説明できます:

KaTeX 解析エラー: 位置 30 の数学モードでは関数 '$' を使用できません: … \mathrm{D}}^l=$̲ TimesBlock $\l...に示すように図

3、llの場合l TimesBlock では、プロセス全体が 2 つの連続した部分で構成されています。時間の 2 次元変化をキャプチャし、異なる期間からの表現を適応的に集約します。

時間の 2 次元変化を捉える: 上の方程式と同様に、period ( ⋅ ) period(\cdot)を渡すことができます。per i o d ( ⋅ )で深部特徴X 1 D l − 1 X_{1D}^{l-1}を推定しますバツ1D _l − 1サイクルの長さ。推定された周期長に基づいて、1D 時系列から 2D 空間への変換を実行し、パラメトリックに効率的なシーティング ブロックを通じて情報表現を便利に取得できる 2D テンソルのセットを取得できます。このプロセスは次のように形式化されます。

A l − 1 , { f 1 , ⋯ , fk } , { p 1 , ⋯ , pk } = 周期 ( X 1 D l − 1 ) X 2 D l , i = pi , fi ( パディング ( X 1 D l − 1 ) ) , i ∈ { 1 , ⋯ , k } X ^ 2 D l , i = インセプション ( X 2 D l , i ) , i ∈ { 1 , ⋯ , k } X ^ 1 D l , i = Trunc ( Reshape 1 , ( pi × fi ) ( X ^ 2 D l , i ) ) , i ∈ { 1 , ⋯ , k } \begin{aligned} & \mathbf{A}^{l-1 },\left\{f_1, \cdots, f_k\right\},\left\{p_1, \cdots, p_k\right\}=\演算子名{期間}\left(\mathbf{X}_{1 \mathrm {D}}^{l-1}\right) \\ & \mathbf{X}_{2 \mathrm{D}}^{l, i}=\text { 変形 }_{p_i, f_i}\left (\operatorname{Padding}\left(\mathbf{X}_{1 \mathrm{D}}^{l-1}\right)\right), i \in\{1, \cdots, k\} \ \ & \widehat{\mathbf{X}}_{2 \mathrm{D}}^{l, i}=\オペレーター名{インセプション}\left(\mathbf{X}_{2 \mathrm{D}}^ {l, i}\right), i \in\{1, \cdots, k\} \\ &\widehat{\mathbf{X}}_{1 \mathrm{D}}^{l, i}=\operatorname{Trunc}\left(\operatorname{Reshape}_{1,\left(p_i \times f_i\ right)}\left(\widehat{\mathbf{X}}_{2 \mathrm{D}}^{l, i}\right)\right), i \in\{1, \cdots, k\} \\ & \end{整列}あl − 1、{

f1、⋯、fk}、{

p1、⋯、pk}=期間( X1D _l − 1)バツ2D _私、私= 形を変える p私は、f私は(パディング( X1D _l − 1) )、私∈{

1 、⋯、k }バツ

2D _私、私=インセプション( X2D _私、私)、私∈{

1 、⋯、k }バツ

1D _私、私=トランク(変形1 、( p私は× f私は)(バツ

2D _私、私) )、私∈{

1 、⋯、k }

ただし、X 2 D l , i ∈ R pi × fi × dmodel X_{2D}^{l,i} \in \mathbb{R}^{p_i \times f_i \times d_{model}}バツ2D _私、私∈Rp私は× f私は× dモデル_ _ _ _i 番目に変換された 2D テンソルです。変換後、初期モジュールを渡します。ここで、X 2 D l , i ∈ R pi × fi × dmodel X_{2D}^{l,i} \in \mathbb{R}^{p_i \times f_i \times d_{モデル }}バツ2D _私、私∈Rp私は× f私は× dモデル_ _ _ _i 番目に変換された 2D テンソルです。変換後、パラメータ効率の高い開始モジュール、つまりInception ( ⋯ ) Inception(\cdots)を通じて 2 次元テンソルを処理します。始めます( ⋯ _ _ _ _ _)は、マルチスケール 2D カーネルを含み、最もよく知られているビジョン バックボーンの 1 つです。次に、2 次元表現X ^ 2 D l , i \hat{X}^{l,i}_{2D} をバツ^2D _私、私1 次元空間に戻りますX ^ 1 D l , i ∈ RT × dmodel \hat{X}^{l,i}_{1D} \in \mathbb{R}^{T \times d_{model}}バツ^1D _私、私∈RT × dモデル_ _ _ _T rune ( ⋅ ) Trune(\cdot)を使用して集計が実行されます。Trun e ( ⋅ )の長さは( pi × fi ) (p_i \times f_i)になります。( p私は×f私は)は元の長さTTて。

1 次元時系列の変換の恩恵を受けて、開始ブロックの 2 次元カーネルは、隣接するスケールをカバーしながら、マルチスケールの期間内変化 (列) と期間間の変化 (行) を同時に集約できることに注意してください。時点と相対的に隣接する期間。さらに、2 次元テンソル{ X 2 D l , 1 , ⋯ , X 2 D l , k } \{X_{2D}^{l,1},\cdots,X_{2D}^ {l を再形成します。 ,k}\}{ X2D _l 、 1、⋯、バツ2D _l 、 kモデルのサイズがハイパーパラメータkkの影響を受けないように、パラメータ効率を向上させるために共有重みを持つ開始ブロックを採用します。kの選択。

適応型集約、最後にkkを融合する必要がありますk個の異なる 1 次元式{ X ^ 1 D l , 1 , ⋯ , X ^ 1 D l , k } \{\hat{X}_{1D}^{l,1},\cdots,\hat{ X }_{1D}^{l,k}\}{ バツ^1D _l 、 1、⋯、バツ^1D _l 、 k}次のレイヤーに移動します。自己相関からインスピレーションを得た振幅 A は、選択された周波数と周期の相対的な重要性を反映し、変換された各 2D テンソルの重要性に対応します。したがって、振幅に従って 1 次元表現を要約します。

A ^ f 1 l − 1 , ⋯ , A ^ fkl − 1 = S oftmax ( A f 1 l − 1 , ⋯ , A fkl − 1 ) X 1 D l = ∑ i = 1 k A ^ fil − 1 × X ^ 1 D l , i \hat{A}_{f_1}^{l-1}, \cdots, \hat{A}_{f_k}^{l-1} = ソフトマックス\left(A_{f_1}^ {l-1},\cdots,A_{f_k}^{l-1}\right)\\ X_{1D}^{l} = \sum^{k}_{i = 1}\hat{A} ^{l-1}_{f_i} \times \hat{X}_{1D}^{l,i}あ^f1l − 1、⋯、あ^fkl − 1=ソフトマックス_ _ _ _( Af1l − 1、⋯、あfkl − 1)バツ1D _私=i = 1∑kあ^f私はl − 1×バツ^1D _私、私

期間内および期間間の変化にはすでに複数の高度に構造化された 2-D テンソルが含まれているため、TimesBlock はマルチスケールの時間的な 2-D 変化を完全に捕捉できるため、TimesNet はより効率的な表現学習を実現できます。

2D ビジョン バックボーンの多用途性 1D 時系列から時間的な 2D 変化への変換の恩恵を受け、広く使用されている ResNet や ResNeXt、高度な ConvNeXt、アテンションベースなど、ロゴ学習の最初のブロックを置き換えるさまざまなコンピューター ビジョン バックボーンを選択できます。フォースモデル。したがって、当社の時間 2D バリエーション設計は、1D 時系列を活発な 2D ビジョン バックボーンと結び付け、時系列分析でコンピューター ビジョン コミュニティの進歩を活用できるようにします。一般に、アイデンティティ学習のためのより強力な 2D バックボーンは、パフォーマンスの向上につながります。性能と効率(図4右)を考慮して、上式に示すように、パラメータ効率の高い開始ブロックに基づいて主な実験を実行します。

図 4: モデルのパフォーマンス (左) とさまざまなビジュアル バックボーンにわたる一般性 (右) の比較

実験

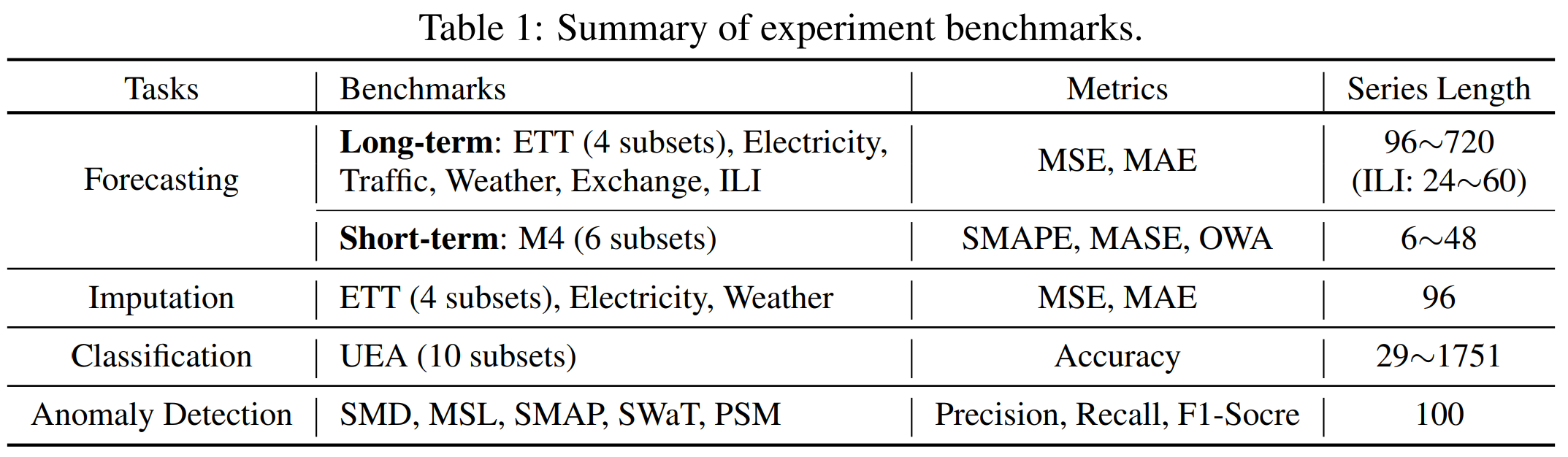

TimesNet の汎用性を検証するために、短期および長期の予測、代入、分類、異常検出を含む 5 つの主流タスクについて広範な実験を実施しています。

以下の表はベンチマークの概要です。データセット、実験実装、モデル構成の詳細については、付録を参照してください。

ベンチマーク: 私たちは時系列分析の基礎モデルを考え出そうとしているため、RNN ベースのモデルとそのバリアント (LSTM、LSTNet、LSSL) を含む、5 つのタスクすべてにわたって認知された最先端のモデルを徹底的に比較します。 ; CNN ベースのモデル: TCN; MLP ベースのモデル: LightTS および DLinear; トランスフォーマー ベースのモデル: Reformer、Informer、Pyraformer、Autoformer、FEDformer、Non-stationary Transformer、および ETSformer。さらに、短期予測には N-HiTS と N-BEATS、異常検出には Anomaly Transformer、分類には Rocket と Flowformer など、特定のタスクごとに最先端のモデルを比較します。包括的な比較のために、合計 15 を超えるベースラインが含まれています。

主な結果

TimesNet は、ベース モデルとして、他のカスタム モデルと比較して、5 つの主流分析タスクで一貫した最先端のパフォーマンスを実現します (図 4 左)。完全な効率比較については、付録を参照してください。さらに、最初のブロックをより強力なビジュアル バックボーンに置き換えることで、TimesNet のパフォーマンスをさらに向上させることができ (図 4 右)、私たちの設計により、充実したビジュアル バックボーンを活用した時系列分析が可能になることが確認されました。

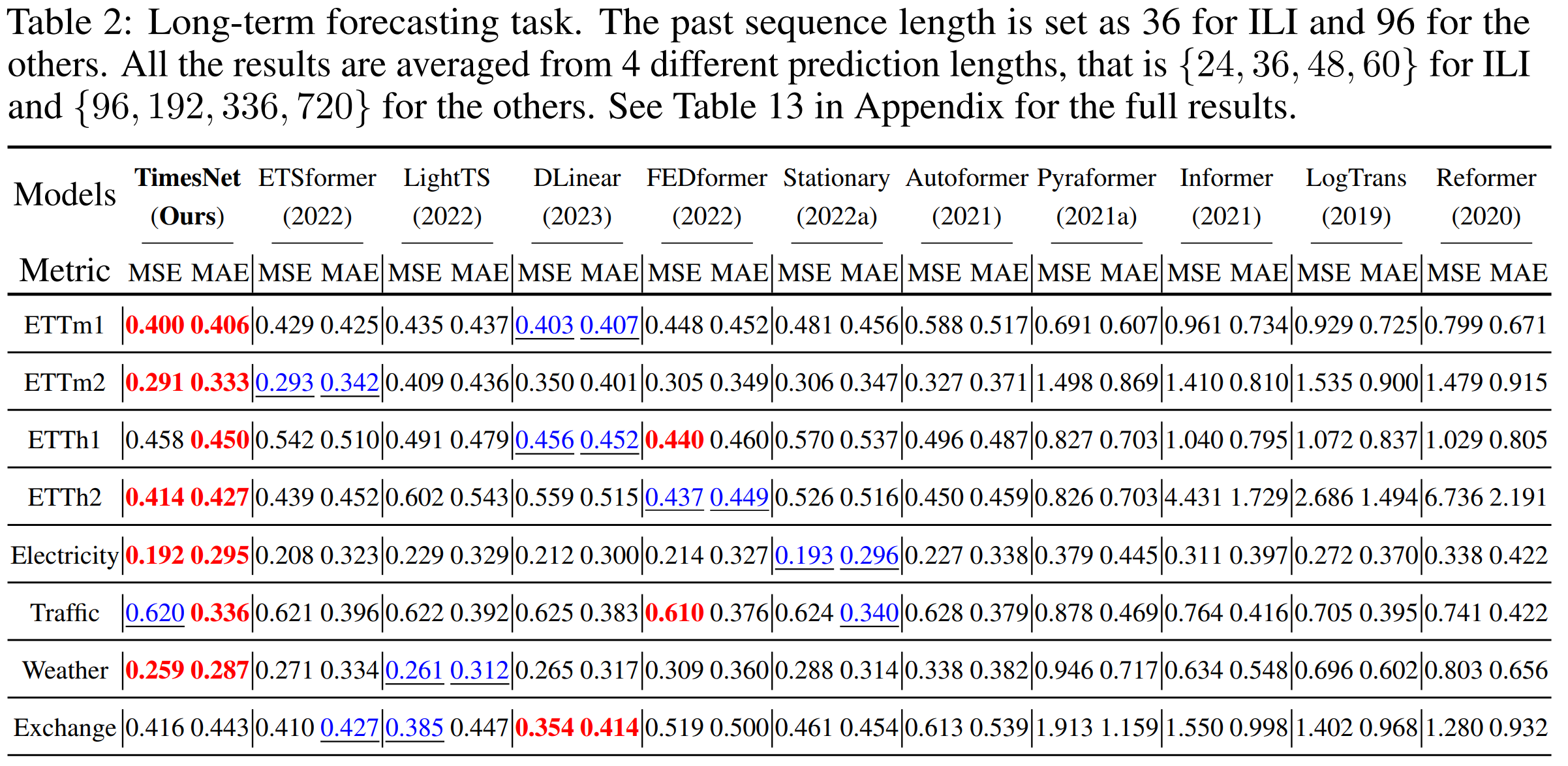

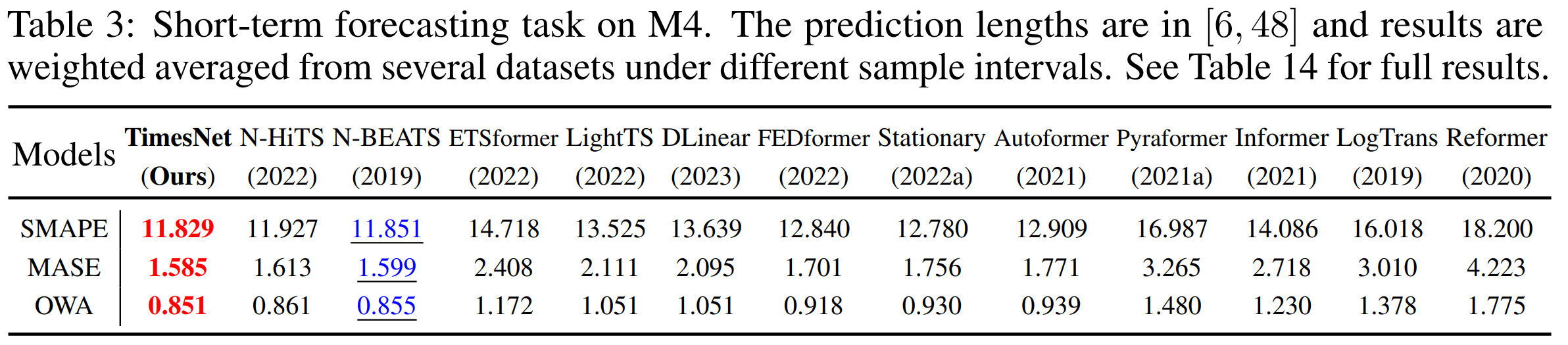

短期および長期の予測

設定: 時系列予測は、天気予報、交通量、エネルギー消費計画に不可欠です。予測におけるモデルのパフォーマンスを総合的に評価するために、長期予測と短期予測の 2 種類のベンチマークを使用します。特に長期予測設定では、ETT、電力、交通、天気、為替、ILI など、Autoformer で使用されるベンチマークに従い、5 つの実際のアプリケーションをカバーします。短期データセットとしては、毎年、四半期、毎月収集された単変量マーケティング データを含む M4 を採用します。長期予測設定の各データセットには連続時系列が 1 つだけ含まれており、スライディング ウィンドウを通じてサンプルを取得しますが、M4 にはさまざまな頻度で収集された 100,000 の異なる時系列が含まれることに注意してください。

その結果、TimesNet は長期設定と短期設定の両方で優れたパフォーマンスを示します。具体的には、TimesNet は長期予測において 80% 以上のケースで最先端の結果を達成しています。M4 データセットの場合、時系列がさまざまなソースから収集されるため、時間の変化が非常に多様になる可能性があり、予測がより困難になります。私たちのモデルは依然としてこのタスクで最高のパフォーマンスを発揮し、幅広い MLP ベースおよび Transformer ベースの最先端モデルを上回ります。

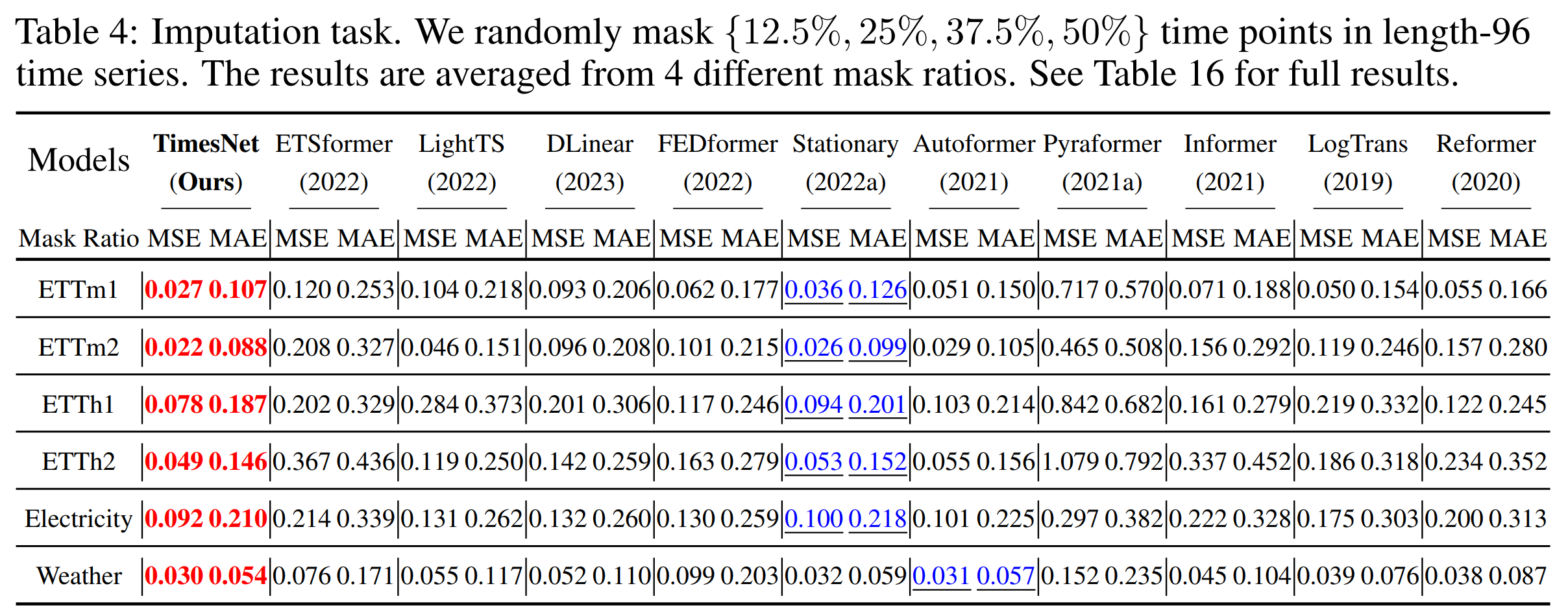

補間

セットアップ後、現実世界のシステムは常に継続的に稼働しており、自動観測装置によって監視されています。ただし、不具合により、収集された時系列が部分的に欠落する可能性があり、下流の分析が困難になります。したがって、アトリビューションは実際のアプリケーションで広く使用されています。このペーパーでは、欠落問題がよくある ETT、UCI、気象など、電力および気象シナリオのデータセットをベンチマークとして選択しました。欠損データのさまざまな割合の下でモデルの能力を比較するために、{12.5%、25%、37.5%、50%} の割合に従って時点をランダムにマスクします。

その結果、推定タスクでは、欠落した時点により不規則で部分的に観察された時系列から固有の時間パターンを発見するモデルが必要になります。表 4 に示すように、私たちが提案する TimesNet は、この困難なタスクに関して依然として一貫した最先端を達成しており、非常に複雑な時系列から時間的変化を捕捉するモデルの能力を検証しています。

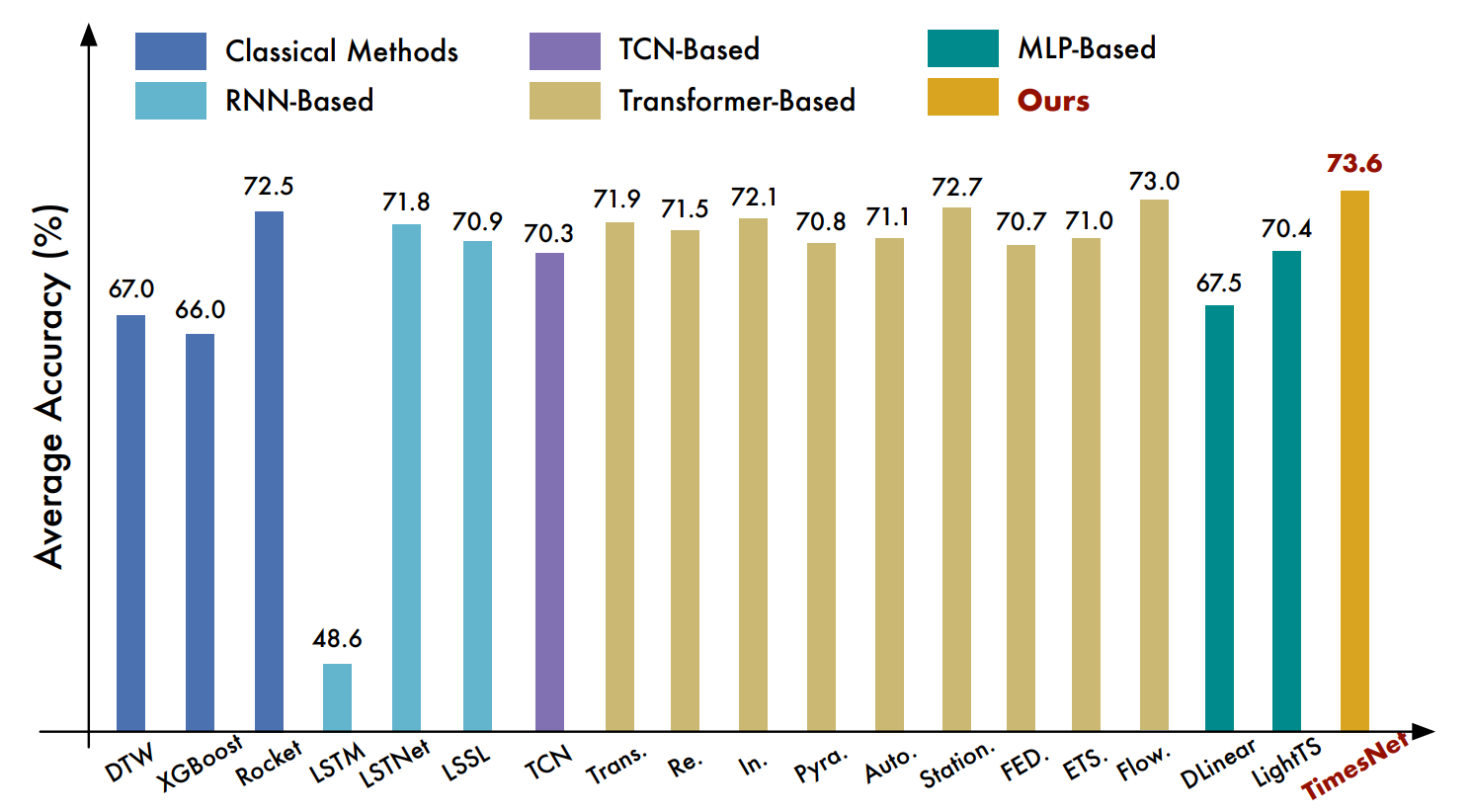

分類

設定、時系列分類は識別や医療診断に使用できます。シーケンスレベルの分類を採用して、高レベルの表現学習におけるモデルの能力を検証します。具体的には、UEA の時系列分類アーカイブから 10 個の多変量データセットを選択し、ジェスチャー、動作、音声認識、心拍モニタリングによる医療診断、その他の実践的なタスクをカバーしました。次に、Zerveas の論文で説明されているように、サブセットごとにシーケンス長が異なるようにデータセットを前処理しました。

図 5: 分類におけるモデルの比較。Transformer の「*」は、*以前のモデルの名前を示します。結果は 10 個の UEA サブセットからの平均です。

その結果、図 5 に示すように、TimesNet は平均精度 73.6% という最高の結果を達成し、これまでの最先端の古典的手法である Rocket (72.5%) やディープ モデル Flowformer (73.0%) を上回りました。さらに、MLP ベースのモデル DLinear もこの分類タスクで不合格 (67.5%) でしたが、一部の時系列予測データセットでは良好なパフォーマンスを示しました。これは、DLinear が時間次元で単層 MLP モデルのみを採用しているためで、これは固定時間の一部の自動プログレッシブ タスクに適している可能性があります。しかし、高レベルの表現を学習する場合、多くの劣化が発生します。これとは対照的に、TimesNet は 2 次元の時間変化を 2 次元空間に統合するため、2 次元のカーネルを介した情報表現の学習が容易になり、分類に役立ちます。階層表現が必要です。

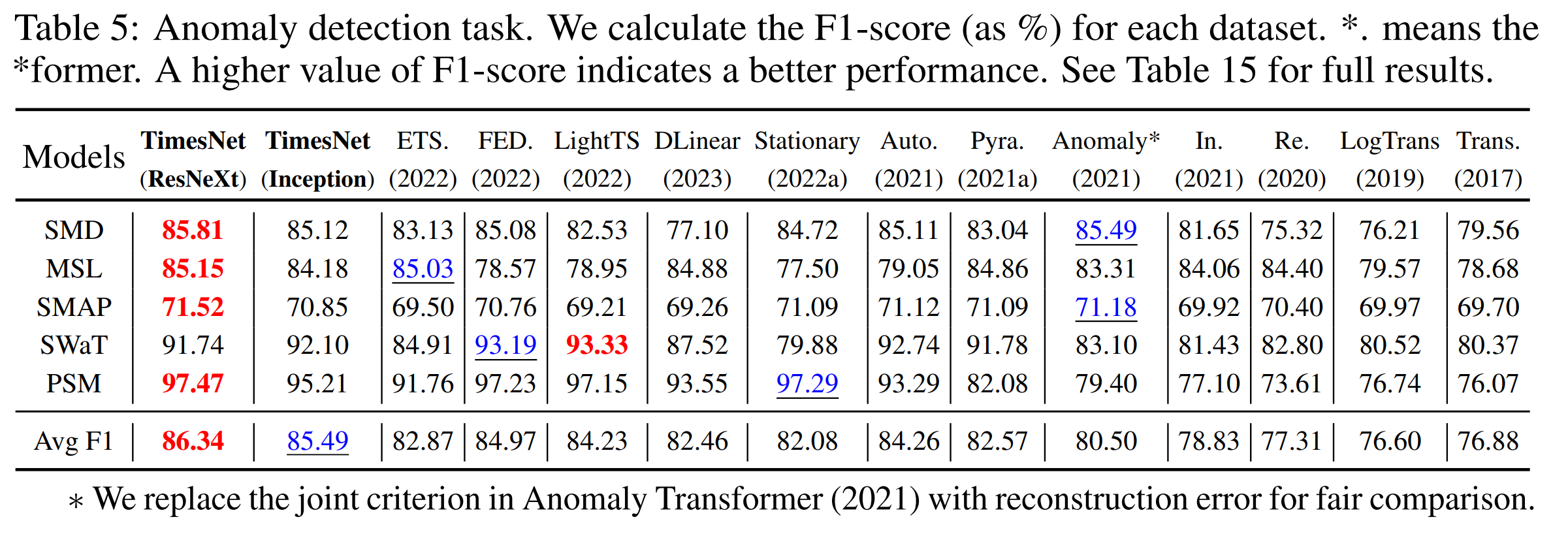

異常検出

設定、監視データからの異常の検出は、産業のメンテナンスにとって重要です。異常は大規模なデータに隠れていることが多く、データのラベル付けが困難であるため、教師なし時系列異常検出、つまり異常な時点の検出に焦点を当てています。広く使用されている 5 つの異常検出ベンチマーク (SMD、MSL、SMAP、SWaT、PSM) のモデルを比較し、サービス監視、宇宙および地球探査、水処理アプリケーションをカバーします。Anomaly Transformer の前処理方法に従って、スライディング ウィンドウによってデータセットを連続した重複しないセグメントに分割しました。以前の研究では、再構成は教師なしの点単位表現学習の古典的なタスクであり、再構成エラーは自然な外れ値基準でした。公平な比較を行うために、再構成の基礎となるモデルのみを変更し、すべての実験の共通の外れ値基準として古典的な再構成誤差を使用しました。

その結果、表 5 は、TimesNet が依然として異常検出において最高のパフォーマンスを達成し、高度な Transformer ベースのモデル FEDformer および Autoformer を上回っていることを示しています。従来の Transformer は、このタスクではあまりパフォーマンスが良くありません (平均 F1 スコアは 76.88%)。これは、異常検出ではモデルが稀な異常な時間的パターンを見つける必要があるのに対し、虚無的な注意メカニズムは各時点のペア間の類似性を計算するが、支配的な正常な時点によって妨げられる可能性があるという事実から来ている可能性があります。さらに、TimesNet、FEDformer、および Autoformer はすべて、周期性を考慮することで優れたパフォーマンスを実現します。したがって、これらの結果は、周期性分析の重要性も示しています。これにより、周期性に違反するステルス変更が強調表示され、異常検出がさらに容易になります。

モデル分析

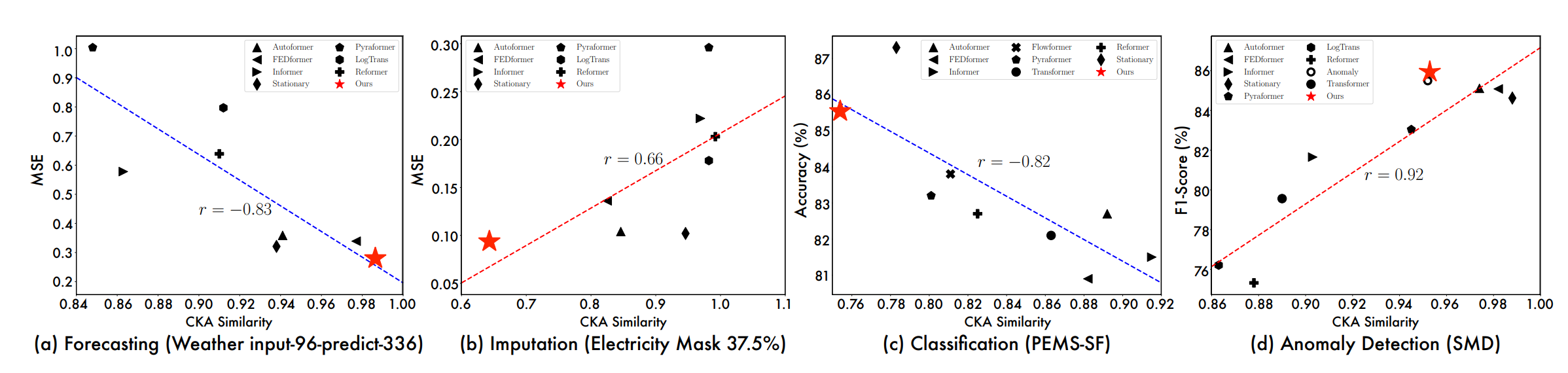

表現分析では、表現学習の観点からモデルのパフォーマンスを説明しようとします。 図 6 から、予測と異常検出のパフォーマンスが向上すると、CKA 類似性が高くなるほど、代入タスクや分類タスクとは逆であることがわかります。CKA の認識が低いということは、異なるレイヤー間の表現が区別できること、つまり階層的な特徴があることを意味することに注意してください。したがって、これらの結果は、各タスクに必要な表現プロパティも示します。図 6 に示すように、TimesNet は、異常検出における予測と再構成のための低レベル表現や、帰納や分類のための階層表現など、さまざまなタスクに適切な表現を学習でき、MD や異常検出などのタスクでは良好にパフォーマンスを発揮しますが、階層表現の学習に失敗し、代入と分類のパフォーマンスが低下します。これらの結果は、基本モデルとして提案した TimesNet のタスクの汎用性も検証します。

図 6: 4 つのタスクにおける表現分析。モデルごとに、最初と最後のレイヤーの表現間のセンター カーネル アライメント (CKA) の類似性を計算します。CKA の類似性が高いほど、知人の表現が多いことを示します。TimesNet には赤い星が付いています。

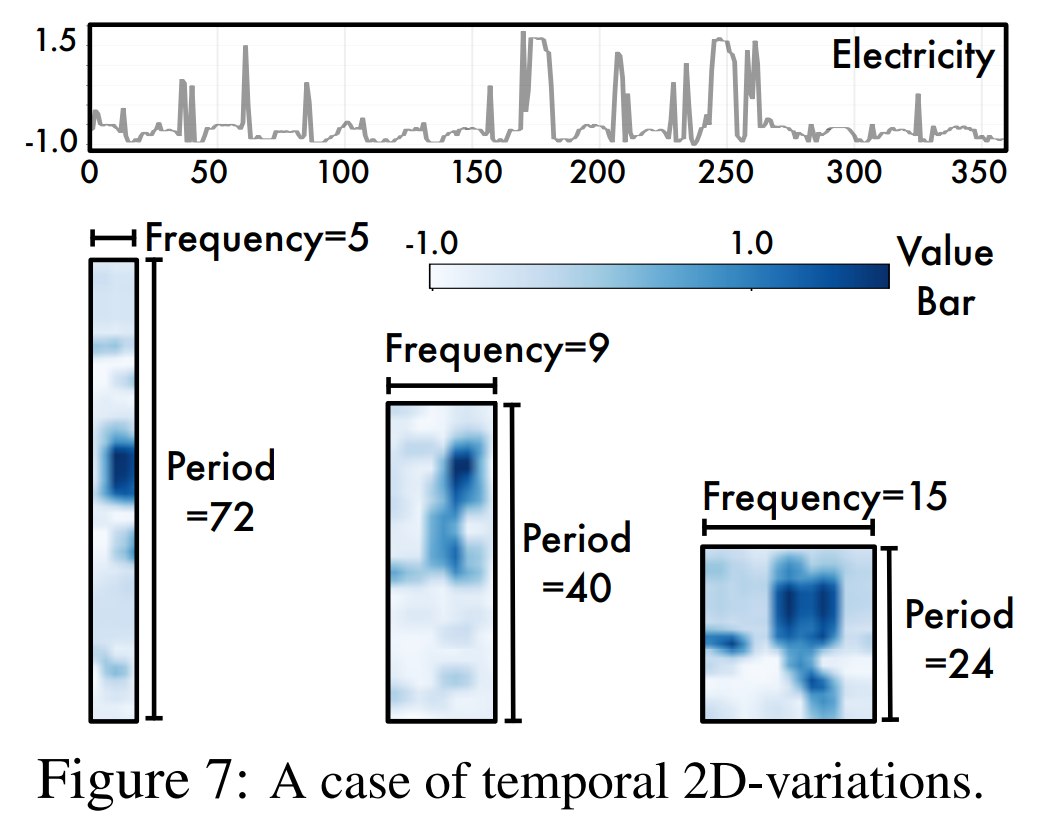

時間的 2 次元変化。図 7 に時間的 2 次元変化のケーススタディを示します。TimesNet が複数周期の特徴を正確にキャプチャできることがわかります。さらに、変換された 2D テンソルは高度に構造化されており有益であり、列と行はそれぞれサイクル内とサイクル間の局所性を反映することができ、表現学習に 2D カーネルを採用する動機をサポートします。視覚化の詳細については、付録を参照してください。

結論と今後の取り組み

本稿では、時系列解析タスクのための汎用基本モデルとして、TimesNet を紹介します.TimesNet は、多周期励起の下で、モジュール構造を通じて複雑な時間変化を明らかにし、パラメータ効率の高い開始を通じて 2 次元を捉えることができます。そして時代ごとの空間の変化。実験の結果、TimesNet は 5 つの主要なデータ フロー分析タスクを再現する際に優れた多用途性とパフォーマンスを発揮することがわかりました。将来的には、TimesNet をバックボーンとして利用し、一般に幅広い下流タスクに利益をもたらす大規模な時系列事前トレーニング方法をさらに検討していきます。