DINO(ICLR 2023)

DETR con caja de anclaje antiruido mejorada

Desarrollo DINO:

DETR condicional->DAB-DETR (corrección 4D, WH)

DN-DETR (entrenamiento de eliminación de ruido, proceso de coincidencia estable de eliminación de ruido)

DETR deformable (Variante 1: dos etapas, la salida del codificador se reemplaza por un encabezado de clasificación FFN con consulta de objeto, Variante 2: refinamiento iterativo del cuadro)

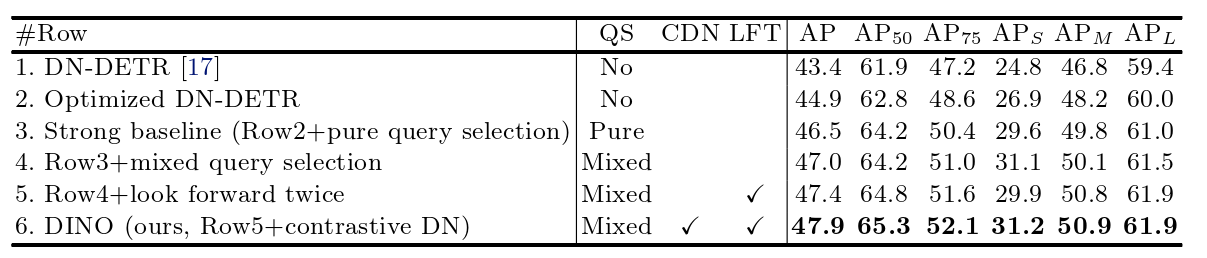

Tres mejoras:

- Entrenamiento de eliminación de ruido de contraste

- Inicialización de consulta (diseño de consulta de objeto del decodificador)

- predicción de caja

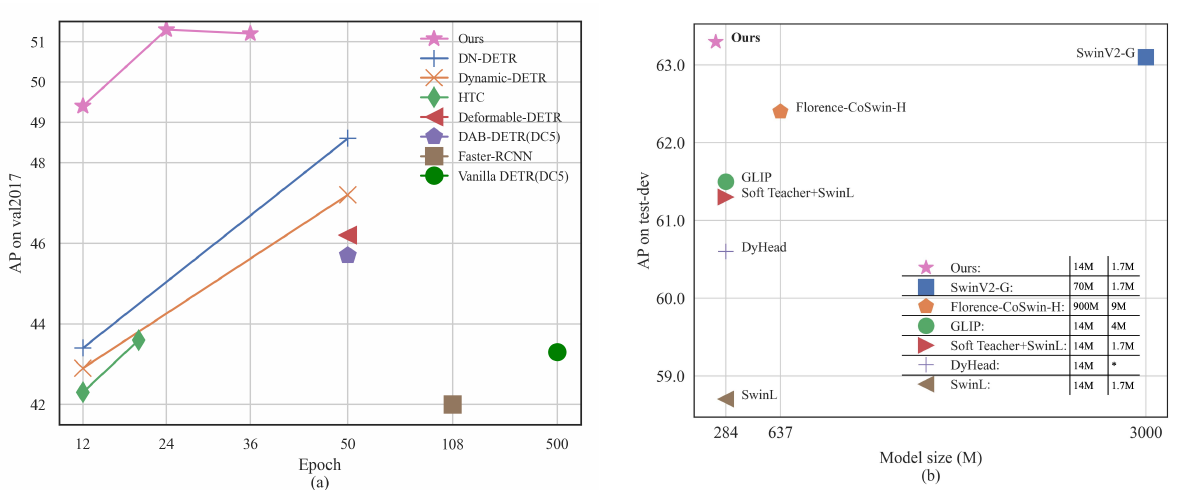

Demostró la escalabilidad de la clase DETR en grandes conjuntos de datos, utilizando grandes conjuntos de datos de gran tamaño y comparación SOTA.

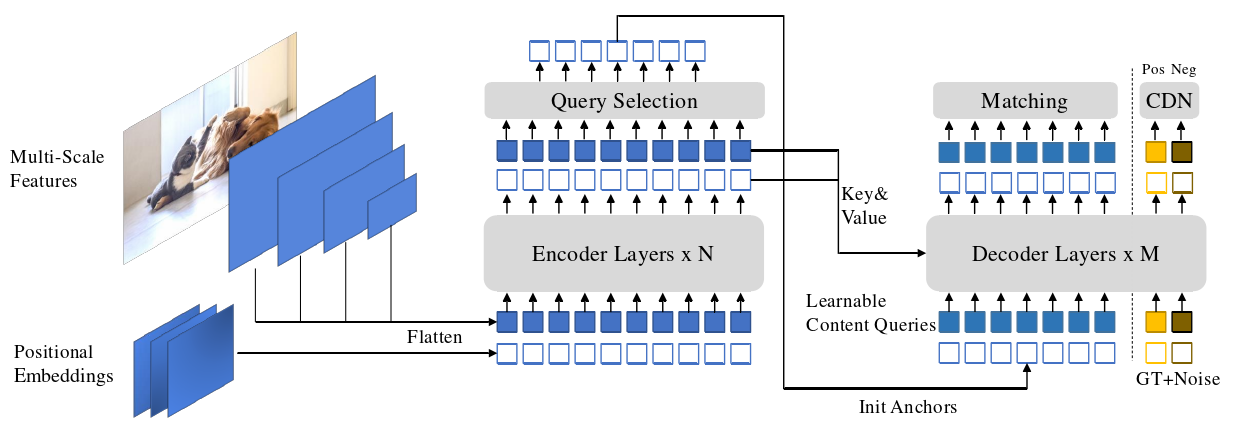

Modelo

- Se utilizan funciones de múltiples escalas.

- Selección de consulta: utilice la salida del codificador para ayudar al decodificador a determinar la consulta

- Utilice entrenamiento de eliminación de ruido contrastivo: pos (muestras positivas) neg (muestras negativas)

- Mejorar el refinamiento de la iteración del cuadro (no se muestra en la imagen)

Entrenamiento contrastivo de eliminación de ruido

DN: entrenamiento de eliminación de ruido, coincidencia estable

DN dos ruidos: hiperparámetro de compensación de DN (xywh) original (0 ~ 1) λ1 (xy) = λ2 (wh) = 0,4, inversión de etiqueta

Ejemplo: Aunque tanto los ejemplos positivos como los negativos son anclajes 4D que se pueden representar como puntos en un espacio 4D, los ilustramos como puntos en un espacio 2D sobre cuadrados concéntricos para simplificar.

加了对比 (genera dos tipos de consultas CDN: consultas positivas y consultas negativas):

λ1<λ2 (no es un hiperparámetro de DN-DETR)

Muestra positiva : una muestra positiva que cae en λ1

Muestra negativa : muestra negativa de λ1~λ2

- Cada GT está diseñado con una muestra positiva y una muestra negativa

- Intentará mantener λ1 y λ2 cerca para formar muestras negativas duras.

- Para muestras positivas, aún calcule la pérdida focal, pérdida focal

- Para muestras negativas, la predicción final de la categoría no debe ser objeto

- grupo de reserva

Idea:

Si no hay ningún objeto cerca del ancla, se debe predecir como ningún objeto. Utilice el método de comparación para aprender mejor que no hay ningún objeto.

Cuando hay varios anclajes alrededor de un GT, el modelo no puede elegir qué anclaje, lo que provocará los dos problemas siguientes:

- Cuando hay múltiples anclas alrededor de un GT, es difícil para el modelo determinar qué GT predice el ancla, y se producirán predicciones repetidas (aunque Hungría fuerza la coincidencia uno a uno, todavía es limitada)

- El ancla y el GT se asignarán si están muy separados, de hecho, este tipo de ancla debe clasificarse como ningún objeto.

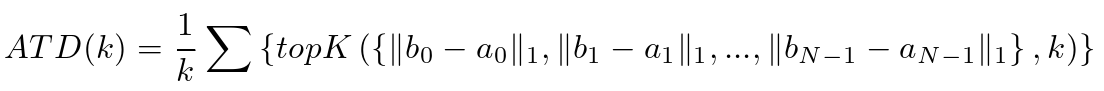

Verificar la validez de CDN : ATD

Para demostrar la efectividad de CDN, definimos la distancia promedio superior-K (ATD (k), indicador) y la usamos en la parte coincidente para evaluar la distancia del punto de anclaje desde el cuadro GT objetivo. Al igual que DETR, cada ancla corresponde a una predicción, que puede coincidir con un cuadro GT o el fondo. Aquí sólo consideramos aquellos que coinciden con la caja GT.

N GT (b0, b2,..., bN-1).

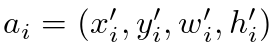

Para cada uno , podemos encontrar su ancla correspondiente y expresarlo como:

ai es el ancla inicial del decodificador, que asigna la última capa del decodificador al cuadro de refinamiento después de bi durante la comparación. Entonces nosotros tenemos:

norma L1

El rendimiento es mucho mejor en objetivos pequeños

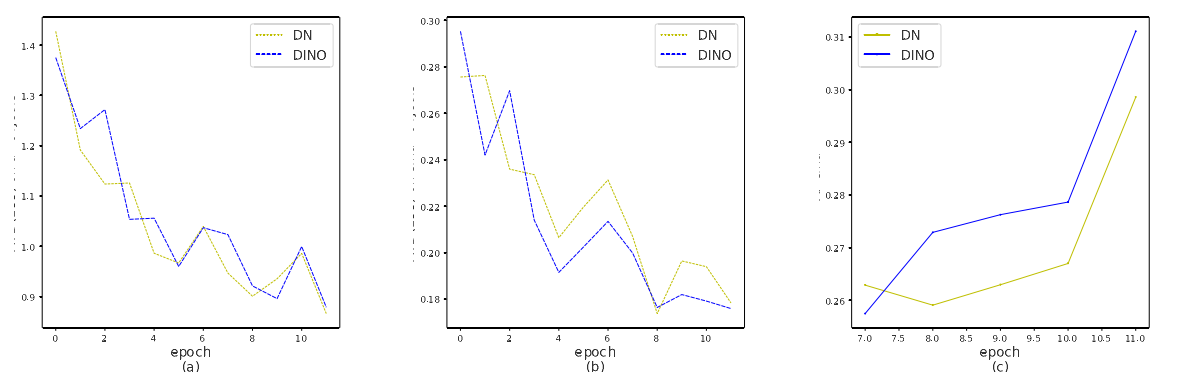

Selección de consultas mixtas

En DETR y DN-DETR, la consulta del decodificador es una incrustación estática sin obtener ninguna característica codificada de una sola imagen.

DETR deformable tiene una variante de selección de consulta (de dos etapas), que selecciona las primeras características del codificador K de la salida del codificador después del último codificador como antes para mejorar la consulta del decodificador. DETR deformable utiliza características top-K (etiqueta) no solo

Aplicar Se utiliza para consultas de ubicación y consultas de contenido.

Es decir, entrada del decodificador:

detr: tgt (cero), consulta pos (incrustación)

DINO: tgt (se incrusta), consulta pos (la consulta de objeto proviene de la salida topk del codificador, información sobre la imagen actual)

El método de selección de consulta mixta solo mejora la consulta de ubicación con las funciones de selección top-k

y mantiene la consulta de contenido tan fácil de aprender como antes.

(a) decodificador detr:tgt y consulta de objeto

(b) detr deformable: se agrega la selección k superior y funciona en la consulta de objetos y tgt al mismo tiempo.

(c) Solo se aplica a la consulta de objeto que tgt está incrustado

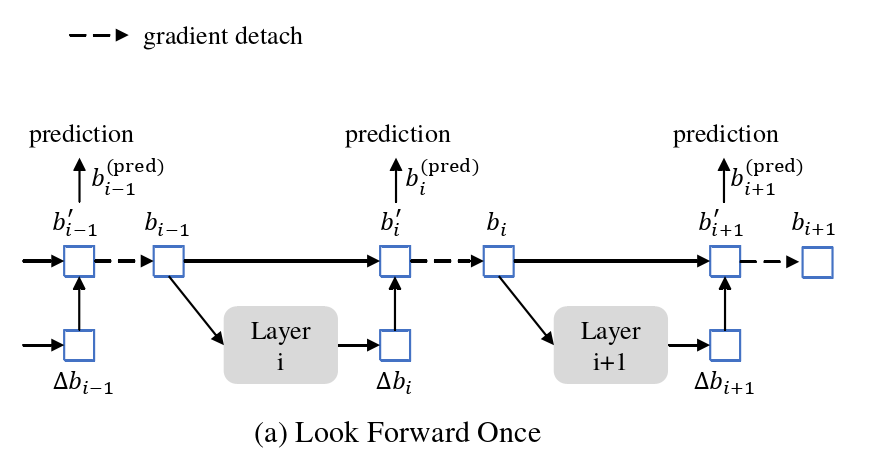

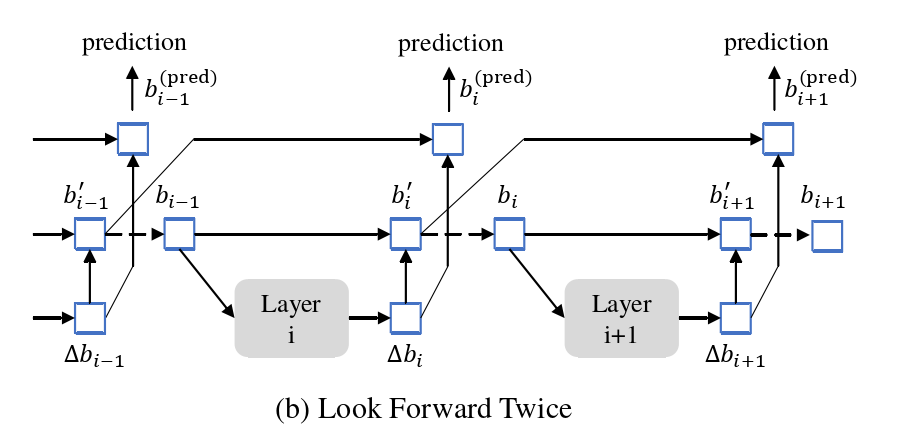

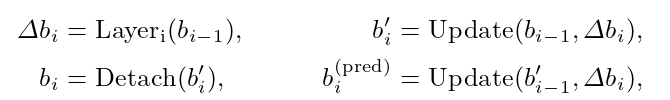

Mirar hacia adelante dos veces

El cabezal de la caja del decodificador se corrige en función de la pérdida auxiliar y el gradiente se rompe antes de la i-ésima capa (línea discontinua)

Mire hacia adelante una vez: la pérdida auxiliar solo puede modificar el gradiente de la capa actual (decodificador). El refinamiento del cuadro iterativo en Deformable DETR puede evitar la retropropagación del gradiente para estabilizar el entrenamiento.

Esperamos dos veces:

**Conjetura, la información de caja mejorada de la capa posterior puede ser más útil para corregir la predicción de caja de su capa temprana adyacente. **Por lo tanto, se propone otro método llamado Look Forward Twice para realizar la actualización del cuadro, donde los parámetros de la i-ésima capa se ven afectados por la pérdida de la i-ésima capa y la capa (i+1).

Δbi es la corrección de la entrada bi-1 a la capa anterior

Agregue Δbi a la entrada bi-1 de la capa anterior para obtener bi' (cuadro corregido)

bi (pred) es la predicción dada por boxhead. La fuente es bi'-1+Δbi. Puede modificar el decodificador de esta capa y el decodificador anterior.

experimento de ablación