En los últimos meses, Amazon Cloud Technology lanzó una serie de artículos que presentan cómo implementar Stable Diffusion en Amazon Cloud Technology o cómo combinar Amazon SageMaker y Stable Diffusion para realizar tareas de inferencia y entrenamiento de modelos.

Para ayudar a los clientes a crear, implementar y administrar aplicaciones en Amazon Cloud Technology de forma rápida y segura, muchos socios trabajan en estrecha colaboración con Amazon Cloud Technology. Ofrecen una amplia variedad de servicios, conocimiento técnico profundo, mejores prácticas y soluciones que incluyen migración de infraestructura, modernización de aplicaciones, seguridad y cumplimiento, análisis de datos, aprendizaje automático, inteligencia artificial, alojamiento en la nube, DevOps, consultoría y capacitación.

Recientemente, eCloudrover, un socio de servicios central de Amazon Cloud Technology, lanzó imAgine, una solución de pintura de IA basada en Stable Diffusion, que no solo tiene un modelo de algoritmo de IA avanzado que ha sido ampliamente verificado y fácil de implementar, sino que también proporciona un rico y alto -Calidad Los recursos rentables en la nube están diseñados para optimizar costos y están diseñados para ayudar a industrias como juegos, comercio electrónico, medios, cine y televisión, publicidad y medios a construir rápidamente canales de aplicaciones AIGC y crear productividad líder en la IA. era.

Habilidades prácticas de difusión estable.

Hay un viejo dicho: "Todo es difícil al principio" y "alcanzar lo vasto y lo sutil". Esto corresponde a los dos problemas más comunes que encuentran los clientes en la práctica real de Difusión Estable: uno es cómo elegir las palabras clave apropiadas para generar imágenes que cumplan con las expectativas y el otro es cómo optimizar los detalles de las imágenes para que el resultado final. producto Los resultados producidos pueden satisfacer las necesidades de las aplicaciones de producción.

Basado en la experiencia pasada de servir a los clientes usando Stable Diffusion, el siguiente contenido se ha compilado como mejores prácticas recomendadas. Esperamos brindar a los lectores una referencia al usar Stable Diffusion para la creación.

proyecto de palabra rápida

A medida que la versión Stable Diffusion continúa iterando y la comprensión de la semántica por parte de la IA se acerca cada vez más al "sentido común", los requisitos de indicaciones serán cada vez mayores. Muchas ideas erróneas sobre las palabras clave a veces pueden tener efectos contraproducentes en los dibujos.

Conceptos básicos de aviso

Las palabras de aviso se dividen en palabras de aviso positivas (mensaje positivo) y palabras de aviso negativas (mensaje negativo), que se utilizan para decirle a la IA qué se necesita y qué no.

Malentendidos sobre el aviso

-

La rapidez radica en la precisión, no en la cantidad; usar las palabras más cortas para describir la imagen es más efectivo que el lenguaje natural.

-

Las palabras descriptivas para mejorar la calidad no son en absoluto una acumulación absurda: cuanto más, mejor.

-

Los movimientos iniciales que se ven con frecuencia: "obra maestra", "mejor calidad", etc., a menudo se vuelven engorrosos con las palabras clave. Estas palabras eran significativas en la era NovelAI, porque NovelAI usaba una gran cantidad de estas palabras para evaluar imágenes al entrenar el modelo; pero ahora, después de que los autores del modelo en Civitai continúan refinando el modelo, estas palabras rápidas son difíciles de usar en la era NovelAI. Era NovelAI Muestra el papel debido en los resultados del gráfico generado.

Ajustar el peso de las palabras clave

-

El peso predeterminado de los afijos es 1, que disminuye de izquierda a derecha.

-

El peso de la palabra inmediata afectará significativamente los resultados de la generación de imágenes.

-

Utilice paréntesis + dos puntos + número para especificar el peso de la palabra clave, escrita como (una niña: 1,5)

Preste atención al orden de las palabras clave.

-

Por ejemplo, si la etiqueta del paisaje está al frente, el personaje será pequeño, y si es al revés, el personaje será más grande o de longitud media.

-

Elegir el orden y la gramática correctos para usar las palabras clave mostrará la imagen deseada mejor, más rápido y más eficientemente.

Emoji en el momento

-

Prompt admite el uso de emoji y tiene buena expresividad. Para acciones o expresiones faciales específicas, puede lograr el efecto agregando imágenes de emoji.

-

Para evitar la deriva semántica, dé prioridad a los emoji y luego utilice una sintaxis compleja menos innecesaria, como con

Recomendación inmediata de perspectiva

| parámetro |

explicar |

| primer plano extremo |

primer plano de la cara |

| de cerca |

cabeza |

| primer plano medio |

foto de identificación |

| tiro medio |

Medio cuerpo |

| tiro de vaquero |

Sin piernas |

| plano medio completo |

Sin pies |

| tiro completo |

todo el cuerpo |

Optimización de imagen

Muchas veces generamos una imagen poco satisfactoria y esperamos optimizar aún más el resultado, pero muchas veces no sabemos por dónde empezar. En este momento, puede consultar las siguientes mejores prácticas para ajustar los parámetros de la imagen:

¿Qué parámetros deben ajustarse?

-

Escala CFG: La correlación entre la imagen y la palabra clave. Cuanto mayor sea el valor, mayor será la influencia de las palabras clave en los resultados finales generados y mayor será el grado de ajuste.

CFG 2-6: Creativo, pero quizás demasiado retorcido y no sigue las indicaciones. Puede ser divertido y útil para obtener consejos breves.

CFG 7-10: Recomendado para la mayoría de consejos. Un buen equilibrio entre creatividad y orientación.

CFG 10-15: Úselo cuando esté seguro de que el mensaje es detallado y muy claro, y tiene requisitos muy claros para el contenido de la imagen.

CFG 16-20: Generalmente no se recomienda a menos que el mensaje sea muy detallado. Puede afectar la consistencia y la calidad.

CFG >20: Casi inutilizable.

-

Número de iteraciones de pasos de muestreo: cuantos más pasos haya, más pequeños y precisos serán los ajustes de la imagen en cada paso. También aumentará proporcionalmente el tiempo necesario para generar la imagen.

Para la mayoría de los muestreadores, cuantas más iteraciones, mejor, pero se logra poco efecto más allá de 50 pasos.

-

Método de muestreo: los diferentes métodos de muestreo tienen diferentes números óptimos correspondientes de pasos de iteración, que deben considerarse de manera integral al hacer comparaciones.

Euler a: Se pueden producir imágenes creativas y diferentes con diferente número de pasos. Y este es un método de muestreo más eficiente que se puede utilizar para verificar rápidamente la efectividad de las indicaciones.

DPM2 a Karras: adecuado para ejecutar modelos reales, pero difícil de controlar después de 30 pasos.

DPM++ 2M Karras: Excelente rendimiento con un gran número de pasos. Cuanto mayor sea el número de pasos, más detalles.

DDIM: la convergencia es rápida, pero la eficiencia es relativamente baja porque se requieren muchos pasos para obtener buenos resultados, y es adecuada para usar durante el rediseño.

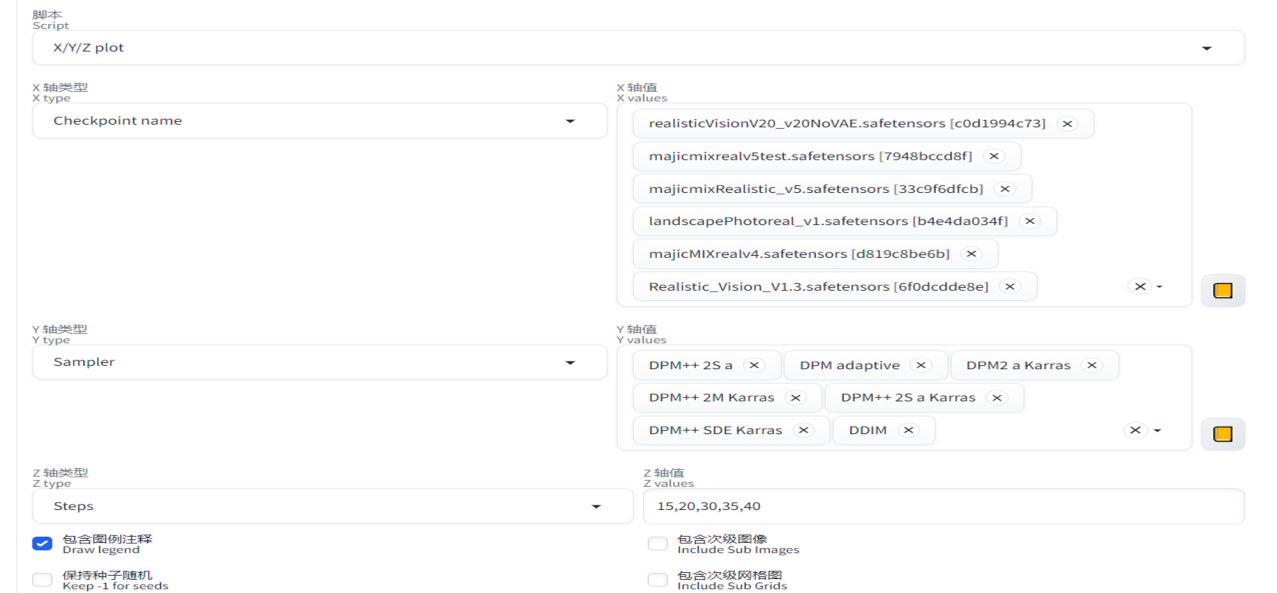

Diferentes modelos y métodos de muestreo producen resultados diferentes. Lo anterior es solo como referencia. Al seleccionar un método de muestreo, es mejor utilizar el gráfico X/Y/Z para comparar.

-

Semilla aleatoria: el valor de la semilla aleatoria a menudo tiene un gran impacto en la composición, que también es la principal fuente de aleatoriedad en la generación de imágenes SD.

Manteniendo la semilla sin cambios, la misma palabra y modelo, y manteniendo todos los parámetros consistentes, la misma semilla puede generar (casi) la misma imagen varias veces.

Después de determinar una composición de imagen adecuada, lo más apropiado es arreglar las semillas y pulir aún más los detalles.

Cómo comparar y encontrar los mejores parámetros

Utilice el gráfico X/Y/Z para encontrar los mejores parámetros: al utilizar el gráfico X/Y/Z, podemos comparar claramente los resultados bajo diferentes parámetros, localizar rápidamente el rango de parámetros apropiado y realizar un control de generación adicional.

Optimización del tamaño de la imagen

-

La calidad de la imagen no está directamente relacionada con el tamaño de la imagen.

-

Pero el tamaño afecta el contenido del tema/imagen hasta cierto punto, porque potencialmente representa la categoría seleccionada (como personajes de pantalla verticales, paisajes de pantalla horizontales, emoticonos de pequeña resolución, etc.).

-

Cuando el tamaño de la trama es demasiado amplio, es posible que aparezcan varios sujetos en la trama.

-

Los tamaños superiores a 1024 pueden producir resultados insatisfactorios y ejercer una enorme presión sobre la memoria del servidor. Se recomienda resolución de tamaño pequeño + restauración HD.

Optimice la generación de múltiples caracteres/caracteres únicos anchos

-

El simple uso de txt2img no puede especificar de manera efectiva las características de un solo carácter en el caso de varios caracteres.

-

La solución más recomendada es crear un borrador + img2img o ControlNet.

-

Para generar una pintura amplia + un solo personaje, lo mejor es hacer un boceto, aplicar color y determinar el cuerpo principal de la imagen, o usar OpenPose de ControlNet para hacer el esqueleto del personaje.

-

Para determinar el número de caracteres para varios personajes, es mejor utilizar OpenPose de ControlNet para especificar; esta solución también es adecuada para dibujar tres vistas del mismo personaje.

Realizar reparación manual

-

Envíe la imagen a img2img inpaint, use aproximadamente la misma palabra, coloque el mensaje sobre "mano" al frente y establezca el rango de redibujado de acuerdo con cuánto desea que cambien las características de la mano (si solo desea que la mano sea más completo, ajústelo por debajo de 0,25), luego mantenga los pasos y CFG igual que txt2img.

-

Encuentre una imagen de mano que cumpla con sus expectativas y utilice preprocesadores + modelos como Canny u OpenPose_hands de ControlNet, combinados con operaciones de pintura, para lograr un control manual más preciso.

Realizar restauración facial.

-

Al realizar dibujos con sujetos humanos pequeños, a menudo se produce un colapso facial. Especialmente en el proceso de generación de códigos QR artísticos que se presentará más adelante en este artículo, las caras de los personajes a menudo colapsan debido a la presencia de puntos de códigos QR.

-

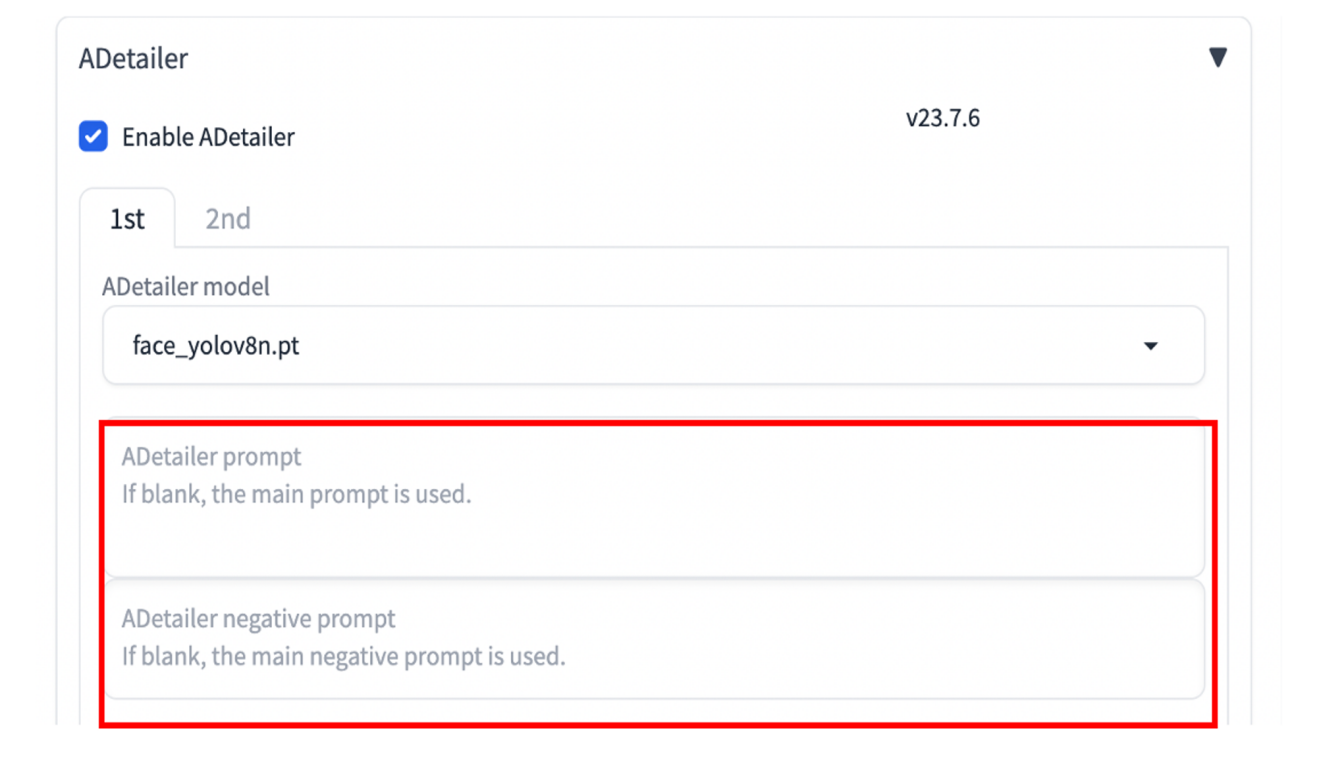

Para volver a dibujar el rostro, se recomienda utilizar el complemento! After Detailer, comúnmente conocido como ADetailer.

-

Este complemento utilizará el algoritmo yolo para identificar objetos en la imagen. Lo configuramos para reconocer los rostros de las personas y proporcionar palabras y modelos rápidos para volver a dibujar el rostro; el complemento volverá a dibujar parcialmente la posición facial reconocida para completar la reparación facial.

-

El complemento ADetailer puede satisfacer las necesidades de reparación y reconocimiento facial y manual.

-

También se puede hacer referencia al modelo Lora en ADetailer para generar un rediseño parcial.

Título original: Uso de ControlNet para generar códigos QR artísticos: solución de pintura con IA basada en difusión estable