Poda modelo

-

Artículo relacionado: Aprendizaje de redes convolucionales eficientes mediante el adelgazamiento de redes (ICCV 2017)

-

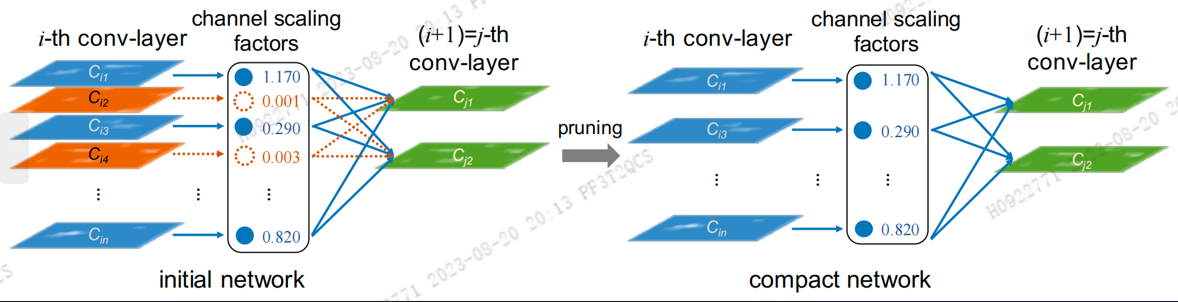

Considere una pregunta: la capa convolucional en el modelo de aprendizaje profundo tiene muchas características, ¿habrá

存在一些没有价值的特征conexiones relacionadas? ¿Y cómo juzgar si una característica y su conexión son valiosas?

Primero da la respuesta:

在 Batch Normalize 层的缩放因子上施加 L1 正则化·

ventaja

- No requiere ningún cambio en las arquitecturas CNN existentes

- Utilice la regularización L1 para llevar el valor del factor de escala BN a cero

- nos permite identificar

不重要的通道(o neuronas) ya que cada factor de escala corresponde a un canal convolucional específico (o neurona de una capa completamente conectada) - Esto facilita la poda a nivel de canal en el siguiente paso.

- nos permite identificar

- Los términos de regularización adicionales rara vez perjudican el rendimiento. No sólo eso, sino que en algunos casos conduce a una mayor precisión de generalización.

- La poda de canales sin importancia a veces puede degradar temporalmente el rendimiento, pero este efecto puede compensarse mediante un ajuste posterior de la red podada.

- Después de la poda, la red más estrecha resultante es más compacta que la red amplia original en términos de tamaño del modelo, memoria de ejecución y operaciones computacionales. El proceso anterior se puede repetir varias veces.