Resumen

ORB-SLAM3 es un sistema SLAM que admite visión, visión más navegación inercial y mapas híbridos . Puede funcionar en cámaras monoculares, binoculares y RGB-D utilizando modelos estenopeicos u ojo de pez.

Es el primer sistema VIO basado en funciones estrechamente acoplado que solo se basa en la estimación máxima a posteriori (incluida la IMU en la inicialización). El efecto de dicho sistema es: ya sea en una escena grande o pequeña, en interiores o exteriores, puede funcionar de manera sólida en tiempo real y su precisión ha aumentado de 2 a 5 veces en comparación con la versión anterior. La segunda innovación de este artículo es el mapa híbrido construido en base al nuevo módulo de reubicación que mejora la recuperación, ya que este módulo permite que ORB-SLAM3 se ejecute durante mucho tiempo en escenas con características deficientes: cuando falla el odómetro, el sistema reconstruirá el map y alinear este mapa con el mapa construido originalmente. En comparación con la odometría, que solo utiliza los últimos marcos de datos, ORB-SLAM3 es el primer sistema capaz de reutilizar toda la información anterior en todas las etapas del algoritmo. Dicho mecanismo puede utilizar fotogramas clave con una relación de vista común durante BA, incluso si los dos fotogramas están separados en el tiempo o provienen del proceso de mapeo original.

Este sistema logró una precisión promedio de 3,6 cm en el conjunto de datos EuRoC y una precisión de 9 mm en el conjunto de datos TUM-VI (escena AR/VR), que utiliza dispositivos portátiles de movimiento rápido. El autor ha abierto el código: https://github.com/UZ-SLAMLab/ORB_SLAM3

1. Introducción

La mayor ventaja del mapeo SLAM es que permite comparar y utilizar observaciones previas en BA que realizan tres asociaciones de datos:

Asociación de datos a corto plazo: emparejar elementos del mapa en los últimos segundos. Al igual que lo que se hace en VO, la eliminación de fotogramas que ya no se ven dará como resultado una deriva acumulativa.

Asociación de datos a mediano plazo: la combinación de mapas con pequeños errores de cámara acumulativos, que también se puede usar en BA, puede lograr una deriva cero cuando el sistema se ejecuta en un mapa ya construido.

Asociación de datos a largo plazo: use la reidentificación de escenas para hacer coincidir las observaciones actuales con observaciones anteriores, independientemente de los errores acumulativos y se puede lograr incluso si el seguimiento falla. para mayor precisión BA. Esta es la clave de la garantía de precisión de SLAM en escenas grandes.

Este es el primer sistema de navegación inercial visual y visual que puede realizar la asociación de datos a corto, mediano y largo plazo. Puede ejecutarse sin desviarse en el entorno de un mapa conocido, donde la asociación de datos de mapas mixtos puede garantizar que podamos realizar la coincidencia de mapas y la optimización BA, que también logra un propósito: construir un mapa, y luego puede ser preciso en la posición del mapa.

Principales contribuciones:

Un sistema SLAM de navegación visual-inercial monocular y binocular: todos se basan en MAP (última estimación de probabilidad posterior), incluso en el momento de la inicialización de la IMU.

Algoritmo de reidentificación de escenas de alta recuperación: DBoW2 necesita hacer coincidir tres fotogramas clave consecutivos, lo que es demasiado lento. El método del autor es: se comprueba la consistencia geométrica del cuadro clave candidato por primera vez , y luego se utilizan los tres cuadros clave de vista común para las pruebas de consistencia local. Esta estrategia mejora la tasa de recuperación y simplifica la asociación de datos, lo que mejora la precisión del mapa. , pero a un costo computacional mayor.

El primer sistema SLAM que puede resolver un mapa híbrido completo de visión pura o navegación inercial visual. En sistemas monoculares o binoculares, Atlas representa una serie de mapas discretos, y se pueden aplicar a todos los procesos de mapeo: reidentificación de escenas, relocalización de cámaras, detección de cierre de bucle y fusión precisa de mapas. Esto permite que el mapa se construya en diferentes momentos (sistema SLAM incremental). El Atlas puramente visual es una referencia a un artículo en IROS en 2019: ORBSLAM-atlas: un sistema multimapa robusto y preciso. Este artículo agrega Un mapa híbrido Se utiliza un sistema basado en la navegación inercial visual para realizar el reconocimiento de la escena.

Representación de cámara abstracta: hacer que los sistemas SLAM sean independientes del modelo de cámara utilizado. Y permite agregar nuevos modelos proporcionando sus funciones proyectivas, no proyectivas y jacobianas. Proporcionamos implementaciones de modelos estenopeico y ojo de pez.

2. Trabajo relacionado

La Tabla 1 muestra el trabajo de estimación de pose y asociación de datos.

SLAM visual

MonoSLAM: El primer sistema SLAM basado en las características de EKF y ShiTomasi

PTAM: seguimiento y mapeo separados, basados en fotogramas clave

LSD-SLAM: construya un mapa semidenso de una escena grande, pero el mapa no está optimizado y la precisión es baja

SVO detecta características FAST, usa un método directo para rastrear características y usa un modelo de error de reproyección para optimizar la pose, pero solo la asociación de datos a corto plazo limita su precisión.

DSO también puede obtener un posicionamiento preciso de la cámara en escenas donde no se pueden detectar puntos característicos. El BA del error fotométrico local de 7 fotogramas clave se usa para optimizar la pose, y la profundidad inversa se usa para almacenar puntos.

Sistema de navegación inercial visual

MSCKF: marginación de características basada en EKF para simplificar los cálculos (sin puntos de mapa en el vector de estado)

OKVIS: El primer sistema VIO optimizado basado en fotogramas clave estrechamente acoplado

ROVIO aprovecha los errores fotométricos de EKF

快速的IMU初始化方法:Solución de forma cerrada de la estructura inercial visual a partir del movimiento Inicialización de estado simultánea y calibración de polarización del giroscopio en la navegación asistida por inercia visual

VINOS->VINOS-Fusión->Kimera

VI-DSO: tarda 20-30 s en inicializarse

3. Resumen del sistema

ORB-SLAM3 es un sistema basado en ORB-SLAM2 y ORB-SLAM-VI, que puede funcionar de forma robusta en visión pura o en sistemas de navegación visual inercial (monocular, binocular y RGB-D, usa modelo estenopeico u ojo de pez, también puedes definir tu propio modelo).

Atlas es un mapa híbrido compuesto por una serie de mapas discretos. Aquí se mantiene un mapa activo para ubicar nuevos fotogramas clave, y el subproceso de mapeo local optimiza y actualiza continuamente el mapa. También hay mapas no activos en Atlas. Este sistema se basa en el modelo de bolsa de palabras para codificar el sistema para relocalización, detección de cierre de bucle y fusión de mapas.

El subproceso de seguimiento procesa la información del sensor, calcula la pose del marco actual y el mapa activo en tiempo real y minimiza el error de reproyección de los puntos característicos coincidentes. Este subproceso también tiene un proceso de selección de fotogramas clave. En el modo VIO, la velocidad del cuerpo y la polarización de la IMU se optimizan utilizando el escalonamiento de la navegación inercial. Cuando se pierde el subproceso de seguimiento, el subproceso de seguimiento intenta completar la reubicación del marco actual en todos los Alats. Si la reubicación de stock es exitosa, el seguimiento se retirará. De lo contrario, la activación se restablecerá como no activa después un período de tiempo Se inicializará un nuevo mapa activo.

El subproceso de mapeo local agrega fotogramas clave y puntos al mapa activo, elimina fotogramas redundantes y optimiza el mapa usando BA visual o visual-inercial, todo dentro de una ventana deslizante local. Además, en el caso de la navegación inercial, los parámetros de la IMU se inicializan y optimizan utilizando la estimación MAP.

Los subprocesos de detección de cierre de bucle y fusión de mapas detectan las mismas regiones en el mapa activo y en todo el Atlas. Si la misma área está activa, se realizará el proceso de circuito cerrado, si pertenecen a mapas diferentes, se fusionarán en un solo mapa. Después de la corrección del bucle, se activa un BA global en un subproceso para optimizar el mapa.

4. Modelo de cámara

Se proporcionan un modelo estenopeico y un modelo de ojo de pez. El modelo de cámara se abstrae por separado en el sistema (ecuaciones de reproyección y retroproyección, ecuaciones jacobianas, etc.). Esto nos permite utilizar nuestro propio modelo de cámara en el sistema. En el proceso de abstracción, también encontramos algunas dificultades, que se analizan a continuación.

A. Reubicación

ORB-SLAM usa Epnp para resolver la reubicación, pero se basa en un modelo de cámara estenopeica calibrado. Para continuar con nuestro trabajo, usamos un algoritmo ML-pnp independiente de la cámara que se puede desacoplar por completo del modelo de cámara. Porque él usa rayos de proyección como entrada. El modelo de cámara solo necesita proporcionar una función de retroproyección que pase de píxeles a rayos de proyección para poder usar la reorientación.

B. SLAM binocular no corregido

Muchos sistemas SLAM asumen que las cámaras binoculares han sido rectificadas (ambas imágenes se convierten en proyecciones estenopeicas usando la misma distancia focal, los planos de la imagen son coplanares y alineados con la epilina horizontal, de modo que mirando la misma línea, pueden coincidir fácilmente las características en una de las imágenes). Sin embargo, la suposición de rectificación para imágenes estereoscópicas tiene limitaciones significativas y no es adecuada o factible en muchas aplicaciones. Por ejemplo, rectificar una cámara de ojo de pez requiere un gran recorte. Esto pierde las ventajas de una cámara gran angular con un gran ángulo de visión, construcción rápida de mapas y procesamiento de oclusión robusto. Por lo tanto, el sistema de este documento no se basa en la corrección de imágenes, sino que trata la cámara binocular como dos cámaras monoculares:

Hay una transformación SE(3) constante

Dos imágenes tienen observaciones parcialmente idénticas

Estas restricciones son eficientes cuando triangulamos nuevos puntos de referencia y realizamos la optimización BA. SLAM estima una pose de cuerpo rígido 6DOF cuyo marco de referencia se puede ubicar en una de las cámaras, o en el sensor IMU, representando la cámara en términos de pose de cuerpo rígido. Podemos usar binoculares para inicializar los puntos de referencia vistos por primera vez. Todavía hay muchas áreas superpuestas para el binocular, lo usamos como una cámara monocular.

SLAM de navegación inercial visual

ORB-SLAM-VI es el primer sistema de navegación inercial visual capaz de reutilizar mapas, pero solo puede basarse en un modelo estenopeico de propósito único y la inicialización es muy lenta. En este documento, el sistema utiliza una inicialización IMU rápida y precisa y aprobó un La biblioteca SLAM de código abierto utiliza modelos estenopeicos u ojo de pez para completar rápidamente la inicialización de la navegación inercial monocular o binocular .

Inicialización B.IMU

El propósito de la inicialización es proporcionar buenos valores iniciales para las variables de la navegación inercial: la velocidad del cuerpo, la dirección de la gravedad y el sesgo de la IMU. VI-DSO intenta no inicializar y usa directamente BA para optimizar, lo que da como resultado una inicialización de hasta 30 s. En este trabajo, proponemos un método de inicialización rápido y preciso basado en tres ideas clave:

SLAM monocular puro puede proporcionar mapas iniciales muy precisos, pero es independiente de la escala. Entonces puede agregar Imu para obtener información de escala.

SLAM monocular a gran escala consciente de la deriva de escala demuestra que converge más rápido cuando la escala se representa explícitamente como una variable de optimización, en lugar de usar una representación implícita de BA.

Ignorar la incertidumbre del sensor durante el proceso de inicialización de la IMU producirá grandes errores impredecibles (Inicialización rápida y robusta para SLAM visual-inercial_2019ICRA)

Por lo tanto, debemos considerar la incertidumbre del sensor durante el proceso de inicialización y considerar la inicialización de la IMU como un problema MAP, que se divide en tres pasos:

Estimación MAP visual pura : solo se necesitan 2 segundos para inicializar una cámara monocular pura en ORB-SLAM e insertar fotogramas clave a una velocidad de 4HZ. Después de la inicialización, tenemos un mapa que consta de diez poses de cámara y cientos de puntos 3D en una escala determinada. La optimización de BA se realiza utilizando el modelo de visión pura en la Figura 2. Estas poses se transforman en coordenadas corporales para obtener trayectorias  .

.

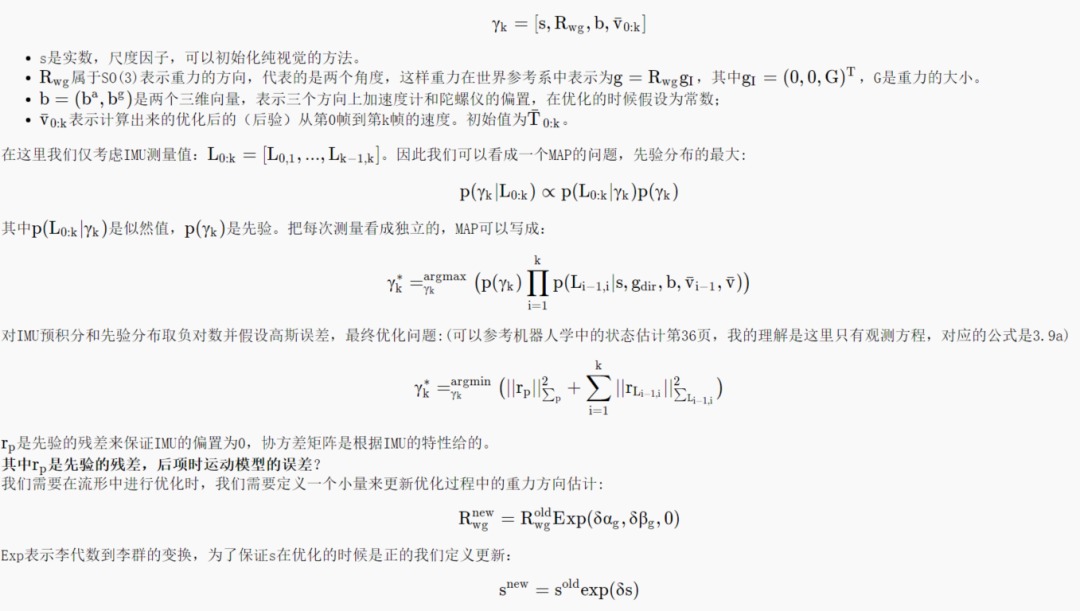

Estimación MAP de navegación inercial pura : el vector de estado de navegación inercial es:

Una vez que se completa la optimización inercial, la posición y la velocidad del marco y los puntos del mapa 3D se escalan a la escala estimada y se rotan para alinear el eje z con la dirección estimada de la gravedad. El sesgo se actualiza y la preintegración de IMU se repite para reducir futuros errores de linealización.

Estimación MAP para VIN : una vez que tengamos buenos parámetros para VIN e IN, podemos realizar una optimización conjunta de VIN para optimizar aún más los parámetros. Esta figura está en 2a pero con el mismo sesgo para todos los fotogramas clave y la misma información previa. Nuestros exhaustivos experimentos de inicialización en el conjunto de datos de EuRoC muestran que esta inicialización es muy efectiva, logrando un error de escala del 5% en el caso de trayectorias de 2 segundos. Para mejorar la estimación inicial, se realiza BA inercial aparente a los 5 y 15 segundos después de la inicialización, convergiendo a un error de escala del 1%, como se muestra en la Sección VII. Después de estos BA, decimos que el mapa está maduro, es decir, la escala, los parámetros IMU y la dirección de la gravedad se han estimado con precisión, y este método de inicialización es mucho mejor que ORB-SLAM-VI y VI-DSO. Fijando el factor de escala en 1 y extrayéndolo de las variables de optimización inercial, podemos extender fácilmente la inicialización inercial monocular a inercial estéreo, mejorando así su convergencia.

C. Seguimiento y Mapeo

El seguimiento y el mapeo utilizan el esquema en SLAM monocular visual-inercial con reutilización del mapa.

El subproceso de seguimiento solo optimiza el estado de los dos últimos fotogramas y la posición del punto del mapa permanece sin cambios.

El mapeo utiliza una ventana deslizante de fotogramas clave y sus puntos como variables optimizables, incluidos los fotogramas clave coviewables, pero manteniéndolos fijos.

En algunos casos, cuando la cámara lenta no proporciona una buena observación de los parámetros de inercia, es posible que la inicialización no converja en una solución exacta en 15 segundos. Para hacer que el sistema sea más robusto, este documento propone un nuevo método de optimización de escala , que se basa en el método mejorado de optimización de navegación inercial única, en el que se insertan todos los fotogramas clave, pero la escala y la dirección de la gravedad son los únicos parámetros estimados (Fig. .2d) . En este caso, es una suposición incorrecta que los sesgos son constantes. Los sesgos se pueden corregir utilizando los valores estimados en cada cuadro. Esta optimización es muy eficiente desde el punto de vista computacional y se realiza cada 10 segundos en el subproceso de asignación local hasta que la asignación supera los 100 fotogramas clave o la inicialización supera los 75 segundos.

D. Mejora robusta de seguimiento de pérdidas

El sistema VIO de este artículo ingresa al estado de falla de seguimiento visual cuando el sistema rastrea menos de 15 puntos y luego ejecuta:

Falla a corto plazo: use las lecturas de IMU para estimar la pose, proyecte los puntos del mapa en la pose estimada de la cámara y luego haga la coincidencia en una ventana de imagen grande, y los resultados coincidentes se incluyen en la optimización VIO. En la mayoría de los casos, el seguimiento visual se puede restaurar, pero si no se ha restaurado después de más de 5 segundos. al siguiente estado.

Falla a largo plazo: reinicialice la navegación inercial visual para construir un mapa, y este mapa se convierte en el mapa activo.

Fusión de mapas y detección de cierre de bucle

La asociación de datos a corto y mediano plazo establecida entre el marco de la imagen y el mapa activo consiste en proyectar los puntos del mapa en la posición estimada en el subproceso de seguimiento y mapeo, y luego hacer coincidir en una pequeña ventana para obtener la relación de coincidencia. Para la asociación de datos a largo plazo para la detección de reubicación y cierre de bucle, ORB-SLAM utiliza un modelo de bolsa de palabras. A diferencia del seguimiento, el reconocimiento de lugares utiliza DBoW2 para construir una base de datos de fotogramas clave utilizando sus vectores de bolsa de palabras, y una imagen de consulta determinada puede proporcionar de manera eficiente los fotogramas clave más similares en función de sus vectores de bolsa de palabras. Usando solo el primer marco candidato, la consulta DBoW2 original logra una precisión y recuperación del 50-80%. Para evitar observaciones falsas positivas, DBoW2 implementa comprobaciones de coherencia temporal y geométrica, aumentando la precisión de los puntos de trabajo al 100 % y la recuperación al 30-40 %. Crucialmente, la verificación de consistencia temporal retrasó el reconocimiento de posición para al menos 3 fotogramas clave. Al intentar usar esto en nuestro sistema Atlas, descubrimos que esta latencia y menor recuperación a menudo se debían a regiones repetidas en el mismo mapa o en mapas diferentes. En este trabajo, proponemos un novedoso algoritmo de reidentificación de escenas con recuperación mejorada en asociaciones de datos de mapas híbridos y a largo plazo. Cuando el subproceso de mapeo filtra un fotograma clave, la reidentificación de la escena intenta detectar fotogramas clave en Atlas para hacer coincidir. Si el fotograma clave coincidente está en el mapa activo, esto determina un bucle cerrado; de lo contrario, es una asociación de datos del mapa híbrido, realizando una fusión del mapa coincidente y el mapa activo actual. La segunda característica de este método es que una vez que se estiman las poses del marco actual y el marco del mapa coincidente, construimos una ventana local entre el marco coincidente y sus vecinos en la vista común. En esta ventana, enfocamos nuestra búsqueda de asociaciones de datos a mediano plazo, lo que mejora la precisión de la detección de cierre de bucle y la fusión de mapas.

A. Reidentificación de la escena

Para lograr un alto recuerdo, cada nuevo fotograma clave entrante detecta varios fotogramas clave similares en Altas utilizando la base de datos DBoW2. Con el fin de lograr el 100% de precisión. Cada marco candidato está sujeto a verificación geométrica. La inspección de geometría incluye verificar si hay un punto de característica ORB (distancia de Hamming) que coincida con el descriptor de puntos del mapa en la ventana de la imagen. Si hay varios marcos candidatos coincidentes, primero elimine la coincidencia incorrecta y luego verifique la relación de distancia con el marco candidato clasificado en segundo lugar. El proceso de reidentificación de la escena es el siguiente:

Cuadro clave candidato de DBoW2: use el cuadro clave activo para recuperar tres cuadros similares candidatos en la base de datos DBoW2 de Altas, incluido el cuadro de vista común de Ka. Llamamos al cuadro coincidente Km.

Ventana local: Para cada Km definimos una ventana local que incluye Km y su mejor marco de co-vista, y todos los puntos del mapa observados por ellos. La indexación directa de DBoW2 proporciona la coincidencia de puntos de características de Ka y los fotogramas clave de la ventana local, y podemos obtener relaciones de coincidencia 2D-2D y 3D-3D.

Transformación de alineación 3D: use RANSAC->Tam para alinear mejor los puntos del mapa de Km y Ka en la ventana local. En un sistema de navegación inercial monocular o monocular, si el mapa no se ha inicializado correctamente, calculamos la transformación Sim3, y si la inicialización es exitosa, calculamos la transformación SE3. Usamos el algoritmo Horn de 3 puntos para encontrar Tam al calcular ambas transformaciones. Si el Tam calculado transforma el punto en Ka en Km y el error de reproyección es inferior a un cierto umbral, la coincidencia se considera correcta. Se elige la hipótesis con más votos (siempre que la hipótesis alcance un cierto umbral).

Optimización de coincidencias: transforme todos los puntos del mapa en la ventana local a través de Tam para encontrar más puntos del mapa que coincidan con los puntos clave en Ka. Al mismo tiempo, es necesario convertir Ka en la ventana local para encontrar el punto de coincidencia con ella. Use todos los puntos coincidentes para calcular Tam y optimice Tam mediante la optimización no lineal del error de reproyección bidireccional con una función kernel robusta. Si el número de valores internos después de la optimización supera un cierto umbral, se realizará en una ventana de imagen más pequeña. el segundo segmento.

Validación en tres fotogramas clave de vista común: para evitar resultados falsos positivos, DBoW2 decide si activa, retrasa o pierde la reidentificación de posición en tres fotogramas clave consecutivos. La clave de este método es: en la mayoría de los casos, la información que necesitamos verificar ya está en el mapa. Para verificar la reidentificación de la posición, compartimos los dos fotogramas clave con Ka en el mapa activo (fotograma co-visto co-coordinado El punto del mapa supera un determinado umbral. Si no se encuentra ningún fotograma clave de vista común, esta verificación se realizará en el nuevo fotograma clave, pero no es necesario volver a iniciar la bolsa de palabras. La verificación continúa hasta que haya tres fotogramas clave para verificar Tam , o dos fallas consecutivas de verificación de fotogramas clave.

Verificación de orientación de gravedad: en presencia de IMU, hemos estimado Tam si el mapa activo está maduro. Necesitamos asegurarnos de que los ángulos de cabeceo y balanceo de los dos marcos sean inferiores a un cierto umbral para determinar si se debe realizar la reidentificación de la posición.

B. Fusión de mapa visual

Cuando la reidentificación de la posición tiene éxito, se generan un cuadro clave Ka en el mapa activo Ma y un cuadro clave Km en el mapa Altas Mm, y Tma$ se usa para la asociación de datos del mapa mixto para fusionar el mapa. Cabe señalar aquí que la información del mapa en Altas debe ser reutilizada por el hilo de seguimiento para evitar la duplicación de mapas. Aquí el mapa de Ma se coloca en el mapa con Mm como referencia Como hay muchos componentes en Ma, toda la integración puede llevar un tiempo. La fusión de mapas se divide en dos partes: primero, la fusión se realiza en una ventana de conexión definida por los vecinos Ka y Km, y en la segunda etapa, la corrección se propaga al resto del gráfico fusionado a través de la optimización del gráfico de pose. Los pasos específicos del algoritmo de fusión son:

Conjunto de ventana de conexión: la ventana de conexión incluye Ka y su fotograma clave de vista común, Km y su fotograma clave de vista común, y todos los puntos del mapa observados por ellos. Use Tma para alinear los puntos del mapa y los fotogramas clave en Ma con Mm y luego colóquelos en la ventana de conexión.

Mapa de fusión: Ma y Mm se fusionan para formar un nuevo mapa activo. Para eliminar puntos duplicados, los puntos coincidentes de Ma se buscan activamente en los cuadros clave en Mm, y los puntos en Ma se eliminan para cada coincidencia, y los puntos en Mm guardan todas las observaciones. Utilice asociaciones de puntos a medio plazo para actualizar gráficos básicos y de vista común para agregar bordes de conexión de Mm y Ma.

BA en la ventana de conexión: todos los fotogramas clave de Mm y Ma se optimizan localmente en la ventana de conexión. Para garantizar el número de fotogramas clave en la ventana deslizante, el fotograma de vista conjunta de Mm se mantiene fijo. Una vez optimizados, todos los marcos en la ventana de conexión se pueden rastrear para una reutilización rápida y precisa del mapa Mm.

Optimización de gráficos de poses: utiliza el gráfico esencial de todo el mapa fusionado para la optimización de gráficos de poses, manteniendo fijos los fotogramas clave de las regiones conectadas. Esta optimización propaga correcciones desde la ventana de conexión al resto del mapa.

C. Fusión de mapas de navegación inercial visual

Los pasos del algoritmo de fusión visual-inercial son similares a los de la fusión visual pura. Mejorar los pasos 1 y 3 en visión pura para aprovechar mejor la información inercial:

Conjunto de ventana de conexión de VI: si el activo está maduro, transforme el mapa Ma usando Tma (SE3) antes de incluir Ma en la ventana de conexión . Si activo es inmaduro, use T ma (Sim3) para alinear Ma.

Ventana de conexión VI BA: el fotograma clave activo Ka y la pose, la velocidad y el desplazamiento de los últimos cinco fotogramas clave se pueden optimizar. Estas variables están correlacionadas por la preintegración de IMU. Para Mm, también optimizamos la pose, la velocidad y el sesgo de Km y sus cinco cuadros adyacentes en el tiempo, como se muestra en la siguiente figura:

Para Mm, se incluye el fotograma clave inmediatamente anterior a la ventana local, pero fijo; mientras que para Ma, se incluye un fotograma clave similar, pero su pose aún se puede optimizar. También se optimizan todos los puntos que todos los fotogramas clave pueden ver y las poses de fotogramas clave que miran esos puntos. Utilice el error de reproyección para asociar fotogramas clave con puntos clave.

D. Detección de circuito cerrado

La detección de cierre de bucle es similar a la fusión de mapas, pero los dos fotogramas clave de la reidentificación de la escena están debajo del mapa activo. Las ventanas de conexión se componen de acuerdo con los fotogramas clave coincidentes, y los puntos duplicados se detectan y fusionan para construir nuevos bordes en la vista común y el gráfico esencial. Luego se realiza una optimización del gráfico de pose para propagar los resultados de la corrección de bucle cerrado a los mapas restantes. El paso final es el BA global, que obtiene la estimación de MAP después de considerar la coincidencia a medio y largo plazo de la detección de cierre de bucle. En el caso de la navegación inercial visual, solo se realiza cuando el número de fotogramas clave está por debajo de un umbral para evitar un gran costo computacional.

referencias

[1] Campos C , Elvira R , Rodríguez, Juan J. Gómez, et al. ORB-SLAM3: una biblioteca precisa de código abierto para SLAM visual, inercial visual y multimapa[J]. 2020.

[2] Campos C , Montiel, José M. M, Tardós, Juan D. Inertial-Only Optimization for Visual-Inertial Initialization[J]. 2020.

[3] https://blog.csdn.net/qq_40878688/article/details/105291348(ORBSLAM-Atlas, un sistema robusto y preciso de mapas múltiples 介绍)

Este artículo es solo para uso académico. Si hay alguna infracción, comuníquese para eliminar el artículo.