- Configurar el clúster

- Trabajando juntos para agrupar

- Caso de ejecución

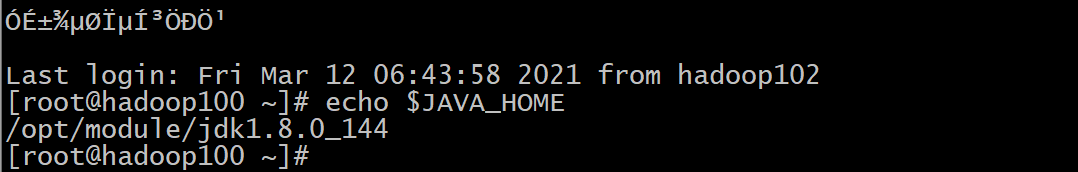

1. Configure el archivo hadoop-env.sh

Escriba la ruta anterior en un archivo, se puede usar el archivo vi o NotePad ++.

Agregue /etc/hadoop/hadoop-env.sh

export JAVA_HOME=/opt/module/jdk1.8.0_144

Ubicación core-site.xml

<property>

<name>fs.defaultFS</name>

<value>hdfs://hadoop101:9000</value>

</property>

<!-- 指定Hadoop运行时产生文件的存储目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/module/hadoop-2.7.2/data/tmp</value>

</property>

Configurar hdfs-site.xml

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

2. Inicie el clúster

Namenode del nodo principal (no siempre se puede formatear, la identificación del clúster cambiará)

bin/hdfs namenode -format

Inicie el NameNode

sbin/hadoop-demon.sh start namenode

Trabajando juntos DataNode

sbin/hadoop-daemon.sh start datanode

Investigar el clúster

jps

Tenga cuidado: jps es un comando JDK, Hadoop está escrito en Java y también se requiere JDK.

http://hadoop101:50070/dfshealth.html#tab-overview

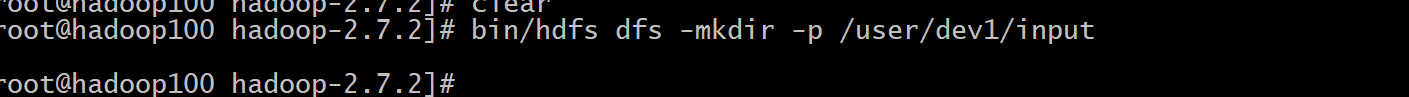

Los hdfs de inicio pseudodistribuidos (sistema de archivos Hadoop Dir)

crean una entrada de archivo para

verificar si el archivo cargado es correcto

bin/hdfs dfs -ls /user/dev1/input/

bin/hdfs dfs -cat /user/dev1/input/word.txt

Ejecutar MapReduce

bin/hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.2.jar wordcount /user/dev1/input/ /user/dev1/output

查看成功的结果:

bin/hdfs dfs -cat /user/dev1/output/*

Colocación yarn-site.xml

Operar bajo dev1

sudo vim yarn-site.xml

Agregar al archivo:

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<!-- 日志保留时间设置7天 -->

<property>

<name>yarn.log-aggregation.retain-seconds</name>

<value>604800</value>

</property>

Inicie NodeManager, ResourceManager e HistoryManager

sbin/yarn-daemon.sh start resourcemanager

sbin/yarn-daemon.sh start nodemanager

sbin/mr-jobhistory-daemon.sh start historyserver

jps

6150 NodeManager

5912 ResourceManager

6284 JobHistoryServer

6317 Jps

Ejecutar WordCount

bin/hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.2.jar wordcount /user/dev1/input /user/dev1/output

Todo el código está adjunto al

historial.

1 java -version

2 ls

3 cd etc

4 ls

5 cd hadoop/

6 ls

7 vi yarn-site.xml

8 sbin/yarn-daemon.sh start resourcemanager

9 sbin/yarn-daemon.sh start nodemanager

10 sbin/mr-jobhistory-daemon.sh start historyserver

11 sbin/yarn-daemon.sh start resourcemanager

12 cd ..

13 ls

14 sbin/yarn-daemon.sh start resourcemanager

15 sbin/yarn-daemon.sh start nodemanager

16 sbin/mr-jobhistory-daemon.sh start historyserver

17 jps

18 bin/hdfs dfs -rm -R /user/dev1/output

19 bin/hadoop jar share/hadoop/mapreduce/hadoop-mapreduce-example

s-2.7.2.jar wordcount / user / dev1 / input / user / dev1 / output