公開アカウント [機械学習と AI 生成] バックステージ返信: 168。[Deep Generative Model] 書籍の無料配布アクティビティに参加できます (締切は 2023 年 9 月 17 日 午後 10 時)。

次の JD.com 専用リンクをクリックして、自分で購入することもできます。

自分に作れないものは、分かりません。

——リチャード・ファインマン

ノーベル物理学賞受賞者ファインマンのこの言葉は、人工知能研究者の心に響き続けており、OpenAI の研究は常に「コンピューターに私たちを理解させるためのアルゴリズムと技術を開発する」という核心的な願望を貫いています。 。」

現在、コンピューターが私たちの世界を理解するには、教師あり学習と教師なし学習という 2 つの方法があります。

その中でも、教師あり学習は技術的に大きな進歩を遂げていますが、その最大の欠点は、データの注釈プロセスに時間がかかり、費用がかかることが多く、非倫理的であるか、不可能である可能性さえあることです。このため、教師なし学習 (または自己教師あり学習) 手法の重要性がますます認識されています。

教師なし学習は、人間の知識学習に最も適したモデルです。子供が成長するときと同じように、自分が見たり聞いたりする情報が何であるかを常に教えてくれる人はいません。世界について彼らがさらされる情報のほとんどは、ラベルが付けられていません。教師なしの方法で世界の法則を学ぶ必要があります。つまり、データ内のパターンと構造を自分で見つける必要があります。

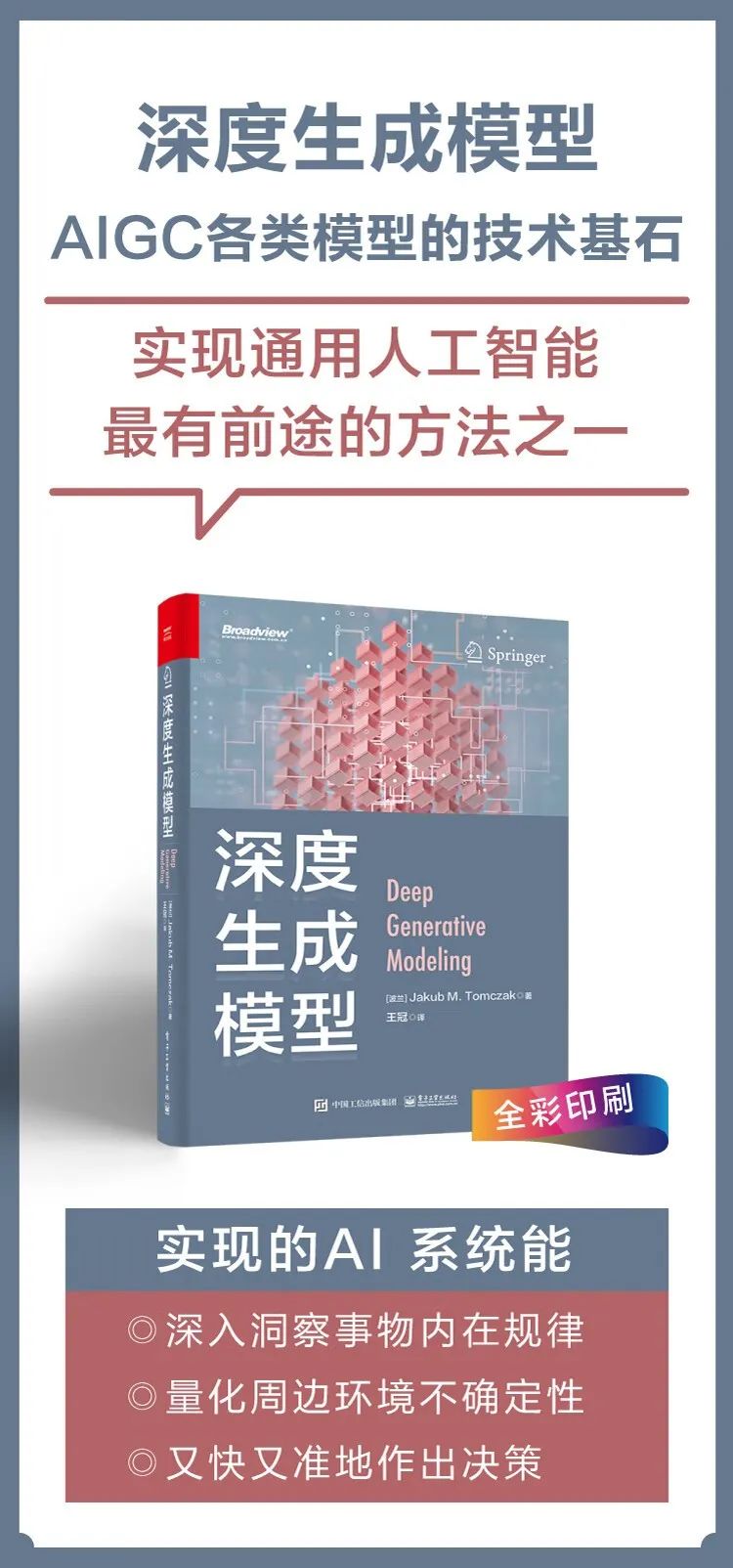

OpenAI によると、深層生成モデルは教師なし学習の最も効果的な方法の 1 つであり、汎用人工知能を実現するための最も有望な方法の 1 つでもあります。

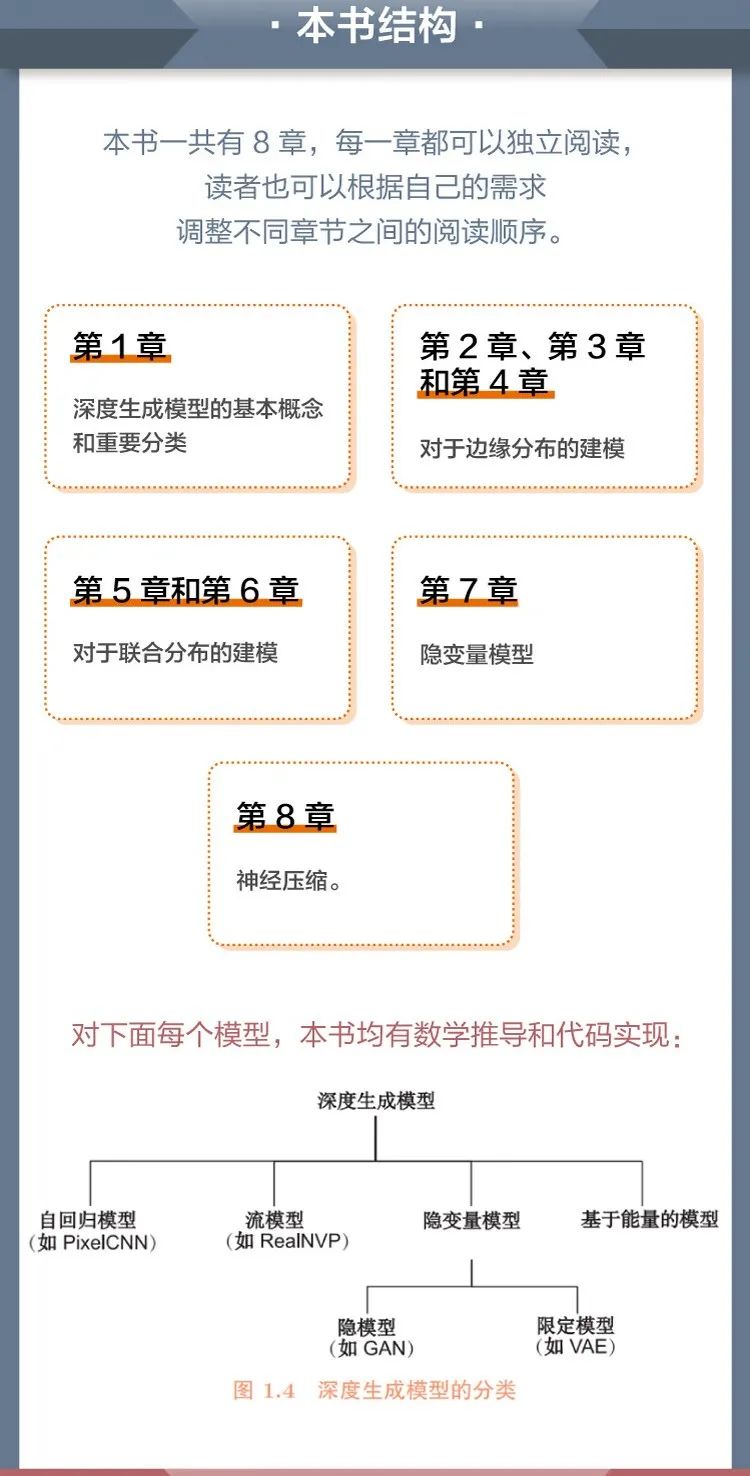

「深い生成モデル」という本では、自己回帰モデル、フロー モデル、潜在変数モデル、エネルギー ベースのモデルなど、さまざまな種類の深い生成モデルを取り上げています。主に、確率モデリングと深層学習を組み合わせて強力な AI を構築する方法について説明しています。周囲環境の不確実性を定量化できるシステム。

この種の AI システムは、生成的な観点から周囲の世界を理解できます。

本書で言及されているこれらのモデルは、ChatGPT に代表される大規模言語モデルや Stable Diffusion に代表される拡散モデルなどの深層生成モデルの背後にある技術的基礎を形成します。

訳者が言ったように、この本を翻訳することで、ChatGPT の出現によってもたらされた暑さ、不安、混乱から解放され、むしろより冷静に考えるようになりました。したがって、新しいテクノロジーについては、その背後にある原理を理解することによってのみ、人々はそれらを快適に感じることができます。

大規模な言語モデルなどの新しいテクノロジーをすべて習得することはできないかもしれませんが、その背後にある基本的な内容のほとんどがこの本に反映されています。この本を注意深く読んでいる限り、数式を導出し、コードを実行し、メソッドを学ぶことができます。さまざまな生成モデルの開発とその応用により、私たちは新しい技術をより冷静に理解し、向き合うことができるようになります。

ChatGPT の背後にある Transformer アーキテクチャと、GPT-1 および GPT-2 から BERT および GPT-3 までの関連モデルはすべて、本書の第 4 章で説明されている自動エンコーダと、第 2 章で説明されている自己回帰モデルに基づいて開発されています。ChatGPT およびその他の関連する大規模言語モデルは、主にデータ収集、データの規模と品質、モデル パラメーターの拡張に焦点を当てていますが、その生成モデル インフラストラクチャは依然として本書で説明されているものに基づいていますが、言語モデルは最適化されています。

前述のテキストから画像またはテキストからテキストへの生成モデルに加えて、テキストから 3D モデル (Dreamfusion、Magic3D)、ビデオ (Phenaki、 Soundify)、音声(AudioLM、Whisper、Jukebox)、コード(CodeX、Alphacode)、画像からテキストを生成するモデル(Flamingo、VisualGPT)など。これらのアプリケーションの技術的基礎は、この本に記載されています。

この本の特別な点は、子供たちがブロックを組み立てることによって物理法則を学ぶのと同じように、この本の読者もコードを通じて深い生成モデルを学ぶことができることです。

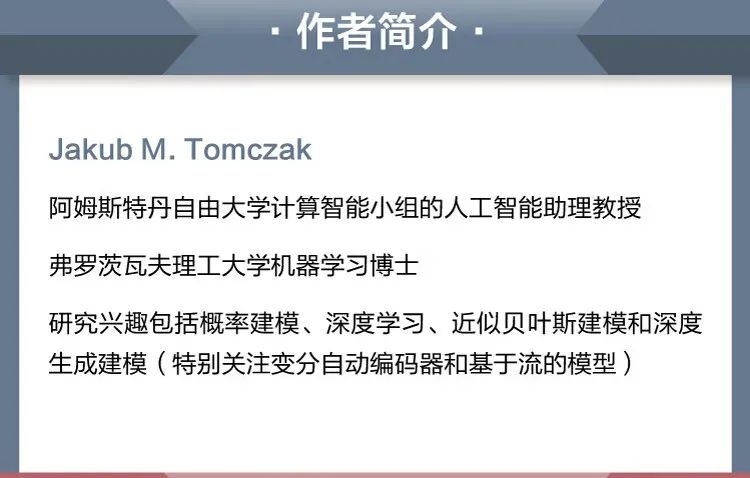

本書の著者はこの分野で多数の論文を発表しており、この分野への造詣が深い。

この本は、確率生成モデルに関するコースの教科書として使用できます。