一連の考え

Naive Bayesian 法は、ベイジアン定理と特徴条件の独立した仮定に基づく分類法です。与えられたトレーニング データ セットに対して、最初に特徴的な特徴条件の独立した仮定に基づいて入力/出力の結合確率分布を学習します。次に、このモデルに基づいて、与えられた入力に対して、ベイズの定理を使用して、最大の出力 y を見つけます。事後確率。

単純ベイジアン学習と分類

単純なベイジアン学習戦略:

y = f ( x ) = arg max ck P ( Y = ck ) ∏ j P ( X ( j ) = x ( j ) ∣ Y = ck ) y=f(x)= arg\max_ {c_k} P(Y=c_k)\prod_{j}P(X^{(j)}=x^{(j)}|Y=c_k)y=f ( x )=あらぐ_ _ck最大P (Y)=ck)j∏P ( X(じ)=バツ( j ) ∣Y=ck)

事後確率の最大化:

f ( x ) = arg max ck P ( ck | X = x ) f(x)=arg\max_{c_k} P(c_k|X=x)f ( x )=あらぐ_ _ck最大P ( ck|×=× )

Naive Bayes 法のパラメータ推定アルゴリズム

最尤推定

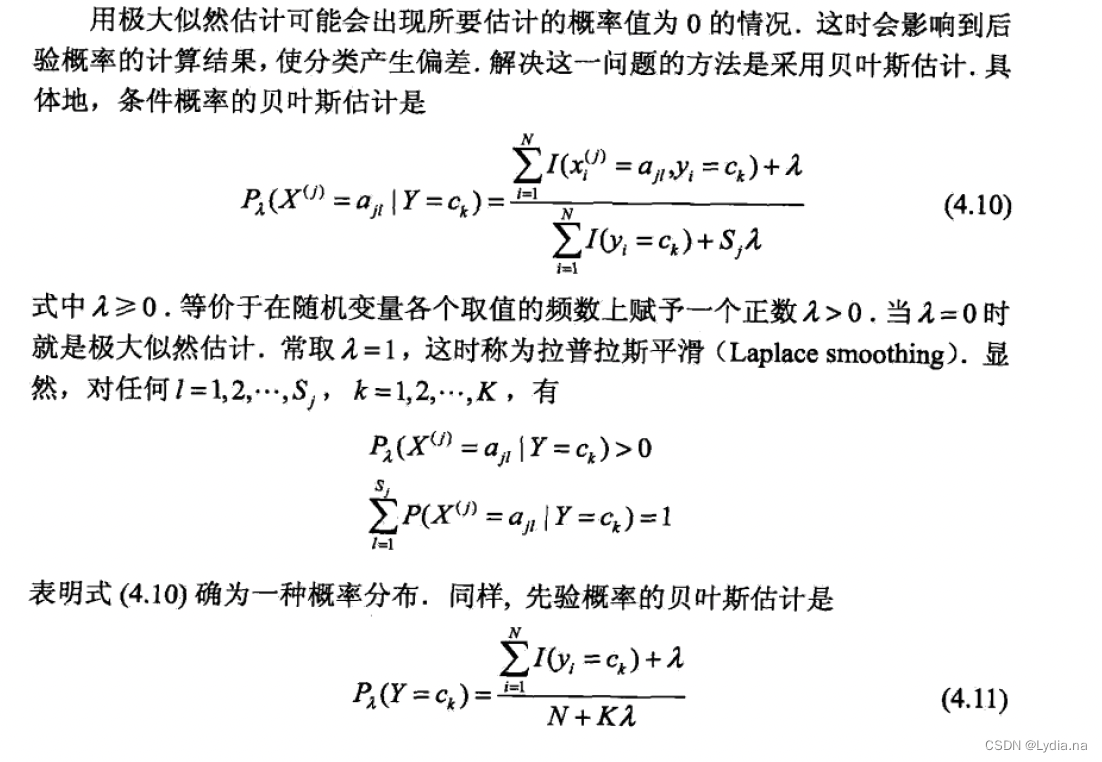

ベイジアン推定