CLASS torch.nn.BatchNorm2d(num_features, eps=1e-05, momentum=0.1, affine=True, track_running_stats=True)

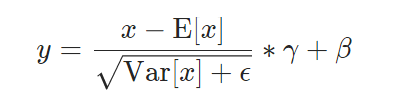

El principio básico es:

Como se muestra, el objetivo es hacer que el bloque normalizó distribución razonable de transmisión de datos, acelerar el proceso de formación.

Los datos de entrada es una de cuatro dimensiones (N, C, H, W ), el tamaño N- lote entrado, C es el número de canal de la imagen de entrada, (H, W) es el tamaño de la imagen de entrada.

-

num_features - 100

-

eps predeterminado 1e-5, añadido a los datos en poder estable en el denominador (el error no se produce denominador 0)

-

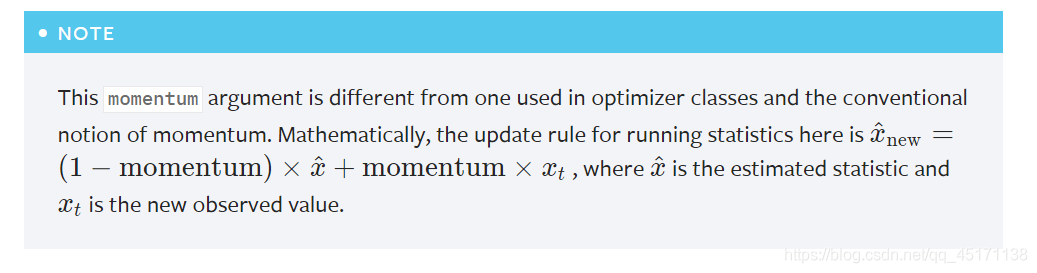

predeterminado impulso 0.1, las estimaciones de la media y la varianza de la operación

-

predeterminado afín es Verdadero, el parámetro de aprendizaje representa (es decir, γ y beta])

-

track_running_stats predeterminado Verdadero, indica las estimaciones de funcionamiento de la media y la varianza de

track_running_stats = True representación lotes seguimiento propiedades estadísticas de todo el proceso de formación, obtener la varianza y la media, y no sólo se basa únicamente en las características estadísticas del lote actual de entrada. Por el contrario, si track_running_stats = False A continuación, sólo calcular las propiedades estadísticas de la entrada de lote actual en la media y la varianza.