De: Corazón de la Máquina

Ingrese al grupo de PNL—> Únase al grupo de intercambio de PNL

¿Serán los agentes la clave para AGI? El equipo de PNL de Fudan explora exhaustivamente los agentes basados en LLM.

Recientemente, el Equipo de Procesamiento del Lenguaje Natural de la Universidad de Fudan (FudanNLP) lanzó un artículo de revisión sobre agentes basados en LLM. ¡El texto completo tiene 86 páginas y más de 600 referencias! A partir de la historia de los agentes de IA, los autores clasificaron de manera integral el estado actual de los agentes inteligentes basándose en grandes modelos de lenguaje, incluidos: los antecedentes, la composición, los escenarios de aplicación de los agentes basados en LLM y la sociedad de agentes que ha atraído mucha atención . Al mismo tiempo, los autores discutieron temas abiertos y de futuro relacionados con Agent, que son de gran valor para las tendencias de desarrollo futuras de campos relacionados.

Enlace del artículo: https://arxiv.org/pdf/2309.07864.pdf

Lista de documentos de agentes basados en LLM: https://github.com/WooooDyy/LLM-Agent-Paper-List

Los miembros del equipo también agregarán un "resumen de una oración" a cada documento relevante, bienvenido al almacén de Star.

Antecedentes de la investigación

Durante mucho tiempo, los investigadores han estado buscando una Inteligencia General Artificial (AGI) que sea equivalente o incluso superior a los niveles humanos. Ya en la década de 1950, Alan Turing extendió el concepto de "inteligencia" a las entidades artificiales y propuso el famoso test de Turing. Estas entidades de inteligencia artificial suelen denominarse agentes (Agente*). El concepto de "agente" se origina en la filosofía y describe una entidad que tiene deseos, creencias, intenciones y la capacidad de actuar. En el campo de la inteligencia artificial, a este término se le ha dado un nuevo significado: una entidad inteligente caracterizada por la autonomía, la reactividad, la positividad y la sociabilidad .

*No hay consenso sobre la traducción china del término Agente. Algunos estudiosos lo traducen como agente, actor, agente o agente inteligente. Tanto el "agente" como el "agente inteligente" que aparecen en este artículo se refieren al Agente.

Desde entonces, el diseño de agentes ha sido un foco de atención de la comunidad de inteligencia artificial. Sin embargo, los trabajos anteriores se han centrado principalmente en mejorar habilidades específicas de los agentes, como el razonamiento simbólico o el dominio de tareas específicas (ajedrez, Go, etc.). Estos estudios se centran más en el diseño de algoritmos y estrategias de entrenamiento, mientras ignoran el desarrollo de las capacidades generales inherentes del modelo, como la memoria de conocimientos, la planificación a largo plazo, la generalización efectiva y la interacción eficiente. Resulta que mejorar las capacidades inherentes del modelo es un factor clave para impulsar un mayor desarrollo de agentes inteligentes.

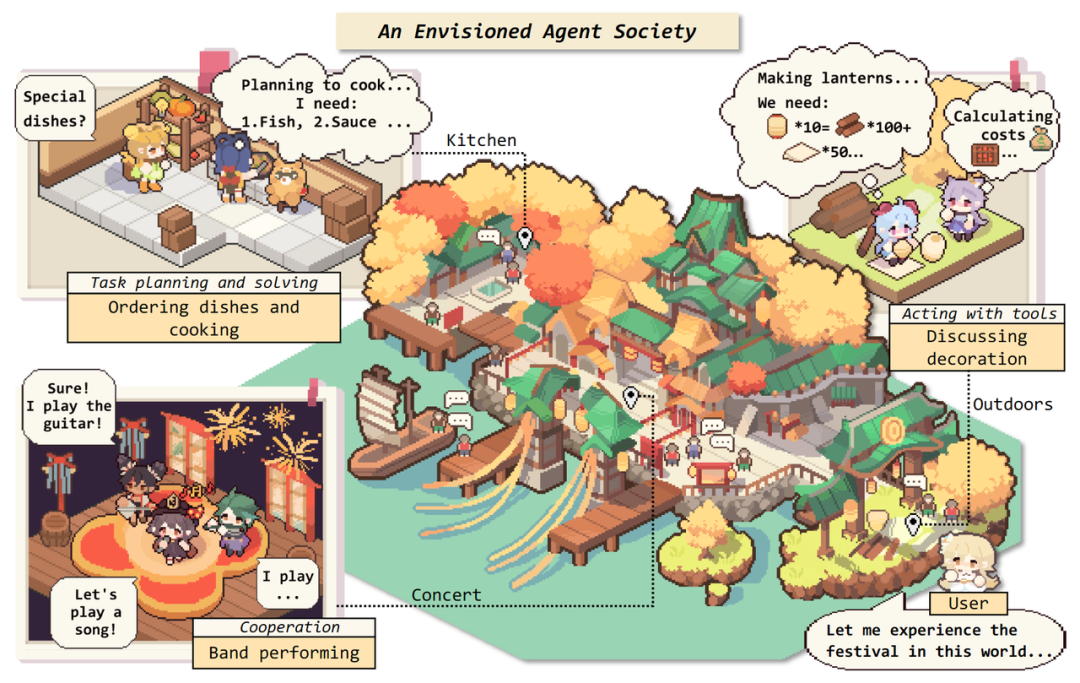

La aparición de grandes modelos de lenguaje (LLM) trae esperanzas para un mayor desarrollo de agentes inteligentes. Si la ruta de desarrollo de PNL a AGI se divide en cinco niveles: corpus, Internet, percepción, encarnación y atributos sociales, entonces el modelo de lenguaje a gran escala actual ha alcanzado el segundo nivel, con entrada y salida de texto a escala de Internet. Sobre esta base, si a los Agentes basados en LLM se les da espacio de percepción y espacio de acción, alcanzarán el tercer y cuarto nivel. Además, cuando múltiples agentes interactúan y cooperan para resolver tareas más complejas o reflejar comportamientos sociales en el mundo real, tienen el potencial de alcanzar el quinto nivel: la sociedad de agentes.

Los autores imaginan una sociedad armoniosa de agentes inteligentes en la que los humanos también puedan participar. La escena está tomada del Festival de los Faroles Marinos en “Genshin Impact”.

El nacimiento de un agente

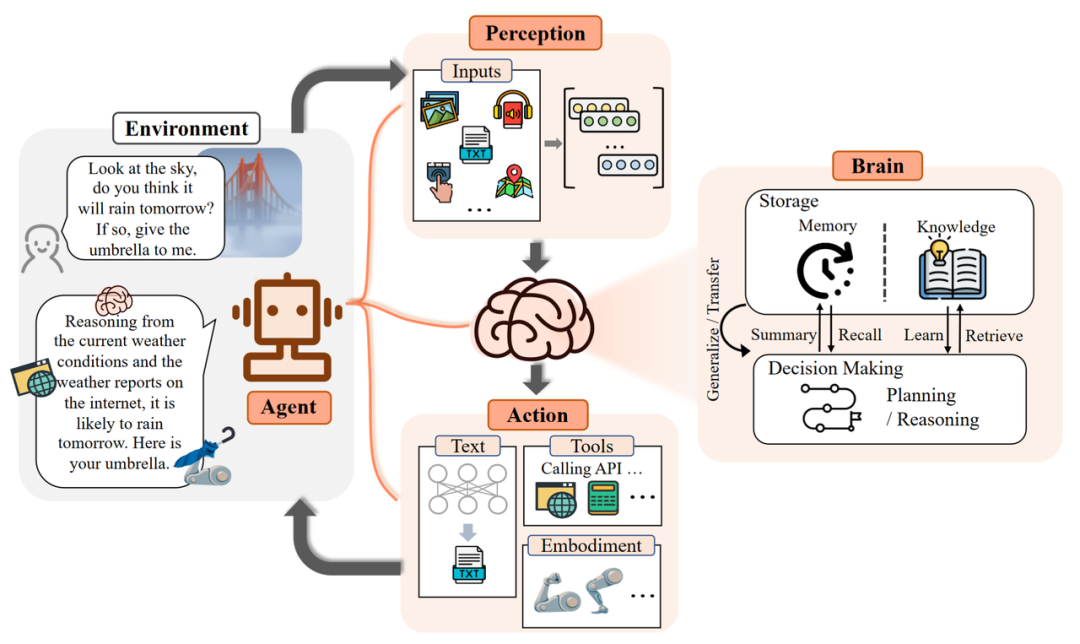

¿Cómo sería un agente inteligente apoyado en un modelo grande? Inspirándose en la ley de "supervivencia del más apto" de Darwin, los autores propusieron un marco general para agentes inteligentes basado en grandes modelos. Si una persona quiere sobrevivir en la sociedad, debe aprender a adaptarse al entorno, por lo que necesita tener capacidades cognitivas y ser capaz de percibir y responder a los cambios en el mundo exterior. De manera similar, el marco de los agentes inteligentes también consta de tres partes: extremo de control (Cerebro), extremo de percepción (Percepción) y extremo de acción (Acción).

Extremo de control : generalmente compuesto por LLM, es el núcleo del agente inteligente. No sólo puede almacenar memoria y conocimientos, sino que también desempeña funciones indispensables como el procesamiento de información y la toma de decisiones. Puede presentar el proceso de razonamiento y planificación y afrontar bien tareas desconocidas, lo que refleja la generalización y transferibilidad de los agentes inteligentes.

Fin de la percepción : ampliar el espacio de percepción del agente inteligente desde el texto puro para incluir campos multimodales como texto, visión y audición, para que el agente pueda obtener y utilizar información del entorno circundante de manera más efectiva.

Lado de acción : además de la salida de texto normal, el agente también tiene la capacidad de incorporar y utilizar herramientas, lo que le permite adaptarse mejor a los cambios ambientales, interactuar con el entorno a través de retroalimentación e incluso darle forma.

El marco conceptual del Agente basado en LLM consta de tres componentes: extremo de control (Cerebro), extremo de percepción (Percepción) y extremo de acción (Acción) .

Los autores utilizan un ejemplo para ilustrar el flujo de trabajo del Agente basado en LLM: cuando un humano pregunta si lloverá, el extremo de percepción (Percepción) convierte la instrucción en una representación que los LLM pueden entender. Luego, el terminal de control (Cerebro) comienza a razonar y planificar acciones basándose en el tiempo actual y las previsiones meteorológicas en Internet. Finalmente, la Acción responde y le entrega el paraguas al humano.

Al repetir el proceso anterior, el agente inteligente puede obtener retroalimentación continuamente e interactuar con el entorno.

Controlador: Cerebro

Como componente central del agente inteligente, los autores presentan sus capacidades desde cinco aspectos:

Interacción del lenguaje natural: el lenguaje es un medio de comunicación y contiene información rica. Gracias a las poderosas capacidades de generación y comprensión del lenguaje natural de los LLM, los agentes inteligentes pueden interactuar con el mundo exterior durante múltiples rondas a través del lenguaje natural para lograr sus objetivos. En concreto, se puede dividir en dos aspectos:

Generación de texto de alta calidad: amplios experimentos de evaluación muestran que los LLM pueden generar texto fluido, diverso, novedoso y controlable. Aunque el rendimiento en idiomas individuales es deficiente, en general se dispone de buenas habilidades multilingües.

Comprender la implicación: además del contenido expresado intuitivamente, el lenguaje también puede transmitir información como las intenciones y preferencias del hablante. La implicación es que ayuda a los agentes a comunicarse y cooperar de manera más eficiente, y los grandes modelos ya han demostrado el potencial en este sentido.

Conocimiento: los LLM capacitados en grandes lotes de corpus tienen la capacidad de almacenar cantidades masivas de conocimiento. Además del conocimiento del idioma, el conocimiento del sentido común y las habilidades profesionales son componentes importantes de los agentes basados en LLM.

Aunque los propios LLM todavía tienen problemas como conocimientos caducados y alucinaciones, algunas investigaciones existentes pueden aliviarlos hasta cierto punto mediante la edición de conocimientos o la llamada a bases de conocimientos externas.

Memoria: En el marco de este artículo, el módulo de memoria (Memoria) almacena las observaciones, pensamientos y secuencias de acción pasadas del agente. A través de mecanismos de memoria específicos, los agentes pueden reflexionar y aplicar eficazmente estrategias previas, lo que les permite aprovechar experiencias pasadas para adaptarse a entornos desconocidos.

Hay tres métodos comúnmente utilizados para mejorar la capacidad de la memoria:

Ampliar el límite de longitud de la arquitectura Backbone: mejorar el límite de longitud de secuencia inherente de Transformers.

Resumir: resumir recuerdos para mejorar la capacidad del agente para extraer detalles clave de la memoria.

Compresión: la eficiencia de recuperación de memoria se puede mejorar comprimiendo la memoria utilizando vectores o estructuras de datos apropiadas.

Además, el método de recuperación de la memoria también es importante: sólo recuperando el contenido adecuado el agente puede acceder a la información más relevante y precisa.

Razonamiento y planificación: la capacidad de razonamiento (razonamiento) es crucial para que los agentes inteligentes realicen tareas complejas como la toma de decisiones y el análisis. Específico de los LLM, se trata de una serie de métodos de orientación representados por la cadena de pensamiento (CoT). La planificación es una estrategia comúnmente utilizada cuando se enfrentan grandes desafíos. Ayuda a los agentes a organizar su pensamiento, establecer metas e identificar pasos para lograr esas metas. En una implementación específica, la planificación puede incluir dos pasos:

Formulación del plan: el agente divide las tareas complejas en subtareas más manejables. Por ejemplo: descomposición única y luego ejecución secuencial, planificación y ejecución paso a paso, planificación de múltiples rutas y selección de la ruta óptima, etc. En algunos escenarios que requieren conocimientos profesionales, los agentes se pueden integrar con módulos de Planner en campos específicos para mejorar las capacidades.

Plan de reflexión: Después de hacer un plan, puedes reflexionar sobre él y evaluar sus fortalezas y debilidades. Este tipo de reflexión generalmente proviene de tres aspectos: utilizar mecanismos de retroalimentación internos; obtener retroalimentación al interactuar con los humanos; obtener retroalimentación del entorno.

Transferibilidad y generalización: los LLM con conocimiento mundial dotan a los agentes inteligentes de poderosas capacidades de transferibilidad y generalización. Un buen agente no es una base de conocimientos estática, sino que también tiene capacidades de aprendizaje dinámicas:

Generalización a tareas desconocidas: a medida que aumentan el tamaño del modelo y los datos de entrenamiento, los LLM han desarrollado capacidades asombrosas para resolver tareas desconocidas. El modelo grande ajustado mediante instrucciones funcionó bien en la prueba de disparo cero, logrando resultados tan buenos como los modelos expertos en muchas tareas.

Aprendizaje en contexto: los modelos grandes no solo pueden aprender por analogía a partir de una pequeña cantidad de ejemplos en el contexto, sino que esta capacidad también se puede extender a escenas multimodales más allá del texto, brindando más oportunidades para que los agentes se utilicen en el mundo real. mundo posibilidad.

Aprendizaje continuo: el principal desafío del aprendizaje continuo es el olvido catastrófico, es decir, cuando el modelo aprende una nueva tarea, fácilmente pierde conocimientos de tareas pasadas. Los agentes inteligentes en dominios especializados deberían intentar evitar perder conocimientos en dominios generales.

Fin de la percepción: percepción

Los humanos perciben el mundo de forma multimodal, por lo que los investigadores tienen las mismas expectativas para los agentes basados en LLM. La percepción multimodal puede profundizar la comprensión del agente sobre el entorno laboral y mejorar significativamente su versatilidad.

Entrada de texto: como capacidad más básica de los LLM, no entraremos en detalles aquí.

Entrada visual: los propios LLM no tienen capacidades de percepción visual y solo pueden comprender contenido de texto discreto. Y la entrada visual suele contener mucha información sobre el mundo, incluidas las propiedades de los objetos, las relaciones espaciales, el diseño de la escena, etc. Los métodos comunes son:

Convierta la entrada visual en la descripción de texto correspondiente (subtítulos de imágenes): los LLM pueden entenderla directamente y tiene una alta interpretabilidad.

Codificación y representación de información visual: el módulo de percepción se compone del paradigma del modelo visual básico + LLM, y el modelo puede comprender el contenido de diferentes modalidades a través de operaciones de alineación, que se pueden entrenar de un extremo a otro.

Información auditiva: la audición también es una parte importante de la percepción humana. Dado que los LLM tienen excelentes capacidades de llamada de herramientas, una idea intuitiva es que el agente puede utilizar los LLM como un centro de control, llamando a conjuntos de herramientas existentes o modelos expertos en cascada para percibir información de audio. Además, el audio también se puede representar visualmente mediante un espectrograma. Los espectrogramas se pueden utilizar como imágenes planas para mostrar información 2D, por lo que algunos métodos de procesamiento visual se pueden transferir al campo del habla.

Otras aportaciones: hay mucho más en el mundo real que el texto, la vista y el oído. Los autores esperan que en el futuro los agentes inteligentes estén equipados con módulos de percepción más ricos, como el tacto, el olfato y otros órganos, para obtener atributos más ricos de los objetos objetivo. Al mismo tiempo, los agentes también pueden sentir claramente la temperatura, la humedad y el brillo del entorno y tomar medidas más conscientes del medio ambiente.

Además, el agente también puede conocer la percepción del entorno general más amplio: utilizando módulos de percepción maduros como lidar, GPS y unidades de medición inercial.

Acción: Acción

Después de que el cerebro realiza análisis y decisiones, el agente también necesita tomar medidas para adaptarse o cambiar el entorno:

Salida de texto: como la capacidad más básica de los LLM, no entraremos en detalles aquí.

Uso de herramientas: aunque los LLM tienen excelentes reservas de conocimiento y capacidades profesionales, cuando se enfrentan a problemas específicos, pueden surgir una serie de desafíos, como problemas de robustez y alucinaciones. Al mismo tiempo, las herramientas, como una extensión de las capacidades del usuario, pueden brindar ayuda en aspectos como el profesionalismo, la factibilidad y la interpretabilidad. Por ejemplo, puedes utilizar una calculadora para resolver problemas matemáticos y un motor de búsqueda para buscar información en tiempo real.

Además, las herramientas también pueden ampliar el espacio de acción de los agentes inteligentes. Por ejemplo, se pueden obtener acciones multimodales llamando a modelos expertos como la generación de voz y la generación de imágenes. Por lo tanto, cómo hacer que los agentes se conviertan en excelentes usuarios de herramientas, es decir, aprender a utilizar las herramientas de forma eficaz, es una dirección muy importante y prometedora.

Actualmente, los principales métodos de aprendizaje de herramientas incluyen aprender a partir de demostraciones y aprender a partir de comentarios. Además, el metaaprendizaje, el aprendizaje de cursos, etc. también se pueden utilizar para proporcionar a los agentes capacidades de generalización en el uso de diversas herramientas. Yendo un paso más allá, los agentes inteligentes pueden aprender cómo fabricar herramientas de forma "autosuficiente", aumentando así su autonomía e independencia.

Acción encarnada: La encarnación se refiere a la capacidad de un agente de comprender, transformar el entorno y actualizar su propio estado durante la interacción con el entorno. Embodied Action se considera el puente entre la inteligencia virtual y la realidad física.

Los agentes tradicionales basados en el aprendizaje por refuerzo tienen limitaciones en la eficiencia de las muestras, la generalización y el razonamiento de problemas complejos, mientras que los agentes basados en LLM introducen un rico conocimiento intrínseco de modelos grandes, lo que permite a los agentes incorporados percibir e influir activamente en la física como el entorno humano. Dependiendo del grado de autonomía del agente en la tarea o de la complejidad de la Acción, pueden existir las siguientes Acciones atómicas:

La observación puede ayudar a agentes inteligentes a localizarse en el entorno, percibir objetos y elementos y obtener otra información ambiental;

La manipulación consiste en completar algunas tareas operativas específicas de agarrar, empujar y otras;

La navegación requiere que el agente inteligente cambie su posición según el objetivo de la tarea y actualice su estado según la información ambiental.

Al combinar estas acciones atómicas, los agentes pueden completar tareas más complejas. Por ejemplo, incorporaba tareas de control de calidad como "¿La sandía de la cocina es más grande que el cuenco?" Para resolver este problema, el agente debe navegar hasta la cocina y obtener la respuesta después de observar el tamaño de ambos.

Limitada por el alto costo del hardware del mundo físico y la falta de conjuntos de datos incorporados, la investigación actual sobre acciones incorporadas todavía se centra principalmente en entornos sandbox virtuales como la plataforma de juegos "Minecraft". Por lo tanto, por un lado, los autores esperan un paradigma de tareas y un estándar de evaluación más cercano a la realidad y, por otro, también necesitan explorar más la construcción eficiente de conjuntos de datos relevantes.

Agente en la práctica: diversos escenarios de aplicación

Actualmente, los agentes basados en LLM han demostrado una diversidad impresionante y un desempeño poderoso. Ejemplos de aplicaciones familiares como AutoGPT, MetaGPT, CAMEL y GPT Engineer están prosperando a una velocidad sin precedentes.

Antes de presentar aplicaciones específicas, los autores analizan los principios de diseño de Agent in Practice:

1. Ayudar a los usuarios a liberarse de las tareas diarias y del trabajo repetitivo, reducir la presión del trabajo humano y mejorar la eficiencia en la resolución de tareas;

2. Los usuarios ya no necesitan dar instrucciones explícitas de bajo nivel y pueden analizar, planificar y resolver problemas de forma completamente independiente;

3. Después de liberar las manos del usuario, intente liberar el cerebro: aproveche al máximo su potencial en campos científicos de vanguardia y complete un trabajo innovador y exploratorio.

Sobre esta base, la aplicación de agentes puede tener tres paradigmas:

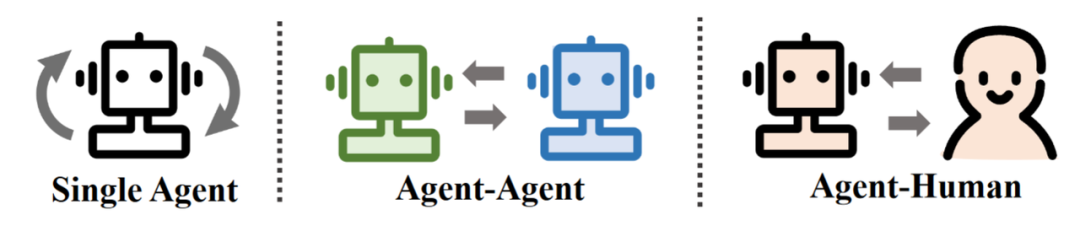

Tres paradigmas de aplicación del agente basado en LLM: agente único, agente múltiple e interacción persona-computadora.

Escenario de agente único

Actualmente, los usuarios prefieren los agentes inteligentes que pueden aceptar comandos del lenguaje natural humano y realizar tareas diarias y tienen un alto valor práctico. Los autores primero detallaron sus diversos escenarios de aplicación y las capacidades correspondientes en el escenario de aplicación de un único agente inteligente.

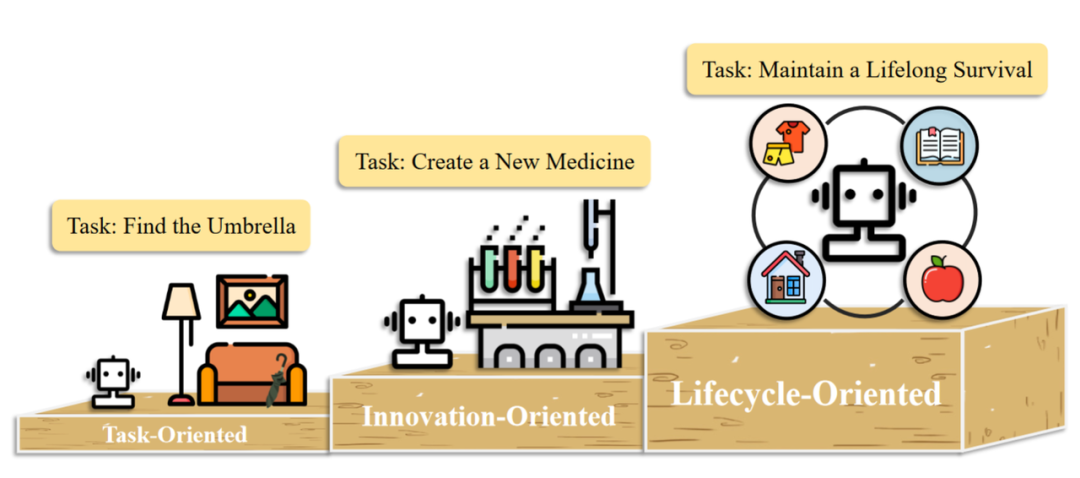

En este artículo, la aplicación de un único agente inteligente se divide en los siguientes tres niveles:

Hay tres niveles de escenarios de aplicaciones de un solo agente: orientado a tareas, orientado a la innovación y orientado al ciclo de vida.

En implementaciones orientadas a tareas , los agentes ayudan a los usuarios humanos con las tareas diarias básicas. Deben tener una comprensión básica de los comandos, la descomposición de tareas y la capacidad de interactuar con el entorno. Específicamente, según los tipos de tareas existentes, la aplicación real de los agentes se puede dividir en entornos de red simulados y escenarios de vida simulados.

En implementaciones orientadas a la innovación , los agentes pueden demostrar el potencial de la investigación autónoma en campos científicos de vanguardia. Aunque la complejidad inherente y la falta de datos de entrenamiento en campos especializados dificultan la construcción de agentes inteligentes, ya hay mucho trabajo avanzando en campos como la química, los materiales, la informática, etc.

En la implementación orientada al ciclo de vida , los agentes tienen la capacidad de explorar, aprender y utilizar nuevas habilidades continuamente en un mundo abierto y sobrevivir durante mucho tiempo. En esta sección, los autores toman como ejemplo el juego "Minecraft". Dado que el desafío de supervivencia del juego puede considerarse un microcosmos del mundo real, muchos investigadores lo han utilizado como una plataforma única para desarrollar y probar las capacidades integrales de los agentes.

Escenario multiagente

Ya en 1986, Marvin Minsky hizo una predicción prospectiva. En The Society of Mind, propuso una nueva teoría de la inteligencia, argumentando que la inteligencia surge de la interacción de muchos agentes más pequeños con funciones específicas. Por ejemplo, algunos agentes pueden ser responsables de identificar patrones, mientras que otros pueden ser responsables de tomar decisiones o generar soluciones.

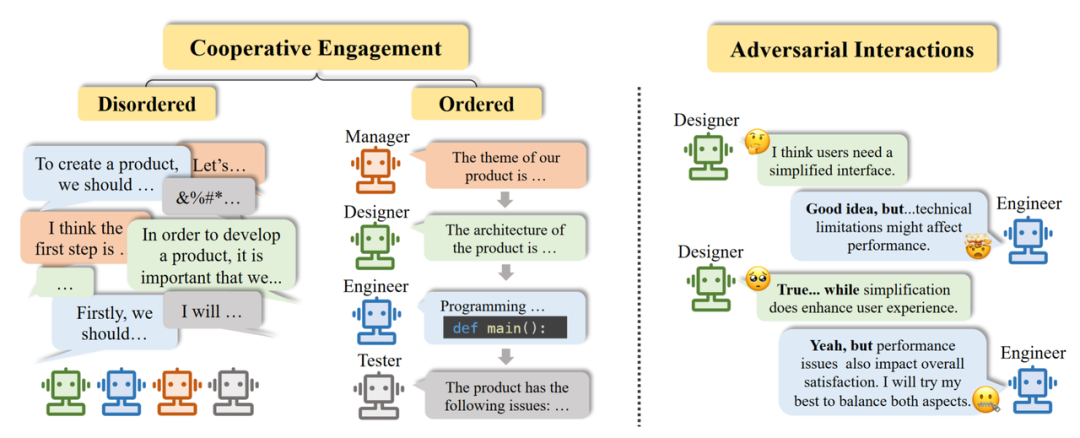

Esta idea se ha implementado concretamente con el auge de la inteligencia artificial distribuida. El sistema multiagente, como uno de los principales temas de investigación, se centra principalmente en cómo los agentes pueden coordinarse y colaborar eficazmente para resolver problemas. El autor de este artículo divide la interacción entre múltiples agentes en las dos formas siguientes:

Hay dos formas de interacción en escenarios de aplicaciones de múltiples agentes: interacción cooperativa e interacción confrontativa.

Interacción cooperativa: como el tipo más utilizado en aplicaciones prácticas, los sistemas de agentes cooperativos pueden mejorar eficazmente la eficiencia de las tareas y mejorar conjuntamente la toma de decisiones. En concreto, según las diferentes formas de cooperación, los autores subdividen las interacciones cooperativas en cooperación desordenada y cooperación ordenada.

Cuando todos los agentes expresan libremente sus puntos de vista y opiniones y cooperan de manera no secuencial, se llama cooperación desordenada.

Cuando todos los agentes siguen ciertas reglas, como expresar sus opiniones una por una en forma de línea de montaje, todo el proceso de cooperación es ordenado, lo que se denomina cooperación ordenada.

Interacción adversaria: los agentes inteligentes interactúan en forma de ojo por ojo. A través de la competencia, la negociación y el debate, los agentes abandonan sus creencias originales posiblemente erróneas y llevan a cabo reflexiones significativas sobre su propio comportamiento o proceso de razonamiento, lo que en última instancia conduce a una mejora en la calidad de la respuesta de todo el sistema.

Escenario de interacción persona-computadora

La interacción humano-agente, como su nombre indica, es un agente inteligente que coopera con los humanos para completar tareas. Por un lado, la capacidad de aprendizaje dinámico del agente debe estar respaldada por la comunicación; por otro lado, el sistema de agentes actual aún no tiene suficiente interpretabilidad y puede tener problemas de seguridad, legalidad, etc., por lo que requiere participación humana. y supervisión.

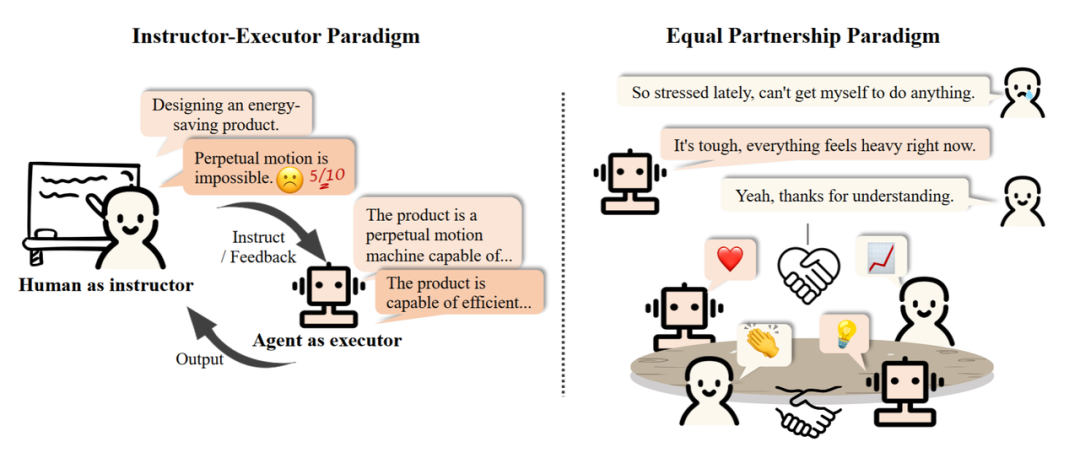

En el artículo, los autores dividen la interacción humano-agente en los dos modos siguientes:

Dos modos en escenarios de interacción persona-computadora: modo Instructor-Ejecutor versus modo Asociación Igualitaria.

Modelo instructor-ejecutor : los humanos actúan como instructores, dando instrucciones y retroalimentación; los agentes actúan como ejecutores, ajustándose y optimizando gradualmente según las instrucciones. Este modelo ha sido ampliamente utilizado en la educación, la medicina, los negocios y otros campos.

Modelo de Asociación Igualitaria: Algunos estudios han observado que los agentes pueden mostrar empatía en la comunicación con los humanos o participar en la ejecución de tareas como iguales. Los agentes inteligentes muestran potencial de aplicación en la vida diaria y se espera que se integren en la sociedad humana en el futuro.

Sociedad de agentes: de la personalidad a la socialidad

Durante mucho tiempo, los investigadores han soñado con construir una "sociedad artificial interactiva". Desde el juego sandbox "Los Sims" hasta el "Metaverso", la definición popular de sociedad simulada se puede resumir en: entorno + individuos que viven e interactúan en el medio ambiente.

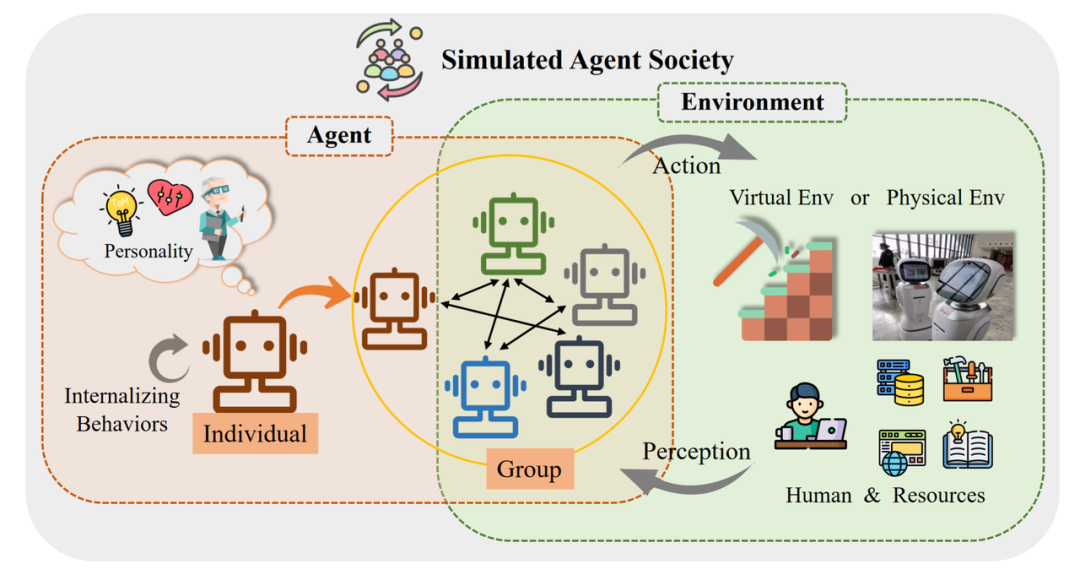

En el artículo, los autores utilizan un diagrama para describir el marco conceptual de la sociedad de agentes:

Un marco conceptual para la sociedad agente, dividido en dos partes clave: agencia y entorno.

En este marco podemos ver:

Parte izquierda: a nivel individual, los agentes exhiben una variedad de comportamientos internalizados como planificación, razonamiento y reflexión. Además, los agentes exhiben rasgos de personalidad intrínsecos que abarcan dimensiones cognitivas, emocionales y de personalidad.

Parte media: un solo agente puede formar un grupo con otros agentes individuales para exhibir conjuntamente comportamientos grupales como la cooperación, como la cooperación colaborativa.

Parte derecha: el entorno puede tener la forma de un entorno de pruebas virtual o de un mundo físico real. Los elementos del entorno incluyen actores humanos y diversos recursos disponibles. Para un solo agente, otros agentes también forman parte del entorno.

Interacción general: los agentes participan activamente en todo el proceso de interacción al sentir el entorno externo y tomar acciones.

Comportamiento social y personalidad del agente

El artículo examina el desempeño de los agentes en la sociedad desde la perspectiva del comportamiento externo y la personalidad interna:

Comportamiento social: Desde una perspectiva social, el comportamiento se puede dividir en dos niveles: individual y colectivo:

El comportamiento individual constituye la base para el funcionamiento y desarrollo del propio agente. Incluye los insumos representados por la percepción, los resultados representados por la acción y el comportamiento internalizado del propio agente.

El comportamiento de multitud se refiere al comportamiento que se produce cuando dos o más agentes interactúan de forma espontánea. Incluye comportamientos positivos representados por la colaboración, comportamientos negativos representados por el conflicto y comportamientos neutrales como seguir al rebaño y observar.

Personalidad: incluye cognición, emoción y personalidad. Así como los humanos desarrollan gradualmente sus propios rasgos a través del proceso de socialización, los agentes también exhiben la llamada "inteligencia similar a la humana", que es la formación gradual de la personalidad a través de la interacción con grupos y entornos.

Habilidades cognitivas: cubre el proceso mediante el cual los agentes adquieren y comprenden conocimientos. Las investigaciones muestran que los agentes basados en LLM pueden exhibir deliberación e inteligencia similares a las de los humanos en algunos aspectos.

Inteligencia emocional: involucra sentimientos subjetivos y estados emocionales, como alegría, enojo, tristeza y alegría, así como la capacidad de mostrar simpatía y empatía.

Personalidad (representación del personaje): para comprender y analizar las características de personalidad de los LLM, los investigadores han utilizado métodos de evaluación maduros, como las pruebas de personalidad de los Cinco Grandes y MBTI, para explorar la diversidad y complejidad de la personalidad.

Simular el entorno operativo de la sociedad.

La sociedad agente no sólo está compuesta por individuos independientes, sino que también incluye el entorno con el que interactúan. El entorno influye en cómo los agentes perciben, actúan e interactúan. A su vez, los agentes también cambian el estado del medio ambiente a través de sus acciones y decisiones. Para un agente individual, el entorno incluye otros agentes autónomos, humanos y recursos disponibles.

Aquí, los autores exploran tres tipos de entornos:

Entornos basados en texto: dado que los LLM se basan principalmente en el lenguaje como formato de entrada y salida, los entornos basados en texto son la plataforma operativa más natural para los agentes. Los fenómenos y las interacciones sociales se describen a través de palabras, y el entorno textual proporciona conocimiento semántico y previo. Los agentes existen en esos mundos textuales y dependen de recursos textuales para percibir, razonar y actuar.

Entorno de zona de pruebas virtual: en el campo de la informática, una zona de pruebas se refiere a un entorno controlado y aislado, que a menudo se utiliza para pruebas de software y análisis de virus. El entorno virtual sandbox de la sociedad de agentes sirve como plataforma para simular la interacción social y la simulación de comportamiento. Sus principales características incluyen:

Visualización: puede utilizar interfaces gráficas 2D simples hasta modelados 3D complejos para mostrar el mundo, representando todos los aspectos de la sociedad simulada de una manera intuitiva.

Escalabilidad: se pueden construir e implementar varios escenarios diferentes (Web, juegos, etc.) para realizar diversos experimentos, proporcionando un amplio espacio para que los agentes exploren.

Entorno físico real: Un entorno físico es un entorno tangible que consta de objetos y espacios reales en los que los agentes observan y actúan. Este entorno introduce una rica información sensorial (visual, auditiva y espacial). A diferencia de los entornos virtuales, los espacios físicos imponen más exigencias al comportamiento de los agentes. Es decir, el agente debe ser adaptable al entorno físico y generar control de movimiento ejecutable.

El autor pone un ejemplo para explicar la complejidad del entorno físico: imaginemos un agente inteligente operando un brazo robótico en una fábrica. Al operar el brazo robótico se requiere un control preciso de la fuerza para evitar dañar objetos de diferentes materiales; además, el El agente debe estar en el espacio de trabajo físico. Navegue en el medio y ajuste la ruta de movimiento a tiempo para evitar obstáculos y optimizar la trayectoria de movimiento del brazo robótico.

Estos requisitos aumentan la complejidad y el desafío de los agentes en el entorno físico.

Simulación, ¡empieza!

En el artículo, los autores creen que una sociedad simulada debe ser abierta, persistente, situacional y organizada. La apertura permite a los agentes entrar y salir de la sociedad simulada de forma autónoma; la persistencia significa que la sociedad tiene una trayectoria coherente que se desarrolla a lo largo del tiempo; la contextualidad enfatiza la existencia y operación de los sujetos en un entorno específico; la organización asegura que la sociedad simulada tenga un mundo físico. como reglas y restricciones.

En cuanto a la importancia de la sociedad simulada, la ciudad de Agentes Generativos de la Universidad de Stanford ofrece un claro ejemplo para todos: la sociedad de agentes se puede utilizar para explorar las capacidades de la inteligencia grupal; por ejemplo, los agentes organizaron conjuntamente una fiesta de San Valentín; también se puede utilizar Acelerar la investigación en ciencias sociales, como la observación de fenómenos de comunicación mediante la simulación de redes sociales. Además, también existen estudios para explorar los valores detrás de los agentes simulando escenarios de toma de decisiones éticas, y para ayudar a la toma de decisiones simulando el impacto de las políticas en la sociedad.

Además, el autor señaló que estas simulaciones también pueden tener ciertos riesgos, que incluyen, entre otros: fenómenos sociales dañinos; estereotipos y prejuicios; problemas de privacidad y seguridad; dependencia excesiva y adicción.

Preguntas abiertas con visión de futuro

Al final del artículo, el autor también analiza algunas preguntas abiertas con visión de futuro y brinda algo de inspiración para que los lectores piensen en:

¿Cómo pueden la investigación sobre agentes inteligentes y grandes modelos lingüísticos promoverse mutuamente y desarrollarse juntos? Los modelos grandes han demostrado un gran potencial en la comprensión del lenguaje, la toma de decisiones y las capacidades de generalización, y se han convertido en un papel clave en el proceso de construcción de agentes. El progreso de los agentes también ha planteado mayores requisitos para los modelos grandes.

¿Qué desafíos e inquietudes traerán los agentes basados en LLM? Para que los agentes inteligentes puedan realmente ponerse en práctica se requiere una evaluación de seguridad rigurosa para evitar daños al mundo real. El autor resume más amenazas potenciales, tales como: abuso ilegal, riesgo de desempleo, impacto en el bienestar humano, etc.

¿Qué oportunidades y desafíos traerá la ampliación de escala? En una sociedad simulada, aumentar el número de individuos puede mejorar significativamente la credibilidad y autenticidad de la simulación. Sin embargo, a medida que aumenta el número de agentes, los problemas de comunicación y difusión de mensajes se volverán bastante complejos, y la distorsión de la información, los malentendidos o las alucinaciones reducirán significativamente la eficiencia de todo el sistema de simulación.

Existe un debate en Internet sobre si el Agente basado en LLM es el camino apropiado hacia AGI. Algunos investigadores creen que los grandes modelos representados por GPT-4 han sido entrenados con suficiente corpus, y los agentes construidos sobre esta base tienen el potencial de convertirse en la clave para abrir la puerta a AGI. Pero otros investigadores creen que los modelos de lenguaje autorregresivos no muestran una inteligencia real porque solo responden. Un método de modelado más completo, como el World Model, puede conducir a AGI.

La evolución de la inteligencia de enjambre. La inteligencia de enjambre es un proceso de recopilar las opiniones de muchas personas y convertirlas en decisiones. Sin embargo, ¿se producirá verdadera "inteligencia" simplemente aumentando el número de agentes? Además, ¿cómo coordinar a los agentes individuales para permitir que una sociedad de agentes inteligentes supere el "pensamiento de grupo" y los sesgos cognitivos personales?

Agente como servicio (AaaS). Dado que los agentes basados en LLM son más complejos que el modelo grande en sí y son más difíciles de construir localmente para pequeñas y medianas empresas o individuos, los proveedores de la nube pueden considerar implementar agentes inteligentes en forma de servicios, es decir, agentes como -un servicio. Al igual que otros servicios en la nube, AaaS tiene el potencial de brindar a los usuarios una alta flexibilidad y autoservicio bajo demanda.

Ingrese al grupo de PNL—> Únase al grupo de intercambio de PNL