Instrucciones:

1. Versión de Hadoop: 3.1.3

2. Herramienta de lectura: IDEA 2023.1.2

3. Adquisición del código fuente: Índice de /dist/hadoop/core/hadoop-3.1.3 (apache.org)

4. Importación del proyecto: Descargar Código fuente Después de eso, obtenga el paquete comprimido, abra PowerShell en el directorio actual, use el comando para descomprimirlo y luego use IDEA para abrir la carpeta. Tenga cuidado al configurar el almacén de Maven o Gradle, de lo contrario la importación del paquete jar será lenta. 5. Curso de referencia: www.bilibili.com / video /BV1Qp…hadoop-3.1.3-src.tar.gztar -zxvfhadoop-3.1.3-src

Carga HDFS

Un código de carga simple:

public void test() throws IOException {

FSDataOutputStream fos = fs.create(new Path("/input"));

fos.write("hello world".getBytes());

}Como puede ver, primero se crea uno

FSDataOutputStreamy luego se escriben los datos en él; luego se divide en el proceso de creación y el proceso de carga de escritura para la lectura y análisis del código fuente.

crearProceso de creación

1. El cliente envía una solicitud de creación a NN.

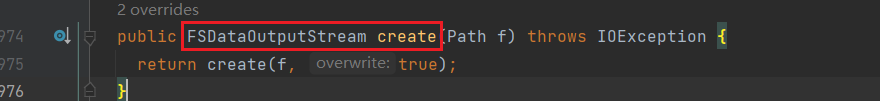

Primero ingrese createel método y vaya a FileSystem.java:

Busque el método de creación y continúe ingresando hasta encontrar el método estático create:

Volvamos a la llamada a ese método estático:

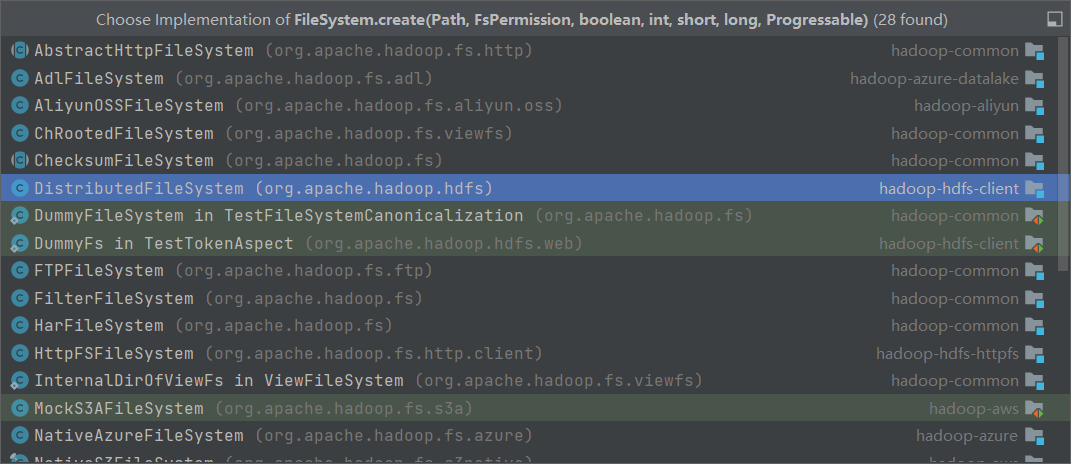

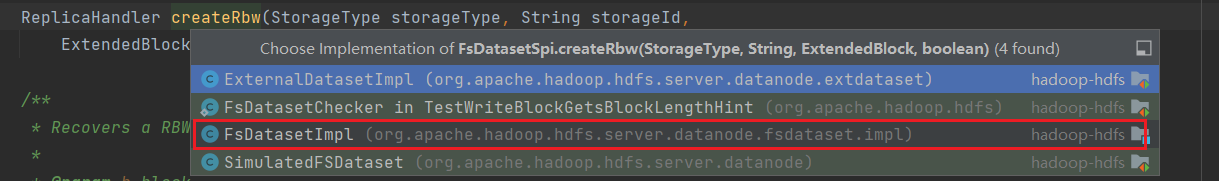

Ctrl+Alt+B encuentra la clase de implementación de este método estático:

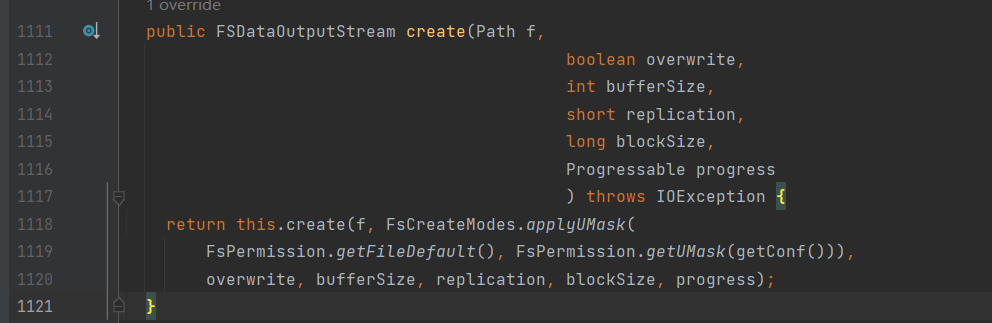

Entrando DistributedFileSystem:

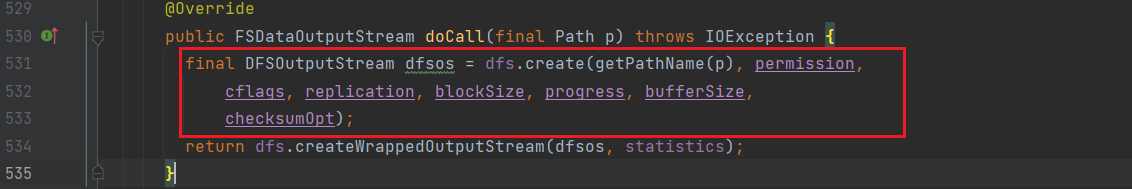

Continúe mirando hacia abajo:

Puede ver que doCallse crea un objeto de flujo de salida en el método;

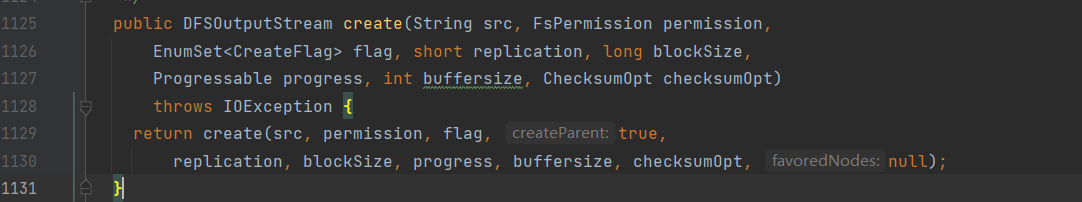

Continúe ingresando createel método y acceda a DFSClient.java:

Sigue buscando hacia abajo para encontrar newStreamForCreateel método:

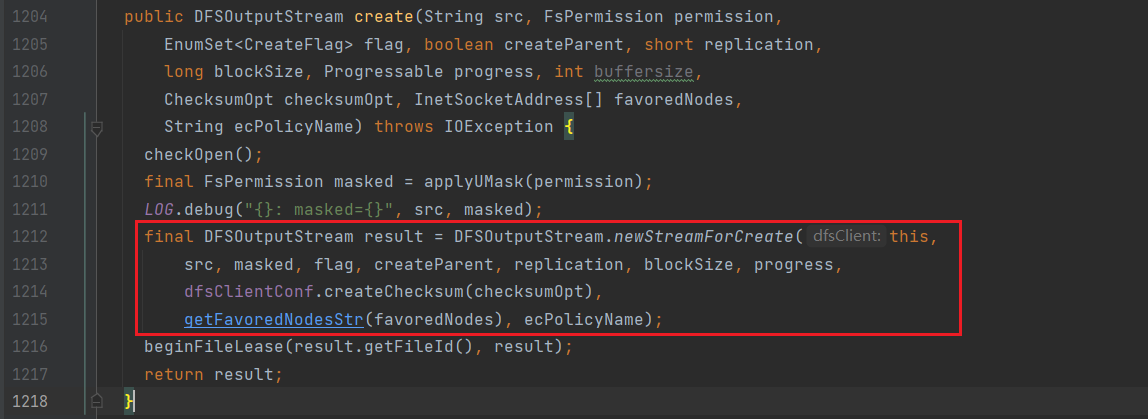

Ingrese newStreamForCreateel método y vaya a DFSOutputStream.java

Aquí el cliente envía la solicitud de creación a NN para su procesamiento a través de comunicación RPC.

Iniciar hilo

2.NN maneja la solicitud de creación del cliente.

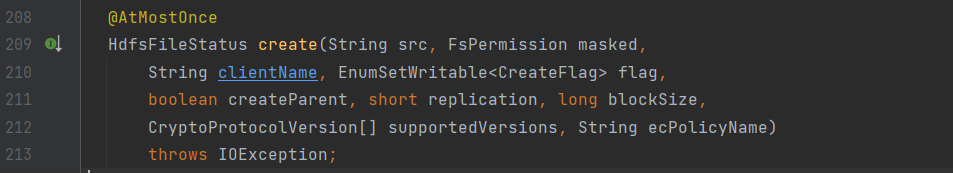

newStreamForCreateIngrese el método de creación en el método y acceda a ClientProtocol.java:

Encuentre su clase de implementación:

Ingrese NameNodeRpcServer createde la siguiente manera:

@Override // ClientProtocol

public HdfsFileStatus create(String src, FsPermission masked,

String clientName, EnumSetWritable<CreateFlag> flag,

boolean createParent, short replication, long blockSize,

CryptoProtocolVersion[] supportedVersions, String ecPolicyName)

throws IOException {

checkNNStartup(); //检查NN是否启动

String clientMachine = getClientMachine();

if (stateChangeLog.isDebugEnabled()) {

stateChangeLog.debug("*DIR* NameNode.create: file "

+src+" for "+clientName+" at "+clientMachine);

}

if (!checkPathLength(src)) { //检查路径长度

throw new IOException("create: Pathname too long. Limit "

+ MAX_PATH_LENGTH + " characters, " + MAX_PATH_DEPTH + " levels.");

}

namesystem.checkOperation(OperationCategory.WRITE);

CacheEntryWithPayload cacheEntry = RetryCache.waitForCompletion(retryCache, null);

if (cacheEntry != null && cacheEntry.isSuccess()) { //缓存相关检查

return (HdfsFileStatus) cacheEntry.getPayload();

}

HdfsFileStatus status = null;

try {

PermissionStatus perm = new PermissionStatus(getRemoteUser()

.getShortUserName(), null, masked);

//开启文件(重要)

status = namesystem.startFile(src, perm, clientName, clientMachine,

flag.get(), createParent, replication, blockSize, supportedVersions,

ecPolicyName, cacheEntry != null);

} finally {

RetryCache.setState(cacheEntry, status != null, status);

}

metrics.incrFilesCreated();

metrics.incrCreateFileOps();

return status;

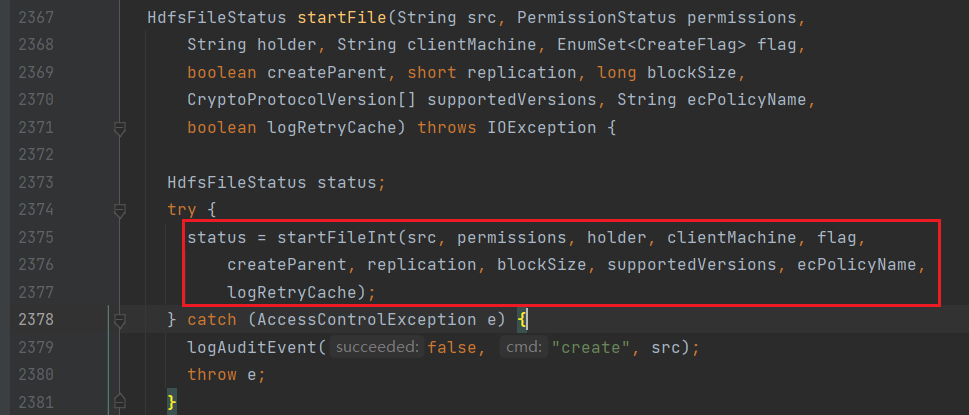

}Luego ingrese startFileel método y vaya a FSNamesystem.java:

Ingrese startFileInt:

Encapsule src (ruta del archivo) en INodesInPath;

Explicación de la clase INodesInPath: Contiene información de INodes resuelta a partir de una ruta determinada.

Primero necesitamos aclarar el concepto de clase INodes:

INodes es una clase abstracta y su explicación oficial es la siguiente:

En términos simples, una clase INode básica es una representación en memoria de una jerarquía de archivos/bloques, que contiene campos comunes para inodos de archivos y directorios.

Puede ver que INodes es la clase más baja y guarda algunos atributos comunes a archivos y directorios, mientras que la clase INodesInPath guarda la información de INode analizada desde una ruta determinada;

Siguiente ubicar startFile:

IngresarstartFile

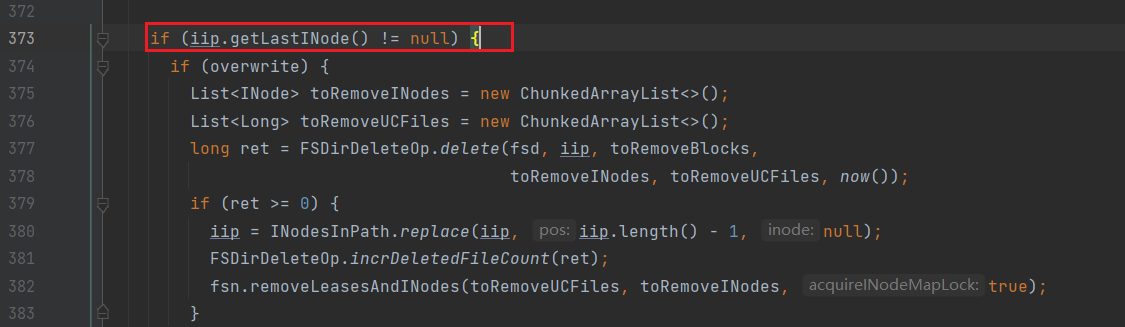

- Primero verifique si la ruta del archivo existe:

Ingrese getLastINode:

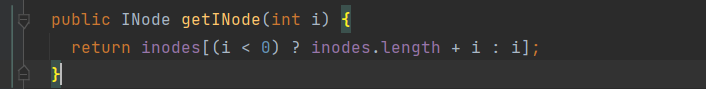

Ingrese getINode:

Se puede ver que cuando i = -1,return inodes[inodes.length-1];

En otras palabras, obtenga el inodo en la última posición, si hay uno, significa que la ruta del archivo ya existe;

A continuación, determine si se permite la sobrescritura:

Si no se permite la sobrescritura, se generará una excepción para informar que la ruta del archivo ya existe y no se permite la carga repetida de archivos;

- Luego determine si el directorio principal existe:

Si el directorio principal existe, agréguele información de metadatos del archivo ( addFilemétodo)

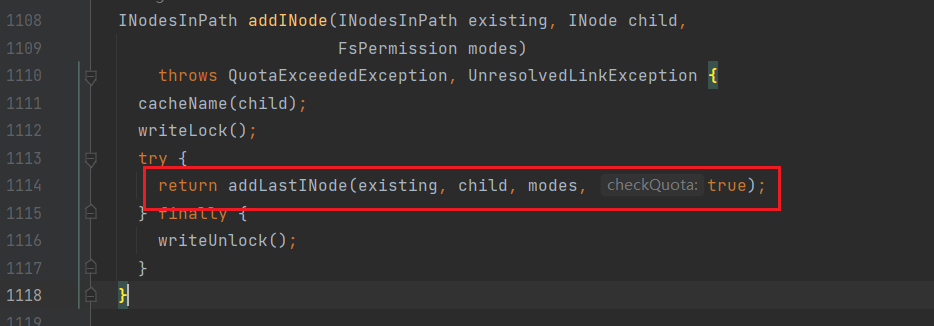

Método de entrada addFile:

Ingrese addINode:

Escriba los datos en el árbol de directorios de INode; ahora se crea el directorio de archivos.

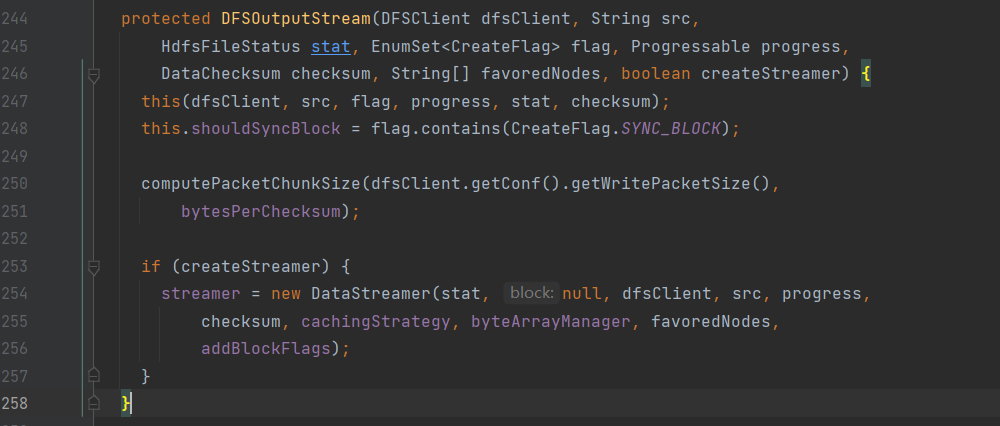

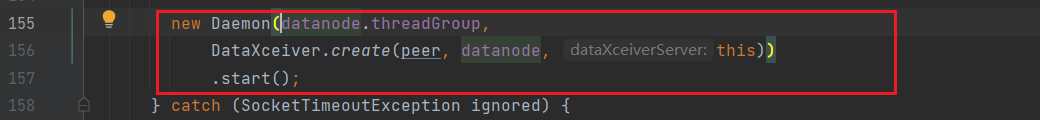

3.Proceso de inicio de DataStreamer

Una vez completado el procesamiento de NN, regrese al cliente nuevamente e inicie el hilo correspondiente;

Abra DFSOutputStream.java y busque newStreamForCreateel método. Después de que NN complete la solicitud de creación, cree el flujo de salida:

Objetivo DFSOutputStream:

Calcular el tamaño del fragmento (Directorio => Archivo => Bloque (128M) => paquete (64K) => fragmento (fragmento 512 bytes + suma de fragmentos 4 bytes))

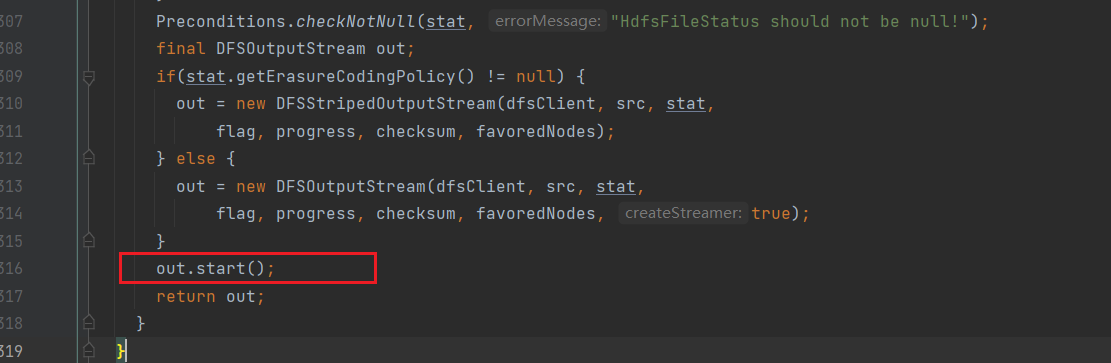

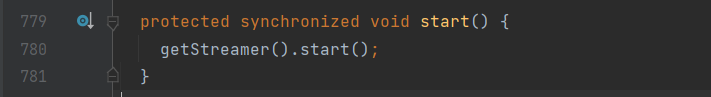

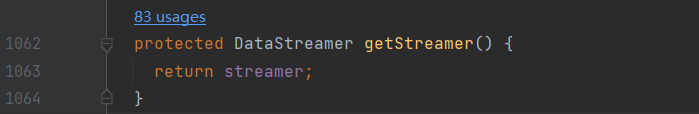

Regrese al newStreamForCreatemétodo e ingreseout.start()

Continúe ingresando:

Continúe ingresando DataStreamer:

Ingrese Daemon:

Como puede ver, el método out.start inicia un hilo, así que regrese al DataStreamer y busque el método de ejecución:

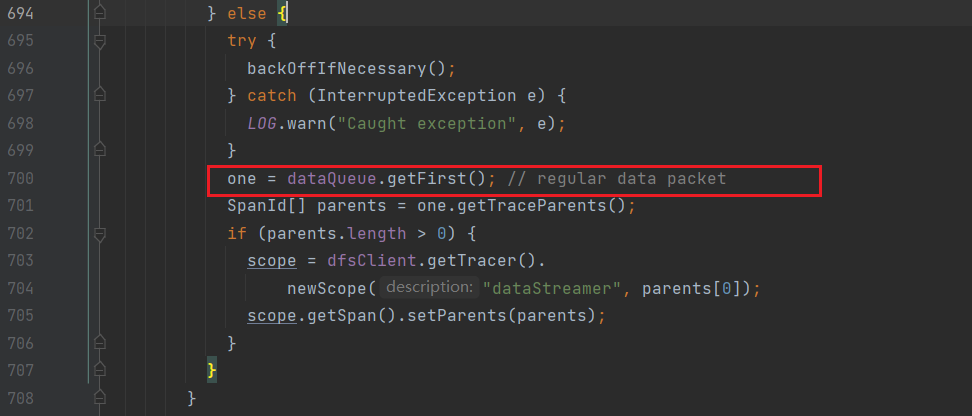

Si no hay datos en dataQueue, el código se bloqueará;

Si la cola de datos no está vacía, retire el paquete.

escribir proceso de carga

1. Escriba datos en la cola de DataStreamer.

El DataStreamer se inicia en la fase de creación y los datos se escriben en él en la fase de escritura;

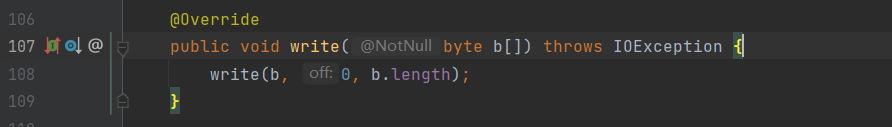

Ingrese el método de escritura y vaya a FilterOutputStream.java:

Continúe hasta llegar al método abstracto write:

![]()

Ctrl+alt+B para encontrar su clase de implementación:

Ingrese FSOutputSummer.java y localice el método de escritura:

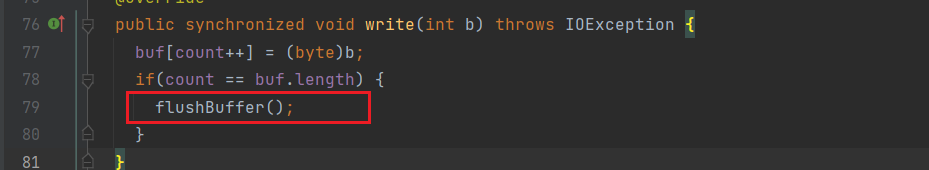

El flushBuffermétodo de entrada, como sugiere el nombre, es vaciar el búfer:

Método de entrada writeChecksumChunks:

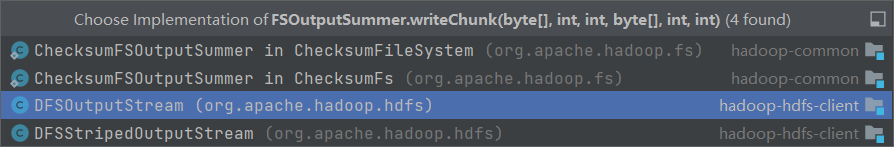

Método de entrada writeChunk(escribir fragmento en la cola de datos):

es un método abstracto, así que encuentre su clase de implementación:

Ingrese DFSOutputStream.java para ver writeChunkla lógica de implementación específica del método, de la siguiente manera:

@Override

protected synchronized void writeChunk(byte[] b, int offset, int len,

byte[] checksum, int ckoff, int cklen) throws IOException {

writeChunkPrepare(len, ckoff, cklen);

currentPacket.writeChecksum(checksum, ckoff, cklen); //往packet里面写chunk的校验和 4byte

currentPacket.writeData(b, offset, len); // 往packet里面写一个chunk 512byte

// 记录写入packet中的chunk个数,累计到127个chuck,这个packet就满了

currentPacket.incNumChunks();

getStreamer().incBytesCurBlock(len);

//如果packet已经满了,则将其放入队列等待传输

if (currentPacket.getNumChunks() == currentPacket.getMaxChunks() ||

getStreamer().getBytesCurBlock() == blockSize) {

enqueueCurrentPacketFull();

}

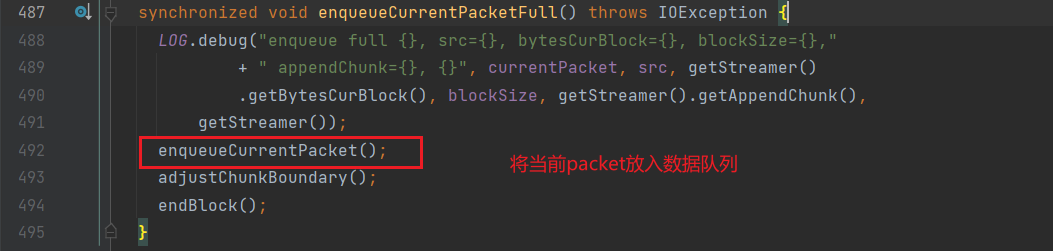

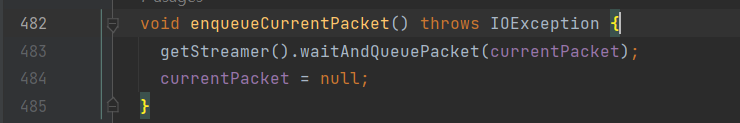

}Método de entrada enqueueCurrentPacketFull:

Método de entrada enqueueCurrentPacket:

Método de entrada waitAndQueuePacket:

void waitAndQueuePacket(DFSPacket packet) throws IOException {

synchronized (dataQueue) {

try {

// 如果队列满了,则等待

boolean firstWait = true;

try {

while (!streamerClosed && dataQueue.size() + ackQueue.size() >

dfsClient.getConf().getWriteMaxPackets()) {

if (firstWait) {

Span span = Tracer.getCurrentSpan();

if (span != null) {

span.addTimelineAnnotation("dataQueue.wait");

}

firstWait = false;

}

try {

dataQueue.wait(); //等待队列有充足的空间

} catch (InterruptedException e) {

// If we get interrupted while waiting to queue data, we still need to get rid

// of the current packet. This is because we have an invariant that if

// currentPacket gets full, it will get queued before the next writeChunk.

//

// Rather than wait around for space in the queue, we should instead try to

// return to the caller as soon as possible, even though we slightly overrun

// the MAX_PACKETS length.

Thread.currentThread().interrupt();

break;

}

}

} finally {

Span span = Tracer.getCurrentSpan();

if ((span != null) && (!firstWait)) {

span.addTimelineAnnotation("end.wait");

}

}

checkClosed();

//如果队列没满,则向队列中添加数据

queuePacket(packet);

} catch (ClosedChannelException ignored) {

}

}

}Ingrese queuePacketel método (la lógica de agregar datos a la cola) y acceda a DataStreamer.java:

2. Construya una tubería

2.1 Conocimiento del rack (determinación de la ubicación de almacenamiento de los bloques)

Ctrl + n busca globalmente DataStreamer, runmétodo de búsqueda:

@Override

public void run() {

long lastPacket = Time.monotonicNow();

TraceScope scope = null;

while (!streamerClosed && dfsClient.clientRunning) {

// if the Responder encountered an error, shutdown Responder

if (errorState.hasError()) {

closeResponder();

}

DFSPacket one;

try {

// process datanode IO errors if any

boolean doSleep = processDatanodeOrExternalError();

final int halfSocketTimeout = dfsClient.getConf().getSocketTimeout()/2;

//步骤一:等待要发送的packet到来

synchronized (dataQueue) {

// wait for a packet to be sent.

long now = Time.monotonicNow();

while ((!shouldStop() && dataQueue.size() == 0 &&

(stage != BlockConstructionStage.DATA_STREAMING ||

now - lastPacket < halfSocketTimeout)) || doSleep) {

long timeout = halfSocketTimeout - (now-lastPacket);

timeout = timeout <= 0 ? 1000 : timeout;

timeout = (stage == BlockConstructionStage.DATA_STREAMING)?

timeout : 1000;

try {

//如果dataQueue中没有数据,代码会阻塞在这里

dataQueue.wait(timeout);

} catch (InterruptedException e) {

LOG.warn("Caught exception", e);

}

doSleep = false;

now = Time.monotonicNow();

}

if (shouldStop()) {

continue;

}

// 获取要发送的数据包

if (dataQueue.isEmpty()) {

one = createHeartbeatPacket();

}

else {

try {

backOffIfNecessary();

} catch (InterruptedException e) {

LOG.warn("Caught exception", e);

}

//如果数据队列不为空,则从其中取出packet

one = dataQueue.getFirst();

SpanId[] parents = one.getTraceParents();

if (parents.length > 0) {

scope = dfsClient.getTracer().

newScope("dataStreamer", parents[0]);

scope.getSpan().setParents(parents);

}

}

}

//步骤二:从NN获取新的block

if (LOG.isDebugEnabled()) {

LOG.debug("stage=" + stage + ", " + this);

}

if (stage == BlockConstructionStage.PIPELINE_SETUP_CREATE) {

LOG.debug("Allocating new block: {}", this);

//向NN申请block并建立数据管道(Pipeline)

setPipeline(nextBlockOutputStream());

//启动ResponseProcessor用来监听packet发送是否成功

initDataStreaming();

} else if (stage == BlockConstructionStage.PIPELINE_SETUP_APPEND) {

LOG.debug("Append to block {}", block);

setupPipelineForAppendOrRecovery();

if (streamerClosed) {

continue;

}

initDataStreaming();

}

long lastByteOffsetInBlock = one.getLastByteOffsetBlock();

if (lastByteOffsetInBlock > stat.getBlockSize()) {

throw new IOException("BlockSize " + stat.getBlockSize() +

" < lastByteOffsetInBlock, " + this + ", " + one);

}

if (one.isLastPacketInBlock()) {

// wait for all data packets have been successfully acked

synchronized (dataQueue) {

while (!shouldStop() && ackQueue.size() != 0) {

try {

// wait for acks to arrive from datanodes

dataQueue.wait(1000);

} catch (InterruptedException e) {

LOG.warn("Caught exception", e);

}

}

}

if (shouldStop()) {

continue;

}

stage = BlockConstructionStage.PIPELINE_CLOSE;

}

// 步骤三:发送packet

SpanId spanId = SpanId.INVALID;

synchronized (dataQueue) {

// move packet from dataQueue to ackQueue

if (!one.isHeartbeatPacket()) {

if (scope != null) {

spanId = scope.getSpanId();

scope.detach();

one.setTraceScope(scope);

}

scope = null;

dataQueue.removeFirst(); //从dataQueue 把要发送的这个packet 移除出去

ackQueue.addLast(one); //ackQueue 里面添加这个packet

packetSendTime.put(one.getSeqno(), Time.monotonicNow());

dataQueue.notifyAll();

}

}

LOG.debug("{} sending {}", this, one);

// 步骤四:向DN中写数据

try (TraceScope ignored = dfsClient.getTracer().

newScope("DataStreamer#writeTo", spanId)) {

one.writeTo(blockStream); //写出数据

blockStream.flush();

} catch (IOException e) {

// HDFS-3398 treat primary DN is down since client is unable to

// write to primary DN. If a failed or restarting node has already

// been recorded by the responder, the following call will have no

// effect. Pipeline recovery can handle only one node error at a

// time. If the primary node fails again during the recovery, it

// will be taken out then.

errorState.markFirstNodeIfNotMarked();

throw e;

}

lastPacket = Time.monotonicNow();

// update bytesSent

long tmpBytesSent = one.getLastByteOffsetBlock();

if (bytesSent < tmpBytesSent) {

bytesSent = tmpBytesSent;

}

if (shouldStop()) {

continue;

}

// Is this block full?

if (one.isLastPacketInBlock()) {

// wait for the close packet has been acked

synchronized (dataQueue) {

while (!shouldStop() && ackQueue.size() != 0) {

dataQueue.wait(1000);// wait for acks to arrive from datanodes

}

}

if (shouldStop()) {

continue;

}

endBlock();

}

if (progress != null) { progress.progress(); }

// This is used by unit test to trigger race conditions.

if (artificialSlowdown != 0 && dfsClient.clientRunning) {

Thread.sleep(artificialSlowdown);

}

} catch (Throwable e) {

// Log warning if there was a real error.

if (!errorState.isRestartingNode()) {

// Since their messages are descriptive enough, do not always

// log a verbose stack-trace WARN for quota exceptions.

if (e instanceof QuotaExceededException) {

LOG.debug("DataStreamer Quota Exception", e);

} else {

LOG.warn("DataStreamer Exception", e);

}

}

lastException.set(e);

assert !(e instanceof NullPointerException);

errorState.setInternalError();

if (!errorState.isNodeMarked()) {

// Not a datanode issue

streamerClosed = true;

}

} finally {

if (scope != null) {

scope.close();

scope = null;

}

}

}

closeInternal();

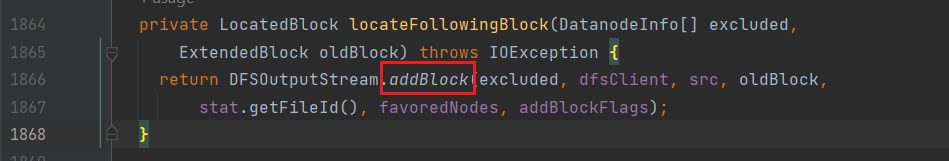

}Ingrese nextBlockOutputStream(línea 68):

Ingrese locateFollowingBlock:

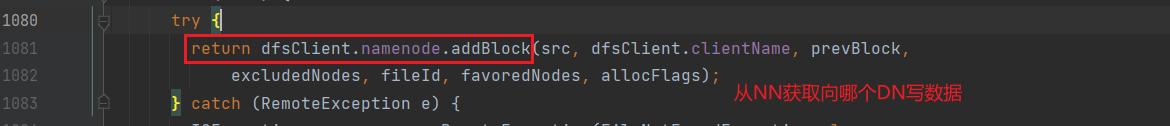

Ingrese addBlock:

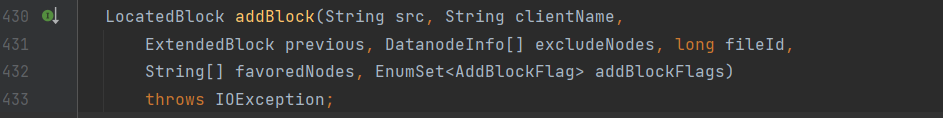

Ingrese addBlocky venga a la clase ClientProtocol:

Por lo tanto, se puede juzgar que este método se implementa a través del agente cliente de NN

Encuentre su clase de implementación:

Ingrese NameNodeRpcServer y busque addBlock:

Ingrese getAdditionalBlock:

Seleccione la ubicación de almacenamiento del bloque;

Ingrese chooseTargetForNewBlock:

Ingrese chooseTarget4NewBlock:

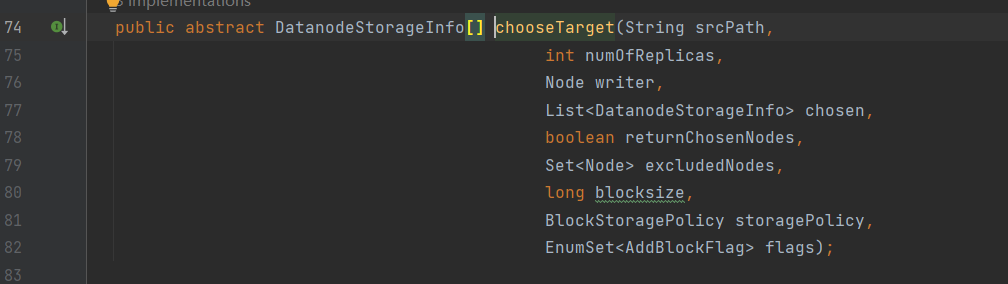

Ingrese chooseTarget:

Continúe ingresando chooseTarget:

Puede ver que es una clase abstracta, así que busque su clase de implementación:

Ingrese BlockPlacementPolicyDefault.java:

Ingrese chooseTarget:

Ingrese chooseTarget:

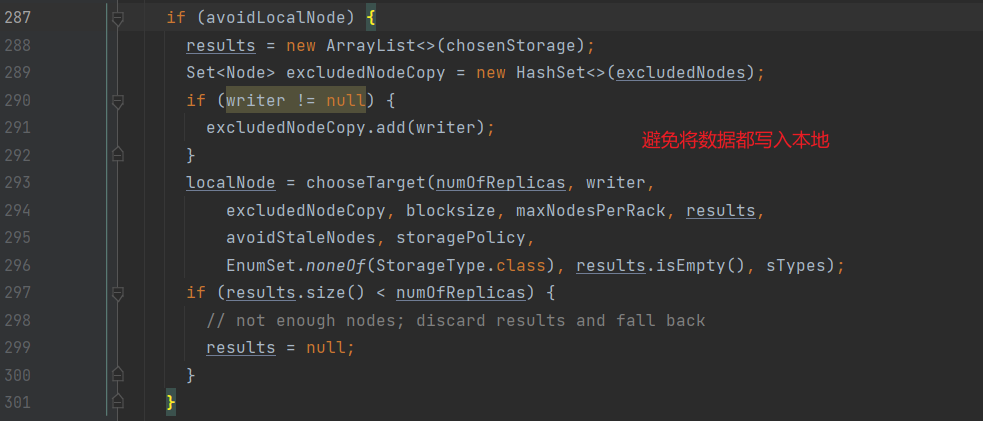

Ingrese chooseTargetInOrderla lógica del conocimiento del rack:

protected Node chooseTargetInOrder(int numOfReplicas,

Node writer,

final Set<Node> excludedNodes,

final long blocksize,

final int maxNodesPerRack,

final List<DatanodeStorageInfo> results,

final boolean avoidStaleNodes,

final boolean newBlock,

EnumMap<StorageType, Integer> storageTypes)

throws NotEnoughReplicasException {

final int numOfResults = results.size();

if (numOfResults == 0) {

//第一个block存储在当前节点

DatanodeStorageInfo storageInfo = chooseLocalStorage(writer,

excludedNodes, blocksize, maxNodesPerRack, results, avoidStaleNodes,

storageTypes, true);

writer = (storageInfo != null) ? storageInfo.getDatanodeDescriptor()

: null;

if (--numOfReplicas == 0) {

return writer;

}

}

final DatanodeDescriptor dn0 = results.get(0).getDatanodeDescriptor();

if (numOfResults <= 1) {

//第二个block存储在另外一个机架

chooseRemoteRack(1, dn0, excludedNodes, blocksize, maxNodesPerRack,

results, avoidStaleNodes, storageTypes);

if (--numOfReplicas == 0) {

return writer;

}

}

if (numOfResults <= 2) {

final DatanodeDescriptor dn1 = results.get(1).getDatanodeDescriptor();

if (clusterMap.isOnSameRack(dn0, dn1)) {

//如果第一个和第二个在同一个机架,那么第三个放在其他机架

chooseRemoteRack(1, dn0, excludedNodes, blocksize, maxNodesPerRack,

results, avoidStaleNodes, storageTypes);

} else if (newBlock){

//如果是新块,和第二个块存储在同一个机架

chooseLocalRack(dn1, excludedNodes, blocksize, maxNodesPerRack,

results, avoidStaleNodes, storageTypes);

} else {

//如果不是新块,放在当前机架

chooseLocalRack(writer, excludedNodes, blocksize, maxNodesPerRack,

results, avoidStaleNodes, storageTypes);

}

if (--numOfReplicas == 0) {

return writer;

}

}

chooseRandom(numOfReplicas, NodeBase.ROOT, excludedNodes, blocksize,

maxNodesPerRack, results, avoidStaleNodes, storageTypes);

return writer;

}2.2 envío de sockets

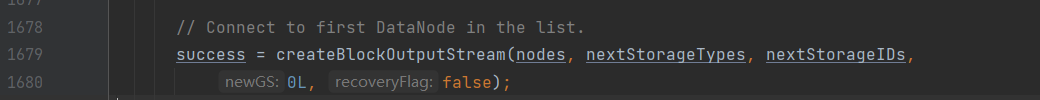

Volver a nextBlockOutputStream:

Ingrese createBlockOutputStream:

Como se puede ver en los comentarios, la función principal de este método es establecer una conexión con el primer DN de la tubería;

boolean createBlockOutputStream(DatanodeInfo[] nodes,

StorageType[] nodeStorageTypes, String[] nodeStorageIDs,

long newGS, boolean recoveryFlag) {

if (nodes.length == 0) {

LOG.info("nodes are empty for write pipeline of " + block);

return false;

}

String firstBadLink = "";

boolean checkRestart = false;

if (LOG.isDebugEnabled()) {

LOG.debug("pipeline = " + Arrays.toString(nodes) + ", " + this);

}

// persist blocks on namenode on next flush

persistBlocks.set(true);

int refetchEncryptionKey = 1;

while (true) {

boolean result = false;

DataOutputStream out = null;

try {

assert null == s : "Previous socket unclosed";

assert null == blockReplyStream : "Previous blockReplyStream unclosed";

//和DN创建socket连接

s = createSocketForPipeline(nodes[0], nodes.length, dfsClient);

long writeTimeout = dfsClient.getDatanodeWriteTimeout(nodes.length);

long readTimeout = dfsClient.getDatanodeReadTimeout(nodes.length);

//输出流,用于写数据到DN

OutputStream unbufOut = NetUtils.getOutputStream(s, writeTimeout);

//输入流,用于读取写数据到DN的结果

InputStream unbufIn = NetUtils.getInputStream(s, readTimeout);

IOStreamPair saslStreams = dfsClient.saslClient.socketSend(s,

unbufOut, unbufIn, dfsClient, accessToken, nodes[0]);

unbufOut = saslStreams.out;

unbufIn = saslStreams.in;

out = new DataOutputStream(new BufferedOutputStream(unbufOut,

DFSUtilClient.getSmallBufferSize(dfsClient.getConfiguration())));

blockReplyStream = new DataInputStream(unbufIn);

//

// Xmit header info to datanode

//

BlockConstructionStage bcs = recoveryFlag ?

stage.getRecoveryStage() : stage;

// We cannot change the block length in 'block' as it counts the number

// of bytes ack'ed.

ExtendedBlock blockCopy = block.getCurrentBlock();

blockCopy.setNumBytes(stat.getBlockSize());

boolean[] targetPinnings = getPinnings(nodes);

// 发送数据

new Sender(out).writeBlock(blockCopy, nodeStorageTypes[0], accessToken,

dfsClient.clientName, nodes, nodeStorageTypes, null, bcs,

nodes.length, block.getNumBytes(), bytesSent, newGS,

checksum4WriteBlock, cachingStrategy.get(), isLazyPersistFile,

(targetPinnings != null && targetPinnings[0]), targetPinnings,

nodeStorageIDs[0], nodeStorageIDs);

// receive ack for connect

BlockOpResponseProto resp = BlockOpResponseProto.parseFrom(

PBHelperClient.vintPrefixed(blockReplyStream));

Status pipelineStatus = resp.getStatus();

firstBadLink = resp.getFirstBadLink();

// Got an restart OOB ack.

// If a node is already restarting, this status is not likely from

// the same node. If it is from a different node, it is not

// from the local datanode. Thus it is safe to treat this as a

// regular node error.

if (PipelineAck.isRestartOOBStatus(pipelineStatus) &&

!errorState.isRestartingNode()) {

checkRestart = true;

throw new IOException("A datanode is restarting.");

}

String logInfo = "ack with firstBadLink as " + firstBadLink;

DataTransferProtoUtil.checkBlockOpStatus(resp, logInfo);

assert null == blockStream : "Previous blockStream unclosed";

blockStream = out;

result = true; // success

errorState.resetInternalError();

lastException.clear();

// remove all restarting nodes from failed nodes list

failed.removeAll(restartingNodes);

restartingNodes.clear();

} catch (IOException ie) {

if (!errorState.isRestartingNode()) {

LOG.info("Exception in createBlockOutputStream " + this, ie);

}

if (ie instanceof InvalidEncryptionKeyException &&

refetchEncryptionKey > 0) {

LOG.info("Will fetch a new encryption key and retry, "

+ "encryption key was invalid when connecting to "

+ nodes[0] + " : " + ie);

// The encryption key used is invalid.

refetchEncryptionKey--;

dfsClient.clearDataEncryptionKey();

// Don't close the socket/exclude this node just yet. Try again with

// a new encryption key.

continue;

}

// find the datanode that matches

if (firstBadLink.length() != 0) {

for (int i = 0; i < nodes.length; i++) {

// NB: Unconditionally using the xfer addr w/o hostname

if (firstBadLink.equals(nodes[i].getXferAddr())) {

errorState.setBadNodeIndex(i);

break;

}

}

} else {

assert !checkRestart;

errorState.setBadNodeIndex(0);

}

final int i = errorState.getBadNodeIndex();

// Check whether there is a restart worth waiting for.

if (checkRestart) {

errorState.initRestartingNode(i,

"Datanode " + i + " is restarting: " + nodes[i],

shouldWaitForRestart(i));

}

errorState.setInternalError();

lastException.set(ie);

result = false; // error

} finally {

if (!result) {

IOUtils.closeSocket(s);

s = null;

IOUtils.closeStream(out);

IOUtils.closeStream(blockReplyStream);

blockReplyStream = null;

}

}

return result;

}

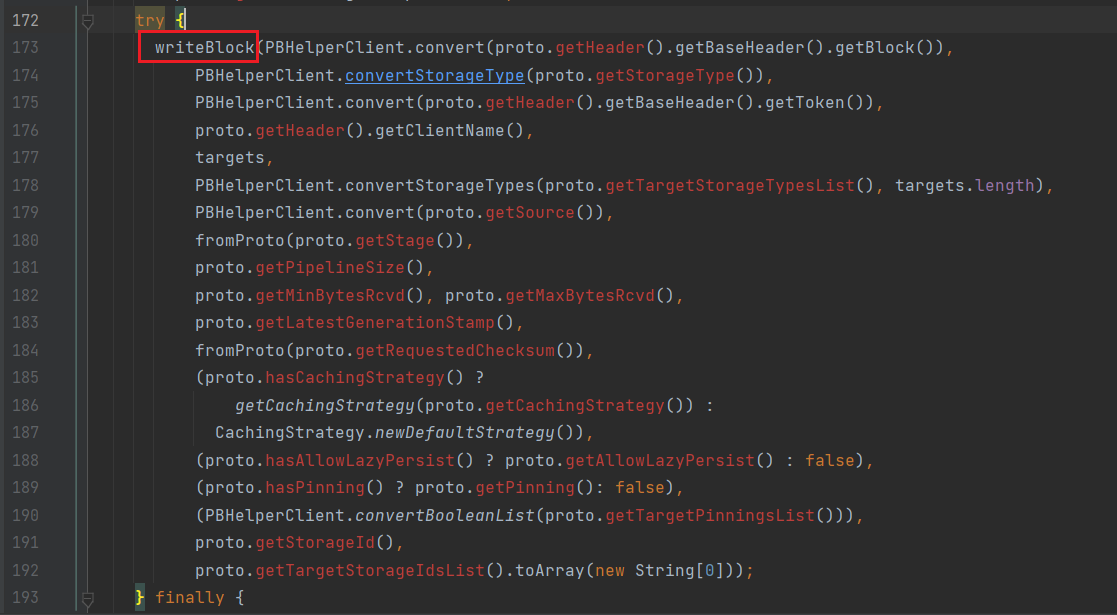

}Ingrese writeBlock:

![]()

Ingrese enviar:

Al flushflashear datos;

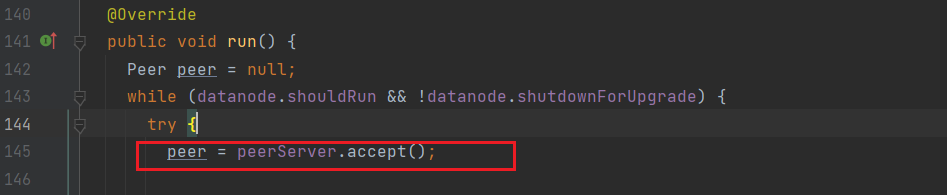

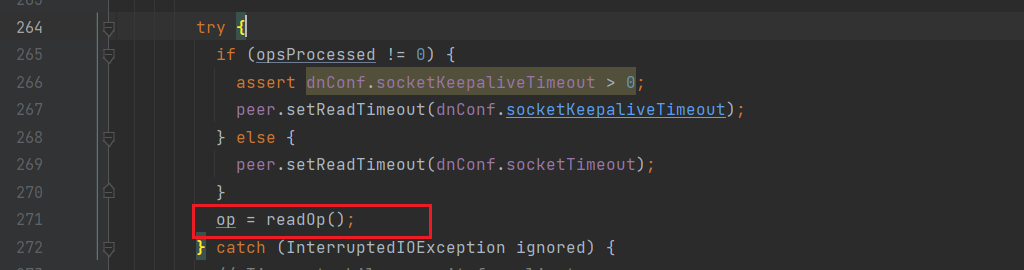

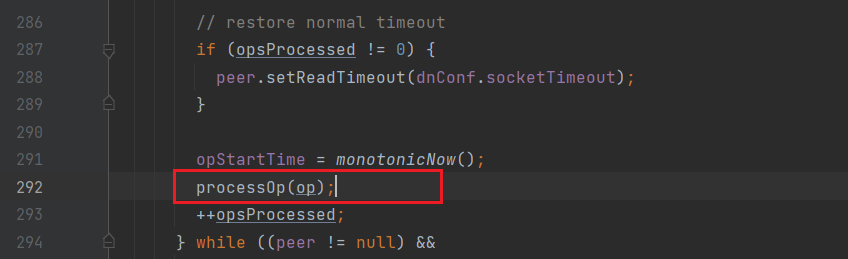

2.3.recepción de enchufe

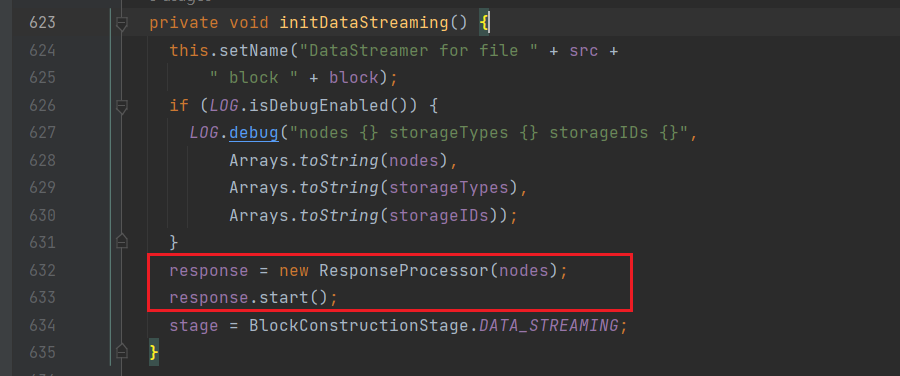

La recepción de datos es tarea de DN, así que ingrese DataXceiverServer.java y busque runel método:

Recibir solicitud de socket;

Cada vez que el cliente envía un bloque, inicia uno DataXceiverpara procesar el bloque.

Ingrese DataXceivery ubique el método de ejecución:

El tipo de operación para leer datos;

Procesar datos según tipo de operación;

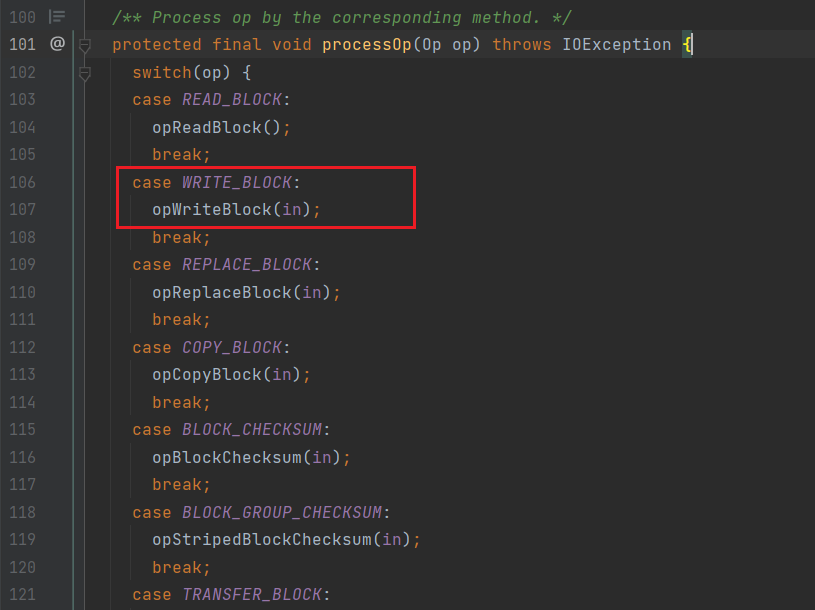

Ingrese processOp:

Se pueden ver diferentes tipos de operaciones.

Ingrese opWriteBlock(escriba datos):

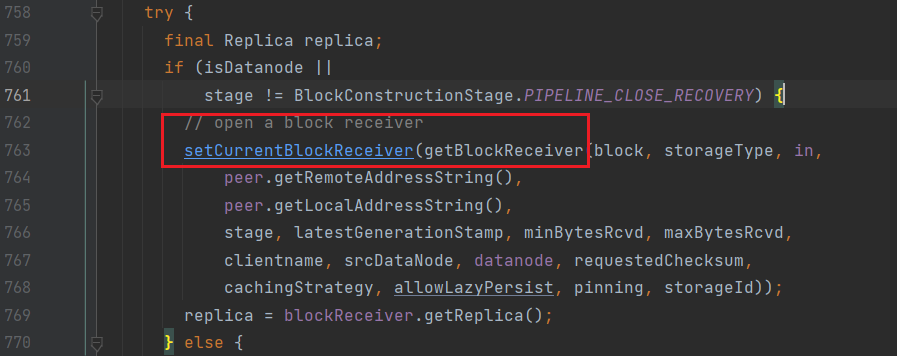

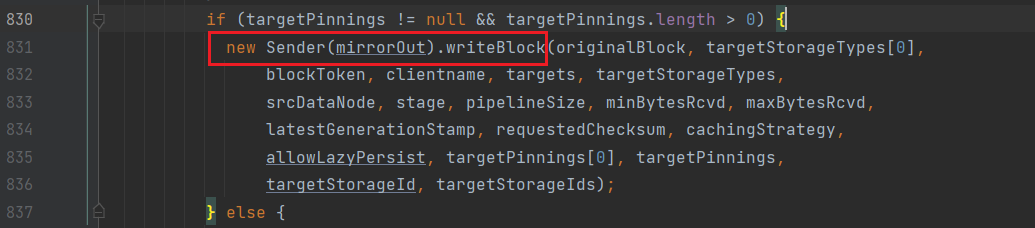

Ctrl +alt +b Busque la clase de implementación de writeBlock e ingrese DataXceiver.java:

Crear un BlockReceiver;

Enviar datos al socket descendente

Siguiente ingresa getBlockReceiver:

Ingrese BlockReceiver:

Crear canalización;

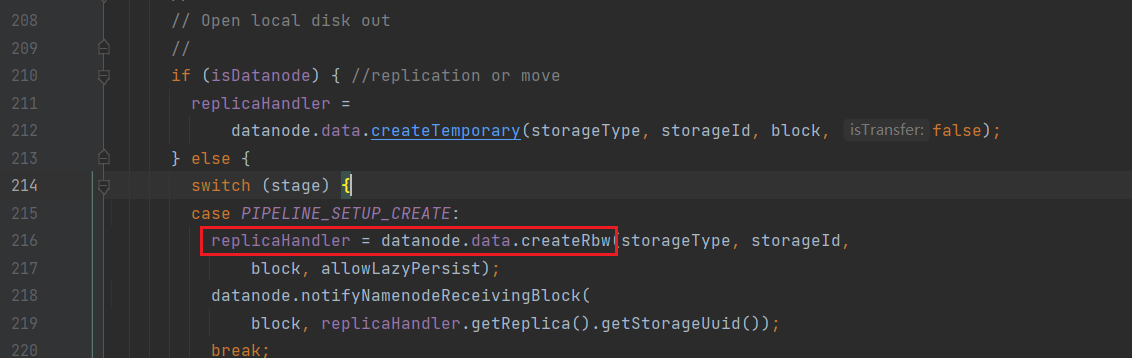

Ingrese createRbw:

Ingrese FsDatasetImpl.java:

Ingrese createRbw:

creando createRbwFileun archivo

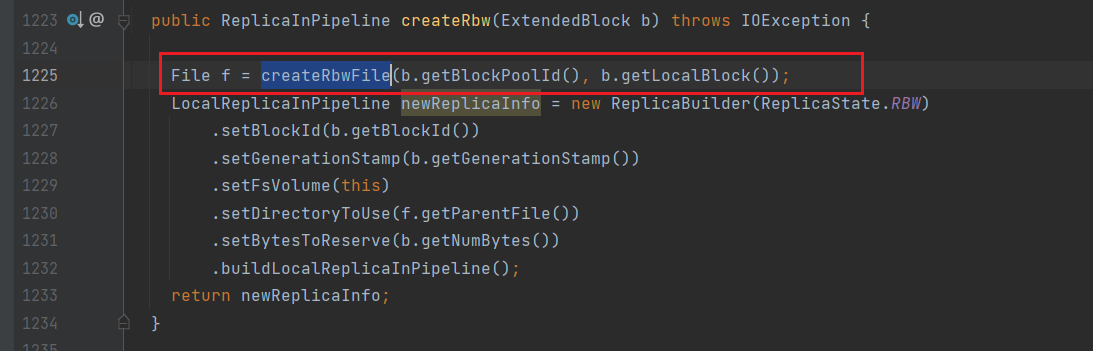

3. El cliente recibe la respuesta del DN

Regrese a DataStreamer.java y navegue para ejecutar:

Inicie ResponseProcessor a través initDataStreamingdel método para monitorear si el paquete se envía correctamente;

Cree un ResponseProcessor e inicie el hilo;

Ingrese ResponseProcessory localice ejecutar:

@Override

public void run() {

setName("ResponseProcessor for block " + block);

PipelineAck ack = new PipelineAck();

TraceScope scope = null;

while (!responderClosed && dfsClient.clientRunning && !isLastPacketInBlock) {

// 处理来自DN的应答

try {

// 从管道中读取一个ack

ack.readFields(blockReplyStream);

if (ack.getSeqno() != DFSPacket.HEART_BEAT_SEQNO) {

Long begin = packetSendTime.get(ack.getSeqno());

if (begin != null) {

long duration = Time.monotonicNow() - begin;

if (duration > dfsclientSlowLogThresholdMs) {

LOG.info("Slow ReadProcessor read fields for block " + block

+ " took " + duration + "ms (threshold="

+ dfsclientSlowLogThresholdMs + "ms); ack: " + ack

+ ", targets: " + Arrays.asList(targets));

}

}

}

if (LOG.isDebugEnabled()) {

LOG.debug("DFSClient {}", ack);

}

long seqno = ack.getSeqno();

// processes response status from datanodes.

ArrayList<DatanodeInfo> congestedNodesFromAck = new ArrayList<>();

for (int i = ack.getNumOfReplies()-1; i >=0 && dfsClient.clientRunning; i--) {

final Status reply = PipelineAck.getStatusFromHeader(ack

.getHeaderFlag(i));

if (PipelineAck.getECNFromHeader(ack.getHeaderFlag(i)) ==

PipelineAck.ECN.CONGESTED) {

congestedNodesFromAck.add(targets[i]);

}

// Restart will not be treated differently unless it is

// the local node or the only one in the pipeline.

if (PipelineAck.isRestartOOBStatus(reply)) {

final String message = "Datanode " + i + " is restarting: "

+ targets[i];

errorState.initRestartingNode(i, message,

shouldWaitForRestart(i));

throw new IOException(message);

}

// node error

if (reply != SUCCESS) {

errorState.setBadNodeIndex(i); // mark bad datanode

throw new IOException("Bad response " + reply +

" for " + block + " from datanode " + targets[i]);

}

}

if (!congestedNodesFromAck.isEmpty()) {

synchronized (congestedNodes) {

congestedNodes.clear();

congestedNodes.addAll(congestedNodesFromAck);

}

} else {

synchronized (congestedNodes) {

congestedNodes.clear();

lastCongestionBackoffTime = 0;

}

}

assert seqno != PipelineAck.UNKOWN_SEQNO :

"Ack for unknown seqno should be a failed ack: " + ack;

if (seqno == DFSPacket.HEART_BEAT_SEQNO) { // a heartbeat ack

continue;

}

// 标志成功传输的ack

DFSPacket one;

synchronized (dataQueue) {

one = ackQueue.getFirst();

}

if (one.getSeqno() != seqno) {

throw new IOException("ResponseProcessor: Expecting seqno " +

" for block " + block +

one.getSeqno() + " but received " + seqno);

}

isLastPacketInBlock = one.isLastPacketInBlock();

// Fail the packet write for testing in order to force a

// pipeline recovery.

if (DFSClientFaultInjector.get().failPacket() &&

isLastPacketInBlock) {

failPacket = true;

throw new IOException(

"Failing the last packet for testing.");

}

// update bytesAcked

block.setNumBytes(one.getLastByteOffsetBlock());

synchronized (dataQueue) {

scope = one.getTraceScope();

if (scope != null) {

scope.reattach();

one.setTraceScope(null);

}

lastAckedSeqno = seqno;

pipelineRecoveryCount = 0;

ackQueue.removeFirst(); //从ack队列中移除

packetSendTime.remove(seqno);

dataQueue.notifyAll(); //通知dataQueue应答处理完毕

one.releaseBuffer(byteArrayManager);

}

} catch (Exception e) {

if (!responderClosed) {

lastException.set(e);

errorState.setInternalError();

errorState.markFirstNodeIfNotMarked();

synchronized (dataQueue) {

dataQueue.notifyAll();

}

if (!errorState.isRestartingNode()) {

LOG.warn("Exception for " + block, e);

}

responderClosed = true;

}

} finally {

if (scope != null) {

scope.close();

}

scope = null;

}

}

}En este punto, una vez que el cliente recibe correctamente la respuesta del DN, se completa el proceso de carga.