Beim Herunterladen des Huggingface-Modells tritt häufig dieser Fehler auf: HTTPSConnectionPool(host='huggingface.co', port=443), selbst wenn Sie über die richtige Internethaltung verfügen.

Beim Herunterladen von Tokenizer wird beispielsweise Folgendes angezeigt:

tokenizer = AutoTokenizer.from_pretrained("csebuetnlp/mT5_multilingual_XLSum")

1. Laden Sie das Modell direkt herunter

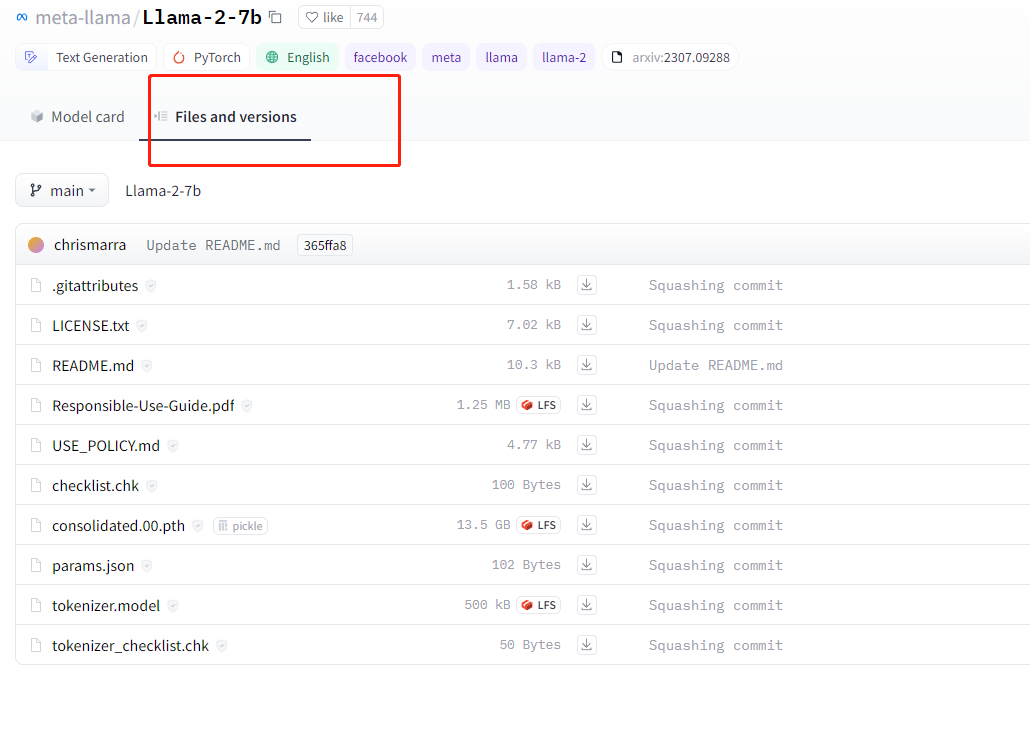

Es gibt eine Möglichkeit, die herunterzuladenden Dateien und Versionen des Modells direkt auf dem Huggingface anzugeben, nachdem der Download abgeschlossen ist.

tokenizer = AutoTokenizer.from_pretrained("模型的本地路径")

Auf diese Weise wird es nicht aus dem Internet heruntergeladen, sondern das lokale Modell wird direkt verwendet.

2. Downgrade-Anfragen und urllib3

Wenn Sie nicht so viele Dateien manuell herunterladen möchten, können Sie die Anforderungen auf 2.27.1 und urllib3 auf 1.25.11 reduzieren

pip install requests==2.27.1

pip install urllib3==1.25.11

Sie können sehen, dass das Modell von selbst herunterlädt.

Downloading (…)okenizer_config.json: 100%|██████████| 375/375 [00:00<?, ?B/s]

Downloading (…)lve/main/config.json: 100%|██████████| 730/730 [00:00<?, ?B/s]

Downloading spiece.model: 100%|██████████| 4.31M/4.31M [00:03<00:00, 1.08MB/s]

Downloading (…)cial_tokens_map.json: 100%|██████████| 65.0/65.0 [00:00<00:00, 65.1kB/s]