在运行实例代码时候,在命令行中log4j的日志中,有时会出现这样的日志,没有warning也没有error,但就是出现不了结果。

18/06/17 21:12:09 INFO scheduler.JobScheduler: Added jobs for time 1420953009000 ms

18/06/17 21:12:10 INFO scheduler.JobScheduler: Added jobs for time 1420953010000 ms

18/06/17 21:12:11 INFO scheduler.JobScheduler: Added jobs for time 1420953011000 ms

18/06/17 21:12:12 INFO scheduler.JobScheduler: Added jobs for time 1420953012000 ms

18/06/17 21:12:13 INFO scheduler.JobScheduler: Added jobs for time 1420953013000 ms

18/06/17 21:12:14 INFO scheduler.JobScheduler: Added jobs for time 1420953014000 ms

18/06/17 21:12:15 INFO scheduler.JobScheduler: Added jobs for time 1420953015000 ms

18/06/17 21:12:16 INFO scheduler.JobScheduler: Added jobs for time 1420953016000 ms

18/06/17 21:12:17 INFO scheduler.JobScheduler: Added jobs for time 1420953017000 ms

18/06/17 21:12:18 INFO scheduler.JobScheduler: Added jobs for time 1420953018000 ms

18/06/17 21:12:19 INFO scheduler.JobScheduler: Added jobs for time 1420953019000 ms

18/06/17 21:12:20 INFO scheduler.JobScheduler: Added jobs for time 1420953020000 ms

18/06/17 21:12:21 INFO scheduler.JobScheduler: Added jobs for time 1420953021000 ms

18/06/17 21:12:22 INFO scheduler.JobScheduler: Added jobs for time 1420953022000 ms

18/06/17 21:12:23 INFO scheduler.JobScheduler: Added jobs for time 1420953023000 ms

18/06/17 21:12:24 INFO scheduler.JobScheduler: Added jobs for time 1420953024000 ms

18/06/17 21:12:25 INFO scheduler.JobScheduler: Added jobs for time 1420953025000 ms

18/06/17 21:12:26 INFO scheduler.JobScheduler: Added jobs for time 1420953026000 ms

18/06/17 21:12:27 INFO scheduler.JobScheduler: Added jobs for time 1420953027000 ms

18/06/17 002112:28 INFO scheduler.JobScheduler: Added jobs for time 1420953028000 ms 由日志中可以看到,一直在执行add job的过程,也就是说一直在执行receiver的过程,但我们接收到的数据实际上是没有执行的,再看官方文档 传送门

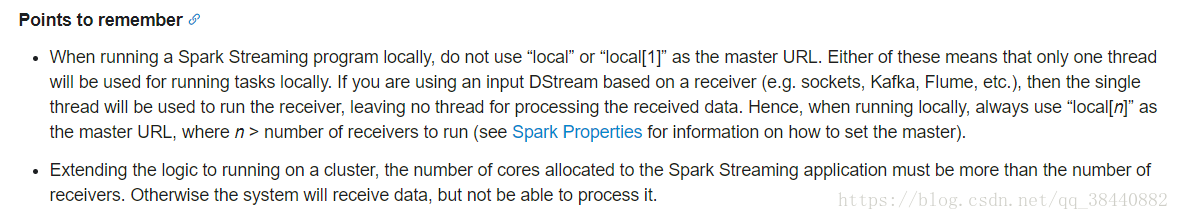

翻译过来的意思是:

在本地运行Spark Streaming程序时,不要使用“local”或“local[1]”作为主节点URL。这两种方法都意味着只能使用一个线程在本地运行任务。如果你用基于receiver 的输入dStream(例如套接字、Kafka、Flume等),然后使用单个线程来运行receiver ,不留下任何线程来处理接收到的数据。因此,当你在本地跑程序时,始终使用“local[n]”作为主节点URL,其中n>接收器要运行的数量(有关如何设置主机的信息,请参见Spark Properties)。

将逻辑扩展到集群上运行,分配给Spark Streaming应用程序的核心数量必须大于接收者的数量。否则,系统将只接收数据,但不会处理它。

所以我们只要将代码中

val sparkConf = new SparkConf().setAppName("NetworkWordCount") 改为

val sparkConf = new SparkConf().setAppName("NetworkWordCount").setMaster("local[2]")即可。