文章目录

一、Max pooling池化

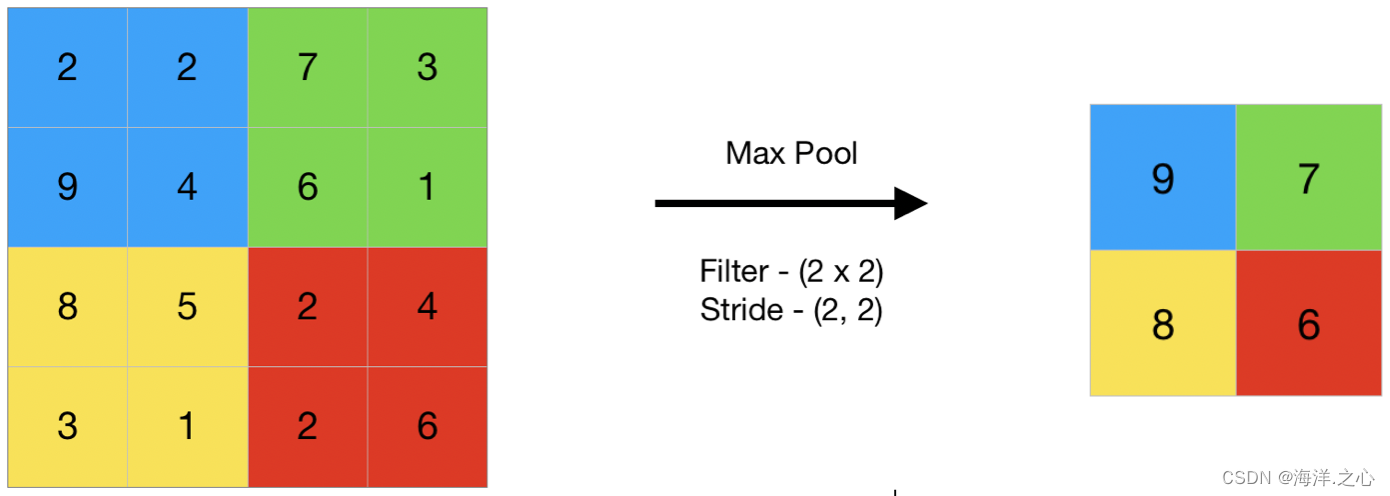

Max 池化(Max Pooling)是一种池化操作,在卷积神经网络(CNN)中用于减小特征图的尺寸,同时保留主要特征。Max 池化操作的基本原理如下:

-

输入特征图: Max 池化操作的输入是一个特征图,通常是卷积层的输出,其中包含了提取到的各种特征。

-

滑动窗口: 在特征图上,Max 池化操作会在每个位置上滑动一个固定大小的窗口(通常是2x2或3x3大小的窗口)。

-

取最大值: 在每个窗口内,Max 池化会选取窗口内的最大值作为输出。这样,窗口内的所有特征都会被压缩成一个单一的最大值。

-

输出特征图: Max 池化操作的输出是一个经过池化的特征图,尺寸减小了,但仍然保留了主要特征。

Max 池化的作用有几个方面:

-

尺寸减小: 通过取每个窗口内的最大值,池化操作可以减小特征图的尺寸,从而降低后续层的计算复杂度。

-

位置不变性: Max 池化引入了平移不变性,因为无论特征在窗口内的位置如何变化,只要最大值保持不变,输出仍然相同。

-

特征保留: Max 池化可以保留主要特征,因为每个窗口内只保留了最显著的特征,丢弃了次要特征。

在卷积神经网络中,Max 池化通常与卷积层交替使用,用于逐步减小特征图的尺寸,并在保留主要特征的同时降低计算量。

二、其他池化

除了 Max 池化之外,还存在其他几种常用的池化操作,它们在卷积神经网络中用于对特征图进行降采样,以减小特征图的尺寸和计算复杂度。以下是一些其他池化操作的介绍:

-

Average Pooling(平均池化):

- 在每个池化窗口内计算特征值的平均值,而不是取最大值。

- 平均池化适用于一些不需要强调局部极值特征的任务,或者需要在某种程度上平滑特征的任务。

- 相对于 Max 池化,平均池化可能会导致一些细节特征的丢失。

-

Global Average Pooling(全局平均池化):

- 在整个特征图上计算特征值的平均值,得到一个标量输出。

- 全局平均池化用于将整个特征图压缩为一个特征向量,适用于网络的最后一层或特征图的全局特征提取。

-

Min Pooling(最小池化):

- 在每个池化窗口内计算特征值的最小值。

- 最小池化可以用于强调局部极小值特征,但在一些任务中可能会导致一些重要特征的丢失。

-

Global Max Pooling(全局最大池化):

- 在整个特征图上选取最大值作为输出,类似于全局平均池化。

- 全局最大池化用于获取特征图的全局最显著特征。

这些池化操作在卷积神经网络中的应用会根据任务需求和网络架构进行选择。不同的池化操作对于特征的处理和降采样效果不同,可以根据实际情况灵活地选择使用哪种池化操作。