部署elasticsearch群集

第1台群集结点配置

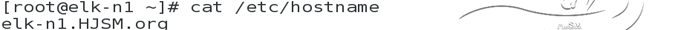

第1台群集节点修改主机名

改下面文件中的SELINUX=permissive

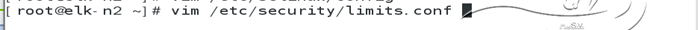

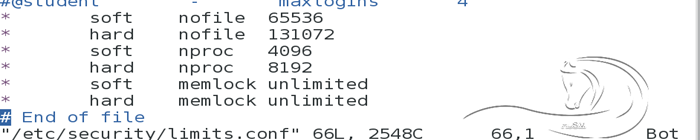

[root@elk-n1 ~]# vim /etc/security/limits.conf #修改系统限制

- soft nofile 65536 #单用户可打开的文件最大数(软限)

- hard nofile 131072 #单用户可打开的文件最大数(硬限)

- soft nproc 4096 #单用户可用的最大进程数(软限)

- hard nproc 8192 #单用户可用的最大进程数(硬限)

- soft memlock unlimited #最大锁定内存地址空间(kb)(软限)

- hard memlock unlimited #最大锁定内存地址空间(kb)(硬限)

[root@elk-n1 ~]#reboot

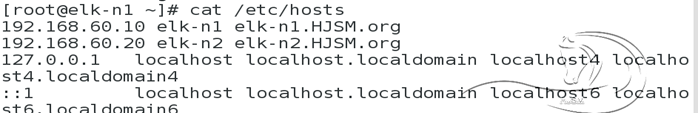

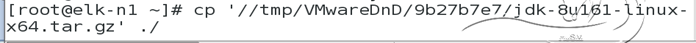

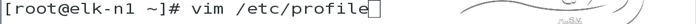

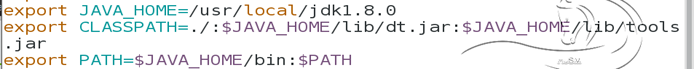

安装java环境(java环境必须是1.8版本以上的)

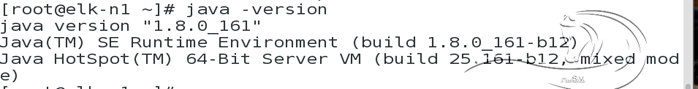

#安装elasticsearch

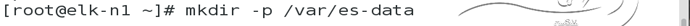

创建elasticsearch data的存放目录,并修改该目录的属主属组

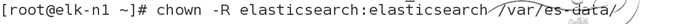

修改elasticsearch的日志属主属组

修改elasticsearch的配置文件

cluster.name: my-elk #设置集群名称

node.name: elk-n1 #设置节点名称

node.master: true #主节点

node.data: true #数据节点

path.data: /var/es-data #修改data存放的路径

path.logs: /var/log/elasticsearch #修改logs日志的路径

bootstrap.memory_lock: true #配置内存使用交换分区

network.host: 0.0.0.0 #监听的网络地址

http.port: 9200 #开启监听的端口

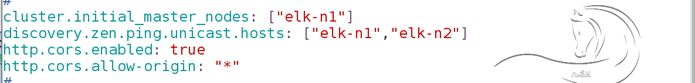

cluster.initial_master_nodes: [“elk-n1”] #集群初始主节点(7.6版必须配置)

discovery.zen.ping.unicast.hosts: [“elk-n1”,“elk-n2”] #节点单播通信

http.cors.enabled: true #此下两条为新增加的参数,

http.cors.allow-origin: “*” #使head插件可以访问es

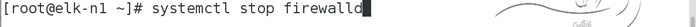

防火墙配置

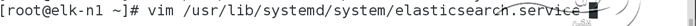

修改elasticsearch的Service配置文件

启动elasticsearch

第2台群集结点配置

第2台群集节点修改主机名

关闭SELinux:

改下面文件中的SELINUX=permissive

[root@elk-n2 ~]#reboot

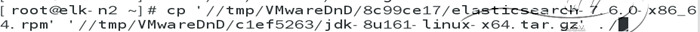

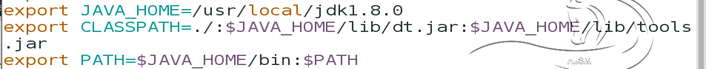

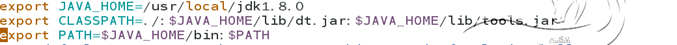

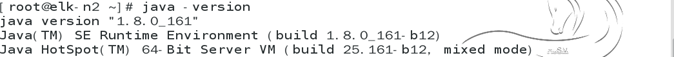

安装java环境(java环境必须是1.8版本以上的)

安装elasticsearch

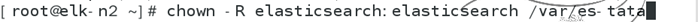

创建elasticsearch data的存放目录,并修改该目录的属主属组

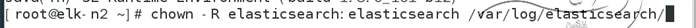

修改elasticsearch的日志属主属组

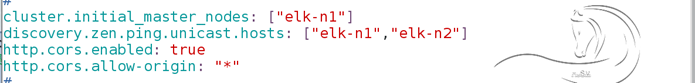

修改elasticsearch的配置文件

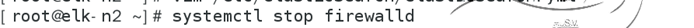

防火墙配置

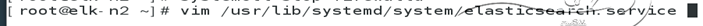

修改elasticsearch的配置文件

启动elasticsearch

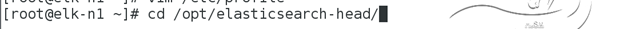

安装Head插件,在elk-n1主机上(第一台机器)

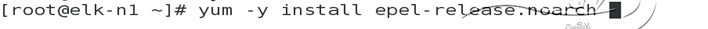

安装EPEL源

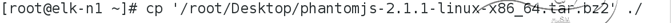

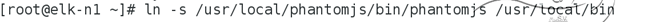

先安装phantomjs

测试一下

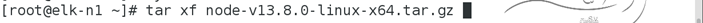

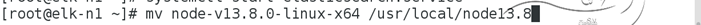

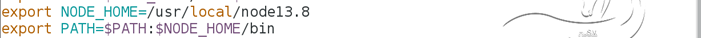

安装Head插件

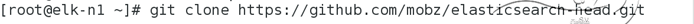

#安装git,下载Head插件

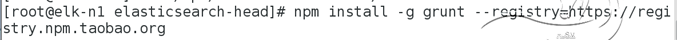

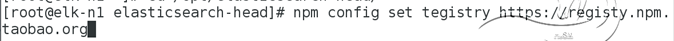

#安装grunt

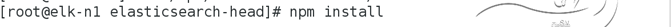

#安装插件

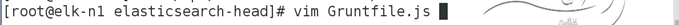

配置 elasticsearch-head下Gruntfile.js文件

修改connect配置节点

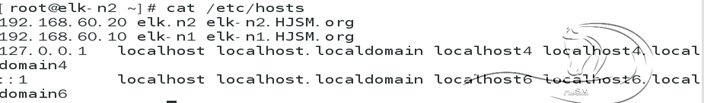

添加主机名

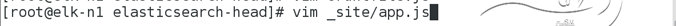

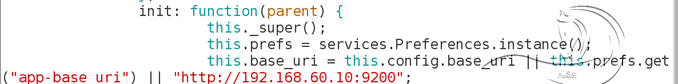

修改 _site/app.js文件

修改IP地址

启动head插件服务(后台运行)

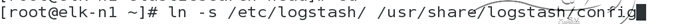

安装配置logstash(你要采集哪里的日志,就装在哪里)

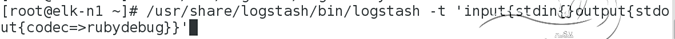

logstash的测试

日志采集配置:

input {

file {

path => “/var/log/messages” #收集Linux系统日志

type => “system”

start_position => “beginning”

}

}

output {

elasticsearch { #输出到elasticsearch

hosts => [“192.168.60.10:9200”]

index => “system-%{+YYYY.MM.dd}”

}

}

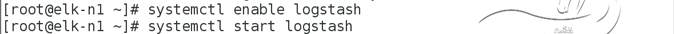

启动Logstash

查看日志

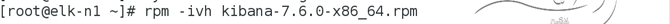

安装kibana

#安装

#编辑/etc/kibana/kibana.yml

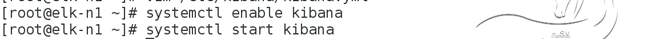

#启动kibana

安装并配置filebeat

#安装

#编辑/etc/filebeat/filebeat.yml

#启动filebeat

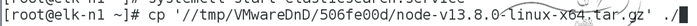

在ELK-n2服务器上部署Logstash,也需要Java环境

#安装java环境(java环境必须是1.8版本以上的)

安装Apache与Logstash

#安装Logstash

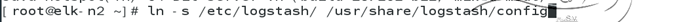

#编辑配置/etc/logstash/conf.d/apache_access.conf

input {

file {

path => “/var/log/httpd/access_log”

type => “Apache_access”

start_position => “beginning”

}

}

output {

elasticsearch {

action => “index”

hosts => [“192.168.60.10:9200”]

index => “apache_access-%{+YYYY.MM.dd}”

}

}

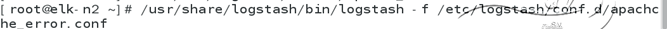

编辑配置/etc/logstash/conf.d/apache_error.conf

input {

file {

path => “/etc/httpd/logs/error_log”

type => “Apache_error”

start_position => “beginning”

}

}

output {

elasticsearch {

action => “index”

hosts => [“192.168.60.10:9200”]

index => “apache_error-%{+YYYY.MM.dd}”

}

}

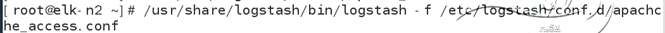

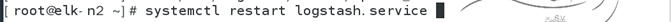

启动Logstash

测试或启动Logstash,并在ESK主机上验证,别忘了防火墙设置

Kibana页面