一、安装第三方库

jieba库和wordcloud库是优秀的第三方库,需要我们手动安装这两个库。

打开cmd,分别输入以下指令,即可安装jieba库和wordcloud库

pip install jieba

pip install wordcloud

二、运用jieba库分析一篇文章

这里我选取的是作家朱光潜的文章《朝抵抗力最大的路径走》,来统计其中词语出现的频率

代码如下:

import jieba

txt = open("C:\\text.txt", "r", encoding='utf-8').read()

words = jieba.lcut(txt)

counts = {}

for word in words:

if len(word) == 1:

continue

else:

counts[word] = counts.get(word,0) + 1

items = list(counts.items())

items.sort(key=lambda x:x[1], reverse=True)

for i in range(15):

word, count = items[i]

print ("{0:<10}{1:>5}".format(word, count))

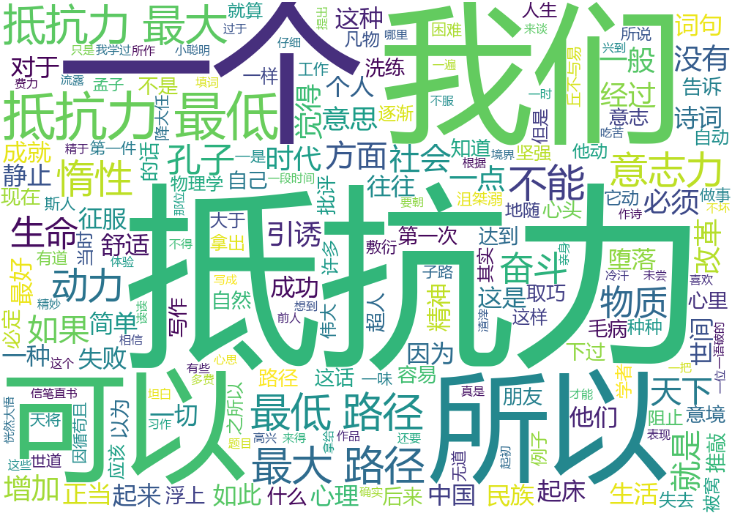

输出如下:

可见在这篇文章中,词频前15的词语如上图所示

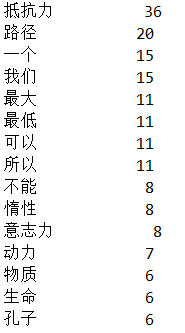

三、运用wordcloud库

jieba库能将txt中的词频统计出来,并按照我们所希望的格式输出。但用wordcloud库能将这些词语形成词云,并且可以用图片方式输出。

这里我依然选取上述文章,来用wordcloud库形成词云。

代码如下:

#GovRptWordCloudv1.py

import jieba

import wordcloud

f = open("C:\\text.txt", "r", encoding="utf-8")

t = f.read()

f.close()

ls = jieba.lcut(t)

txt = " ".join(ls)

w = wordcloud.WordCloud( \

width = 1000, height = 700,\

background_color = "white",

font_path = "msyh.ttc"

)

w.generate(txt)

w.to_file("grwordcloud.png")

词云如下图所示: