Выпадение Профиль

1. В модели обучения машины, параметры модели слишком много, слишком мало образцов обучения, обучено модель склонна к более облегающему явлению. Переобучения производительности конкретной: модель данных обучения по меньшей функции потерь, прогнозирование

более высокая точности, но в потере данных тестовой функции является относительно большой, низкой точностью предсказания.

2.Dropout: когда вперед распространение, так что значение нейрона активируется с некоторой вероятностью р , чтобы перестать работать , так что вы можете сделать более обобщенной модели, так как она не слишком полагаться на некоторых местных особенностей.

.Dropout процесса и использования

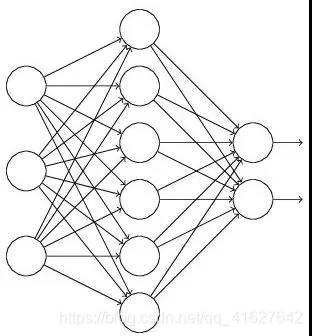

Предположим , мы хотим обучить такой нейронной сети, показанной на рисунке 2:

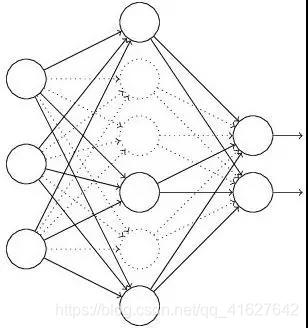

нормальный процесс: х вход, выход Y, X мы сперва перед распространением через сеть, то распространение ошибки обратно позволяет определить , как обновлять параметры сеть обучения. Выпадение После использования, этот процесс будет выглядеть следующим образом :

(1) Во- первых, случайные (временные) Удаление сети половина скрытые нейроны , нейроны выходных остается постоянной вход (пунктирная линия на фиг.3 представляет собой частичный временный нейрон удаляется.)

(2 ) и входная х до распространения через сеть модифицированный, то в результате потери путем модификации сети распространения обратно. После небольшого числа обучающих выборок после выполнения этого процесса, нейроны не удаляются обновить соответствующие параметры методы (ш, б) сниженные в соответствии со стохастическим градиентом.

(3) , а затем продолжают повторять процесс (1 и 2):

восстановить нейроны будут удалены (для удаленных интактных нейронов, но нейроны удалены не обновляется).

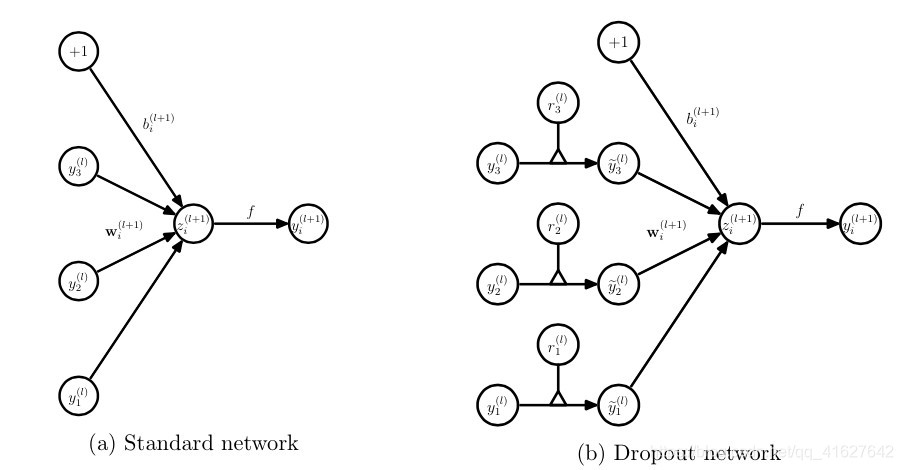

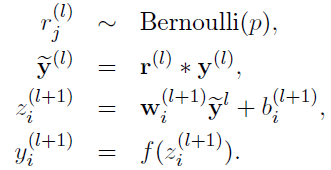

Выпадение с использованием нейронных сетей

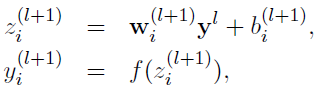

Формула сети Нет Отключение:

сеть Выпадение формулы:

Почему Выпадение может быть решен припадок?

(1)取平均的作用: 先回到标准的模型即没有dropout,我们用相同的训练数据去训练5个不同的神经网络,一般会得到5个不同的结果,此时我们可以采用 “5个结果取均值”或者“多数取胜的投票策略”去决定最终结果。例如3个网络判断结果为数字9,那么很有可能真正的结果就是数字9,其它两个网络给出了错误结果。这种“综合起来取平均”的策略通常可以有效防止过拟合问题。因为不同的网络可能产生不同的过拟合,取平均则有可能让一些“相反的”拟合互相抵消。dropout掉不同的隐藏神经元就类似在训练不同的网络,随机删掉一半隐藏神经元导致网络结构已经不同,整个dropout过程就相当于对很多个不同的神经网络取平均。而不同的网络产生不同的过拟合,一些互为“反向”的拟合相互抵消就可以达到整体上减少过拟合。

(2)减少神经元之间复杂的共适应关系: 因为dropout程序导致两个神经元不一定每次都在一个dropout网络中出现。这样权值的更新不再依赖于有固定关系的隐含节点的共同作用,阻止了某些特征仅仅在其它特定特征下才有效果的情况 。迫使网络去学习更加鲁棒的特征 ,这些特征在其它的神经元的随机子集中也存在。换句话说假如我们的神经网络是在做出某种预测,它不应该对一些特定的线索片段太过敏感,即使丢失特定的线索,它也应该可以从众多其它线索中学习一些共同的特征。从这个角度看dropout就有点像L1,L2正则,减少权重使得网络对丢失特定神经元连接的鲁棒性提高。

(3)Dropout类似于性别在生物进化中的角色:物种为了生存往往会倾向于适应这种环境,环境突变则会导致物种难以做出及时反应,性别的出现可以繁衍出适应新环境的变种,有效的阻止过拟合,即避免环境改变时物种可能面临的灭绝。