Машинное обучение Обзор

1. машинного обучения классификаторов

1,1 контролируемого обучения:

С набором параметров известного классов составляющих скорректированным классификатор для достижения требуемой производительности процесса, также известную как подконтрольная подготовка учителей или обучения. Ведет обучение обучающего набора требований, включая вход и выход, в основном используется в классификации и прогнозирования.

1,2 неконтролируемого обучение:

Обнаружение вытекать из набора данных определенной структуры, структуру, характерных для выборки данных, определение того, какие данные являются весьма схожи.

1,3 полуобучаемого обучения

Руководил и неконтролируемое обучение в сочетание исследование, которое используется на этапе обучения является непомеченным и помеченными данные, а не только узнать структуру отношений между атрибутами, но и выходом модель классификации предсказать.

1.4 Армирование обучение:

Армирование обучение (Армирование обучение, RL), также известное как армирующее обучение, оценки обучения или обучения с подкреплением, является одной из машинного обучения парадигмы и методологии, используемой для описания и решения агента (агент) в процессе взаимодействия с окружающей средой через обучение стратегии для достижения максимальной отдачи от задачи или для достижения определенной цели.

2. Алгоритм машинного обучения

2.1 линейный алгоритм (алгоритмы линейной):

Линейная регрессия (линейная регрессия), Lasso регрессия (Lasso регрессия), хребет регрессия (Ридж регрессия), логистическая регрессия (логистическая регрессия)

2,2 дерева принятия решений (Decision Tree):

ID3, C4.5, CART

2.3 Поддержка Vector Machine (SVM)

2.4 Наивные Байеса (Наивные байесовский алгоритмы):

Наивный Байес (Naive Байес), Наивный Байес гауссовского (гауссовский Наивный Байес), полиномиальный Наивный Байес (мультиномиальный Наивный Байес), вера сеть (байесовский вера сеть, BBN), байесовские сети (байесовская сеть, Б.Н. )

2,5 к ближайшему соседу алгоритм классификации (Knn)

2.6 кластеризации (Кластеризация алгоритмы):

К среднихам, к-Медиана, алгоритм ожидания максимизации (Ожидание Максимизация, ЭМ), иерархическое группирование (Иерархическая кластеризация)

2,7 Random Forest (Random Forest)

2.8 Размерность алгоритм редукции (Размерность Снижение Алгоритмы)

2.9 градиент повышения алгоритм (алгоритмы Градиент Активизации)

GBM, XGBoost, LightGBM, CatBoost

2,10 глубина алгоритм обучения (Deep Learning алгоритмы):

Сверточные нейронные сети (сверточная нейронные сети, CNN), рецидивирующий нейронная сеть (Повторяющийся Neural Networks, RNNs), краткосрочные и долгосрочная перспектива сетевой памяти (Long кратковременной память Сеть, LSTMs), штабелер автоматический датчик (суммированный Auto-кодеры), глубина Больцман машина (глубокая машина Больцмана, DBM), глубина веры сетей (глубокая вера сетей, ДБН)

3. машинного обучения функция потерь

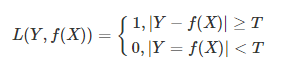

Функция 3.1 0-1 потерь

0-1 Функция потерь также можно ослабить условия, удовлетворяющие | считаются равными, когда <Т, т.е. | Y-F (X):

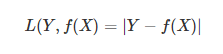

Функция потерь 3.2 абсолютное значение

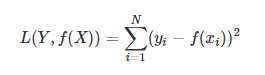

3.3 квадратная функция потерь

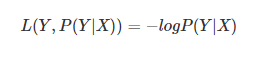

Логарифмическая функция потерь

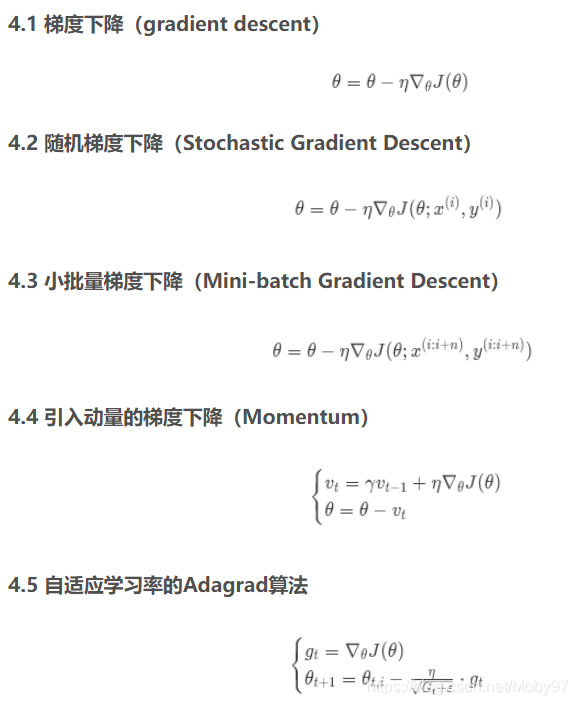

4. Способ оптимизации машинного обучения