ОТ РЕДАКЦИИ

Рептилий чувствовать себя учебный процесс должен привести в порядок после вступления, но и оставить след его.

Scrapy также настроить среду собственного Baidu, на самом деле, это не сложно (только для окна системы, конфигурации CentOS в течение двух дней, до сих пор не поняло все)

После установки питона загрузки пип, пип установки, Пип установки, а затем загружены на линии (pyspider так настроен).

Основная информация адрес ссылки прилагается

Scrapy учебники адрес https://www.bilibili.com/video/av13663892?t=129&p=2

затмить развития Scrapy https://blog.csdn.net/ioiol/article/details/46745993

Прежде всего, чтобы убедиться, что хост настроен затмение, питон там пип среды

Метод монтажа рамы Scrapy

Введите CMD интерфейс

:: команда обновления пип

пункт установить --upgrade пип

:: пункт установить Scrapy

пип intall SCRAPY

После завершения установки, вы можете использовать

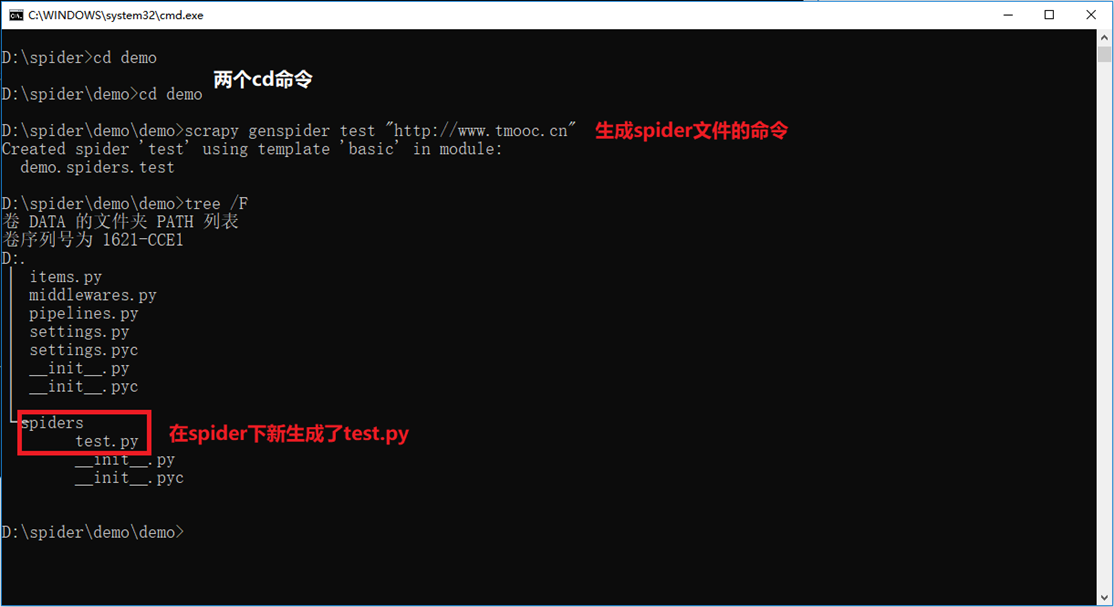

CMD среда демонстрационный процесс создал SCRAPY

Во-первых, создать каталог, случайное местоположение, а затем войти в каталог, введите командный режим для просмотра Scrapy

startproject создать команду проекта. Проект формат имени SCRAPY startproject

genspider создать команду гусеничной, проект может иметь несколько сканеров. Формат SCRAPY имя genspider рептилий (и не может проецировать то же имя) гусеничные IP - адрес начального значения

Цель состоит в том, чтобы получить содержание дома tmooc боковой панели (вспомогательный текст дочернего элемент дочерних элементов пролета)

tmooc Главная

Sidebar содержание

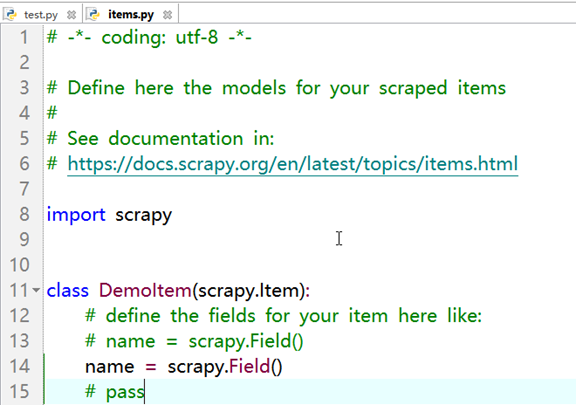

Редактировать item.py, позиция паук в каталоге на том же уровне (код просто не вставить код а)

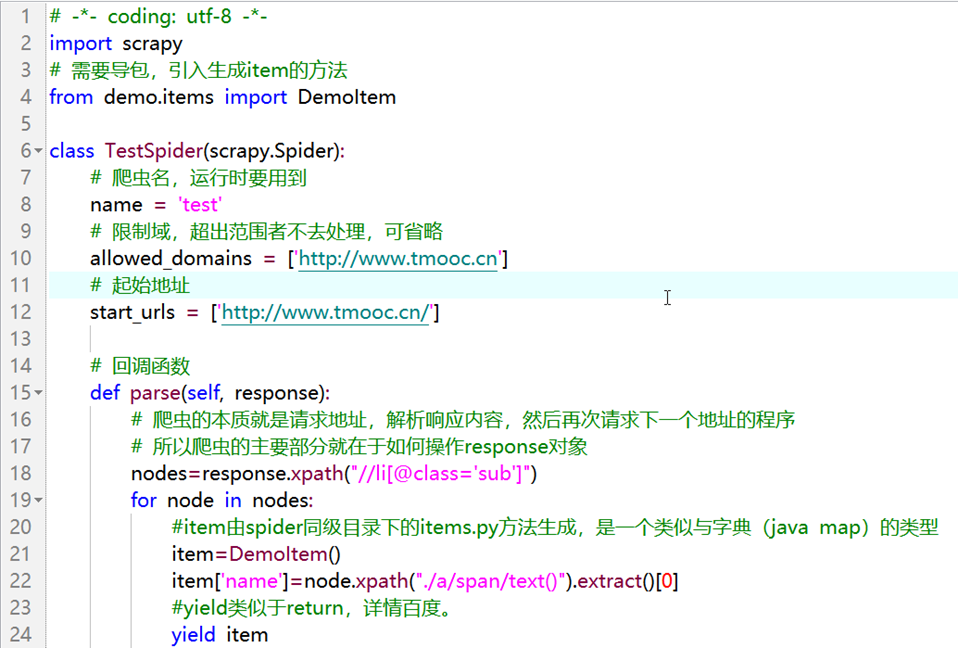

Редактировать test.py

раздел кода

# - * - кодирование: UTF-8 - * -

импорт SCRAPY

# Лидер пакета необходимо, метод вводится для создания элемента

от demo.items импорта DemoItem

Класс TestSpider (scrapy.Spider):

# Reptile имя для использования при работе

Name = 'тест'

# Ограниченную домен, не выходит за рамки процесса, может быть опущены

allowed_domains = [ ' http://www.tmooc.cn ']

# Начальный адрес

start_urls = [ ' http://www.tmooc.cn/ ']

# Обратный вызов функции

Защита синтаксического анализа (я, ответ):

# Reptile характер программы является рассмотрение запроса, разобрать ответ, а затем запросить следующий адрес еще раз

# Таким образом, основная часть рептилий заключается в том, как работать с объектами реагирования

узлы = response.xpath ( "// Ли [@ класс = 'суб']")

для узла в узлах:

#Item, сгенерированный способом паука items.py в том же самом каталоге, похож на словарь (Java карты) Тип

Пункт = DemoItem ()

Пункт [ 'имя'] = node.xpath ( "./ а / SPAN / текст ()"). извлечения () [0]

#yield подобного возвращения, деталь Baidu.

пункт выход

Компиляция test.py, запустить паук

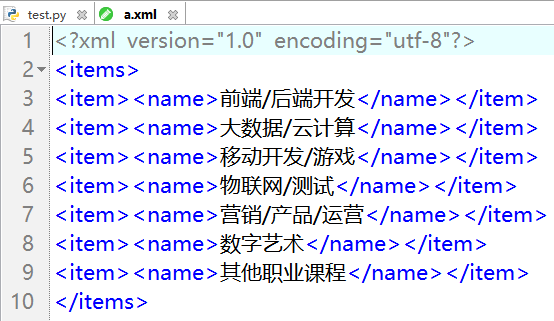

сканирование выполняются команды паука. Название Формат SCRAPY ползать рептилия [-o имя файла]

-o параметры Кроме того , роль данных , хранящихся в паука ползать. Хранится в команде операции каталог может быть сохранен в формате CSV (Excel таблицу) JSon jsonl XML ... другие форматы

Результаты показывают,

затмение развития Scrapy паук проект

Во-первых, чтобы обеспечить там среда разработки питон затмение

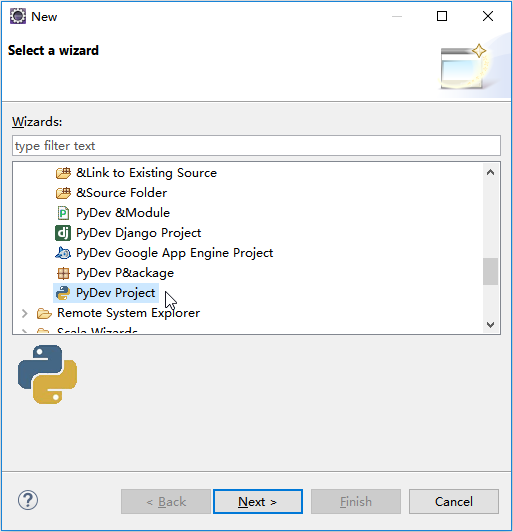

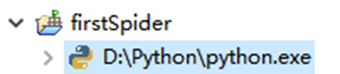

Новый проект питона, вариант по умолчанию,

Создать хорошую структуру каталогов

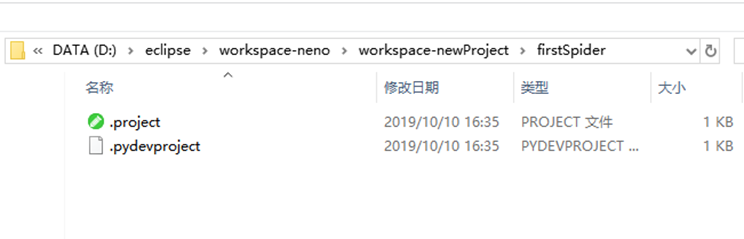

В локальной рабочей области найдите папку проекта

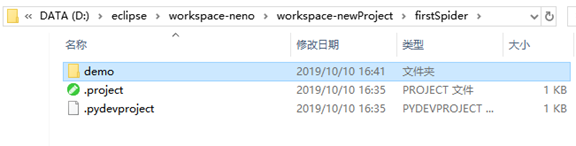

SCRAPY проект только что созданный каталог копируется, не начать создавать эту папку

Демо-каталог

Скопировать в

Каталог проектов. Не забудьте удалить последний прогон файла результатов

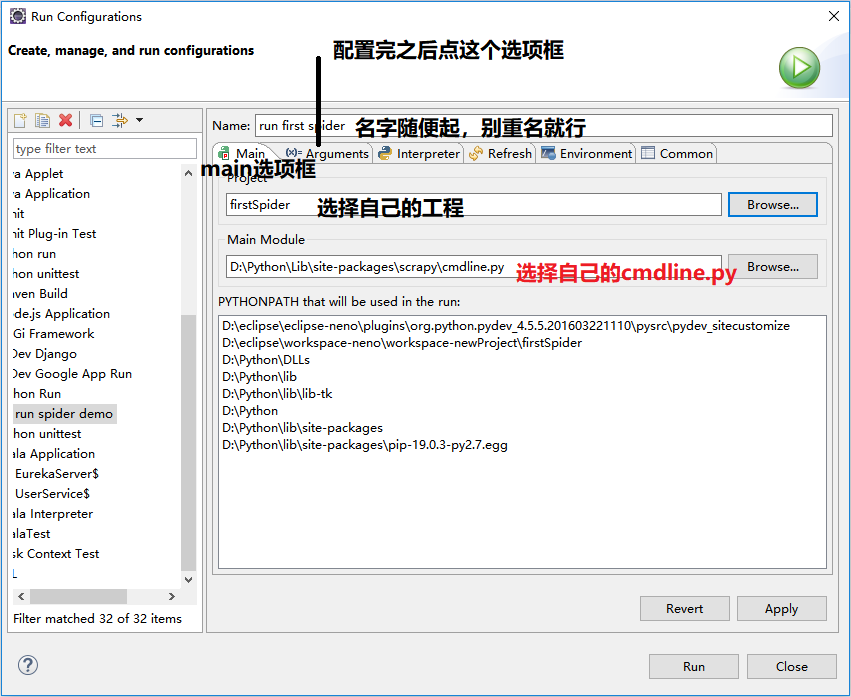

Выполнить -> запустить configuretion ->

Операционные результаты