Для того, чтобы решить проблему неполного знания карты триплета (KG) в данном описании в сочетании с фигами взвешенных сверточной нейронной сетью (WGCN) и двумя модулями ко-Transe предложенных SACN (структура-зависимой сверточных сеть) модель. SACN моделируется KG WGCN сущностей и связей в выделенных физических характеристиках, а также физический вход манипуляции с удобст КГ удовлетворяет ограничения триплетов, в результате сущности встраивания фиг. Экспериментальные результаты показывают, на FB15k-237 наборов данных и WN18RR, чем на 10% до достижения наилучших результатов модели, текущая модель СОТА.

Опубликовано в AAAI 2019, следующую информацию:

- введение

Во-первых, краткое введение в базе знаний (Knowledge Base, KB). Знания в области знаний, существует множество различных форм, такие как совокупность знаний, а также знания, базы правил и прецедентных знания. По сравнению с концепцией базы знаний, карты знаний (Knowledge Graph, KG), чтобы больше сосредоточиться на построении актуальности знаний. Основной метод состоит в использовании определяется КГ (с, г, о) троек, например, капитал Китай Пекина, то предложение может быть представлены тройками: (с = Пекин, г = IsCapitalOf, о = Китай). В котором ы называется первым объектом, г называется зависимость, о является сущностью хвоста. База знаний статья полный набор задач относится к укомплектовать Graph знаний троек.

Затем, после определения троек с задачей, как описано здесь, могут быть: даны КГ, обучение, встроенные объектов и отношений представительства, для завершения выполнения задачи троек (с, г, о), то есть, данными лица, головы и отношения, для наиболее вероятно хвостовых лиц.

- метод

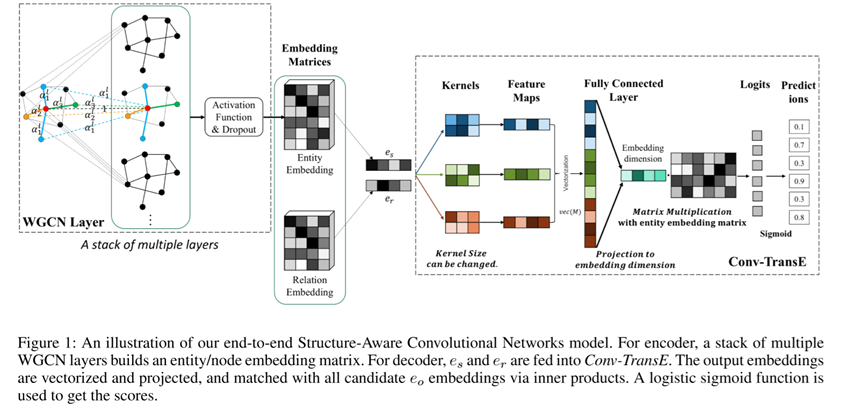

WGCN общих рамки для модели объекта вложения модуля экстракты говорят, вложение объект затем представить в виде модуля ввода ко-Transe встретил Loss тройных ограничения для обучения всей сети. Как показано на рисунке 1 общие рамки.

Здесь, до введения этой статьи будет модулем WGCN ко-Transe и распространяется последовательно.

Здесь, до введения этой статьи будет модулем WGCN ко-Transe и распространяется последовательно.

1. WGCN

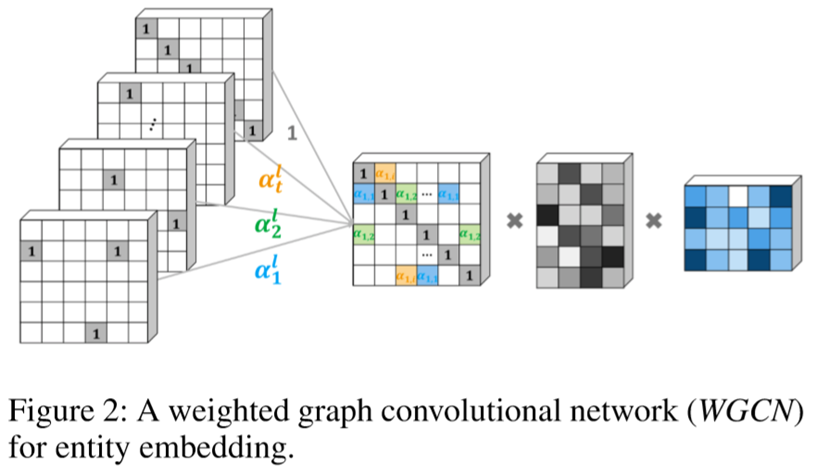

Как следует из названия, WGCN означает Взвешенный граф сверточных сети, фиги условно называются взвешенной сверточной нейронной сетью. Основная идея заключается в определении различного веса, тем более, чем одну единственной схемы на нескольких диаграмм с различной прочностью связи между различными сторонами отношений. На фигуре узлов, составляющая сущность, ребро графа взаимосвязи между объектами.

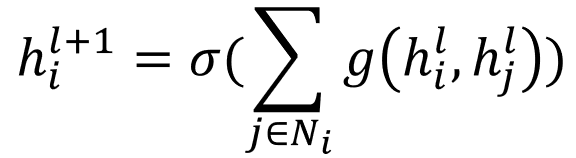

Классическое определение GCN воспоминаний, основная идея заключается: в качестве центрального узла каждого узла полимеризации, для каждого узла центра, полимерные слои, в котором присутствует соседние узлы сказали функция, представленная в качестве центрального узла следующего слоя, то есть,

Где, N - я обозначает множество соседей я-узлов (I-узлов , включая себя), H л векторов , которые экспрессируют узел л слоя. г (·, ·) представляет собой функцию передачи информации, основной метод , как определено

![]()

![]()

Суммируя операции, вектор из соседних узлов представляет собой линейное преобразование, чтобы разделить центральный узел, чтобы достичь операцию полимеризации GCN слоя. GCN стека слоя слой за слоем, чтобы быть реализован перед передачей. Стоит отметить, что каждый информационный сосед GCN полимеризуется, полимеризация первого слоя после информации соседней первого порядка, когда второй слой полимеризуется соседи, его сосед узлы имеют информацию о соседних узлах соседних узлов , второй информационный полимерный слой GCN соседи второго порядка. Чем больше количество слоев сложены GCN, агрегированные центральный узел соседей более обширный ассортимент. Более конкретное описание можно найти [1].

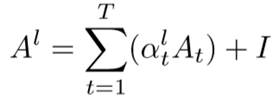

Затем мы вернулись к основной линии, основное отличие WGCN классического GCN есть, для каждого моделирования отношений знаний Graph, различные отношения к процессу полимеризации с различными весами. Она определяется как весовой [альфа] T , 1≤t≤T, где Т представляет собой общее количество отношений. [Альфа] Т , чтобы быть параметрами. Поэтому , прежде чем вы можете написать итерационной формуле

Отличающееся тем, что г (·, ·) обозначает функцию по передаче информации, определяется так же, как

![]()

Таким образом, мы будем центральный узел и соседние узлы разделены, можно записать в виде

Запишите его в матричной форме, то

其中,At表示第t个关系构成的0-1邻接矩阵,0为无边相连,1为有边相连。因此,形式上就又回到了原始的GCN递推公式【1】

![]()

这样我们便将一个多关系图转变成了多个具有不同强弱关系的单关系图,如Figure 2所示,图的右侧分别对应矩阵A、H、W。这便是WGCN的巧妙之处。

另外,关于KG在WGCN中的建图,使用实体作为图的节点,关系作为图的边。值得说明的是,本文还使用了节点的属性作为图的节点,如属性(Tom,gender,male)。这样做的目的是将属性也作为节点,起到“桥”的作用,相同属性的节点可以共享信息。还有作者为了减少过多的属性节点,对节点进行了合并, 将gender也作为了图中的节点,而不是建立male和female两个属性,理由是gender已经能够确定实体的person,而不必过多区分性别。

因此,WGCN同时使用了三元组的结构信息和实体的属性信息,也就是标题中的structure-awared。

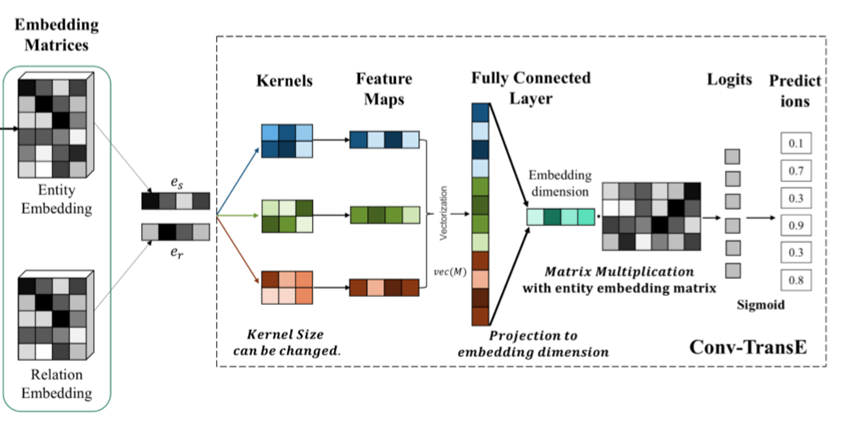

2. Conv-TransE

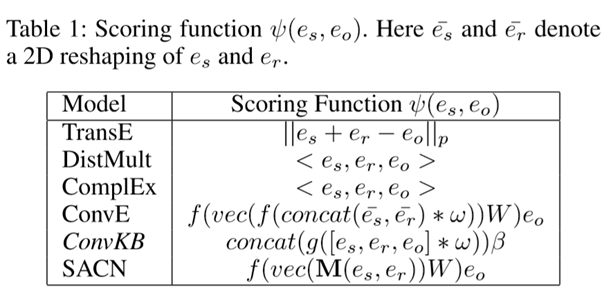

Conv-TransE这个部分类似于ConvE【2】,通过对(s, r)和o进行相似度打分,来预测关系是否成立。与ConvE的主要区别是去掉了ConvE中的reshape操作,具体可以参看文献【2】。这里给出经典的KG表征学习的打分函数。

来看模型结构,如图所示。

举例来说,将WGCN得到的实体s的embedding和预训练的关系r的embedding进行concat操作,变成一个2*n维的矩阵。对这个矩阵进行卷积操作,通过多个相同尺寸的卷积核,得到feature maps。然后将feature maps拉直成一个向量,通过全连接层进行维度缩减。将这个融合了s和r的向量与WGCN生成的所有向量分别进行点积操作,计算(s,r)与所有待选o的相似度。相似度通过sigmoid缩放到0~1范围内,取相似度最高的作为预测的实体o。

打分函数(相似度函数)体现了前向传播的过程,公式形式为

![]()

M(·, ·)表示卷积操作,vec(·)表示拉直操作,f(·)为激活函数。

将打分函数通过sigmoid函数,得到(s, r)和待选o构成三元组成立的概率,即

![]()

因此,整个网络的损失也就可以定义为,(s, r)和待选o构成三元组是否成立的二分类交叉熵,即

![]()

- 数据集

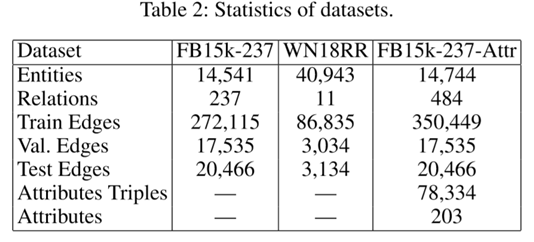

文中共使用了三个数据集,包括:

1)FB15k-237: freebase三元组

2)WN18RR: wordnet三元组

3)FB15k-237-Attr:作者从FB24k中抽取了实体的属性

具体的统计信息如下:

- 实验

文章进行了链接预测任务的实验,实验结果如表3。可以看到,带有属性节点的SACN性能表现达到了State-Of-The-Art。

参数敏感性部分,文章尝试了不同长度的卷积核,针对不同的数据集有不同的最优参数。

文章还对不同的度的节点的性能进行了比较,可以看到,在度较低的节点下是SACN高于Conv-TransE的,因为邻居节点可以共享更多的信息;然而度较高的节点则效果不如单独的Conv-TransE,文章对它的解释是较多的邻居节点使较重要的邻居信息被过度“平滑”掉了,因此比不上单纯的Conv-TransE。

- 结束语

作者用WGCN来捕获具有相关关系的实体特征,使邻居节点的信息得以共享,这样学到的实体表示要好于孤立的学习ConvE得到的实体表示。本质上是GCN+ConvE的模型框架,这种串联的框架对其他类似的任务也有启发性。另外的体会是深度学习方面的研究,还是要多读论文多总结。好的,做完了这篇博客,相信事情总可以一件一件一件的做完!

参考文献

【1】Kipf, T.N., & Welling, M. (2016). Semi-Supervised Classification with Graph Convolutional Networks. ArXiv, abs/1609.02907.

【2】Dettmers, T., Minervini, P., Stenetorp, P., & Riedel, S. (2017). Convolutional 2D Knowledge Graph Embeddings. AAAI.