Fonte do artigo Editor Xinzhiyuan: Taozi

【Guia】 Enciclopédia Baidu: "Cinemagraph, a tecnologia mágica de movimento sutil em fotos estáticas. Como o nome sugere (cinema é fotografia cinematográfica, gráfico são imagens) é uma combinação de fotografia dinâmica e imagens estáticas. Esta arte fluiu pela primeira vez do site cinemagraphs , dos artistas de Nova York Jamie e Kevin."

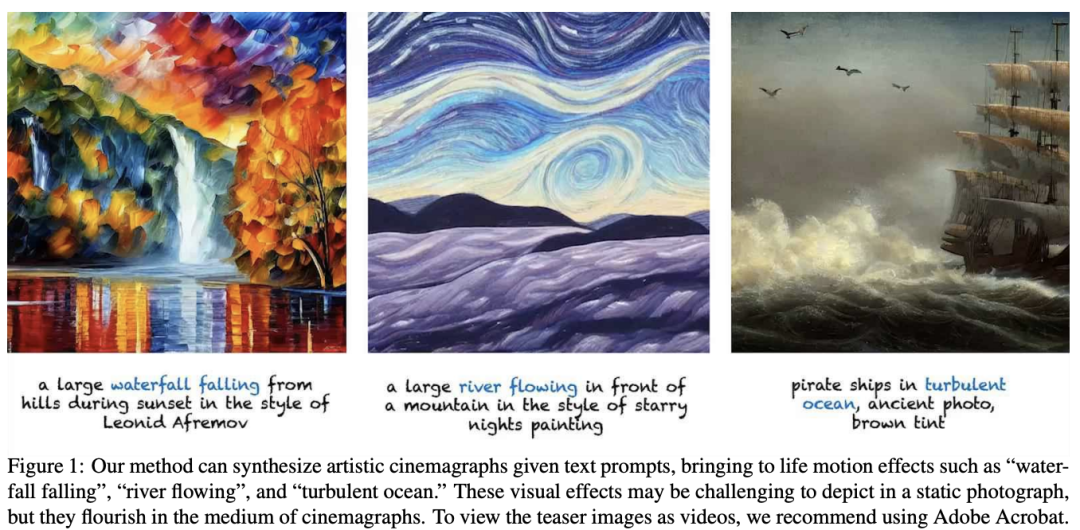

O mais recente modelo de IA, Text2Cinemagraph, pode animar obras de mestres de arte com apenas uma linha de texto.

O novo artigo do chefe do CV, Zhu Junyan, fez os animadores se sentirem em perigo.

É necessária apenas uma frase e o modelo pode gerar uma animação com estilo consistente e excelente qualidade.

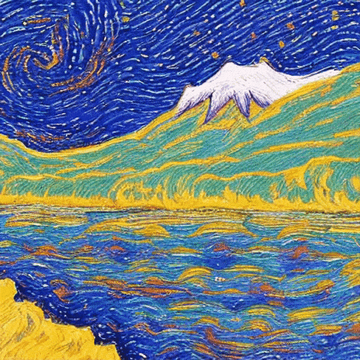

Usando a Noite Estrelada de Van Gogh como referência, crie a imagem de um riacho fluindo em frente a uma montanha.

Ou, no estilo de Afremov, crie uma paisagem de cachoeiras que descem das montanhas.

Recentemente, pesquisadores da CMU e do Snap Institute construíram um método totalmente automático para criar imagens de filmes a partir de descrições de texto - Text2Cinemagraph.

Endereço do artigo: https://arxiv.org/pdf/2307.03190.pdf

Além disso, os pesquisadores demonstraram duas extensões, animando desenhos existentes e usando texto para controlar a direção do movimento.

Por que não assistimos a uma demonstração primeiro?

greves de demonstração

A direção do fluxo acima da Noite Estrelada de Van Gogh pode ser controlada movendo a boca.

Por exemplo, da esquerda para a direita.

Depois, da direita para a esquerda.

Mesmo estilo, paisagem diferente.

Qualidade de filme, navegando no mar.

Ao pôr do sol, no estilo da pintura de Van Gogh, uma grande cachoeira cai entre os morros, 4K.

Estilo Picasso, uma cabana de madeira com um barco flutuando no lago.

Ilustração ultra-realista de um farol sendo atacado por um monstro marinho e tentáculos envolvendo toda a torre.

Cena surreal e fantástica da cachoeira

Projeto Text2Cinemagraph

Atualmente, os métodos existentes de animação de imagem única são insuficientes em termos de contribuição artística.

Embora os métodos de vídeo baseados em texto de última geração frequentemente introduzam inconsistências temporais, tornando difícil manter certas regiões estáticas.

Para enfrentar esses desafios, os pesquisadores propõem a ideia de sintetizar imagens gêmeas, ou seja, um par de imagens artísticas e seu alinhamento de pixels, a partir de uma única sugestão de texto.

As imagens artísticas retratam o estilo e a aparência detalhados nas instruções de texto, enquanto as imagens realistas simplificam bastante o layout e a análise de movimento.

Usando conjuntos de dados naturais de imagens e vídeos existentes, o Text2Cinemagraph pode segmentar com precisão imagens realistas e prever movimentos plausíveis com base em informações semânticas.

O movimento previsto pode então ser transferido para imagens artísticas para criar a animação cinematográfica final.

Especificamente, dada uma sugestão textual c, a Difusão Estável é usada para gerar imagens gêmeas, uma imagem artística x no estilo descrito na sugestão textual e uma contraparte realista  usando a sugestão modificada

usando a sugestão modificada  . As imagens siamesas têm layouts semânticos semelhantes.

. As imagens siamesas têm layouts semânticos semelhantes.

Os pesquisadores então extraem máscaras binárias M de regiões de movimento dos mapas de autoatenção obtidos durante a geração de imagens artísticas.

Use máscaras e imagens realistas para prever fluxo óptico  e modelos de previsão de fluxo

e modelos de previsão de fluxo  .

.

Como as imagens gêmeas têm layouts semânticos muito semelhantes, fluxo óptico  e geradores de vídeo podem ser usados

e geradores de vídeo podem ser usados  para animar imagens artísticas.

para animar imagens artísticas.

Vale ressaltar que todos os experimentos deste estudo são baseados na Difusão Estável.

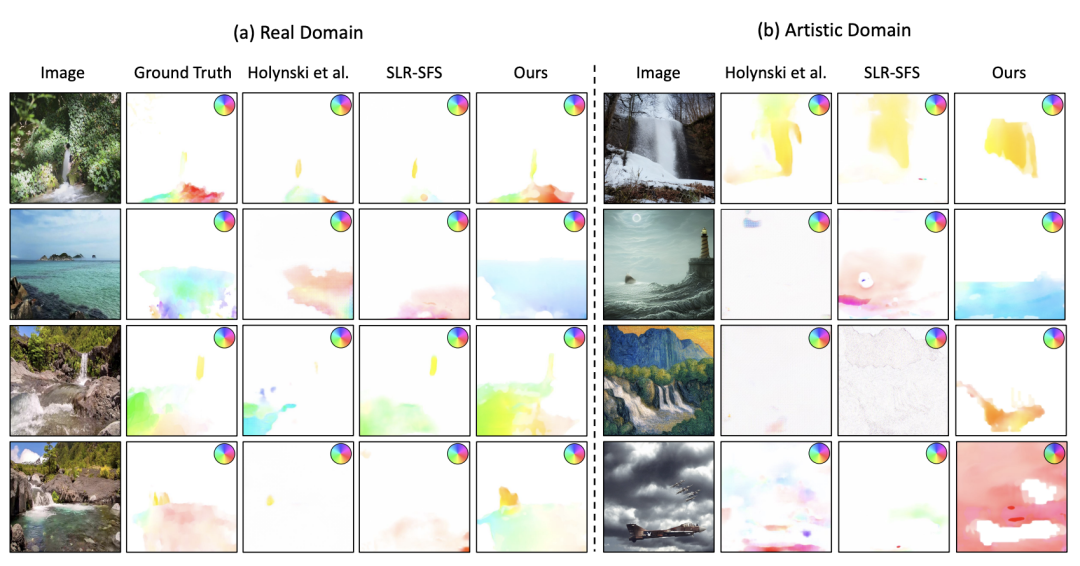

Os pesquisadores compararam o efeito real do fluxo óptico.

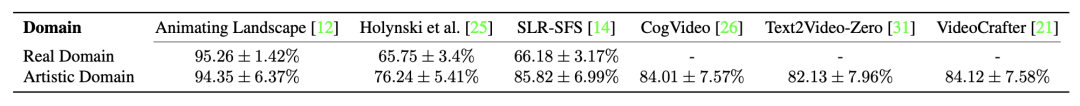

Média do fluxo óptico verdadeiro em todos os quadros no Text2Cinemagraph em comparação com SLR-SFS, abordagem de pesquisa de animação de imagem única de Holynski et al.

No geral, o método de última geração prevê movimentos mais plausíveis que melhor correspondem à região alvo.

Além disso, através da pesquisa de preferências do usuário, a maioria dos participantes é a favor do Text2Cinemagraph.

Por fim, os pesquisadores também demonstraram duas extensões: animar desenhos existentes e usar texto para controlar a direção do movimento.

Animar uma pintura existente

A seguir está A Nona Onda (1850) exibida no Museu Russo.

Óleo sobre tela Minnehaha Falls, de Albert Bierstadt.

Sobre o autor

Jun-Yan Zhu

Zhu Junyan é atualmente professor assistente no Instituto de Robótica da Escola de Ciência da Computação da CMU e é pioneiro na aplicação do aprendizado de máquina moderno no campo da computação gráfica.

Antes de ingressar na CMU, ele foi pesquisador na Adobe Research.

Ele fez pós-doutorado no MIT CSAIL, trabalhando com William T. Freeman, Josh Tenenbaum e Antonio Torralba.

Ele também recebeu seu doutorado pela UC Berkeley sob a supervisão de Alexei A. Efros. E recebeu o diploma de bacharel pela Universidade de Tsinghua, trabalhando com Zhuowen Tu, Shi-Min Hu e Eric Chang.

Referências:

https://text2cinemagraph.github.io/website/

Preste atenção na conta oficial [Machine Learning and AI Generation Creation], coisas mais interessantes estão esperando por você para ler

Explicação detalhada do ControlNet, um algoritmo controlável de geração de pintura AIGC!

O GAN clássico deve ser lido: StyleGAN

Clique em mim para ver os álbuns da série GAN ~!

Clique em mim para ver os álbuns da série GAN ~!

Uma xícara de chá com leite, torne-se a fronteira da visão AIGC + CV!

O resumo 100 mais recente e completo! Gerar modelos de difusão Modelos de difusão

ECCV2022 | Resumo de alguns artigos sobre geração de rede de confronto GAN

CVPR 2022 | Mais de 25 direções, 50 artigos GAN mais recentes

ICCV 2021 | Resumo dos artigos do GAN sobre 35 tópicos

Mais de 110 artigos! CVPR 2021 penteado de papel GAN mais completo

Mais de 100 artigos! CVPR 2020 mais completo penteado de papel GAN

Desmontando o novo GAN: dissociando a representação MixNMatch

StarGAN versão 2: geração de imagens de diversidade multidomínio

Download em anexo | Versão chinesa de "Explainable Machine Learning"

Download em anexo | "Algoritmos de aprendizado profundo do TensorFlow 2.0 na prática"

Download em anexo | Compartilhar "Métodos Matemáticos em Visão Computacional"

"Uma revisão dos métodos de detecção de defeitos de superfície baseados em aprendizagem profunda"

Uma pesquisa sobre classificação de imagens Zero-Shot: uma década de progresso

"Uma pesquisa de aprendizagem rápida baseada em redes neurais profundas"

O "Livro dos Ritos · Xue Ji" tem um ditado: "Aprender sozinho, sem amigos, é solitário e ignorante."

Clique em uma xícara de chá com leite e torne-se o líder da visão AIGC + CV! , junte-se ao planeta da criação gerada por IA e do conhecimento de visão computacional!