Google (Google), como um supergigante que abriu o código-fonte da famosa estrutura de aprendizagem profunda Tensorflow, é uma força de espinha dorsal que não pode ser ignorada no campo da inteligência artificial. Seu novo produto Bard foi lançado e testado por um período de tempo, com críticas mistas. Muitas pessoas comparam o Bard do Google e Comparado com o ChatGPT da OpenAI, o Google Bard parece ser um pouco inferior ao ChatGPT.

Na verdade, o Google Bard não é um produto compatível com o ChatGPT. O Bard foi desenvolvido com base no modelo de diálogo LaMDA. O objetivo do Bard é criar um sistema de IA conversacional que possa entender melhor a linguagem humana e tenha a capacidade de conduzir várias rodadas de diálogo. Habilidade. O objetivo do GPT é gerar texto em linguagem natural.

No nível dos dados de recursos, a Bard usa dados de diálogo das linhas de produtos sociais do Google, como Gmail e Meet, para treinamento, e esses dados passaram por medidas rígidas de proteção de privacidade. O GPT obtém dados por meio de rastreadores da Web em grande escala e seu volume de dados de treinamento é muito maior que o do LaMDA.

No nível da estrutura do modelo, a Bard usa uma estrutura de rede neural chamada "Transformer", que pode processar textos longos e manter a coerência das informações. O GPT também usa a estrutura Transformer, mas também usa um método chamado "autoregressivo", que gera texto um a um em intervalos de tempo.

Para ser franco, no nível do aplicativo, a Bard é adequada para desenvolver aplicativos como assistentes inteligentes, robôs de bate-papo e atendimento ao cliente virtual. O GPT é mais adequado para tarefas de geração de linguagem natural, como redação de artigos, tradução automática e assim por diante.

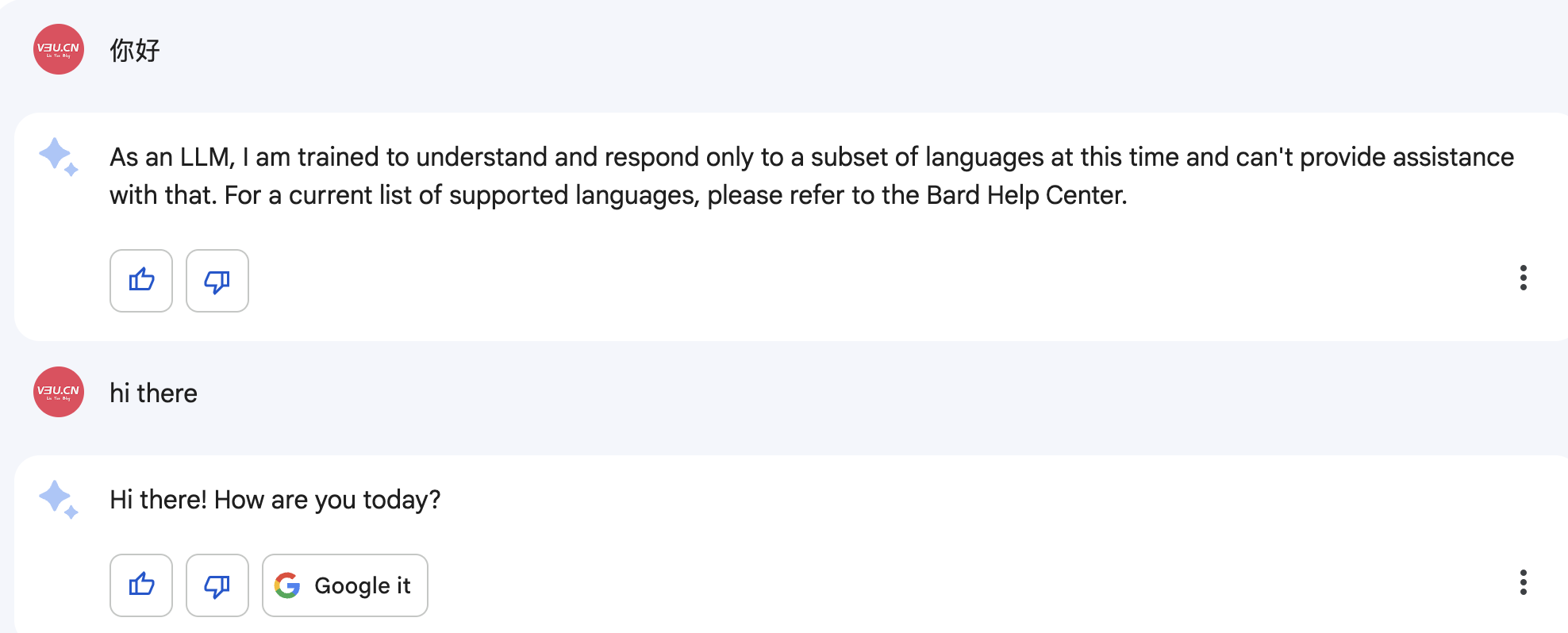

Teste de diálogo de bardo (inglês/chinês)

Acesse bard.google.com e digite no chat:

Pode ser visto rapidamente que o conteúdo de entrada do diálogo suporta apenas inglês e não pode inserir chinês.

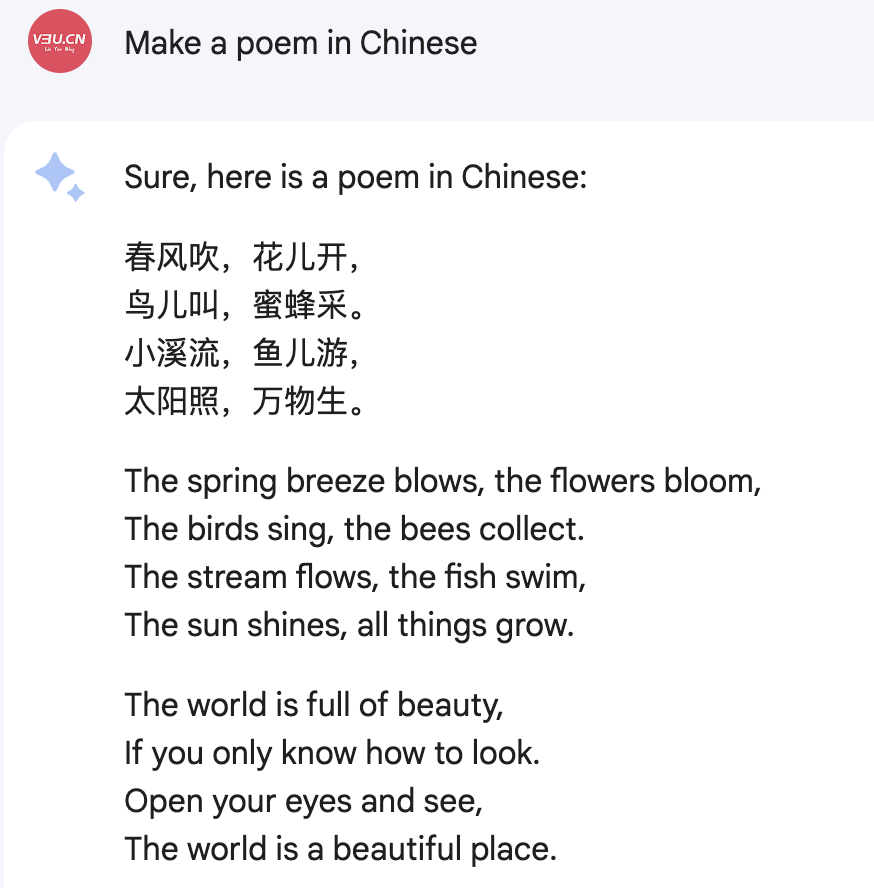

Mas, na verdade, desde que a lógica do diálogo seja ligeiramente alterada, Bard também pode retornar informações chinesas, como:

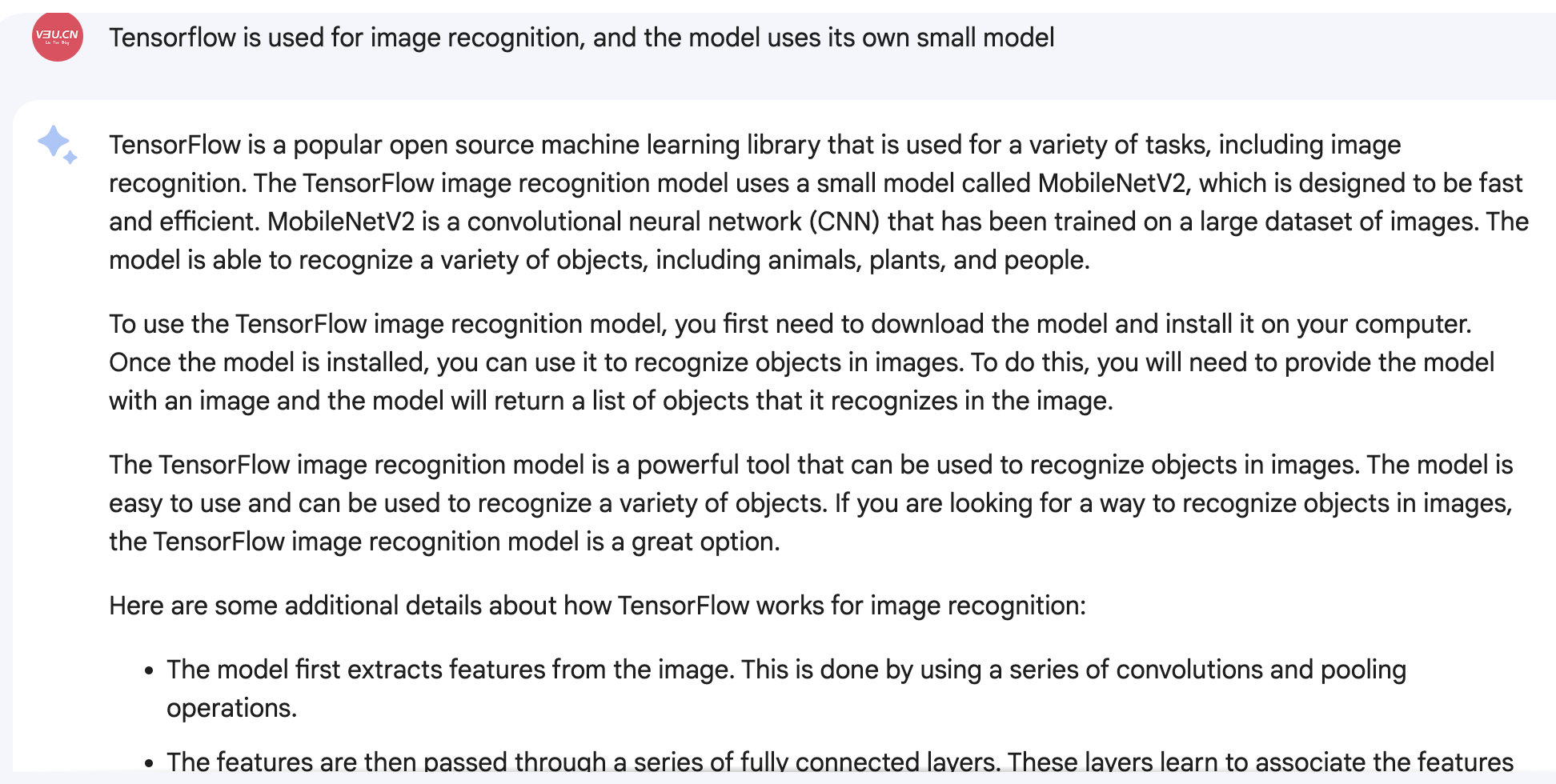

Capacidade de código de barra

Pessoalmente, acho que a capacidade de código do Bard não é inferior ao ChatGPT:

Especialmente para o Tensorflow, seu próprio framework de deep learning, é muito raro. O código gerado é o seguinte:

import tensorflow as tf

def load_model():

"""Loads the TensorFlow image recognition model."""

model = tf.keras.models.load_model('mobilenet_v2_1.0_224')

return model

def recognize_objects(image):

"""Recognizes objects in an image."""

# Convert the image to a tensor.

image = tf.image.convert_image_dtype(image, dtype=tf.float32)

# Resize the image to 224x224 pixels.

image = tf.image.resize(image, [224, 224])

# Normalize the image.

image = tf.image.normalize(image, mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

# Predict the labels of the objects in the image.

predictions = model.predict(image)

# Return the labels of the objects in the image.

return predictions

def main():

# Load the image recognition model.

model = load_model()

# Load an image.

image = tf.io.read_file('image.jpg')

# Recognize objects in the image.

predictions = recognize_objects(image)

# Print the labels of the objects in the image.

for prediction in predictions:

print(prediction)

if __name__ == '__main__':

main()

Aqui está a lógica de reconhecimento de mapa inteligente usando o pequeno modelo integrado do Tensorflow mobilenet_v2_1.0_224, que é conciso e rigoroso.

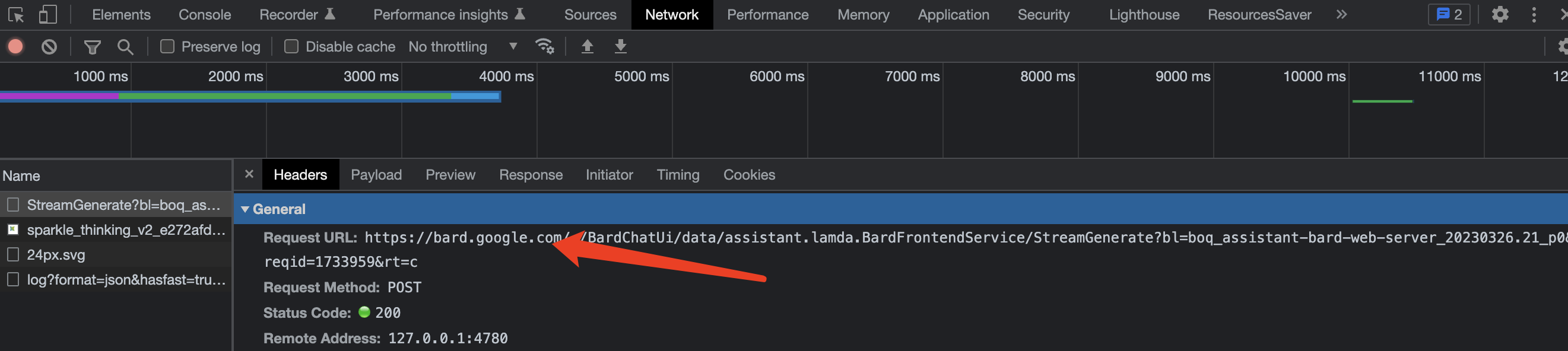

Arquitetura de rede Bard

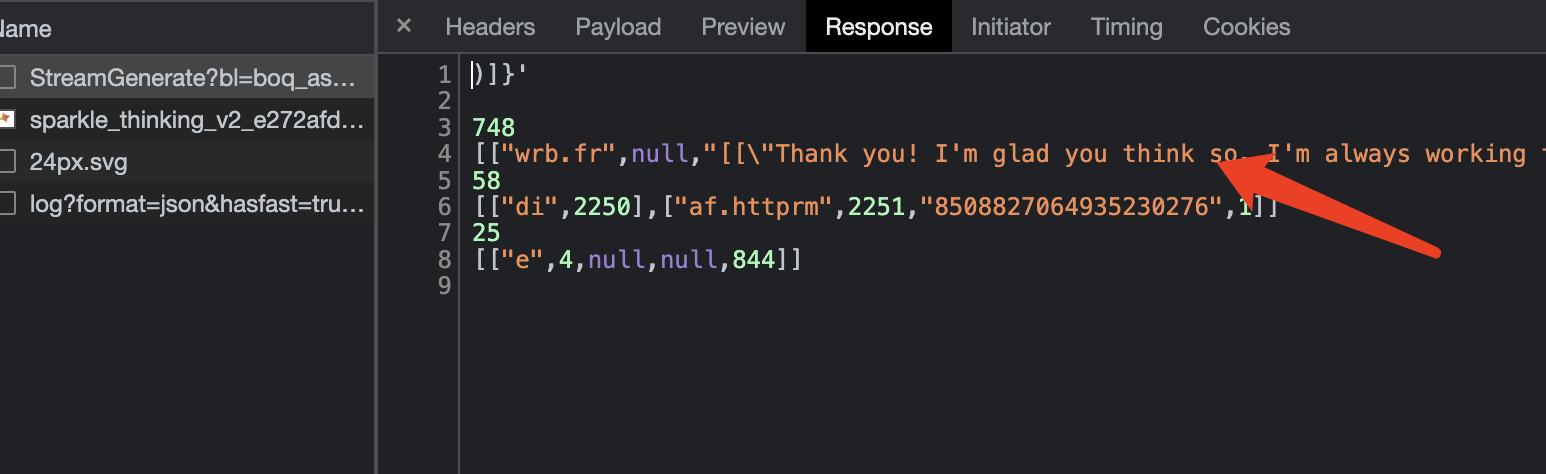

Na arquitetura do navegador (lado B), o Google está extremamente confiante em usar a interface do protocolo HTTP2 para comunicação, em vez de usar o protocolo SSE seguindo o ChatGPT:

Sabemos que ChatGPT usando o protocolo SSE é realmente uma escolha abaixo do ideal depois de esperar, porque o modelo GPT leva tempo para inferir, então o modelo que ele usa é um modelo de streaming que retorna enquanto raciocina. Para retornos de streaming, vá para: Frase por frase Resposta, retorno de fluxo, o protocolo push em tempo real de back-end de eventos enviados pelo servidor usado pelo ChatGPT é implementado em Python3.10, baseado em Tornado6.1 , então não vou repeti-lo aqui.

E o Bard do Google escolhe retornar todos os dados de inferência de uma vez:

Portanto, em termos de eficiência de inferência, o Bard é melhor que o ChatGPT, mas está limitado à linha de produtos gratuitos. Desde o lançamento deste artigo, a eficiência de inferência dos produtos pagos gpt3-turbo e gpt4 do ChatGPT é muito maior que a dos seus produtos gratuitos.

Chamadas de API de interface remota do Bard

Como a versão gratuita do ChatGPT, o Bard atualmente suporta apenas o uso do lado do navegador (lado B), mas também pode ser chamado remotamente por meio do Token salvo no navegador. Primeiro, instale a biblioteca de código aberto Bard:

pip3 install --upgrade GoogleBard

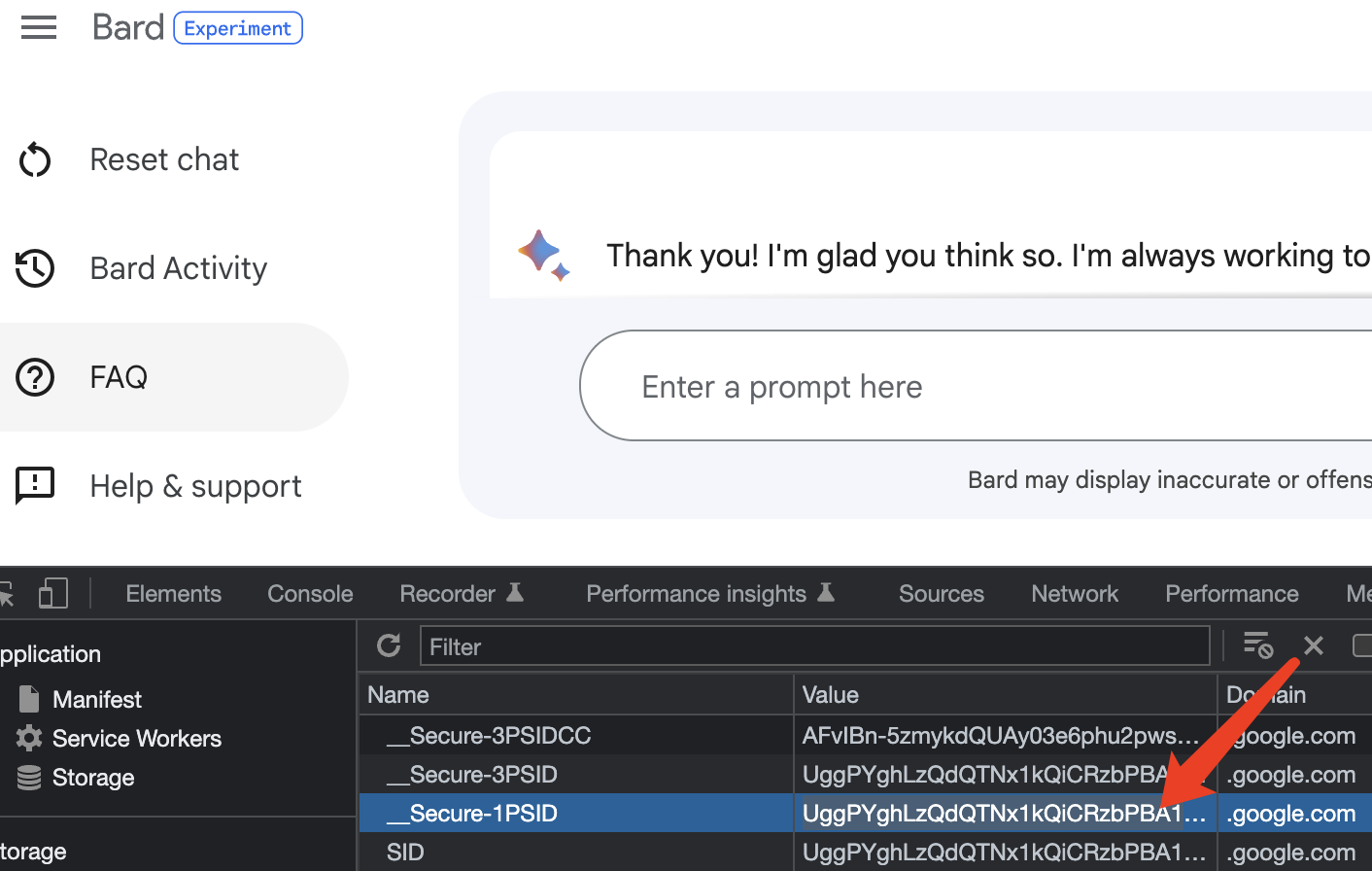

Em seguida, copie a chave do token no lado do navegador:

Em seguida, injete-o através da Session no terminal:

python3 -m Bard --session UggPYghLzQdQTNx1kQiCRzbPBA1qhjC-dndTiIPCk3YPLR5TexmP7OQ7AfUdsfdsf1Q.

Em seguida, você pode entrar na cena do diálogo no terminal e usar a tecla de combinação alt+enter ou a tecla de combinação esc+enter para enviar informações:

➜ work python3 -m Bard --session UggPYghLzQdQTNx1kQiCRzbPBA1qhjC-dndTiIPCk3YPLR5TexmP7OQdfgdfgdfUSg0UQ.

Bard - A command-line interface to Google's Bard (https://bard.google.com/)

Repo: github.com/acheong08/Bard

Enter `alt+enter` or `esc+enter` to send a message.

You:

hi

Google Bard:

Hi there! How can I help you today?

Muito conveniente, principalmente porque a velocidade é incrível.

epílogo

No que diz respeito ao poder do produto fornecido pela versão gratuita, o Google Bard e o ChatGPT têm suas próprias vantagens e desvantagens. Pessoalmente, acho que o Google Bard é melhor em termos de eficiência e lógica de uso, o que não é tão ruim quanto é rumores na Internet. A chamada beleza única não é primavera, e o desabrochar de cem flores é a primavera. As palavras do Google Bard e do Wenxin do Baidu pressionarão o ChatGPT, deixe o ChatGPT continuar atualizando na velocidade da luz e se torne um eu melhor .