最近、ドイツの自動車業界専門誌 HANSERautomotive は、自動運転分野における Inspur 情報アルゴリズム チームによる主要な進歩に関する特別署名記事「Wahrnehmungssysteme und 3D-Objekterkennung Alles im Blick」(「知覚システムと 3 次元オブジェクト」)を発表しました。認識、オールインワン" ) .眼底")。自動運転の産業化における AI 認識技術の変革的な重要性に対して、「HANSERautomotive」の記事は、「自動運転の分野における重要な中核タスクとしての 3D ターゲット検出は、強力な環境認識を重視しており、高度な技術を備えている」と指摘しました。 AI アルゴリズムと融合アーキテクチャの知覚テクノロジーは、非常に堅牢かつ高精度のターゲット検出を実現するために重要な情報入力を提供します。また、プラットフォームのコンピューティング能力と知覚アルゴリズムにおける効率の向上と革新的なブレークスルーも、自動車会社が自動運転機能を開発するための重要なテクノロジーとなっています。 」

現在、世界的に権威ある自動運転nuScenesコンペティションの最新評価において、 Inspur情報アルゴリズムチームが提出した「 IEI-BEVFusion++」アルゴリズムモデルが主要指標であるnuScenes検出スコア(NDS)で77.6%という高スコアを達成し、 3D ターゲット検出記録、これまでのトラック全体で最高の結果。

[HANSERautomotive は、ドイツのトップカーエレクトロニクス業界メディアとして、カーエレクトロニクスの開発、プロジェクト、アプリケーション、テストの分野でエンジニアに力を与え続け、業界幹部や世界の自動車分野の最も重要な関係者に製品、システムを提供することを目指しています。 , 通信/データ通信、消費者、産業などの業界分野でより適切な意思決定を行うためのトレンドと最新の出来事。】

「 HANSERautomotive 」からの詳細なレポートを添付します(原文翻訳)。

自動運転はモビリティ業界を根底から変革し、自動車メーカーや人工知能企業にとって重要な注力分野です。自動運転技術の中核はアルゴリズムベースの 3D 物体認識であり、自動運転車両の環境認識の中核と考えられています。重要なことは、車両はさまざまなセンサーを使用して、環境内の人、車両、物体の 3 次元の距離を推定することです。次の記事では、さまざまなセンサーがどのように機能し、相互にどのように相互作用するかについて説明します。

自動運転の中核となる認識タスク - 3D ターゲット検出

自動運転の分類という観点から見ると、現在の自動運転技術は大きく2つに分類されます。1つは直接レベル4(高度な運転自動化)への到達を目指す急進派、もう1つはレベル2(運転支援)から段階的に自動運転レベルを上げていく先進派です。ただし、レベル 2 であってもレベル 4 であっても、アーキテクチャ全体から見ると、知覚、意思決定、制御の 3 つの部分に大別できます。自動運転車の目は知覚であり、人間の目が脳に情報の 70% 以上を提供するのと同じように、知覚システムも自動運転車の外部環境の情報を提供します。自動運転の認識は、カメラ、レーダー、ライダーなどのさまざまなセンサーからの情報に依存します。その中核となるのはカメラとライダーです。

自動運転は 3 次元の環境空間に直面していますが、自動運転車両は環境空間内を移動する必要があり、環境空間内の他の歩行者や車両も移動するため、自動運転は 4 次元の環境空間に直面しているとさえ言えます。環境、時空システム (3D 空間 + 1D 時間)。自動運転車は、周囲の人、車両、3 次元空間内の物体間の距離を判断する必要があります。その上で、静的か動的か、移動方向や速度などの情報も必要となり、これを一般に3次元目標検出タスクと呼んでいます。3D 物体検出タスクは、自動運転における中核的な認識タスクとみなすことができます。もちろん、これに加えて、他の認識タスクには、信号機、交通標識、車線、横断歩道などの道路情報の識別も含まれます。

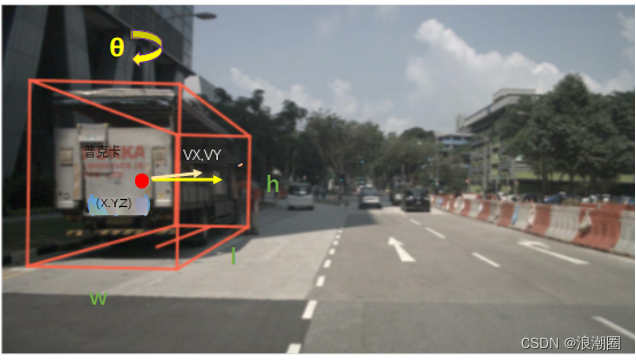

(図: 3D ターゲット検出図。3D ターゲットはボックスとして定義されます。(x, y, z) はボックスの中心座標、(l, w, h) は長さ、幅、高さ、θ は方位角。クラスは 3D ターゲット カテゴリです。Vx と vy は、地上の 3D ターゲットの x 軸と y 軸に沿った速度を表します。)

センサー: LiDAR

LiDAR は、車両の周囲の最も正確な 3D 認識を提供するため、自動運転車に不可欠なコンポーネントであると長い間考えられてきました。LIDAR によって収集された点群情報には、当然のことながら 3D 空間情報が格納されているため、点群情報に基づく 3D ターゲット検出のアルゴリズム設計は非常に簡単になり、PointPillar、SECOND、SSSD などの一連の古典的なモデルが誕生しました。 . 待ってください。しかし、ライダーのコストも自動運転実現の最大のネックとなっており、自動車よりも高価であることが、発売や量産化の最大の障害となっている。近年の技術の進歩によりライダーの価格は大幅に下がってきましたが、L4のニーズに対応できるライダーの価格は依然として高価です。

センサー: カメラ

カメラも自動運転車にとって非常に重要なセンサーです。LIDARで収集される点群情報には色やテクスチャがないため、信号機や標識、車線、横断歩道など人間が認識しやすい道路情報を識別することができません。したがって、カメラは補助センサーとして依然として必要です。ただし、これはマルチモーダル情報融合の問題につながります。つまり、LIDAR は主に車両や歩行者の 3D 情報のセンシングを得意とし、カメラは信号や車線などの視覚的なテクスチャー特徴が豊富な情報のセンシングを得意としています。さらに、カメラは量産コストと価格においても比類のない利点を持っています。たとえば、テスラの単眼カメラ 1 台の価格はわずか 25 ドルで、車両全体で 8 台のカメラの価格はわずか 200 ドルです。カメラ センサーのみを使用し、強力な人工知能アルゴリズムの助けを借りて、正確な 3D オブジェクト検出タスクを達成できます。これは、LIDAR センサーを使用せずに自動運転が可能であることを意味します。

画像ベースの 3D ターゲット検出アルゴリズム

コンピューター ビジョンの分野では、ResNet、YOLO、Mask RCNN など、近年多数の分類、検出、セグメンテーション モデルが登場しています。これらの AI モデルは、セキュリティ、交通機関、自動運転などで広く使用されています。 。ただし、重要な問題の 1 つは、これらのモデルが 2D 画像用に設計されており、3D オブジェクト検出タスクに直接適用できないことです。画像ベースの 3D オブジェクト検出の中心的な問題は、画像内のオブジェクトの深さをどのように正確に推定するかです。カメラで撮影した写真やビデオは3次元空間を2次元平面に投影しており、奥行き情報が失われているため、奥行き情報をどのように復元するかが「病理学的問題」となります。とはいえ、問題の解決策は一意ではない可能性があります。したがって、画像ベースの 3D ターゲット検出アルゴリズムのパフォーマンスは、長い間、LIDAR ベースの 3D ターゲット検出アルゴリズムのパフォーマンスよりもはるかに低かったです。

カメラのみを使用するテスラの FSD 運転システムが一定の成功を収めて以来、ビジョンベースの自動運転認識ソリューションが業界からますます注目を集めています。同時に、データ、アルゴリズム、コンピューティング能力などの進歩により、3D ターゲット検出タスクにおける純粋に視覚的な自動運転認識ソリューションのパフォーマンスは、昨年の LIDAR と比較して大幅に向上しました。

NuScenes データセット

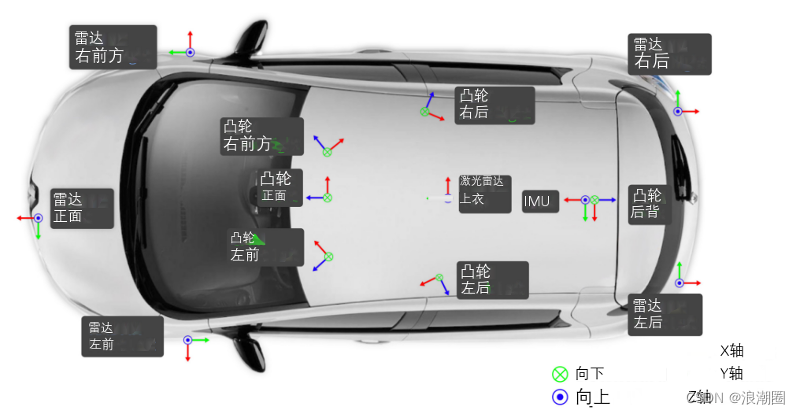

自動運転データセットは古く、センサーの数が多く、収集に時間がかかります。NuScenes データセットは、2019 年に Motive によって開発およびリリースされ、ボストンとシンガポールの路上で収集されました。意味のあるシナリオ データを取得するために、約 15 時間の走行データを収集し、さまざまなシナリオをカバーする走行ルートを慎重に選択しました。収集車両には、カメラ 6 台、ライダー 1 台、ミリ波レーダー 5 台、GPS、IMU を含むセンサーが搭載されており、360° の視野を認識します。

(画像注: NuScenes データセット収集車両に設置されたセンサー配置図。カメラ 6 台、ライダー 1 台、ミリ波レーダー 5 台が装備されています。)

NuScenes データセットは、3D オブジェクト検出、3D オブジェクト追跡、予測軌道、LIDAR セグメンテーション、パノラマ セグメンテーション、追跡などのいくつかの評価タスクを提供します。3D オブジェクト検出タスクの目標は、NuScenes データセット内の自動車、トラック、自転車、歩行者などの 10 種類の検出オブジェクトを検出することです。検出情報には、物体の3次元位置に加えて、物体の大きさ、方向、速度も含まれる。NuScenes は、平均精度 (mAP)、平均変換誤差 (ATE)、平均スケール誤差 (ASE)、平均方向誤差 (AOE)、および平均速度誤差構成から構成される包括的な NDS インデックス、すなわち NuScenes 検出スコア (NDS) を提案しました。 (AVE) および平均属性誤差 (AAE)。

(画像注: NuScenes データセット内の 6 台のカメラによって収集された画像の概略図。)

NuScenes に加えて、業界には Waymo や ONCE などのオープンソース データ セットもあります。ただし、NuScenes は最も多く使用されているデータセットです。NuScenes データセットは、リリース以来、2,000 を超える研究論文で引用されています。NuScenes チャレンジは、自動運転に関連するタスクにおける知覚アルゴリズムのパフォーマンスをテストするための試金石にもなりました。世界中の研究チームから 220 を超える応募が集まりました。最近では、PhiGent Robotics、Zongmu Technology、ECARX などの自動車会社の研究開発チームも NuScenes のリストに掲載されています。

NuScenes では、年間を通じて更新されるリストを提供しています。現在 50 件以上の提出があり、そのほとんどが 2022 年に行われたものです。現在、リストの 1 位にランクされているのは、 Inspur Information Algorithm Team によって提出された「IEI-BEVFusion++」アルゴリズム モデルです。主要な指標であるnuScenes Detection Score (NDS) は0.776 という高スコアであり、3D ターゲット検出トラック全体で最高のスコアを生み出しています。これまでのところ。

また、純粋なビジュアルトラックでは、2022年にアルゴリズムチームが提出した総合検出精度NDS 0.624の「DABNet4D」モデルも当時のリストでトップとなった。比較すると、2022 年初めに第 1 位にランクされた BEV3D アルゴリズムの NDS 精度は 0.474 で、これは 1 年以内に、NuScenes の純粋なビジュアル 3D ターゲット検出の NDS インデックスが 15 ポイント向上したことを意味します。純粋な視覚アルゴリズムと LIDAR アルゴリズムの間の精度の差も、年初の 45% から 17% に縮まりました。これらはすべて、純粋な視覚 3D 検出アルゴリズムの最適化によってもたらされたパフォーマンスの向上によるものです。

未来を見据えて

自動運転の産業化プロセスにおいて、自動運転の中核技術モジュールとしての認識技術は出発点であり、基礎でもあります。将来的には、より強力な人工知能コンピューティング プラットフォームが、自動運転をサポートする認識アルゴリズムの研究開発に投資されるでしょう。NuScenes リストに掲載されているテクノロジーの急速な反復から判断すると、コンピューティング能力とアルゴリズムの継続的な進歩により、自動運転の産業化のプロセスには追加の「離陸のための動力源」が追加されると信じる理由があります。 」