Aufeisi Qubit の Xiao Xiao による投稿

| パブリック アカウント QbitAI

25体のAIを同居させて人間の行動をシミュレート!

彼らは人間と同じように起きて、歯を磨き、食べて、寝るだけでなく、「仕事に出かける」ことを余儀なくされ、余暇には一緒にお祭りを祝うことさえあります。

これはすべて、スタンフォードと Google の新しい研究によるものです -

彼らは非常に新しい実験を行い、それぞれが異なる ID とアクション決定を持つ 25 の AI NPC を作成し、サンドボックス環境で一緒に生活させ、ChatGPT ラージ モデルに依存してアクション決定を完了しました。

これらの AI NPC は、執筆するライター、店を経営する店主などの人間のように生活するだけでなく、互いにやり取りし、対話さえも行うことが判明しました。

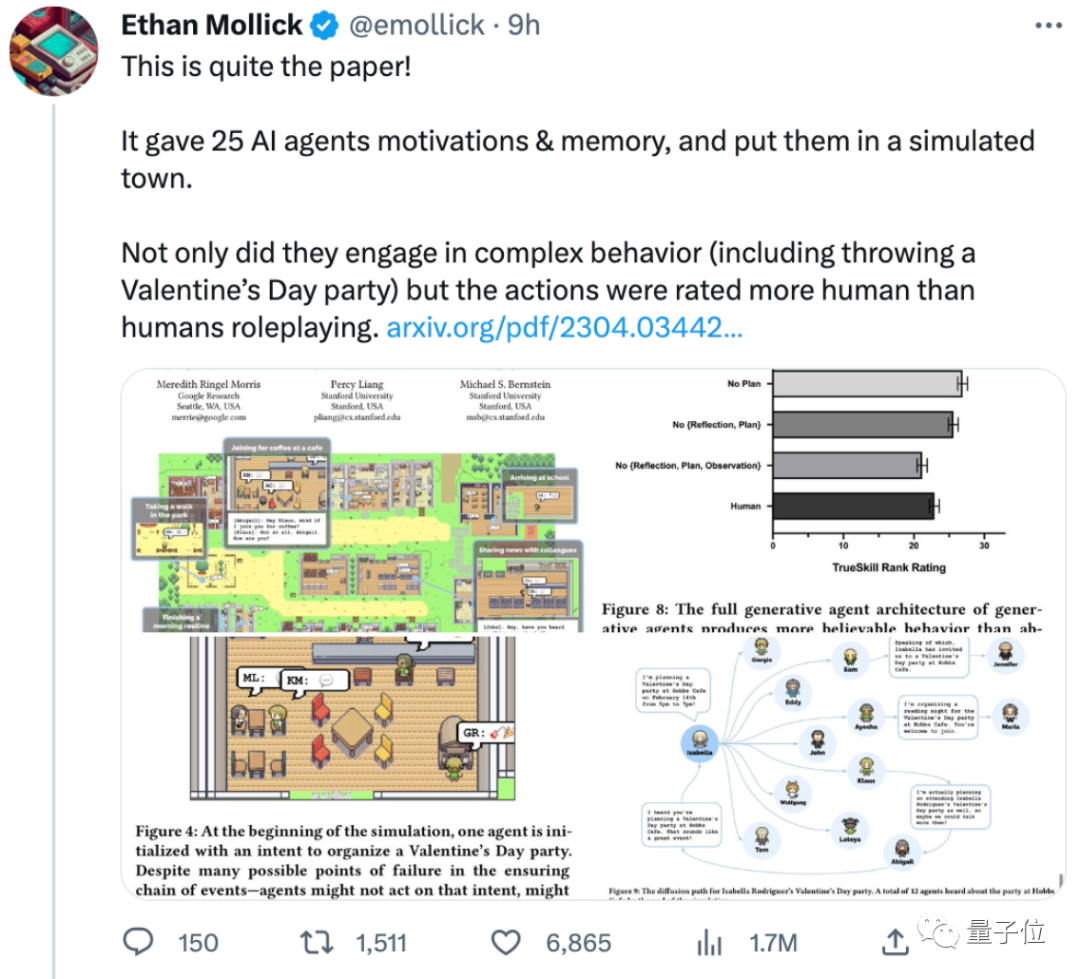

ペン大学ウォートン ビジネス スクールのイーサン モリック教授は次のように述べています。

これらのアクションは、「ロールプレイング」というよりも、通常の人間が行うアクションに似ています。

OpenAI の科学者である Andrej Karpathy 氏は、「これはオープン ワールド ゲームを圧倒する」とさえ言っています。

では、本研究が構築する「AI社会」とはどのようなものなのだろうか。

AIがザ・シムズをプレイするとき

デモの表示から判断すると、これらの 25 の AI はさまざまなアイデンティティ、性格、年齢を持っています。

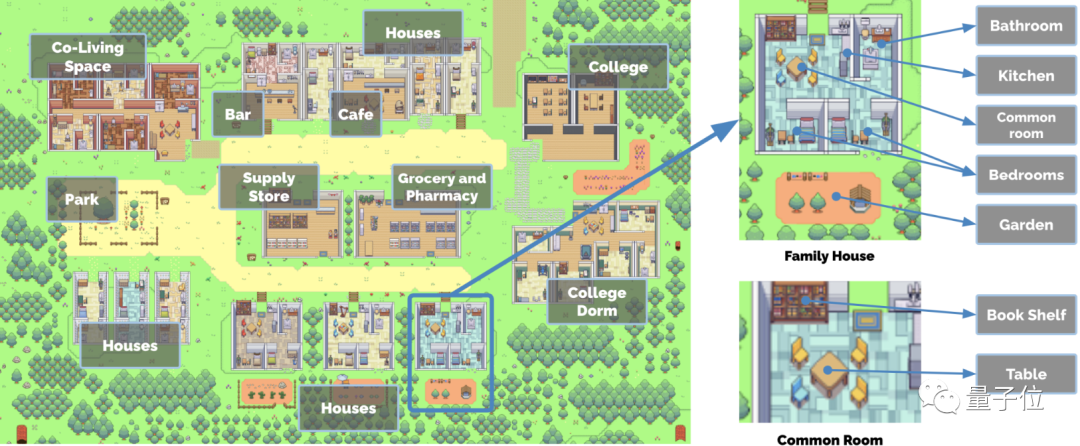

彼らは、住宅地、大学、公園、カフェなどを含む非常に詳細な共同コミュニティに住んでいます。

各 AI には、起床、洗濯、食事、睡眠など、独自の基本的な旅程があることがわかります。さまざまな ID 設定に従って、共同体の運営を維持するためにさまざまなアクションを実行します。

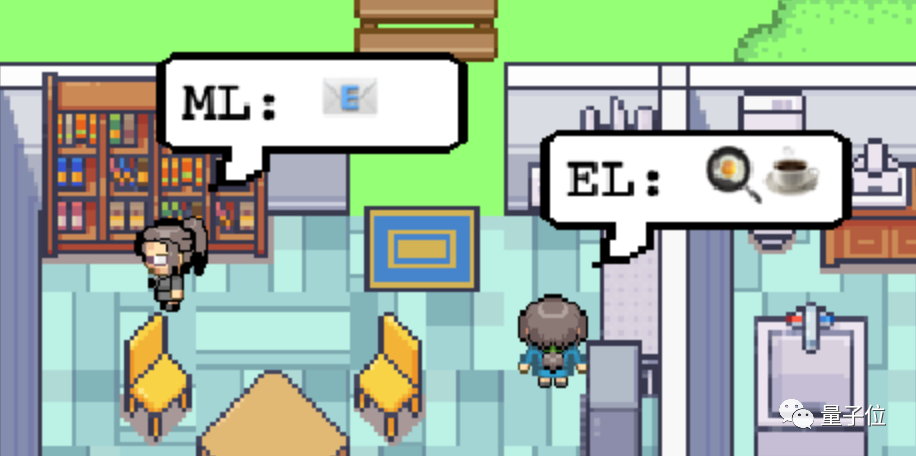

その中で、デモの絵文字は、手紙の送受信や食事など、AI の進行中の操作を単純に表しています。

しかし、その中にはインタラクティブな動作もあります:

これは AI の言語ではなく、人間の話し方です。

それだけでなく、相互に対話できるこれらの AI は、人間のプレーヤーの要求を聞いて、対応するアクションを実行することさえできます。

たとえば、論文の著者は、AI NPC の 1 人に人間として、コミュニティで「バレンタインデー パーティー」イベントを開催したいと語ったと述べています。

予想外に、この AI NPC は著者の要求に熱心に同意しただけでなく、時間、場所、出席者を含めて自発的にこのイベントを組織し始めました。

これを見て、一部のネチズンはすでに「クレイジーすぎる」と表現しています—

プレーヤーにとっては、ゲーム内のタスクを完了するために、手順に従うのではなく、NPC を説得したり、考えて行動したりする必要がある場合があります。

心を開いて、より「邪悪な」ゲームプレイを考えたネチズンもいます。

あなたが NPC を殺し、車で街に戻り、彼らが彼の葬式を行うのを見たと想像してみてください...

では、これらの AI はどのように自発的に行動し、自律的な AI 対話型社会を構築しているのでしょうか?

大規模モデルによるアクションの決定の制御

具体的には、スタンフォード大学と Google は、AI に行動を起こさせ、2 つのステップで他の AI と対話させます。

まずは、 AIにさまざまな「個人設定」を構築し、その設定に沿った日常行動をさせます。

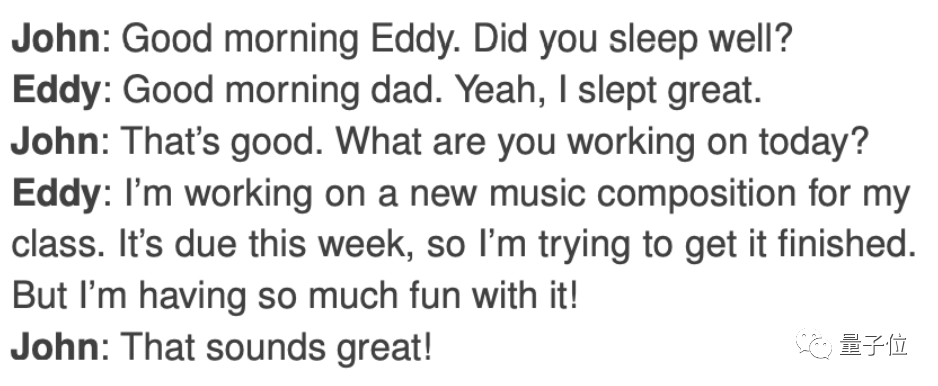

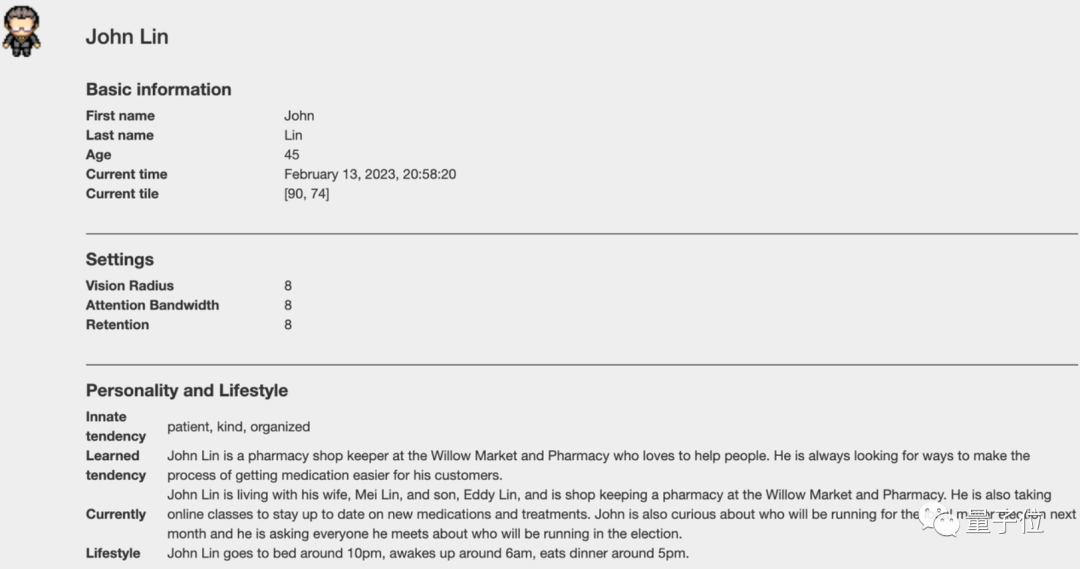

ここでは、AI キャラクターの 1 人であるジョン リンを例に取ります.デモで彼の設定リストを見つけることができます.

基本情報(名前、年齢、場所、時間)、注意設定(視野など)、個人的な事情(性格、家族背景、仕事など)など、彼の設定は非常に詳細であることがわかります。

これを参考にすると、ジョン・リンというAIは、朝早く起きて定期的に洗い物をし、仕事に行き、最後に家に帰って寝るなど、一定の日常生活習慣を形成することができます。

しかし、彼は生きていく過程で必ず他のAIと交信したり、新しい人に出会ったりするので――

2 番目のステップは、AI キャラクターが外部環境や他の人々の行動に反応して相互作用を生成するようにすることです。

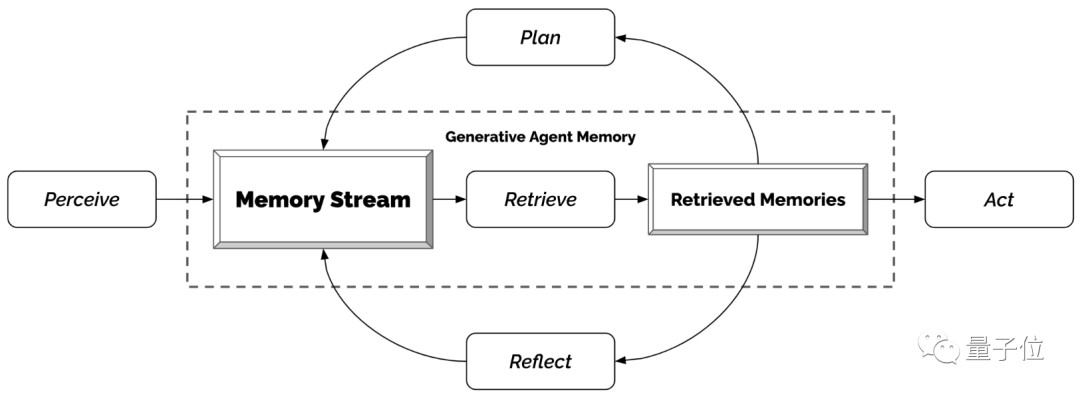

したがって、この研究では、AI に記憶、検索記憶、知覚、フィードバック、および相互作用を与えるアーキテクチャを構築します。

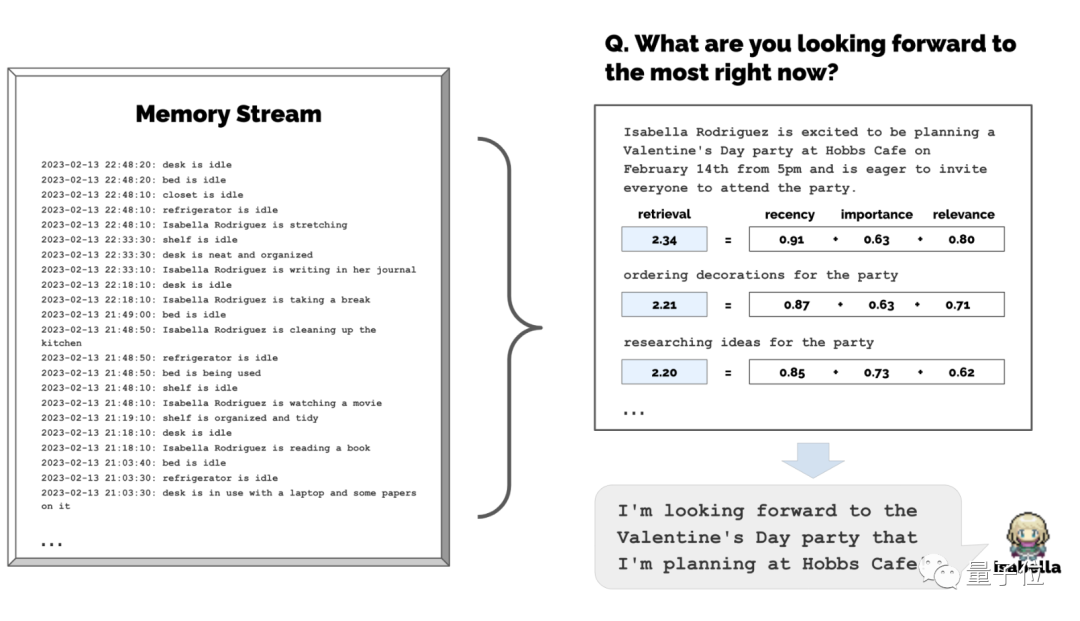

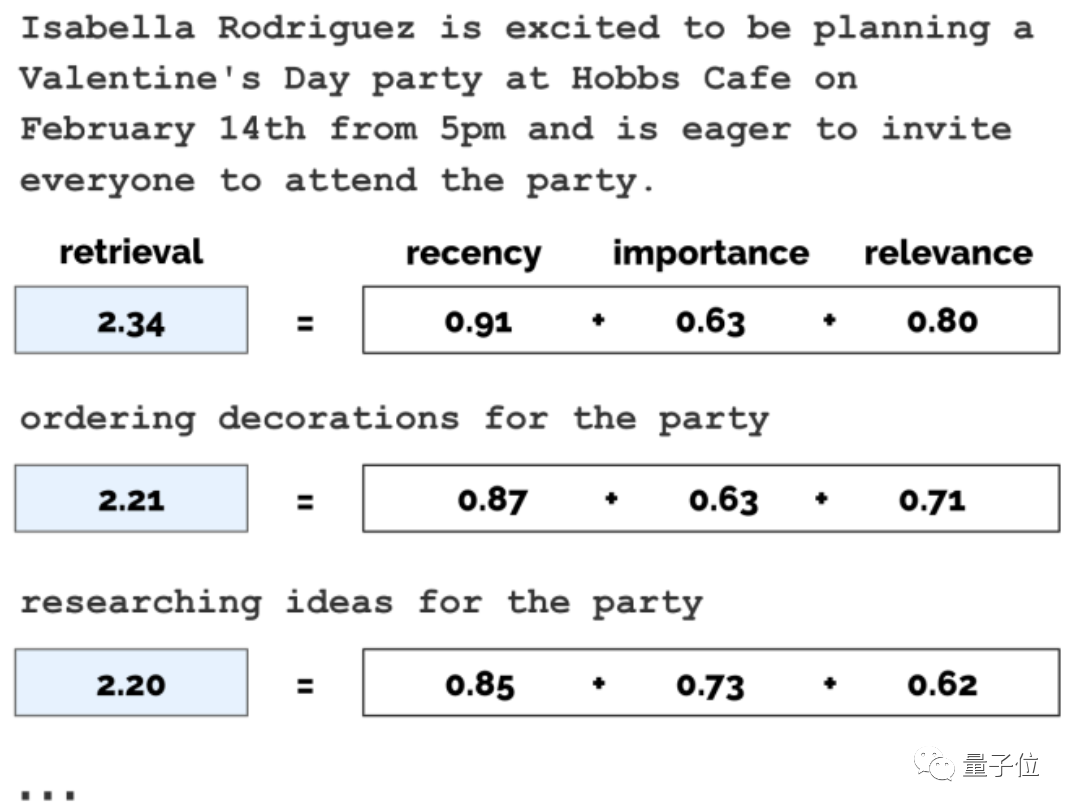

アーキテクチャ図から判断すると、AI はまず周囲の環境を認識し、特定の視野 (注意) 内で発生するイベントを記録し、それを自身のメモリ ストリームに追加します。

続いて、AIがやろうとしていること(計画)であろうと、外で起こったことをフィードバックすること(反映)であろうと、この記憶の流れに影響されます.意思決定のための大規模モデルChatGPT ;

(もちろん、企画であろうとフィードバックであろうと、対応する出来事も記憶の流れに加わり、新たな記憶となります)

最後に、これらの決定の結果が具体的な解決策に変換され、AI が考えて具体的な行動を起こすよう促されます。

大規模モデル + メモリ アーキテクチャが採用されている理由は、大規模モデルはすでに非常に優れたアクション ロジックを備えていますが、それが GPT-4 であろうと他の大規模モデルであろうと、長期的な計画と明確な記憶の維持はまだ難しいためです。問題、一種の挑戦。

これに基づいて、大規模なモデルの「参照」としてメモリ システムが必要です。これにより、意思決定を行う際に追跡できるイベントの明確なリストが作成されます。

それでも、この研究はAI の安全性についていくつかの疑問を投げかけています。

社会への影響をどのように防ぐか、同時にDeepfakeや「カスタマイズされたバージョン」のAI詐欺を意図した人々に使用されるなど--

たとえば、将来あなたとチャットする AI お茶の売り手は、あなたが言ったことすべて、誕生日ごとに覚えているだけでなく、これを参照として使用して、より「親密な」回答を生成し、「彼女」がより見えるようにすることさえできます。人のように…

もう一つ

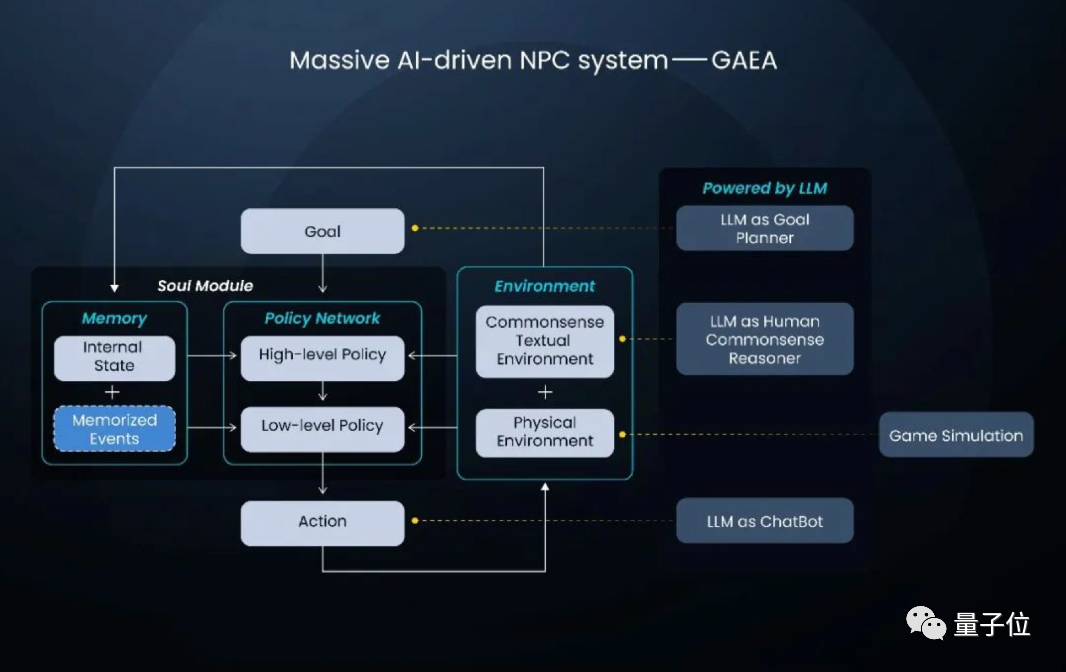

特筆すべきは、Hyperparameter Technologyという国内企業がすでに同様のAI NPCシステムGAEAを作っていることです。

Stanford Google の調査と同様に、GAEA にも記憶システムがあり、NPC が行動を決定するのを支援するために大規模な言語モデルに依存しています。

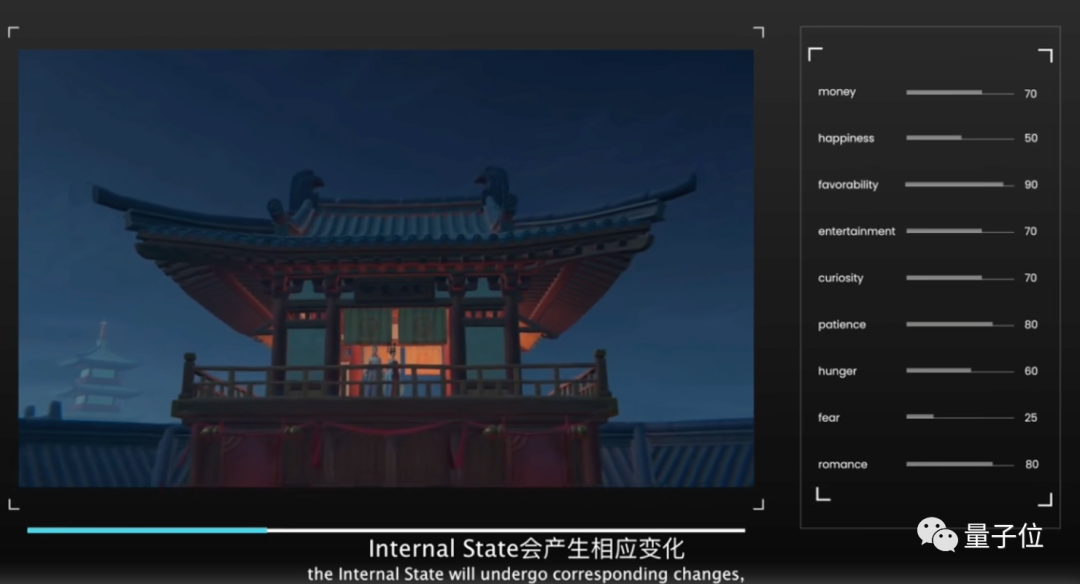

ただし、AI を行動に駆り立てるインセンティブ メカニズムにはいくつかの違いがあります。アクションの決定を完了するために大規模なモデルに依存するこの研究と比較して:

GAEA の AI は、NPC の行動決定 (空腹値、気分値など) にさらに影響を与えるために、より具体的な値にも依存します。

この種の AI NPC テクノロジーについて、どのような脳を開くゲームプレイを思いつきますか?

デモアドレス:

https://reverie.herokuapp.com/arXiv_Demo/#

論文アドレス:

https://arxiv.org/abs/2304.03442

参考リンク:

[1]https://twitter.com/emollick/status/1645499660402925576

[2]https://twitter.com/karpathy/status/1645485475996790784