1.はじめに

1986年にRumelhartとMcCellandが率いる科学者のグループによって提案されたBPネットワーク(バックプロパゲーション)は、エラーバックプロパゲーションアルゴリズムによってトレーニングされた多層フィードフォワードネットワークであり、現在最も広く使用されているニューラルネットワークモデルの1つです。BPネットワークは、マッピング関係を記述する数式を事前に明らかにすることなく、多数の入出力パターンマッピング関係を学習して保存できます。

人工ニューラルネットワークの開発の歴史において、隠れ層の接続重みを調整するための効果的なアルゴリズムは長い間発見されていませんでした。エラーバックプロパゲーションアルゴリズム(BPアルゴリズム)が提案されるまで、非線形連続関数を解くための多層フィードフォワードニューラルネットワークの重み調整の問題はうまく解決されました。

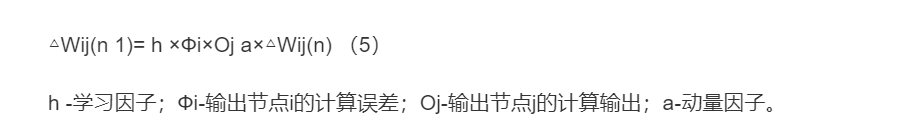

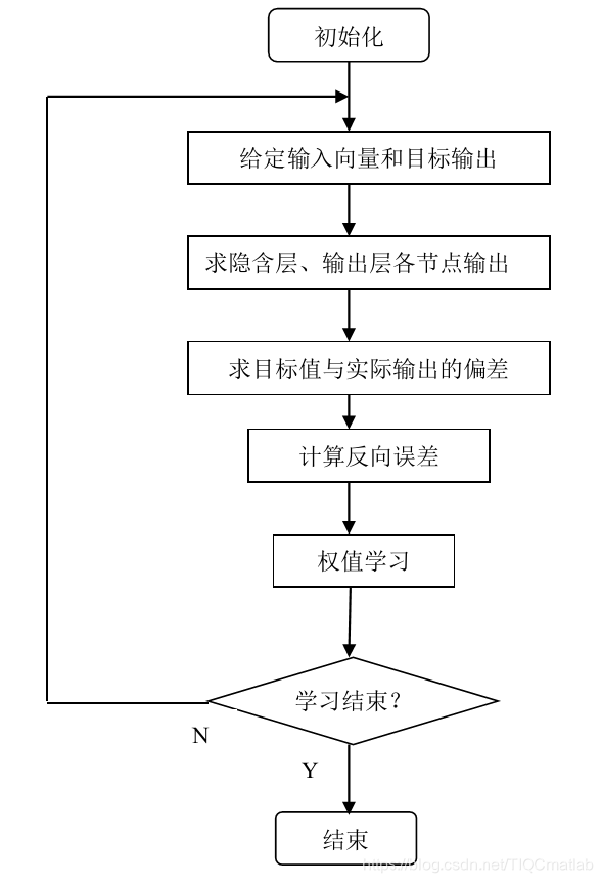

エラーバックプロパゲーションアルゴリズムの学習プロセスであるBP(バックプロパゲーション)ニューラルネットワークは、情報のフォワードプロパゲーションとエラーのバックプロパゲーションの2つのプロセスで構成されています。入力層の各ニューロンは、外部から入力情報を受け取り、それを中間層の各ニューロンに送信します。中間層は内部情報処理層であり、情報処理を担当します。情報変更能力の需要に応じて、中間層は、単一の隠れ層または複数の隠れ層構造として設計できます。最後の隠れ層は、出力層の各ニューロンの情報を送信し、さらに処理した後、学習順方向伝播プロセスを完了し、出力層は出力します。情報処理の結果を外の世界に。実際の出力が期待される出力と一致しない場合、エラーバックプロパゲーションステージに入ります。エラーは出力レイヤーを通過し、エラー勾配降下法で各レイヤーの重みを修正し、レイヤーごとに非表示レイヤーと入力レイヤーに送り返します。情報の順方向伝搬とエラーの逆方向伝搬の繰り返しプロセスは、各層の重みを絶えず調整するプロセスであり、ニューラルネットワークの学習とトレーニングのプロセスでもあります。このプロセスは、ネットワーク出力のエラーが減少するまで続きます。許容レベルまで、または設定されたスタディ数までプリセットされています。

BPニューラルネットワークモデルBPネットワークモデルには、その入力および出力モデル、アクション関数モデル、エラー計算モデル、および自己学習モデルが含まれます。2BP

ニューラルネットワークモデルとその基本原理

3BP_PIDアルゴリズムフロー

第二に、ソースコード

%BP based PID Control

clc,clear,close all

warning off

xite=0.25; % 学习因子

alfa=0.05; % 惯量因子

S=1; %Signal type

%NN Structure

IN=4; % 输入层个数

H=5; % 隐藏层个数

Out=3; % 输出层个数

if S==1 %Step Signal

wi=[-0.6394 -0.2696 -0.3756 -0.7023;

-0.8603 -0.2013 -0.5024 -0.2596;

-1.0749 0.5543 -1.6820 -0.5437;

-0.3625 -0.0724 -0.6463 -0.2859;

0.1425 0.0279 -0.5406 -0.7660];

%wi=0.50*rands(H,IN);

wi_1=wi;wi_2=wi;wi_3=wi;

wo=[0.7576 0.2616 0.5820 -0.1416 -0.1325;

-0.1146 0.2949 0.8352 0.2205 0.4508;

0.7201 0.4566 0.7672 0.4962 0.3632];

%wo=0.50*rands(Out,H);

wo_1=wo;wo_2=wo;wo_3=wo;

end

if S==2 %Sine Signal

wi=[-0.2846 0.2193 -0.5097 -1.0668;

-0.7484 -0.1210 -0.4708 0.0988;

-0.7176 0.8297 -1.6000 0.2049;

-0.0858 0.1925 -0.6346 0.0347;

0.4358 0.2369 -0.4564 -0.1324];

%wi=0.50*rands(H,IN);

wi_1=wi;wi_2=wi;wi_3=wi;

wo=[1.0438 0.5478 0.8682 0.1446 0.1537;

0.1716 0.5811 1.1214 0.5067 0.7370;

1.0063 0.7428 1.0534 0.7824 0.6494];

%wo=0.50*rands(Out,H);

wo_1=wo;wo_2=wo;wo_3=wo;

end

x=[0,0,0];

u_1=0;u_2=0;u_3=0;u_4=0;u_5=0;

y_1=0;y_2=0;y_3=0;

% 初始化

Oh=zeros(H,1); %从隐藏层到输出层

I=Oh; %从输入层到隐藏层

error_2=0;

error_1=0;

ts=0.001;

for k=1:1:500

time(k)=k*ts;

if S==1

rin(k)=1.0;

elseif S==2

rin(k)=sin(1*2*pi*k*ts);

end

%非线性模型

a(k)=1.2*(1-0.8*exp(-0.1*k));

yout(k)=a(k)*y_1/(1+y_1^2)+u_1; % 输出

error(k)=rin(k)-yout(k); % 误差

xi=[rin(k),yout(k),error(k),1];

x(1)=error(k)-error_1;

x(2)=error(k);

x(3)=error(k)-2*error_1+error_2;

epid=[x(1);x(2);x(3)];

I=xi*wi';

for j=1:1:H

Oh(j)=(exp(I(j))-exp(-I(j)))/(exp(I(j))+exp(-I(j))); %Middle Layer

end

K=wo*Oh; %Output Layer

for l=1:1:Out

K(l)=exp(K(l))/(exp(K(l))+exp(-K(l))); %Getting kp,ki,kd

end

kp(k)=K(1);ki(k)=K(2);kd(k)=K(3);

Kpid=[kp(k),ki(k),kd(k)];

du(k)=Kpid*epid;

u(k)=u_1+du(k);

% 饱和限制

if u(k)>=10

u(k)=10;

end

if u(k)<=-10

u(k)=-10;

end

dyu(k)=sign((yout(k)-y_1)/(u(k)-u_1+0.0000001));

%Output layer

for j=1:1:Out

dK(j)=2/(exp(K(j))+exp(-K(j)))^2;

end

for l=1:1:Out

delta3(l)=error(k)*dyu(k)*epid(l)*dK(l);

end

3、実行中の結果

四、備考

完全なコードまたは書き込み追加QQ1564658423過去のレビュー

>>>>>>

[予測モデル] matlab粒子群に基づくlssvm予測[Matlabソースコード103を含む]

[lSSVM予測] matlabクジラ最適化アルゴリズムに基づくlSSVMデータ予測[Matlabソースコードを含む104]

[lstm予測] matlabクジラ最適化アルゴリズムに基づく改善されたlstm予測[Matlabソースコード105を含む]

[SVM予測] matlabバットアルゴリズムに基づく改善されたSVM予測(1)[Matlabソースコード106を含む]

[ SVM予測]に基づくmatlabBP

ニューラルネットワーク予測に基づくsvmサポートベクターマシン予測[Matlabソースコード107を含む] [予測モデル] [Matlabソースコード108を含む]

[lssvm予測モデル]を最適化するmatlabグレイウルフアルゴリズムバットアルゴリズムに基づく改善された最小二乗サポートベクターマシンlssvm予測[Matlab109の問題]

[lssvm予測]最小二乗サポートベクターマシンlssvm予測の蛾消火アルゴリズムに基づく改善[Matlab110]

[SVM予測] matlabバットアルゴリズムに基づくSVM予測の改善(2)[Matlabソースコード141を含む限目]

[Lssvm予測]改善された最小二乗サポートベクトルマシンMatlab蛾消防アルゴリズムに基づくlssvm予測[Matlabソースコード142を含む]

[ANN予測モデル] MATLAB差分アルゴリズムに基づいてANNネットワーク予測を改善[Matlabソースコード151を含む]

[予測モデル] matlabRBFニューラルネットワーク予測モデルに基づく[Matlabソースコード177期間を含む]

[予測モデル]ストックトレンドを予測するためのmatlabSVM回帰予測アルゴリズムに基づく[Matlabソースコード180期間を含む]