guide

L'émergence de ChatGPT a attiré beaucoup d'attention, mais il ne faut pas oublier le génie inconnu qui se cache derrière. Ilya Sutskever est le co-fondateur et scientifique en chef d'OpenAI. C'est sous sa direction qu'OpenAI a réalisé des progrès significatifs dans le développement de technologies de pointe et l'avancement du domaine de l'intelligence artificielle.

Dans cet article, nous explorons comment Sutskever est passé d'un jeune chercheur à l'une des figures de proue de l'intelligence artificielle en deux décennies. Que vous soyez un passionné d'IA, un chercheur ou simplement une personne curieuse des rouages de ce domaine, cet article fournira une perspective et des informations précieuses.

Cet article est compilé à partir de https://journeymatters.ai/ilya-the-brain-behind-chatgpt/

Auteur / Munish Gandhi

Source/Communauté Zhiyuan

Compilation/Niu Menglin, Li Mengjia

Cet article suit la chronologie suivante :

2003 : Apprentissage d'Ilya Sutskever

2011 : Apprendre à connaître AGI pour la première fois

2012 : une révolution dans la reconnaissance d'images

2013 : vente aux enchères de DNNresearch à Google

2014 : Une révolution dans la traduction linguistique

2015 : De Google à OpenAI : Un nouveau chapitre de l'intelligence artificielle

2018 : GPT 1, 2 et 3

2021 : Développement de DALL-E 1

2022 : Dévoiler ChatGPT au monde

Ilya Sutskever

Cofondateur et scientifique en chef d'OpenAI, diplômé de l'Université de Toronto en 2005 et titulaire d'un doctorat en informatique en 2012. Depuis 2012, il a successivement travaillé à l'Université de Stanford, DNNResearch et Google Brain, engagé dans la recherche liée à l'apprentissage automatique et à l'apprentissage profond, et en 2015, il a renoncé à son poste bien rémunéré chez Google et a créé conjointement OpenAI avec Greg Brockman et autres, leader dans OpenAI La recherche et le développement des modèles des séries GPT-1, 2, 3 et DALLE. En 2022, il a été élu membre de la Royal Society of Science. Pionnier dans le domaine de l'intelligence artificielle, il a contribué à façonner le paysage actuel de l'intelligence artificielle et continue de repousser les limites de ce qui est possible en apprentissage automatique. Sa passion pour l'intelligence artificielle a éclairé ses recherches révolutionnaires, qui ont façonné le développement du domaine de l'apprentissage en profondeur et de l'apprentissage automatique.

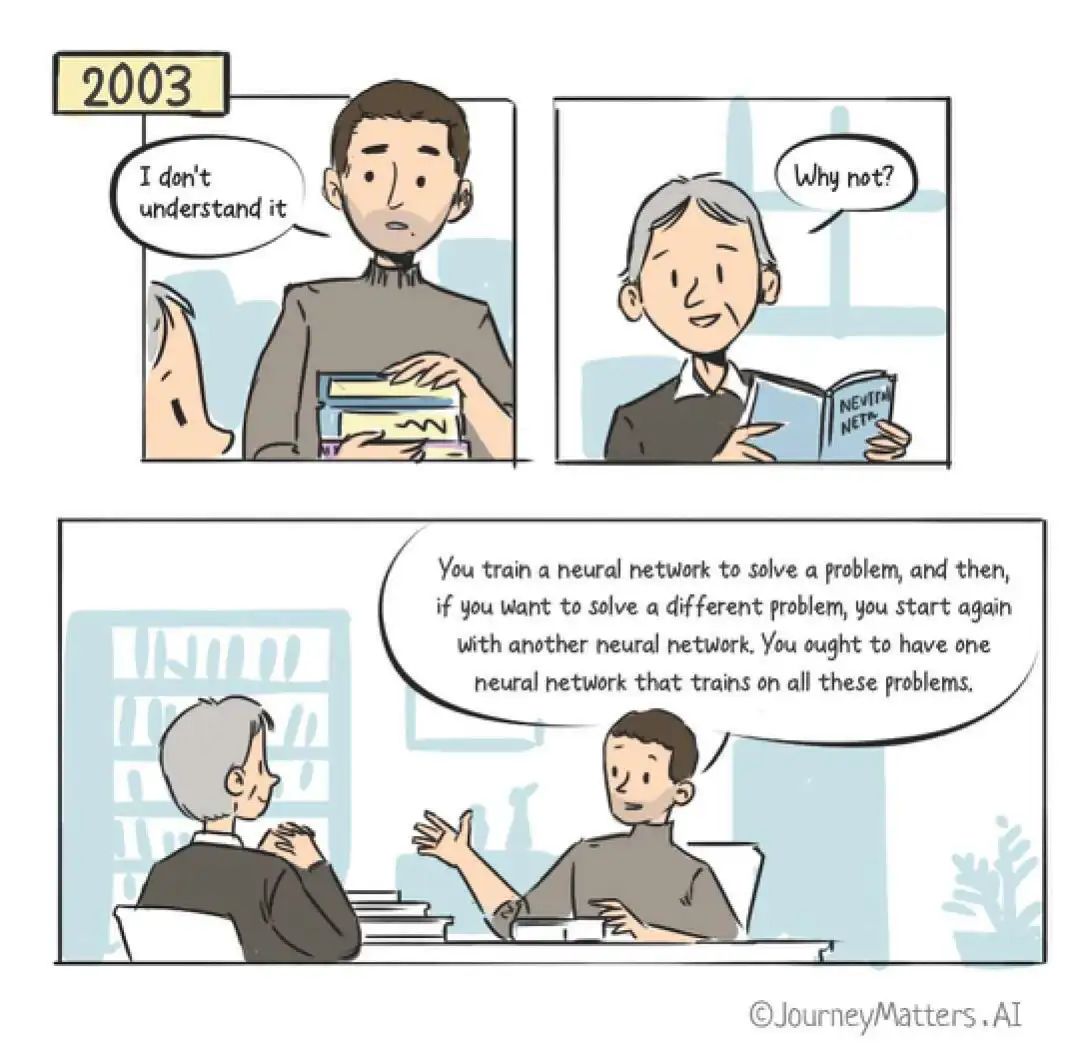

2003 :

Premières impressions d'Ilya Sutskever

Sutskever : Je ne comprends pas, Hinton : Pourquoi je ne comprends pas, Sutskever : Les gens entraînent des réseaux de neurones pour résoudre des problèmes, et quand les gens veulent résoudre des problèmes différents, ils doivent recommencer à s'entraîner avec un autre réseau de neurones. Mais je pense que les gens devraient avoir un réseau de neurones capable de résoudre tous les problèmes.

En tant qu'étudiant de premier cycle à l'Université de Toronto, Sutskever voulait rejoindre le Deep Learning Lab du professeur Geoffrey Hinton. Alors, un jour, il a frappé à la porte du bureau du professeur Hinton et a demandé s'il pouvait rejoindre le laboratoire. Le professeur lui a demandé de prendre rendez-vous à l'avance, mais Sutskever ne voulait pas perdre plus de temps, alors il a immédiatement demandé : « Et maintenant ?

Réalisant que Sutskever était un étudiant passionné, Hinton lui donna deux articles à lire. Une semaine plus tard, Sutskever est retourné au bureau du professeur et a dit au professeur qu'il ne comprenait pas.

« Pourquoi ne comprends-tu pas ? » demanda le professeur.

Sutskever a expliqué : "Les gens forment des réseaux de neurones pour résoudre des problèmes, et lorsqu'ils veulent résoudre différents problèmes, ils doivent recommencer à s'entraîner avec un autre réseau de neurones. Mais je pense que les gens devraient avoir un réseau de neurones capable de résoudre tous les problèmes."

Le passage a démontré la capacité unique de Sutskever à tirer des conclusions qui prendraient des années à découvrir même des chercheurs expérimentés, et Hinton a lancé une invitation à rejoindre son laboratoire.

2011 : Apprendre à connaître AGI pour la première fois

Sutskever : Je ne suis pas d'accord avec l'idée (AGI)

Lorsque Sutskever était encore à l'Université de Toronto, il s'est envolé pour Londres pour trouver un emploi chez DeepMind. Là, il a rencontré Demis Hassabis et Shane Legg (co-fondateurs de DeepMind), qui construisaient AGI (Artificial General Intelligence). L'IAG est une intelligence artificielle générale capable de penser et de raisonner comme les humains et d'accomplir diverses tâches liées à l'intelligence humaine, telles que la compréhension du langage naturel, l'apprentissage par l'expérience, la prise de décisions et la résolution de problèmes.

À l'époque, l'AGI n'était pas quelque chose dont les chercheurs sérieux parleraient. Sutskever pensait également qu'ils avaient perdu le contact avec la réalité, alors il a refusé le travail, est retourné à l'université et a finalement rejoint Google en 2013.

2012 : La révolution de la reconnaissance d'images

Gagnant du concours ImageNet

Geoffrey Hinton a la vision de croire en l'apprentissage en profondeur quand les autres ne le font pas. Et il croit fermement que gagner le concours ImageNet réglera le débat une fois pour toutes.

Concours ImageNet : Le laboratoire de l'Université de Stanford accueille chaque année le concours ImageNet. Ils ont fourni aux participants une vaste base de données de photos soigneusement étiquetées, et des chercheurs du monde entier ont concouru pour essayer de créer un système capable de reconnaître le plus d'images.

Deux des étudiants de Hinton, Ilya Sutskever et Alex Krizhevsky, ont participé au concours. Ils ont brisé le schéma de conception manuelle traditionnel, adopté un réseau neuronal profond et franchi la barre des 75 % de précision. Ils ont donc remporté le concours ImageNet, et leur système a ensuite été nommé AlexNet.

Depuis, le domaine de la reconnaissance d'images a pris un nouveau visage.

Plus tard, Sutskever, Krizhevsky et Hinton ont publié un article sur AlexNet qui est devenu l'un des articles les plus cités en informatique, collectivement cité plus de 60 000 fois par d'autres chercheurs.

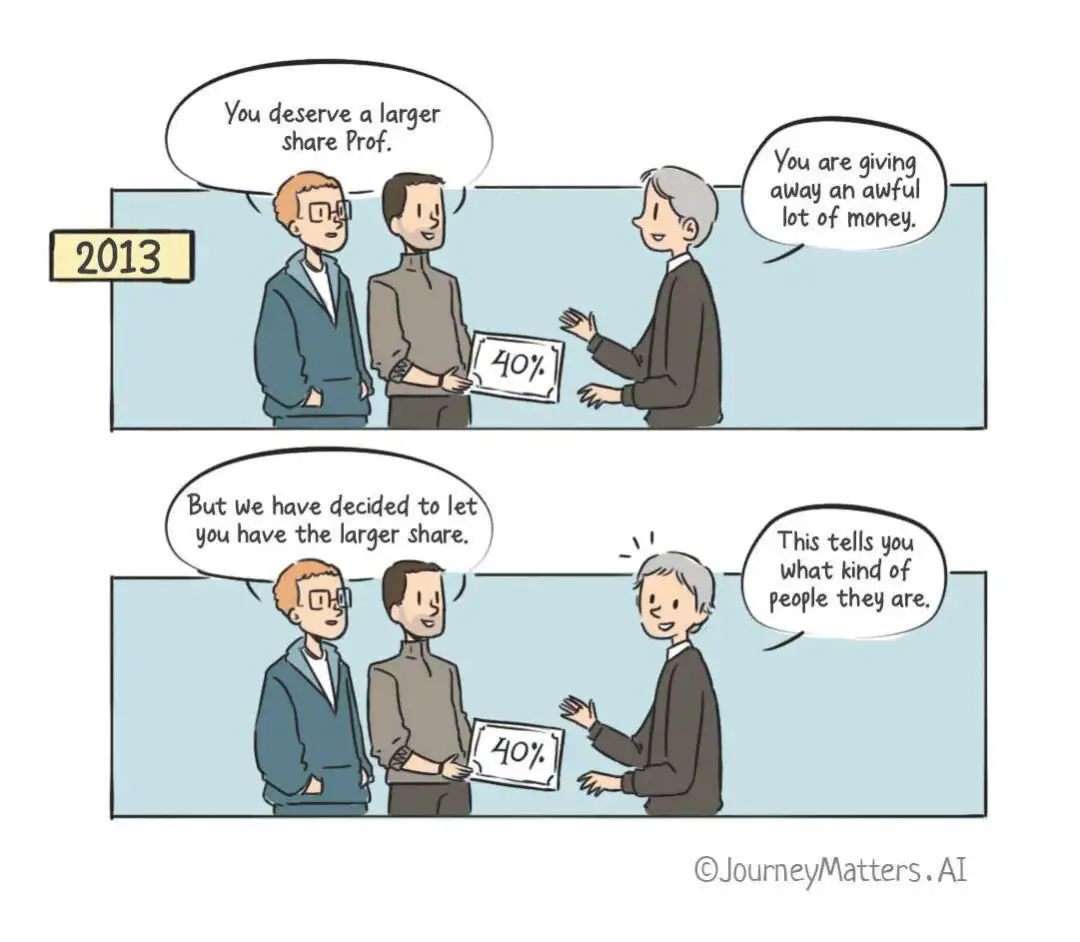

2013 : vente aux enchères de DNNresearch à Google

Sutskever & Krizhevsky : Vous méritez un plus grand pourcentage de dividendes. Hinton : Vous me donnez trop d'argent. Sutskever&Krizhevsky : Mais nous avons déjà décidé de vous laisser prendre la tête. Hinton : Cela montre leur caractère.

Hinton, avec Sutskever et Krizhevsky, a fondé une nouvelle société appelée DNNresearch. Ils n'ont aucun produit et n'ont pas l'intention d'en fabriquer à l'avenir.

Hinton a demandé à l'avocat comment maximiser la valeur de sa nouvelle entreprise, même si elle ne compte actuellement que trois employés et n'a ni produit ni héritage. L'une des options que l'avocat lui a données était de mettre en place une vente aux enchères. Quatre sociétés ont été impliquées dans l'acquisition : Baidu, Google, Microsoft et DeepMind (alors une jeune start-up à Londres). Le premier à abandonner fut DeepMind, suivi de Microsoft, et finalement seuls Baidu et Google restèrent en compétition.

Vers minuit une nuit, alors que le prix de l'enchère dépassait 44 millions de dollars, Hinton a interrompu les enchères et s'est endormi. Le lendemain, il a annoncé que l'enchère était terminée et a vendu son entreprise à Google pour 44 millions de dollars, décidant qu'il était plus important de trouver une "maison" appropriée pour ses recherches. En cela, Hinton, comme ses étudiants, place leurs idées au-dessus du gain financier.

Quand est venu le temps de partager le produit, Sutskever et Krizhevsky ont insisté sur le fait que Hinton méritait une part plus importante (40%), même si Hinton a suggéré qu'ils feraient aussi bien de dormir un peu. Le lendemain, ils ont encore insisté sur cette distribution. Hinton a commenté plus tard: "Cela parle de qui ils sont, pas de moi".

Après cela, Sutskever est devenu chercheur chez Google Brain, et ses idées ont encore changé et ont progressivement commencé à s'aligner sur les idées des fondateurs de DeepMind. Il a commencé à croire que l'avenir d'AGI était imminent. Bien sûr, Sutskever lui-même n'a jamais eu peur de changer d'avis face à de nouvelles informations ou expériences. Après tout, croire en AGI nécessite un acte de foi , comme l'a dit Sergey Levine (le collègue de Sutskever chez Google) à propos de Sutskever : "C'est un homme qui n'a pas peur de 'croire'".

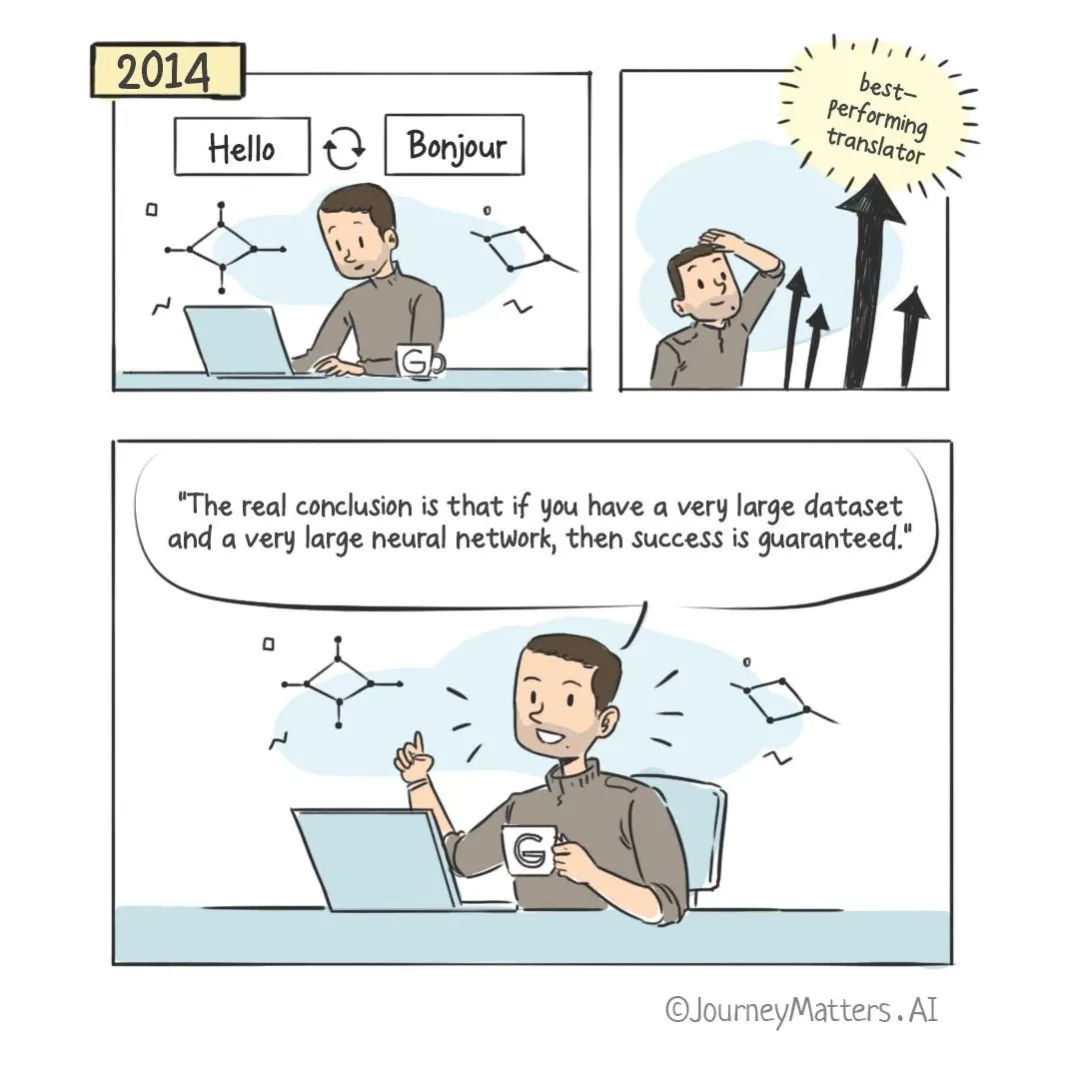

2014 : Une révolution dans la traduction linguistique

Sutskever : La conclusion correcte est que si vous disposez d'un très grand ensemble de données et d'un très grand réseau de neurones, le succès est inévitable. (traducteur le plus performant)

Après avoir acquis DNSResearch, Google a embauché Sutskever en tant que chercheur chez Google Brain.

Chez Google, Sutskever a inventé une variante d'un réseau de neurones capable de traduire l'anglais en français. Il a proposé "Sequence to Sequence Learning" (Sequence to Sequence Learning), qui peut capturer la structure de séquence de l'entrée (comme les phrases en anglais) et la mapper à la sortie (comme les phrases en français) qui a également une structure de séquence.

Les chercheurs ne pensaient pas que les réseaux de neurones pouvaient traduire, ce fut donc une grande surprise lorsqu'ils l'ont fait, a-t-il déclaré. Son invention a battu les traducteurs les plus performants, donnant à Google Traduction une mise à niveau majeure. La traduction linguistique n'a jamais été la même.

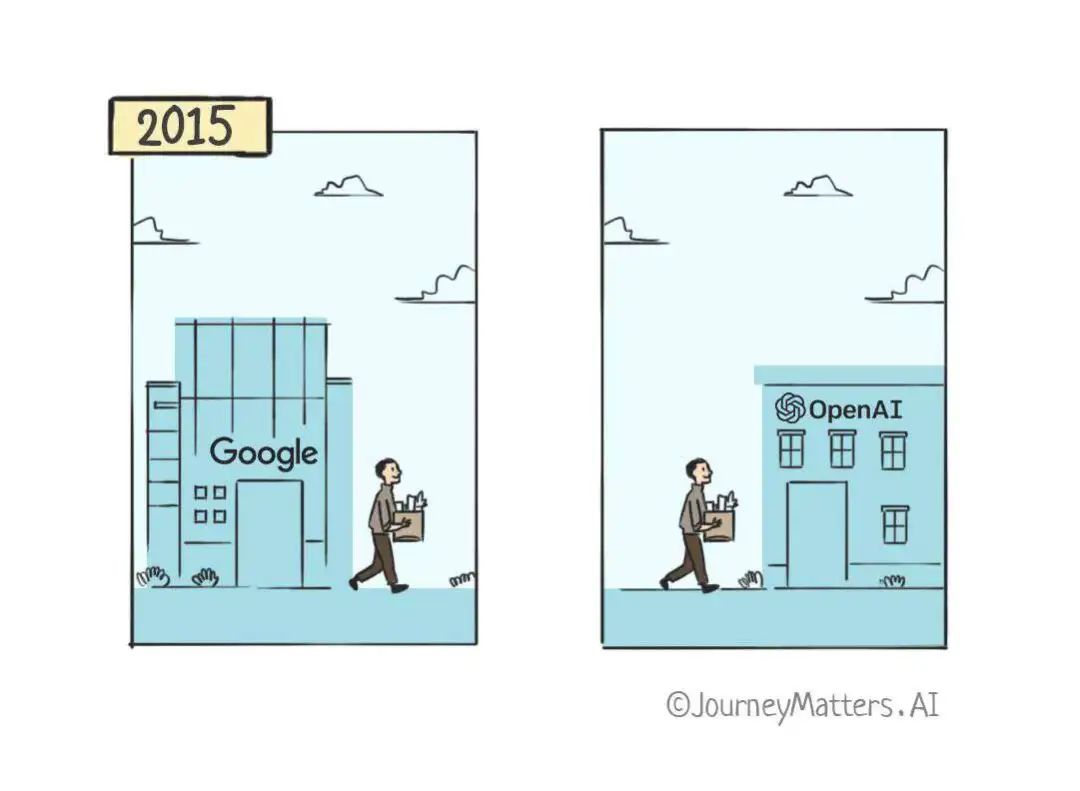

2015 :

De Google à OpenAI : un nouveau chapitre de l'intelligence artificielle

Sam Altman et Greg Brockman ont réuni Sutskever et neuf autres chercheurs pour voir s'il était encore possible de former un laboratoire de recherche avec les meilleurs esprits dans le domaine. En discutant du laboratoire qui allait devenir OpenAI, Sutskever s'est rendu compte qu'il avait trouvé un groupe de personnes partageant les mêmes idées qui partageaient ses croyances et ses aspirations.

Brockman a invité les 10 chercheurs à rejoindre son laboratoire et leur a donné trois semaines pour se décider. Google a appris cela et a offert à Sutskever une belle somme pour les rejoindre. Après avoir été rejeté, Google a augmenté son salaire à près de 2 millions de dollars la première année, soit deux ou trois fois ce qu'OpenAI allait lui verser.

Mais Sutskever a heureusement laissé passer une offre d'emploi de plusieurs millions de dollars chez Google, devenant finalement co-fondateur de l'OpenAI à but non lucratif.

L'objectif d'OpenAI est de faire progresser l'intelligence artificielle de manière responsable en exploitant l'intelligence artificielle au profit de tous.

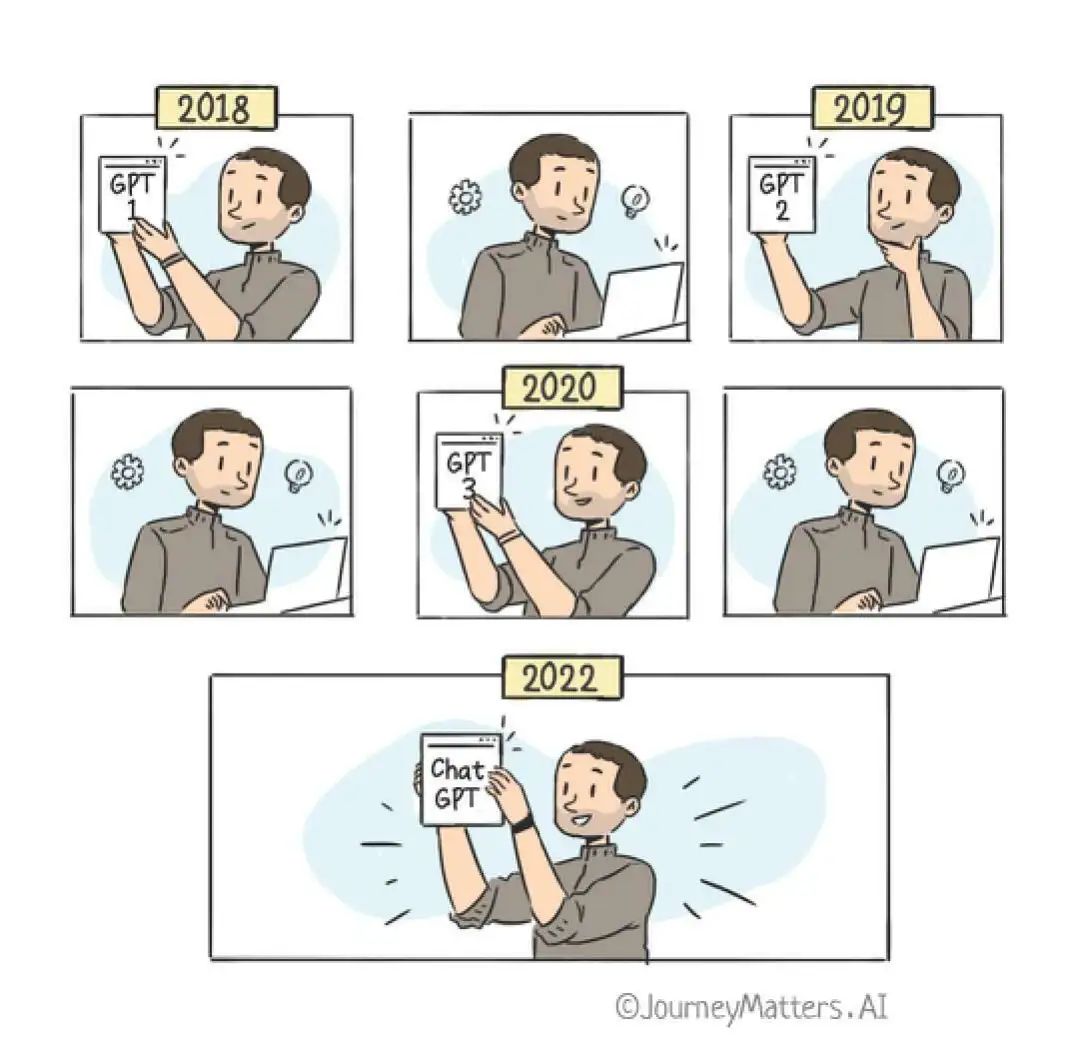

2018 : Développement des GPT 1, 2 & 3

Sutskever a conduit OpenAI à inventer GPT-1, puis à développer GPT-2, GPT-3 et ChatGPT.

Le modèle GPT (Generative Pre-trained Transformer) est une série de modèles de langage basés sur des réseaux de neurones. Chaque mise à jour du modèle GPT est une percée dans le domaine du traitement du langage naturel.

GPT-1 (2018) : Il s'agit du premier modèle de la série, formé sur un ensemble de données textuelles Internet à grande échelle. L'une de ses principales innovations est l'utilisation d'un pré-entraînement non supervisé, auquel cas le modèle apprend à prédire les mots dans les phrases en fonction du contexte des mots précédents. Cela permet au modèle d'apprendre la structure du langage et de générer un texte de type humain.

GPT-2 (2019) : S'appuyant sur le succès de GPT-1, il a été formé sur un ensemble de données plus large, ce qui a donné un modèle plus puissant. L'une des avancées majeures de GPT-2 est sa capacité à générer des passages de texte cohérents et fluides sur un large éventail de sujets, ce qui en fait un acteur clé dans les tâches de compréhension et de génération de langage non supervisées.

GPT-3 (2020) : GPT-3 est un bond en avant substantiel en termes d'échelle et de performances. Il a été formé sur un ensemble de données massif, utilisant 175 milliards de paramètres, beaucoup plus volumineux que les modèles précédents. GPT-3 atteint des performances de pointe sur un large éventail de tâches linguistiques, telles que la réponse aux questions, la traduction automatique et la synthèse, avec des capacités quasi humaines. Il a également démontré la capacité d'effectuer des tâches de codage simples, d'écrire des articles de presse cohérents et même de générer de la poésie.

GPT-4 : Devrait paraître bientôt, prévu en 2023.

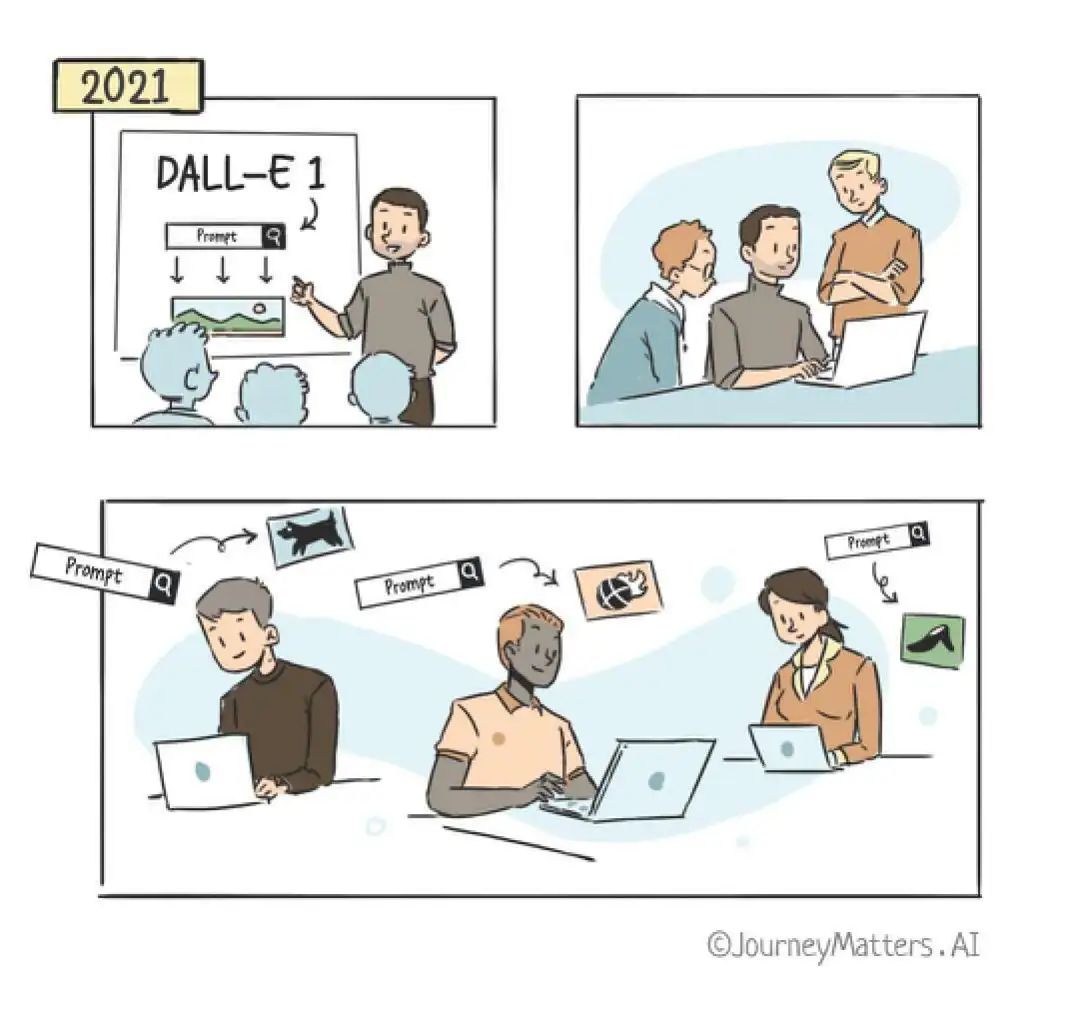

2021 : Développement de DALL-E 1

Sutskever a également dirigé l'invention par OpenAI de DALL-E 1, un modèle génératif d'images alimenté par l'IA. Il utilise une architecture et un processus de formation similaires à ceux du modèle GPT, mais est appliqué à la génération d'images au lieu de texte.

Bon nombre des principaux générateurs d'images d'aujourd'hui (DALL-E 2, MidJourney) après DALL-E 1 sont basés sur des architectures de transformateurs similaires et sont entraînés sur des ensembles de données d'images similaires et les sous-titres associés. DALL-E 2 et MidJourney sont de nouveaux développements après DALL-E 1.

2022 : Dévoiler ChatGPT au monde

Le 30 novembre 2022, Sutskever a aidé à lancer ChatGPT, qui a attiré l'attention du public et est passé à 1 million d'utilisateurs en seulement 5 jours.

ChatGPT fonctionne en préformant un réseau neuronal profond sur un grand ensemble de données de texte, puis en l'ajustant sur des tâches spécifiques, telles que répondre à des questions ou générer du texte. Il s'agit d'un système d'intelligence artificielle conversationnel basé sur le modèle de langage GPT-3.

Comprendre le contexte d'une conversation et générer une réponse appropriée est l'une des fonctions principales de ChatGPT. Le bot se souvient de vos fils de conversation et fait des réponses de suivi basées sur les questions et réponses précédentes. Contrairement aux autres chatbots, qui sont généralement limités à des réponses préprogrammées, ChatGPT peut générer des réponses dans l'application, permettant des conversations plus dynamiques et diversifiées.

Elon Musk, l'un des fondateurs d'OpenAI, a déclaré : "ChatGPT est terriblement bon. Nous ne sommes pas loin d'une intelligence artificielle dangereusement puissante."

note de fin

La passion d'Ilya Sutskever pour l'intelligence artificielle est à l'origine de ses recherches révolutionnaires qui changent le cours du domaine. Son travail sur l'apprentissage en profondeur et l'apprentissage automatique a joué un rôle déterminant dans l'avancement de l'état de l'art et dans la définition de l'orientation future du domaine.

Nous avons également constaté de visu l'impact du travail de Sutskever sur l'IA. Il a changé le cours du terrain et continuera à travailler dans ce sens. Malgré de multiples tentations matérielles, Sutskever a choisi de poursuivre sa passion et de se concentrer sur ses recherches ; son dévouement à son travail est exemplaire pour tout chercheur.

Aujourd'hui, nous avons vu l'impact de Sutskever sur notre monde. De toute évidence, ce n'est que le début.

(sur)

Cliquez sur l'image ci-dessous pour voir plus excitant