Tabla de contenido

1. Características de la imagen

1. Funciones de bajo nivel de las imágenes.

- Las características de bajo nivel de las imágenes se refieren a características como bordes, colores y texturas.

- Las funciones de bajo nivel tienen mayor resolución y contienen más ubicación e información detallada, pero contienen menos información semántica y más ruido.

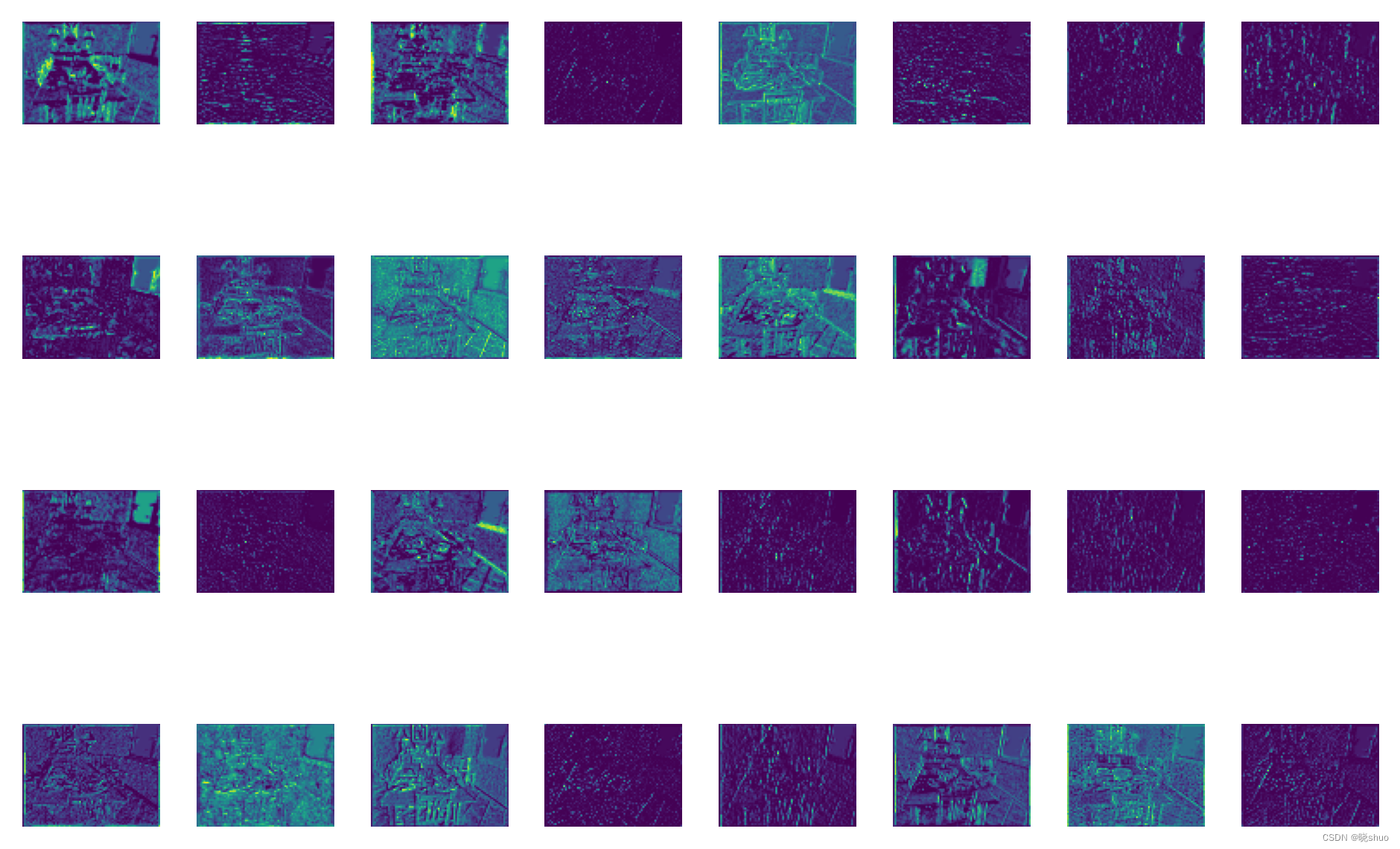

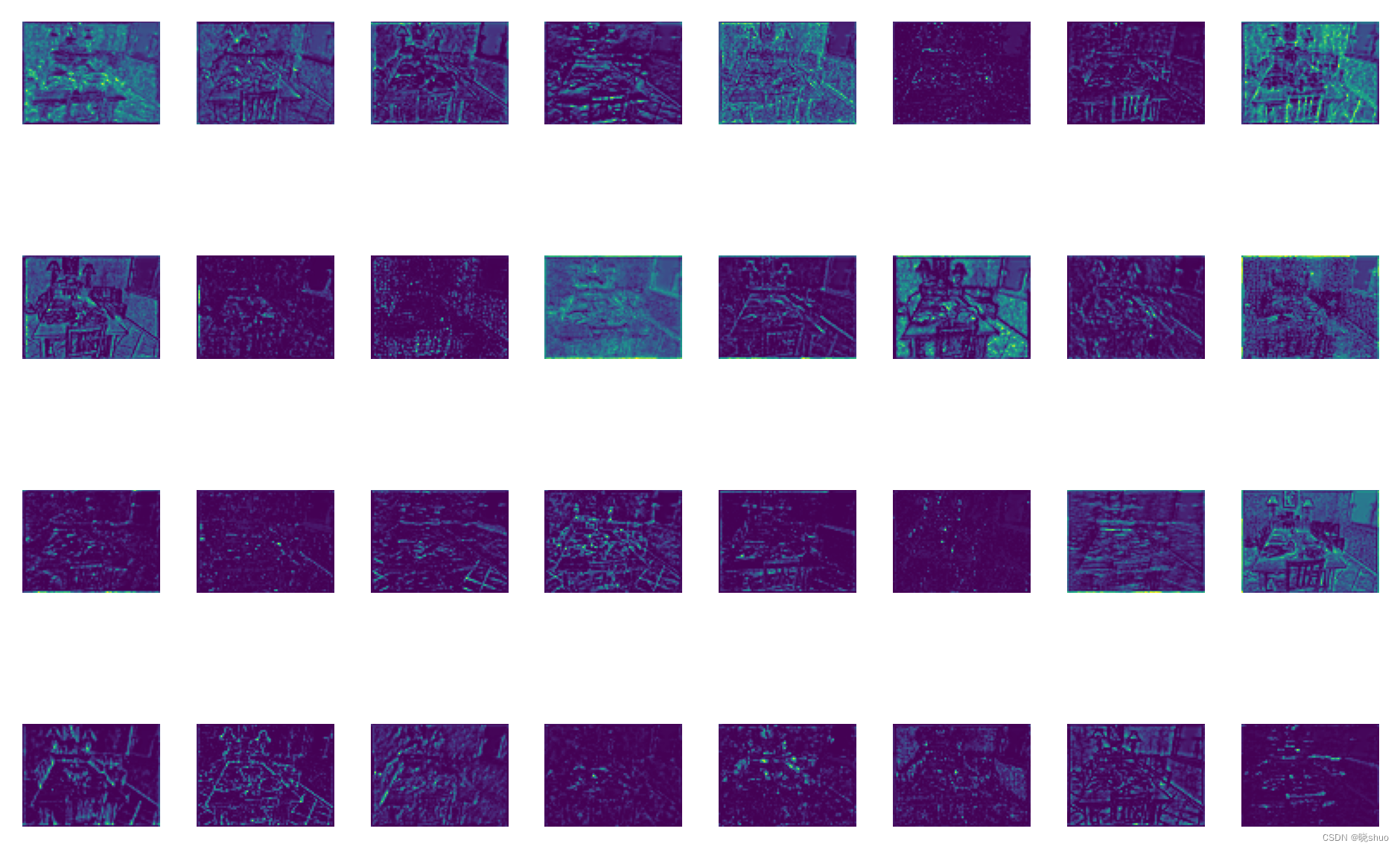

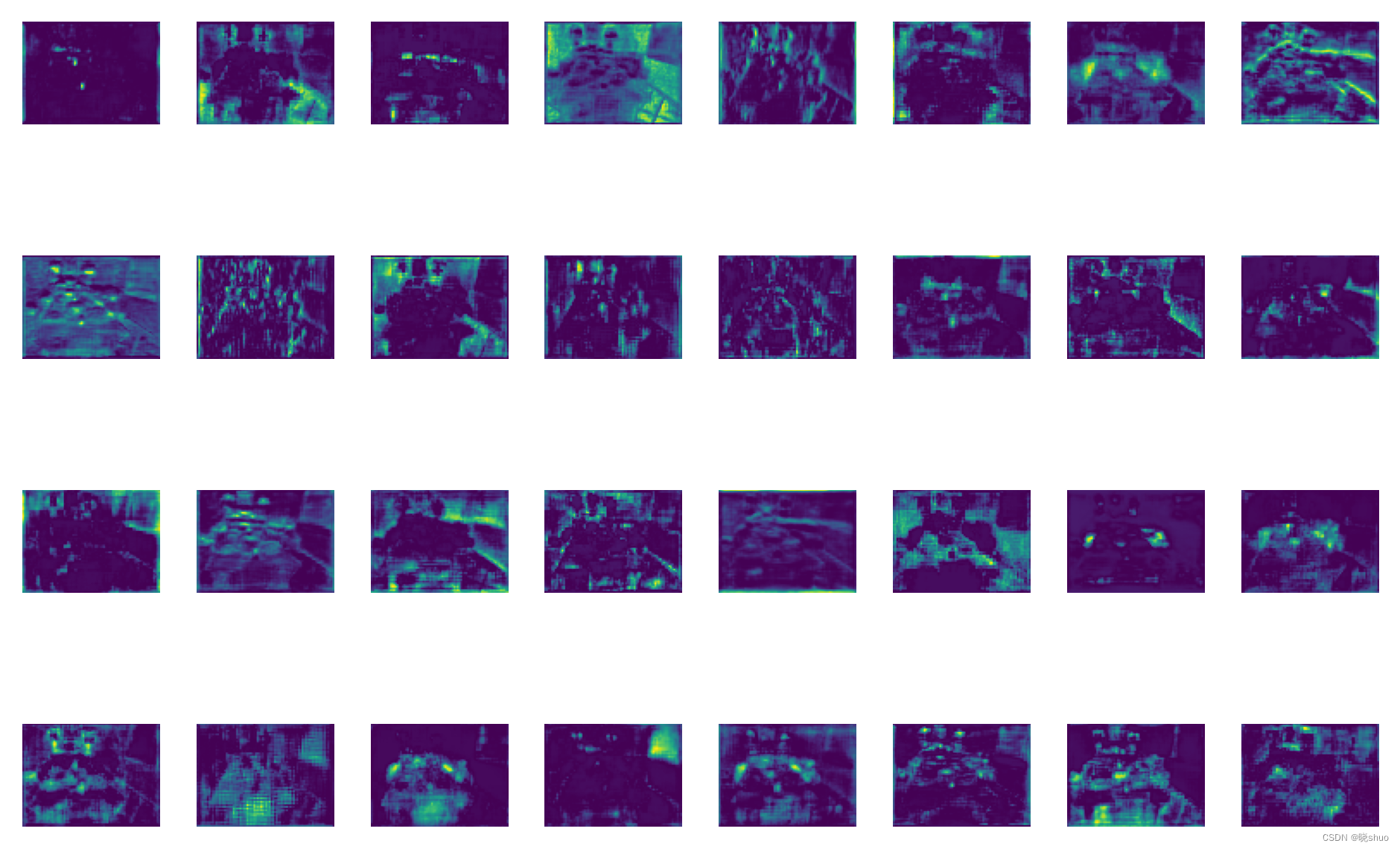

- La imagen original y el mapa de características generado por la red convolucional superficial son características de bajo nivel, y información como contornos y bordes se puede ver claramente en el mapa de características de bajo nivel.

2. Funciones de alto nivel de las imágenes.

- Las características semánticas de alto nivel de las imágenes se refieren a cosas que las personas pueden entender, como sofás, perros, botellas, etc.

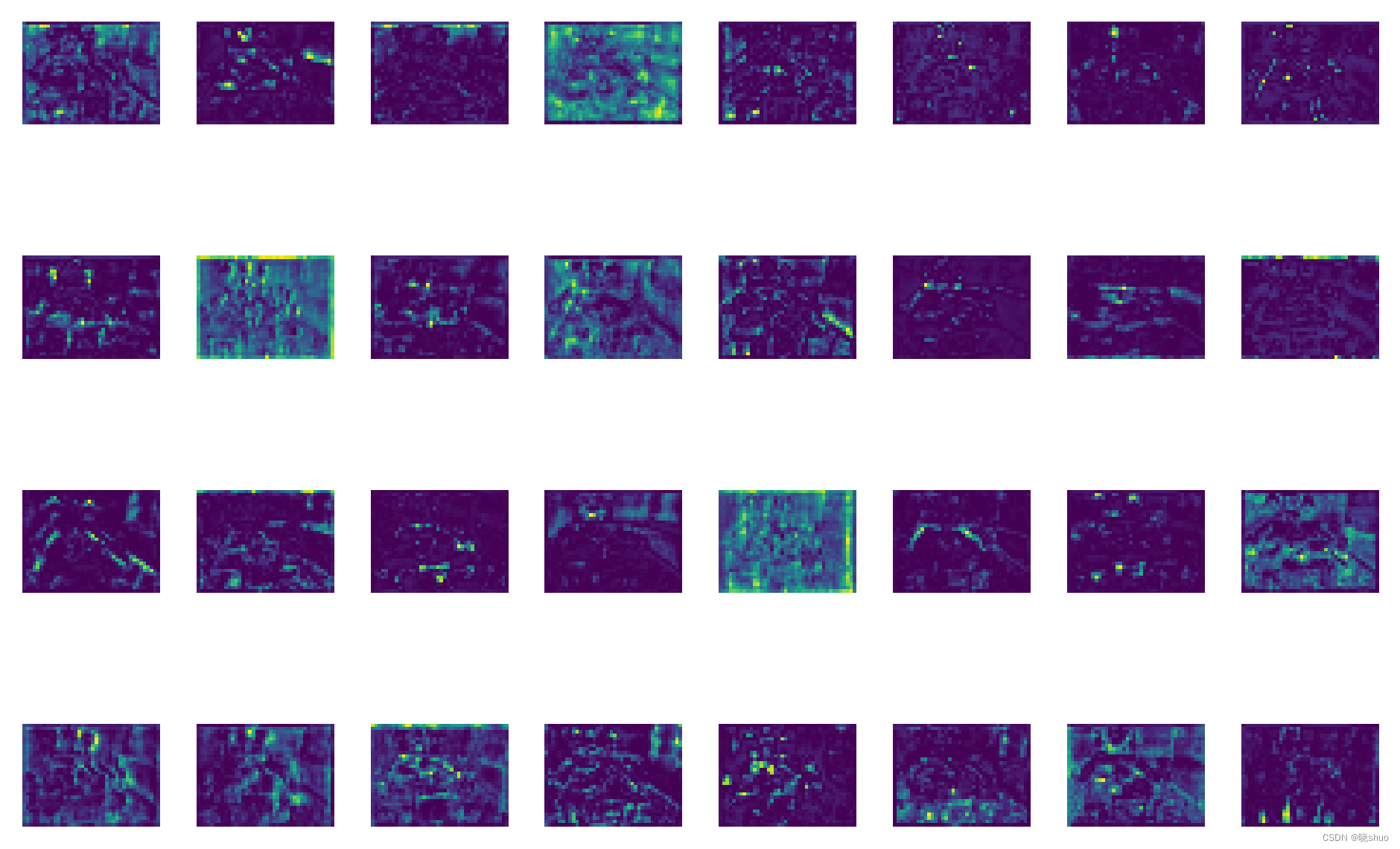

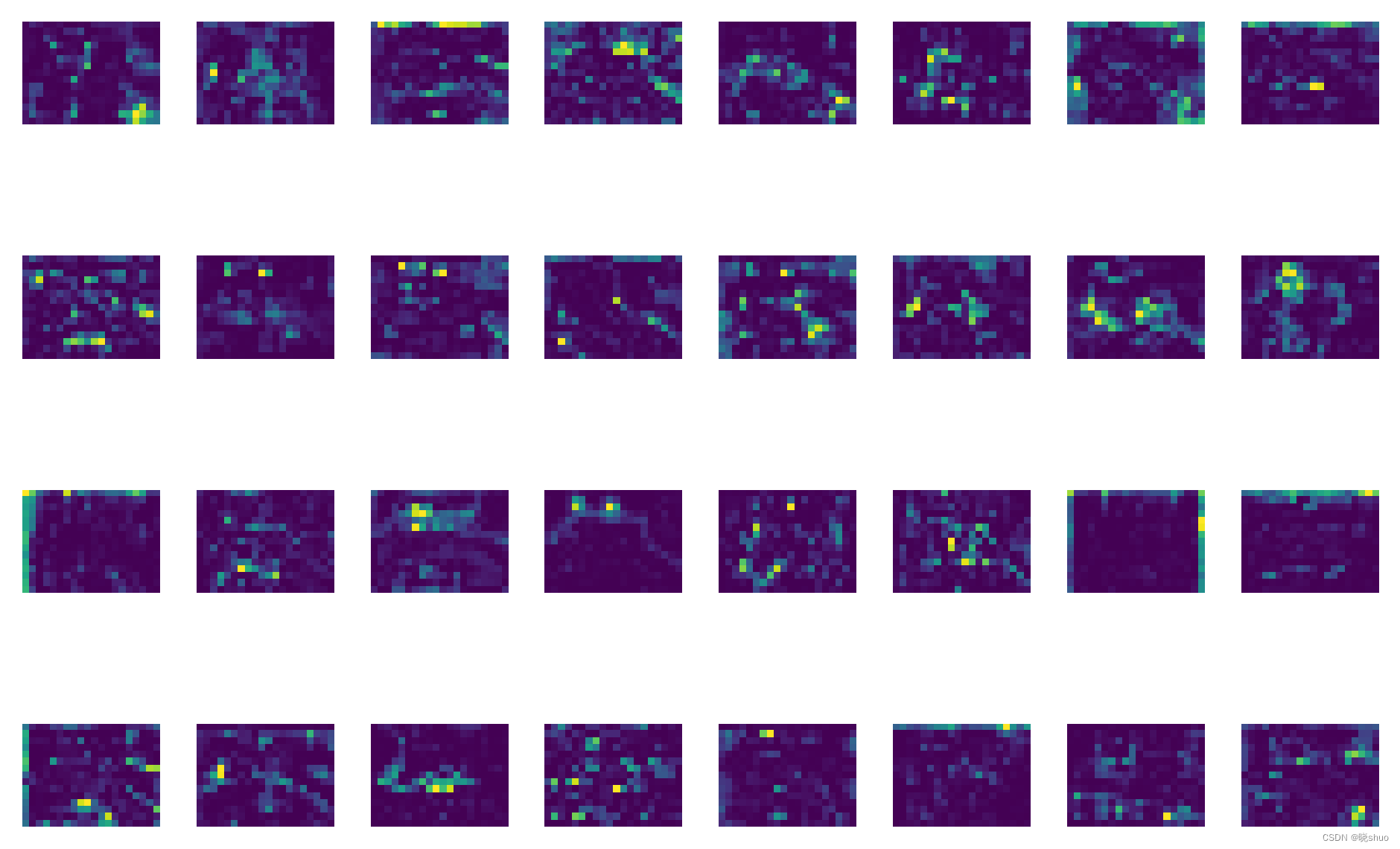

- Las funciones de alto nivel contienen más información semántica, pero su resolución es menor y su percepción de ubicación y detalles también es pobre.

- Después de una red convolucional profunda, la información semántica se puede resumir de manera efectiva, que es cómo es un área determinada, y no es necesario mostrar información de textura específica.

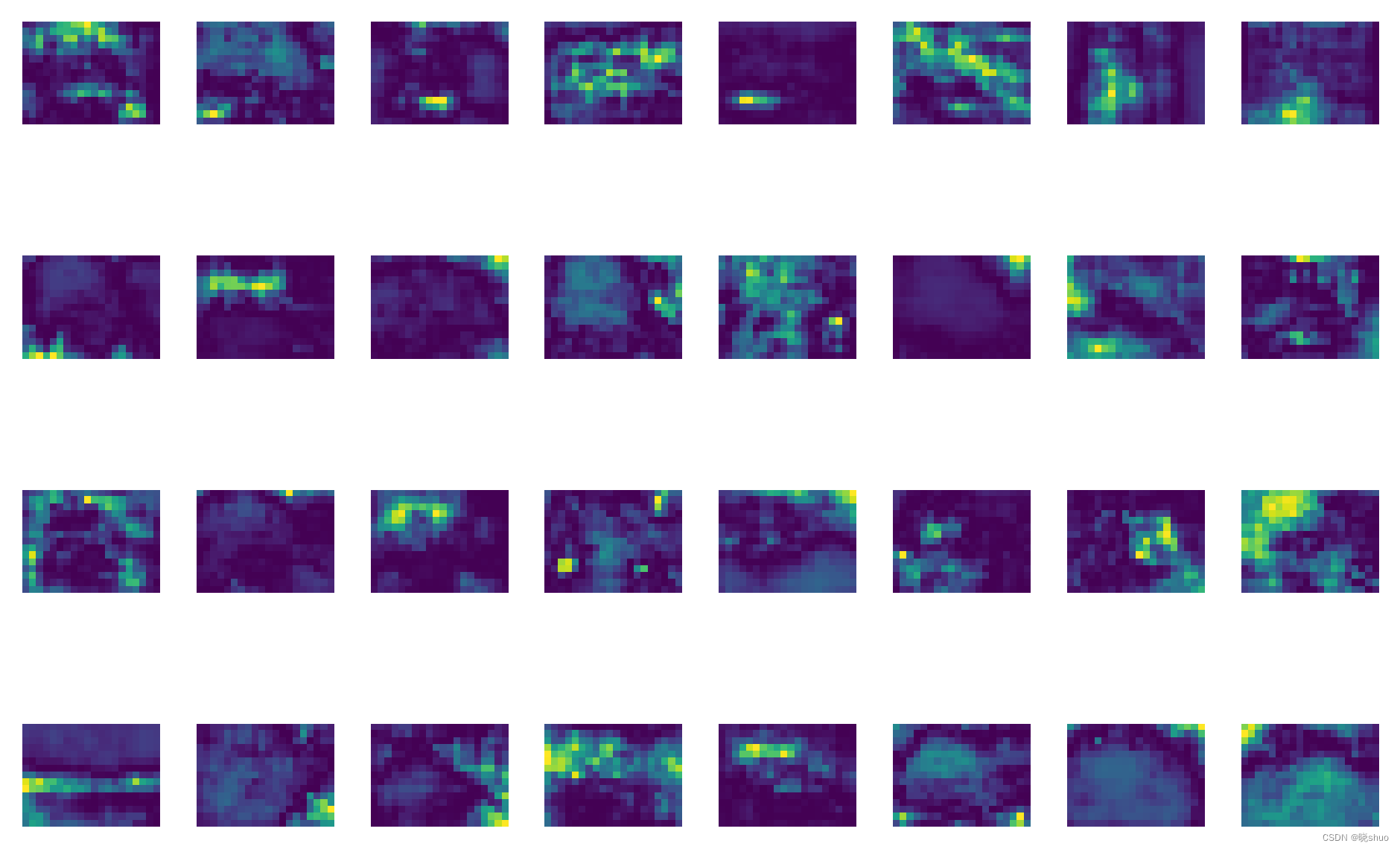

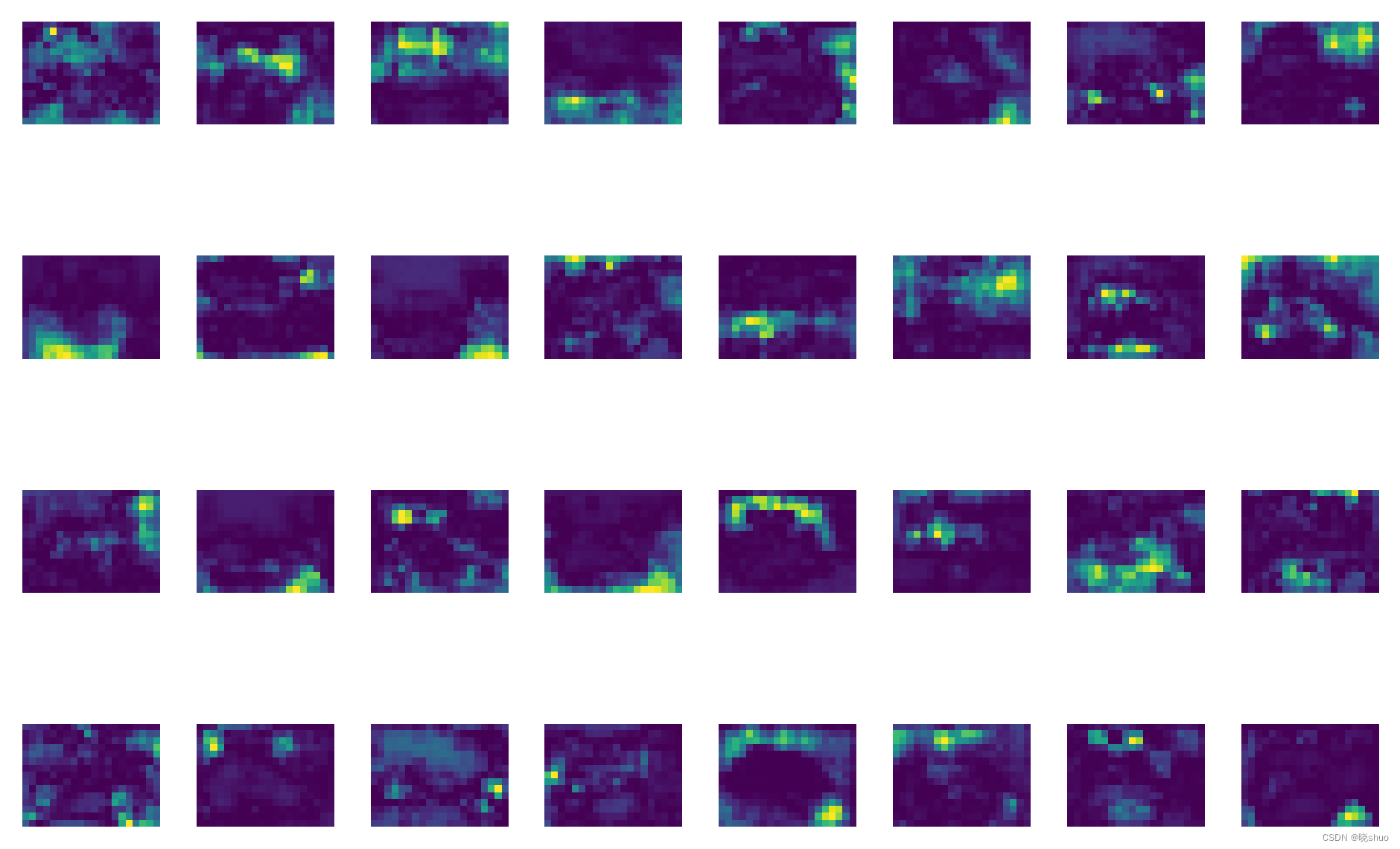

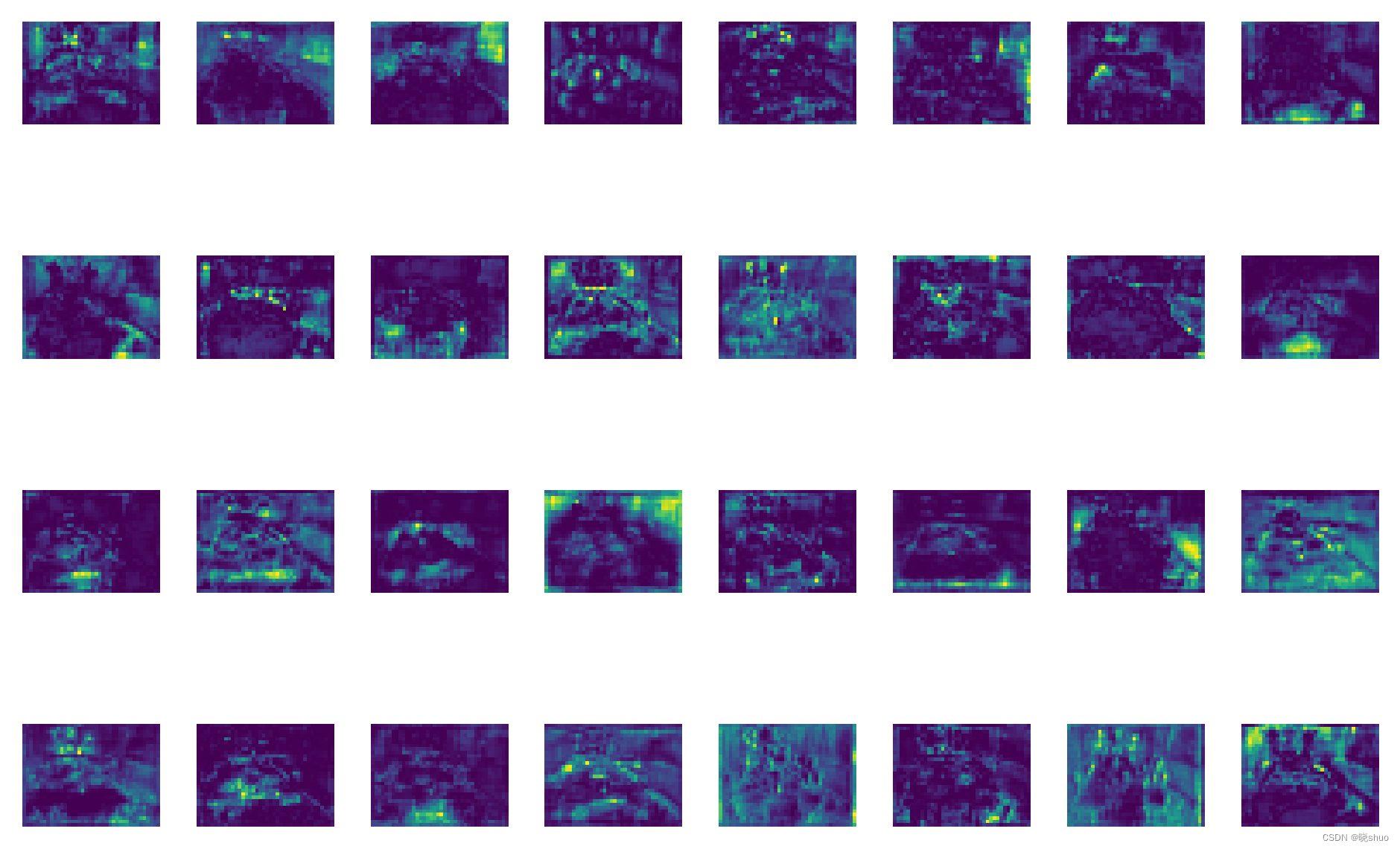

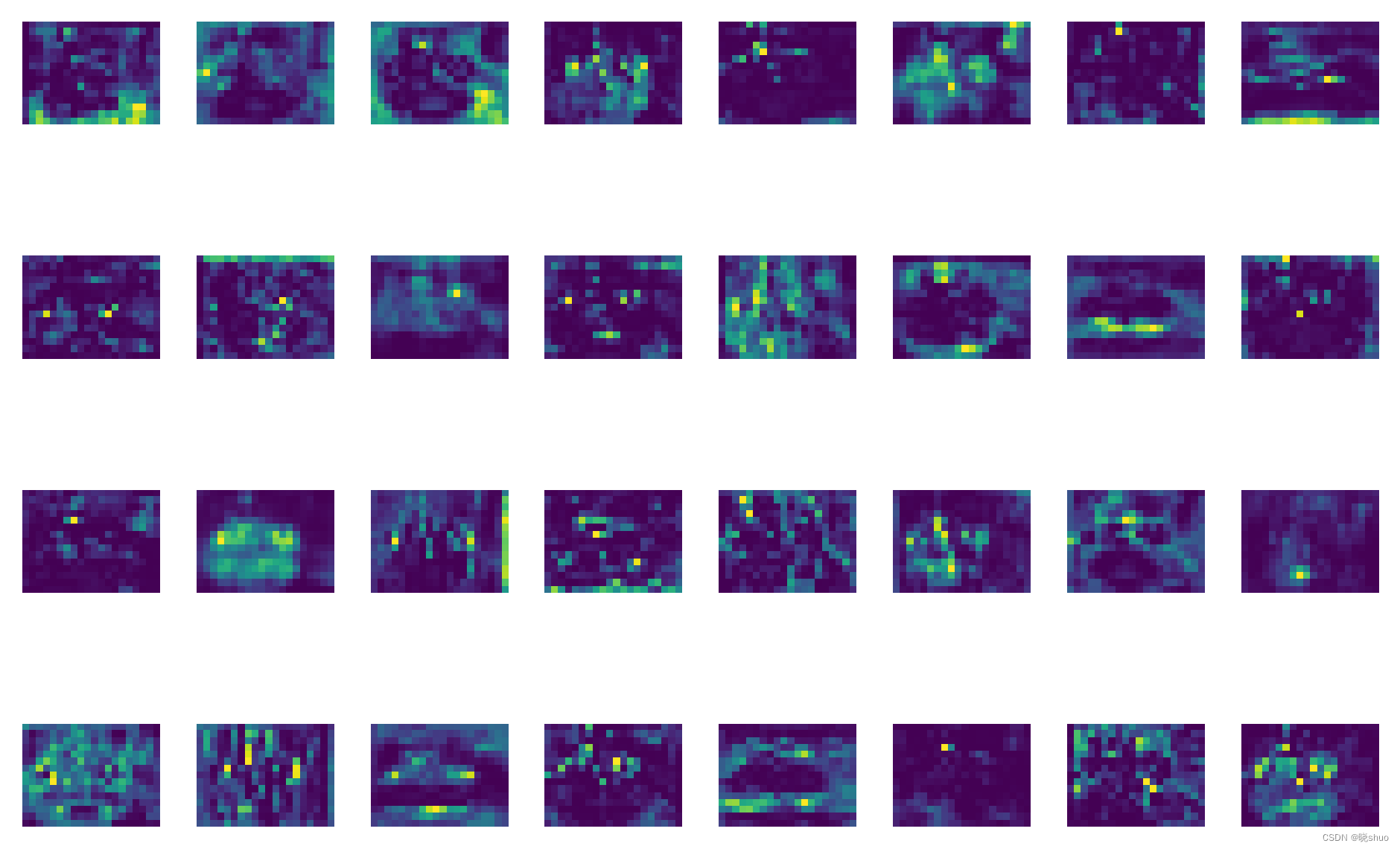

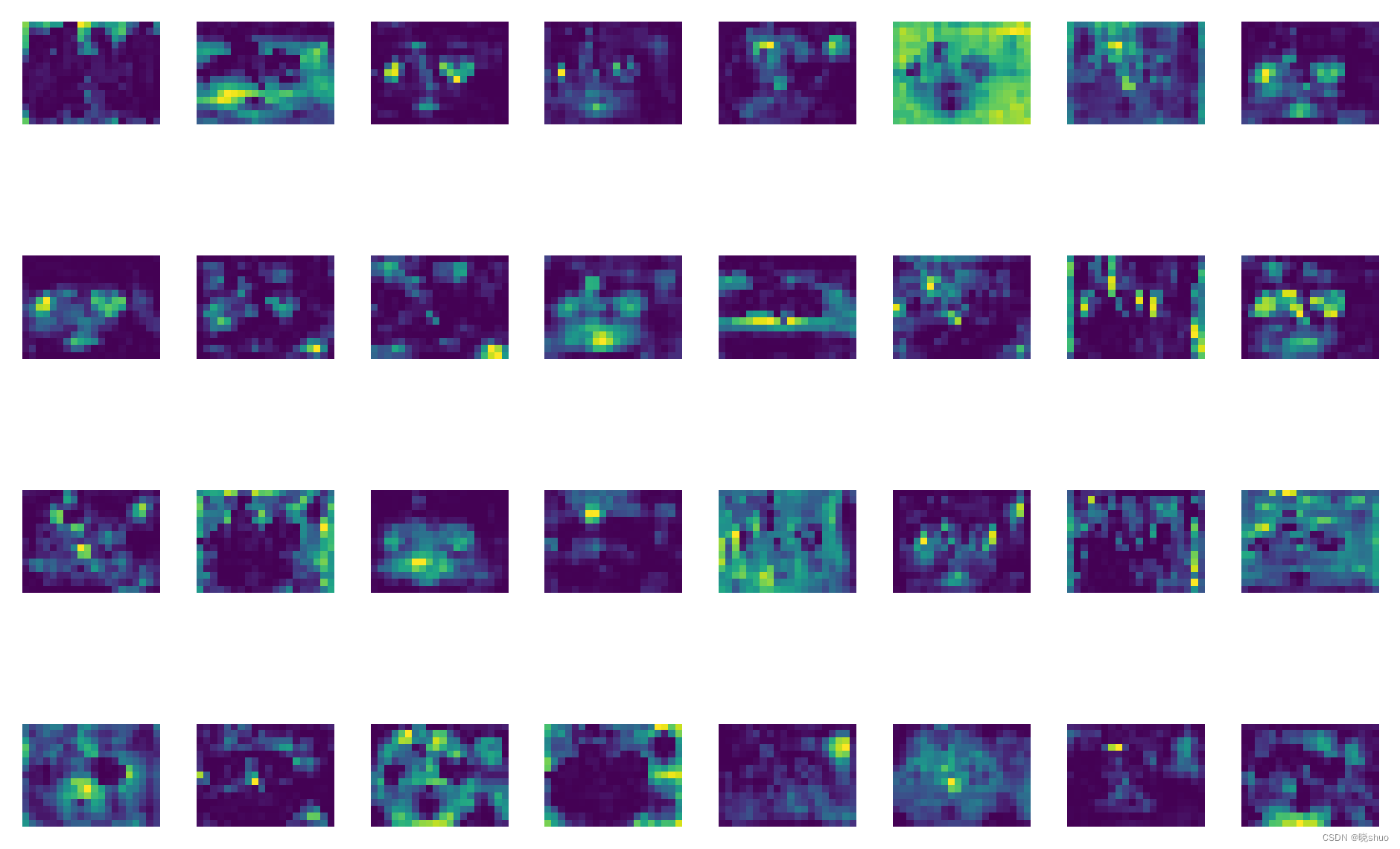

3. Ejemplo

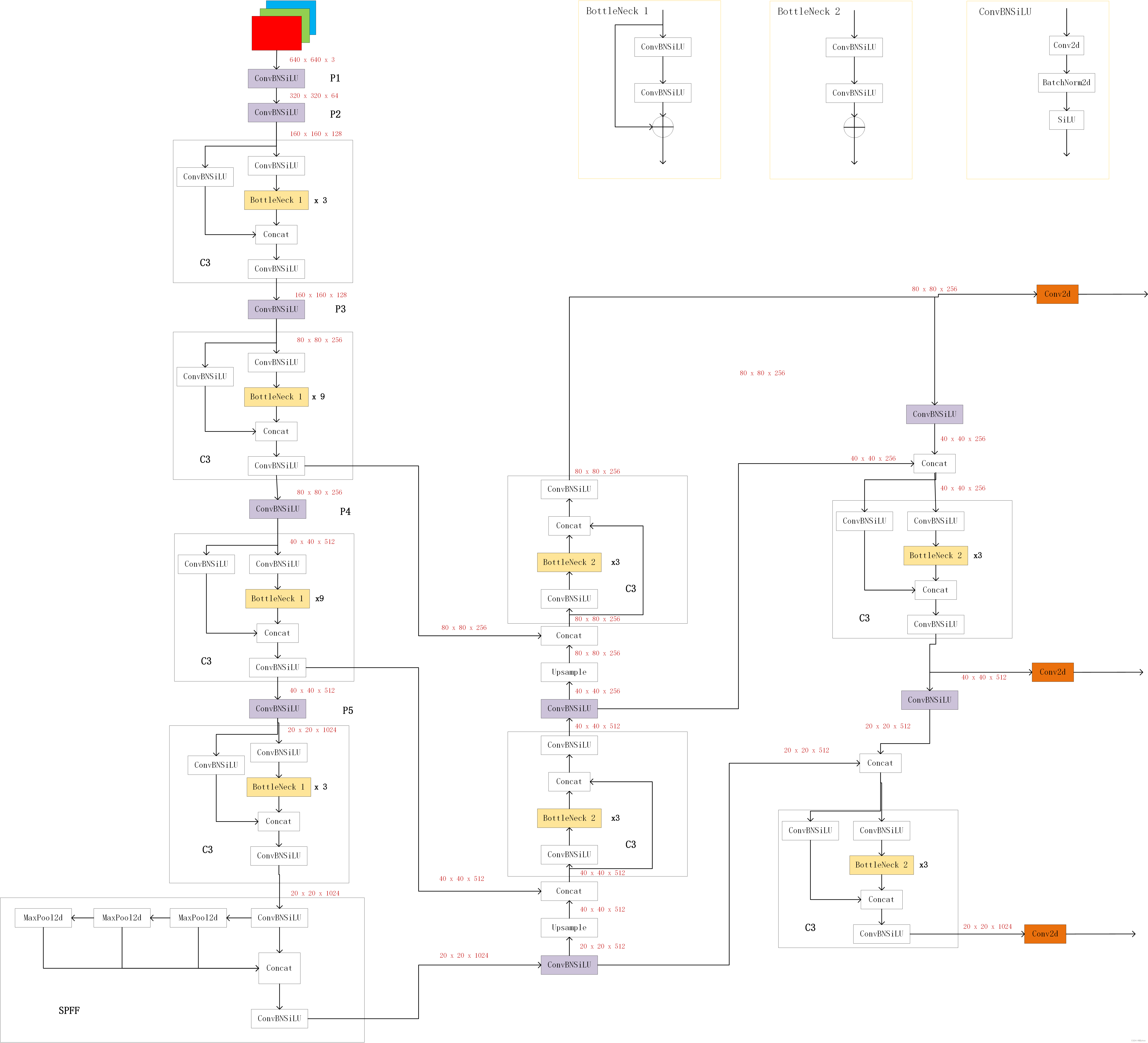

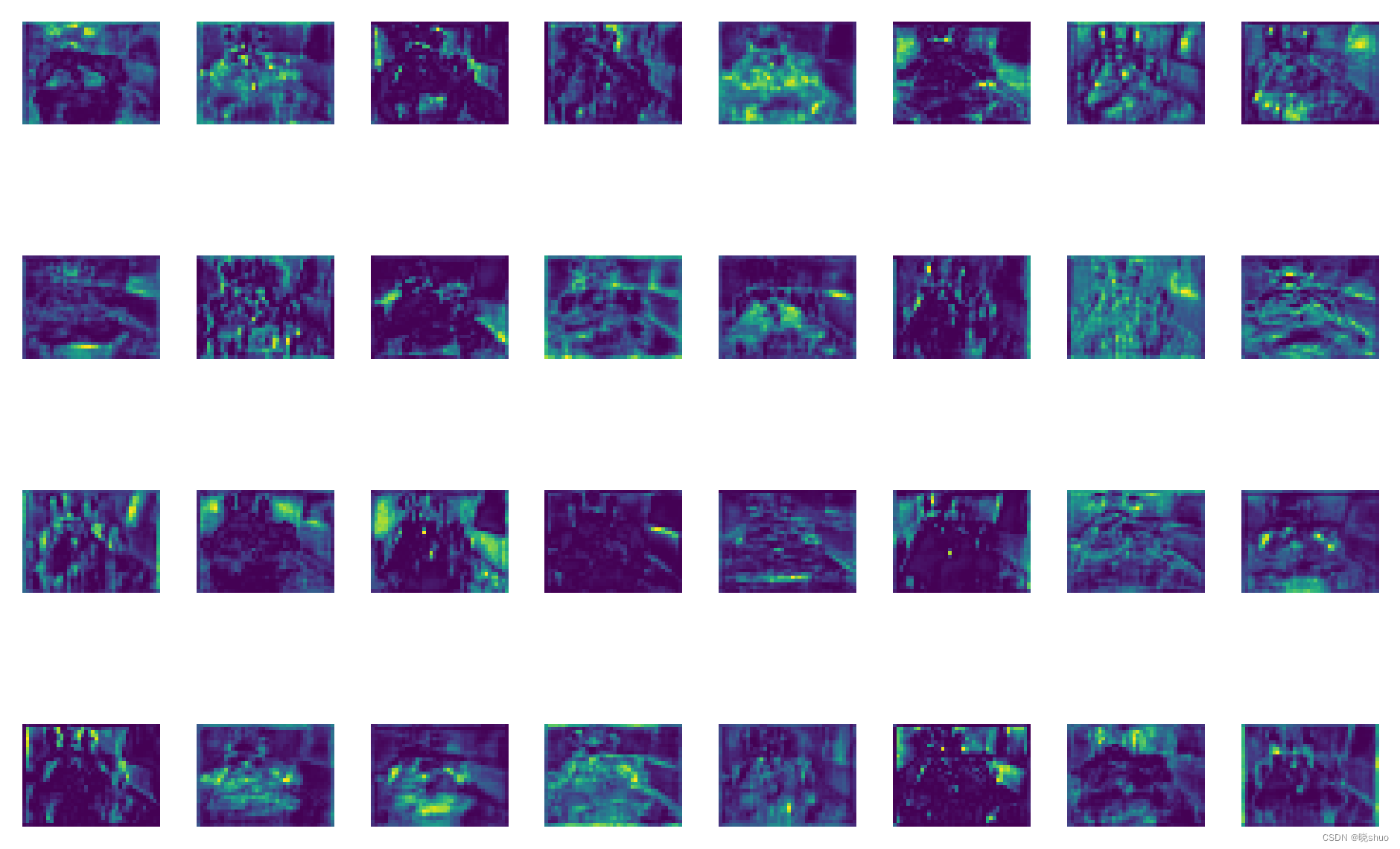

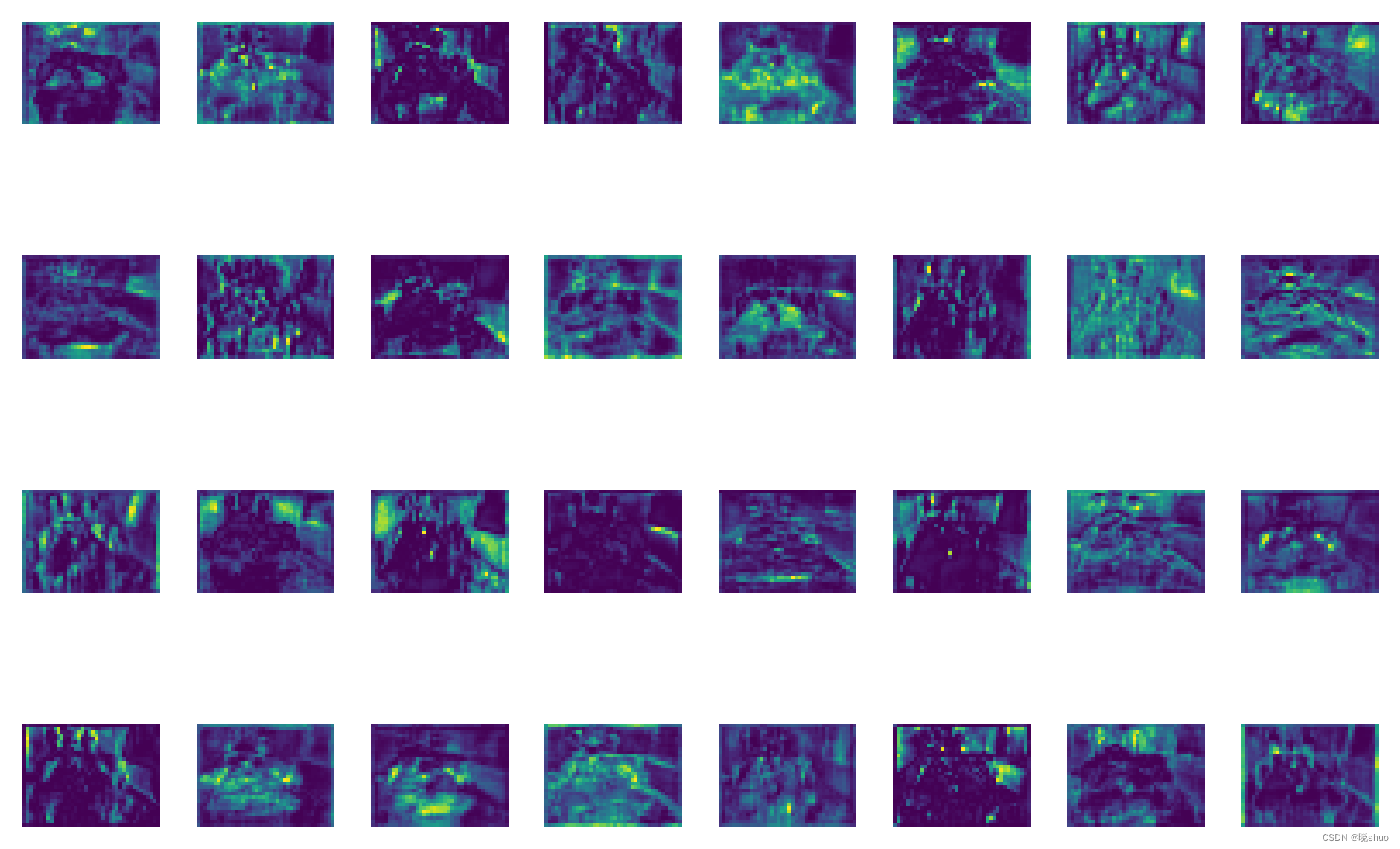

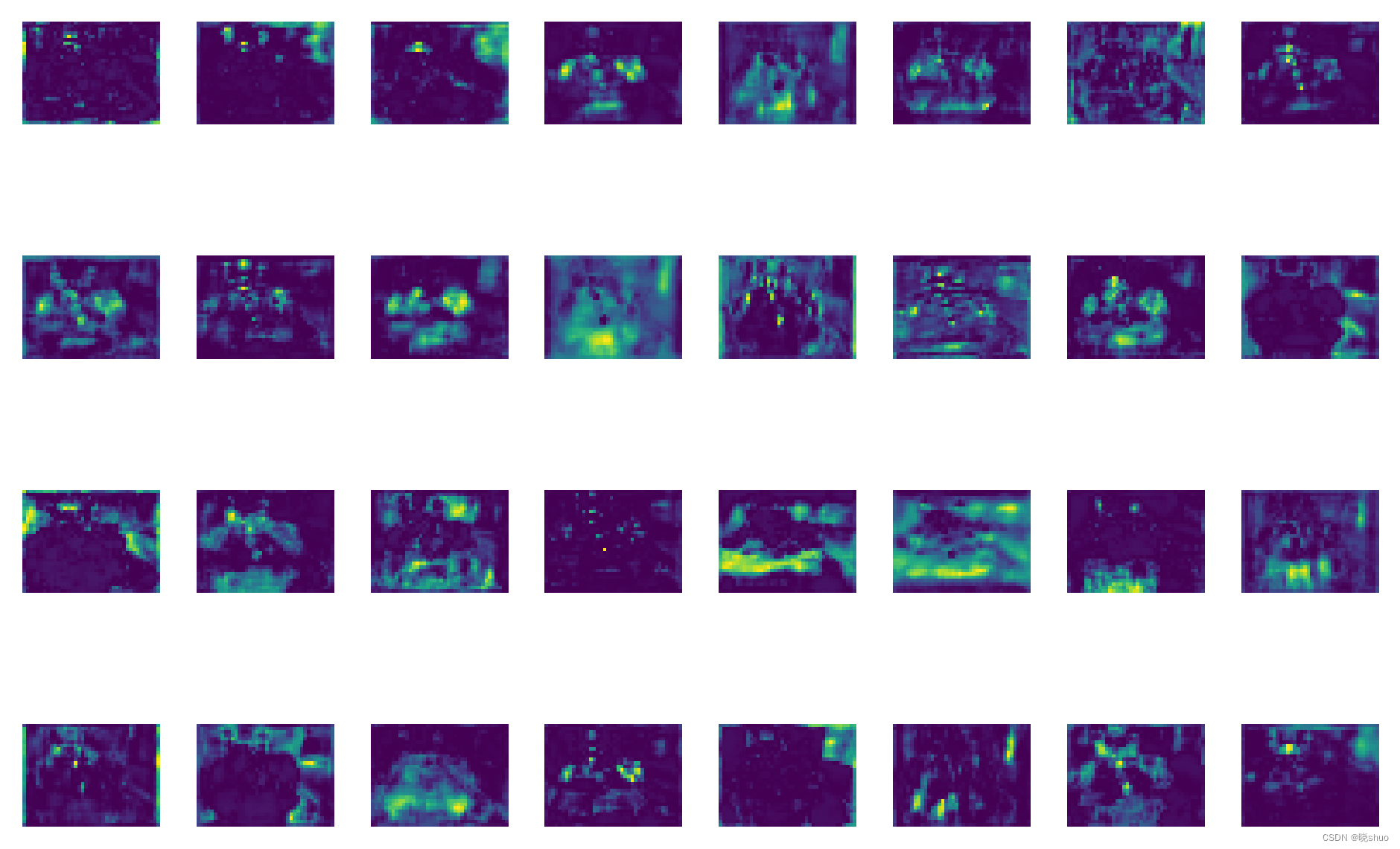

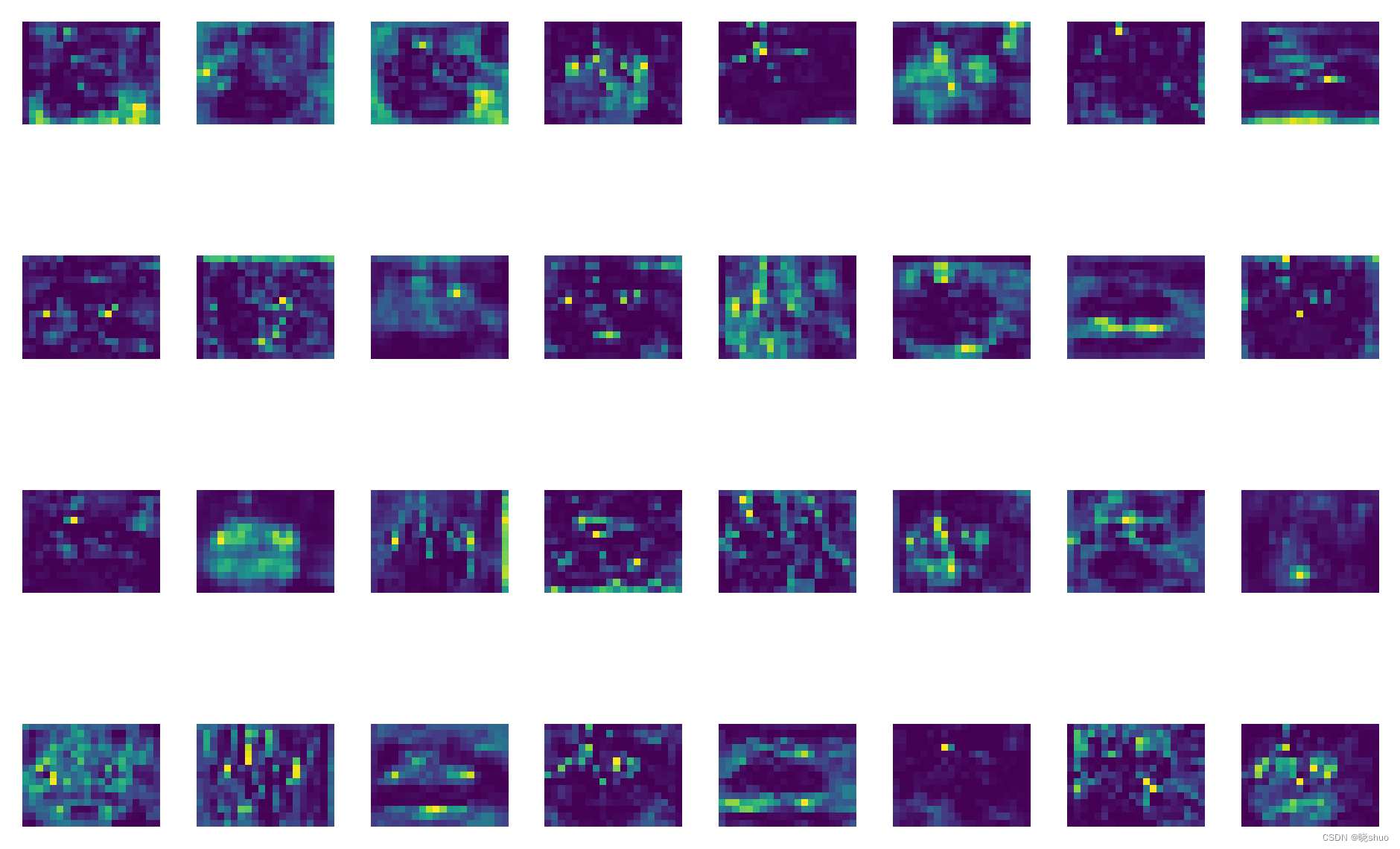

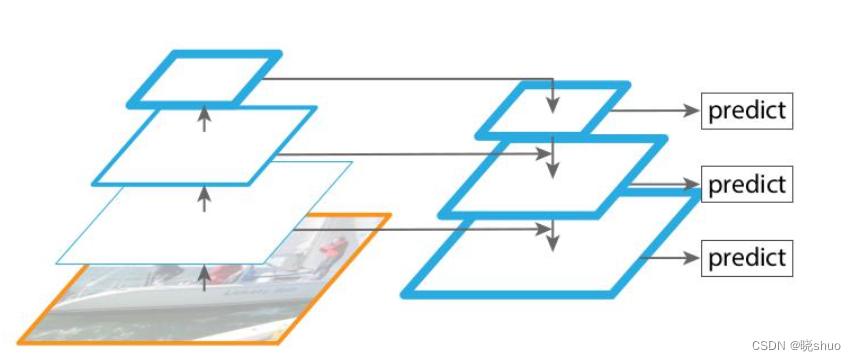

- Tomando la red YOLOv5 como ejemplo a continuación, se muestra visualmente el mapa de características de salida de la imagen original después de cada capa de la red (un total de 23 capas, visualizadas capa por capa). La estructura de la red de YOLOv5 es la siguiente:

- Imagen de entrada original

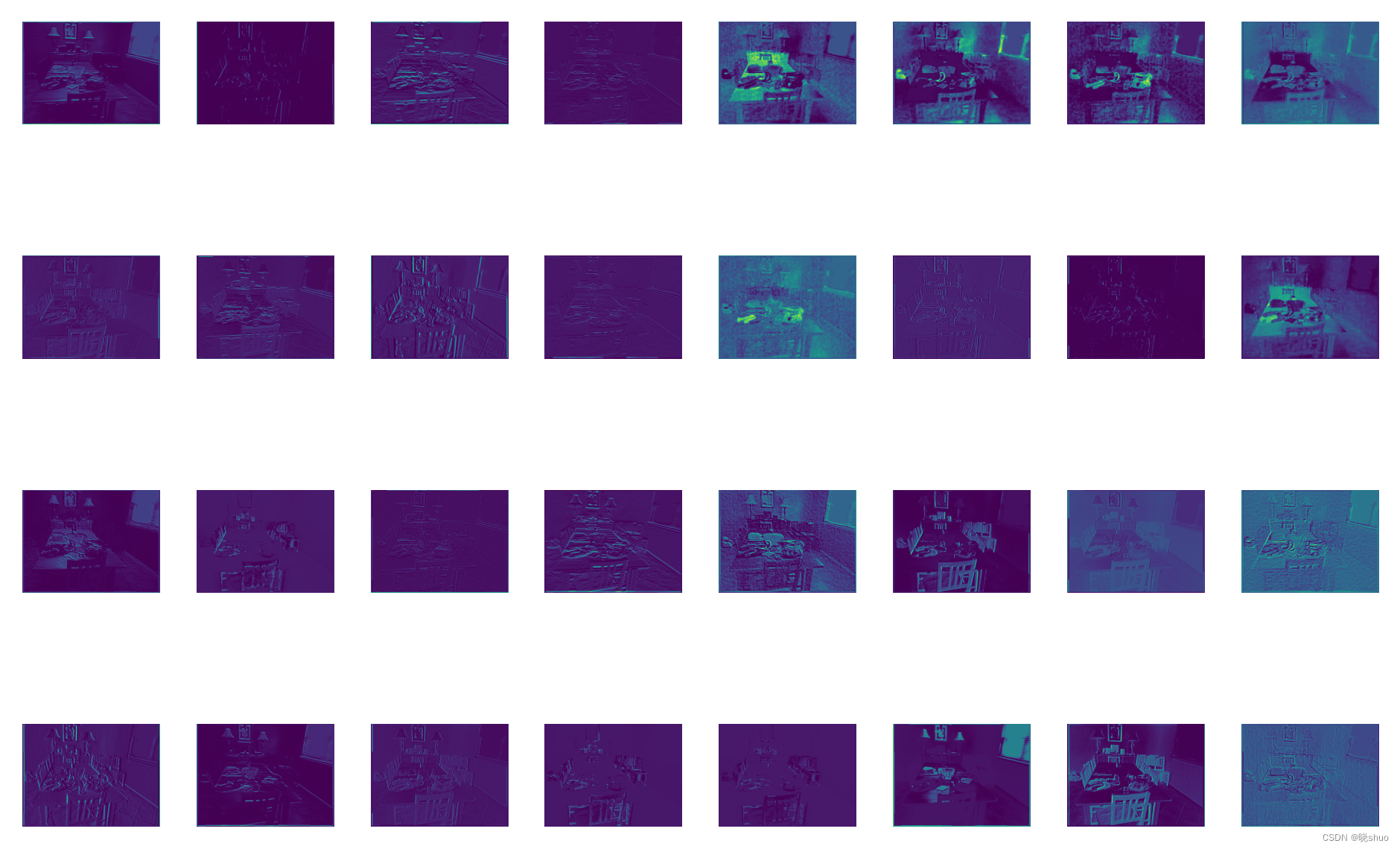

- Salida del mapa de características por Conv ( salida de la capa 0

) - Salida del mapa de características por Conv ( salida de la capa 1

) - Salida del mapa de características por C3 (salida de la capa 2 )

- Salida del mapa de características por Conv ( Salida de la capa 3

) - Mapa de características después de C3 ( salida de la capa 4

) - Salida de mapa de características por Conv (salida de capa 5 )

- Salida de mapa de características por C3 (salida de capa 6 )

- Salida de características por Conv salida de capa 7

) - Característica salida del mapa por C3 (salida de la capa 8 )

- Salida del mapa de características por SPPF ( capa 9salida)

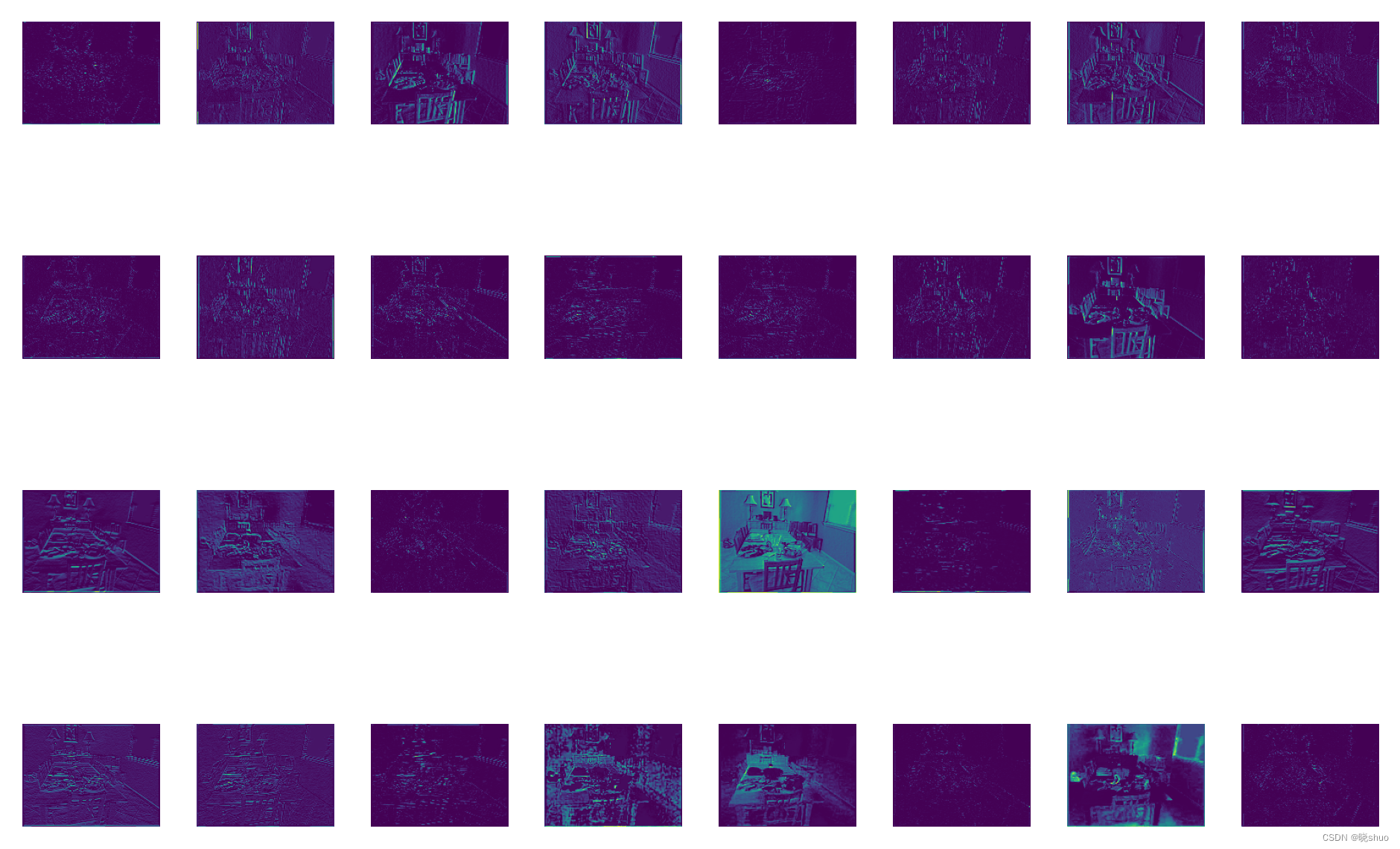

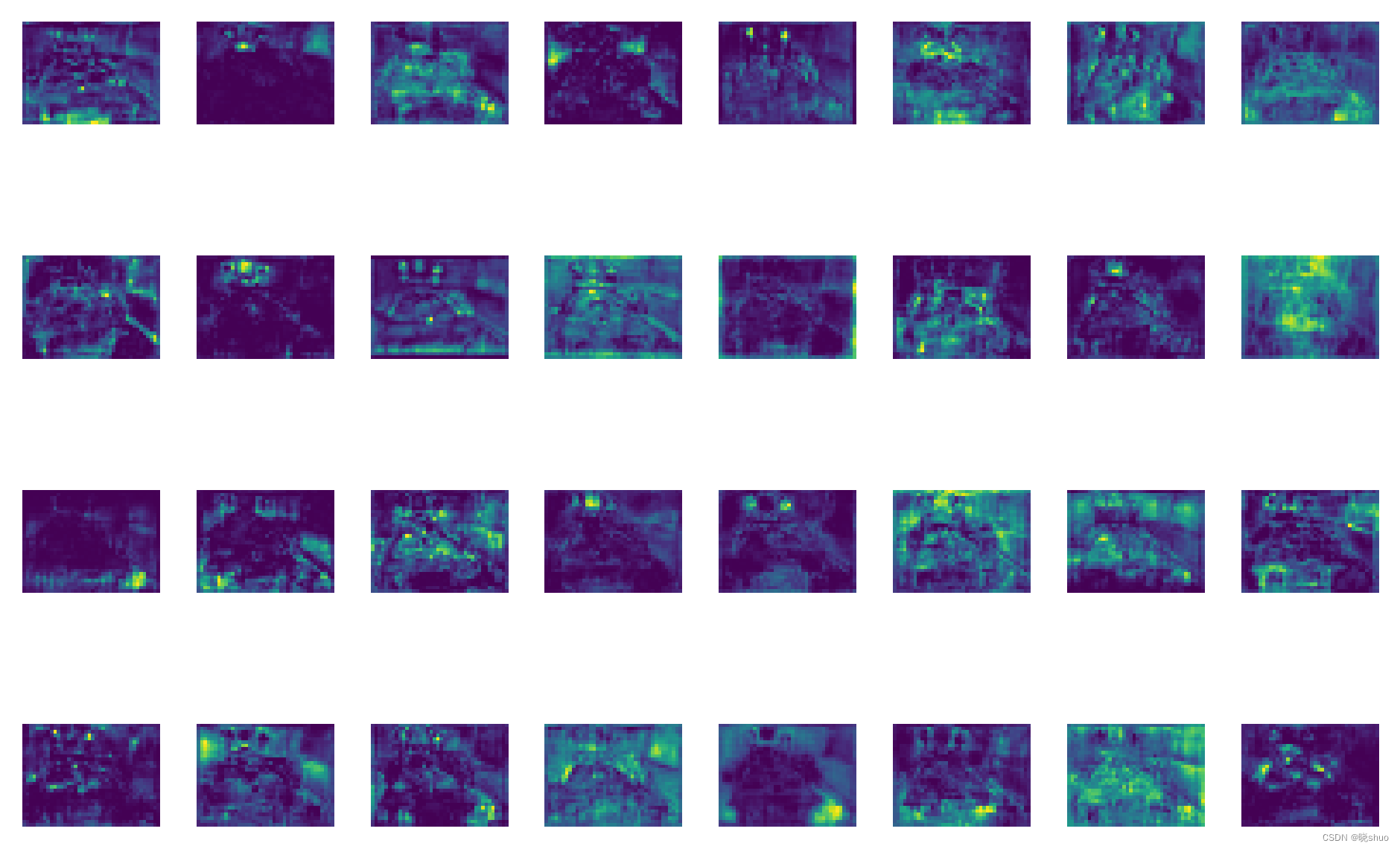

- la salida del mapa de características por Conv ( salida de la capa 10

) - la salida del mapa de características por Upsample ( salida de la capa 11

) - la salida del mapa de características por Concat (salida de la capa 12 )

- la salida del mapa de características por C3 (salida de la capa 12) Salida de )

- Salida del mapa de características por Conv ( salida de la capa 14

) - Salida del mapa de características por Upsample ( salida de la capa 15

) - Salida del mapa de características por Concat (salida de la capa 16 )

- Salida del mapa de características por C3 ( Salida de la capa 17

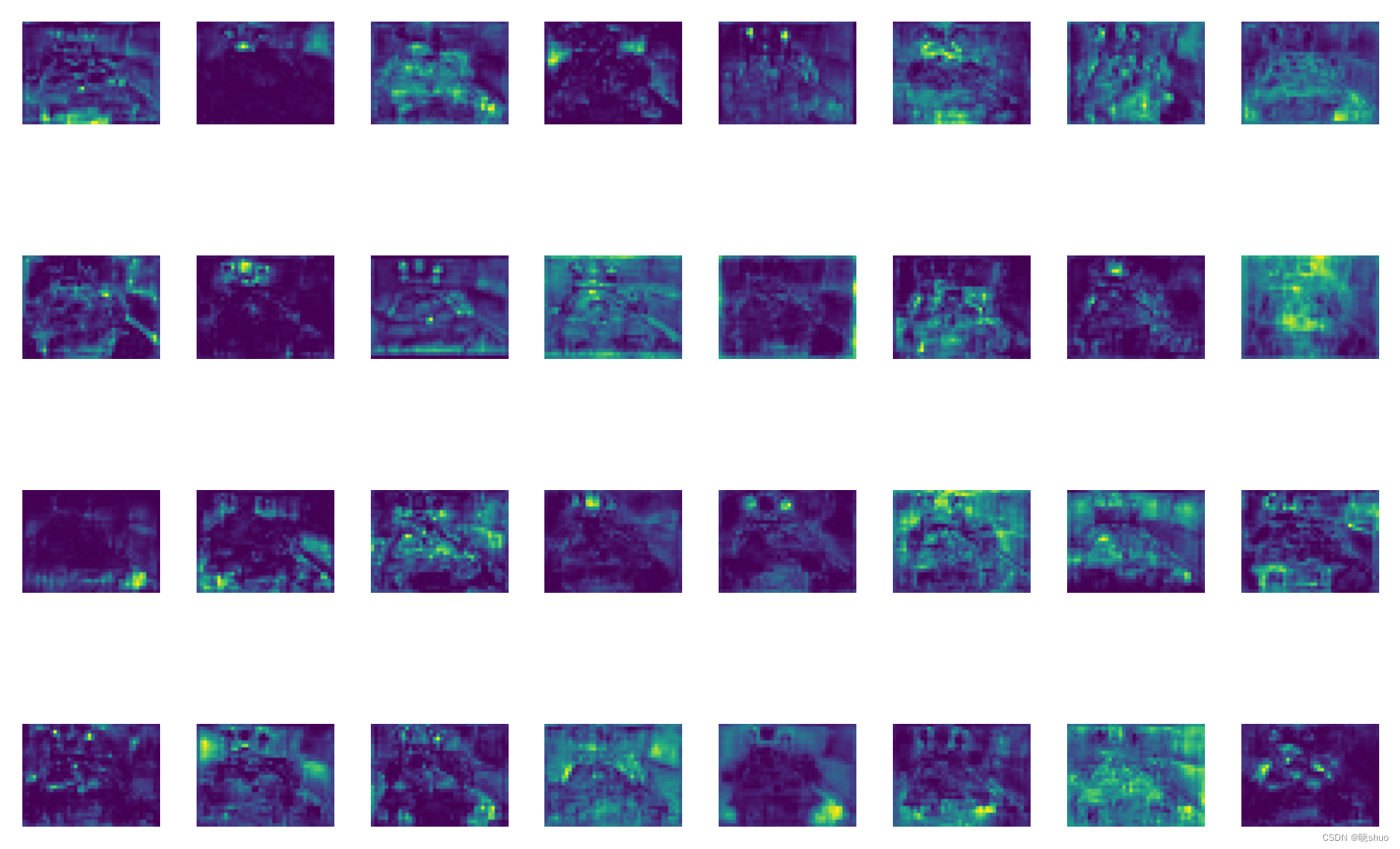

) - Salida del mapa de características por Conv (Salida de la capa 18 )

- ConcatSalida del mapa de características ( salida de la capa 19

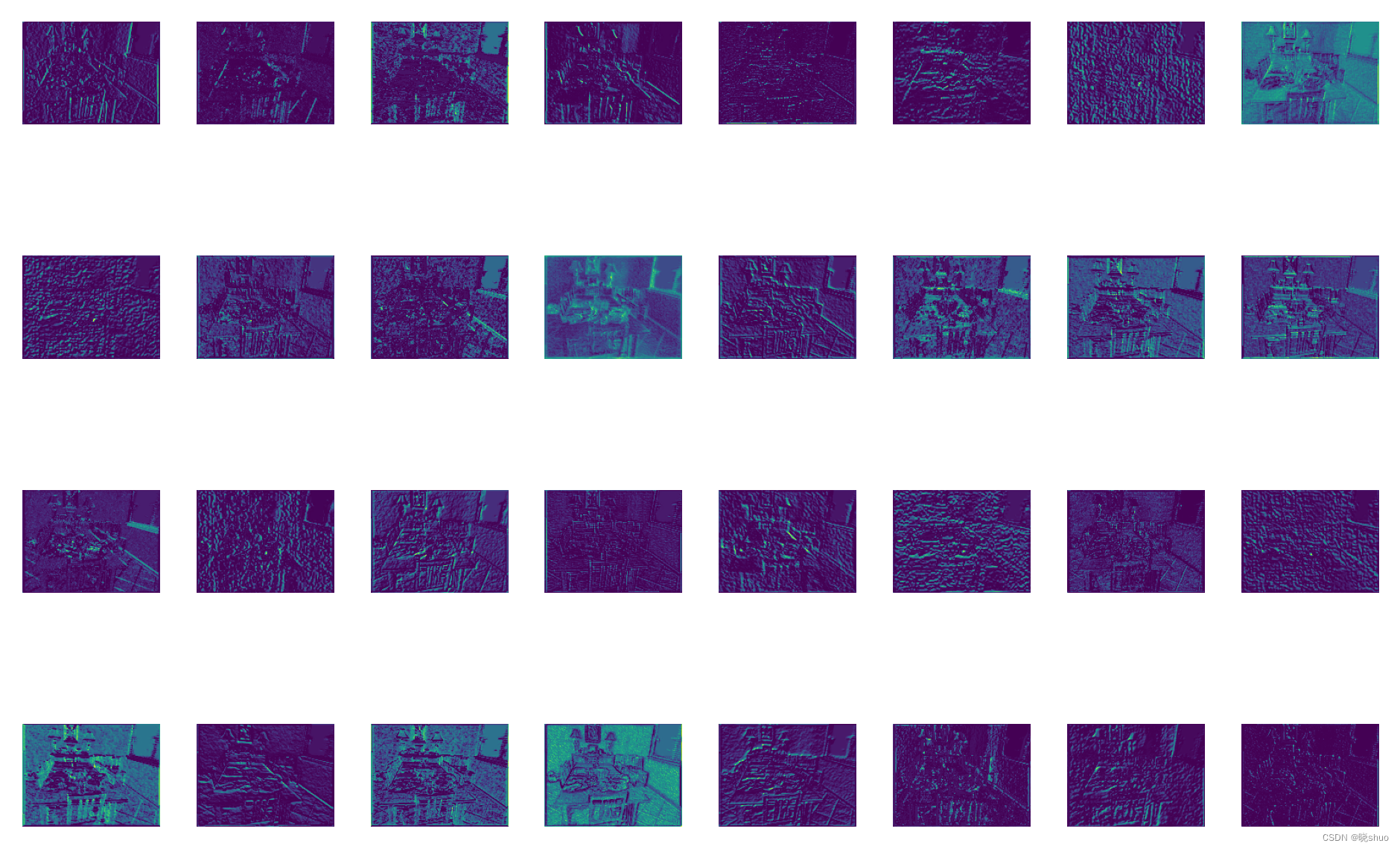

) - Salida del mapa de características por C3 ( salida de la capa 20

) - Salida del mapa de características por Conv (salida de la capa 21 )

- Salida del mapa de características por Concat (salida de la capa 22 )

- Salida del mapa de características por C3 (salida de la capa 23 )

2. Fusión de funciones

1. Fusión de funciones a múltiples escalas

- El campo receptivo de la red de bajo nivel es relativamente pequeño y la capacidad de representación de información geométrica es fuerte.Aunque la resolución es alta, la capacidad de representación de información semántica es débil.

- El campo receptivo de las redes de alto nivel es relativamente grande. Se puede entender que CNN extrae características de las imágenes desde una perspectiva más global, generando así información semántica de alto nivel. La capacidad de representación de la información semántica es fuerte, pero la resolución de las características El mapa es bajo y la representación de información geométrica es una capacidad débil (falta de detalles de las características geométricas espaciales).

- La integración de la información geométrica de la red de bajo nivel con la información semántica de la red de alto nivel es un medio importante para mejorar el rendimiento de detección y segmentación.

2.FPN

-

FPN (Feature Map Pyramid Network) resuelve principalmente problemas de múltiples escalas en la detección de objetos. A través de simples cambios en la conexión de red, mejora en gran medida el rendimiento de la detección de objetos pequeños sin aumentar básicamente la cantidad de cálculo del modelo original.

-

La estructura general del algoritmo es la siguiente: una línea de abajo hacia arriba, una línea de arriba hacia abajo y conexiones horizontales.

-

De abajo hacia arriba:

el proceso de abajo hacia arriba es el proceso de propagación hacia adelante de la red neuronal. Después de que el núcleo de convolución calcula el mapa de características, el tamaño será cada vez más pequeño. -

De arriba hacia abajo:

el proceso de arriba hacia abajo consiste en muestrear mapas de características de nivel superior que son más abstractos y semánticos. -

Conexión horizontal: la

conexión horizontal fusiona los resultados del muestreo ascendente con mapas de características del mismo tamaño generados de abajo hacia arriba. Las dos capas de características conectadas horizontalmente tienen el mismo tamaño espacial. De esta manera, se pueden utilizar detalles de posicionamiento de bajo nivel.

Artículo de referencia

Acerca de la fusión de funciones de red codificador-decodificador

Fusión de características profunda: fusión de características de alto y bajo nivel (multiescala)

Comprensión de la información semántica, características de alto y bajo nivel en imágenes.

Funciones de bajo nivel, alto nivel, información contextual y escala múltiple en CNN