Hola a todos, soy Weixue AI. Hoy les presentaré el método de integración de múltiples mecanismos de atención en la aplicación de técnicas de aprendizaje profundo en 26-CNN y finalmente comprenderé el mecanismo de atención. CNN es un modelo de aprendizaje profundo que puede procesar imágenes y otros datos bidimensionales de manera eficiente. En una CNN tradicional, cada núcleo de convolución realiza la misma operación en todas las posiciones de la entrada, lo que puede hacer que la red no preste más atención y se centre en regiones o características específicas.

El mecanismo de atención se introduce en la red neuronal convolucional, con el objetivo de permitir que la red aprenda y se centre automáticamente en regiones o características importantes en la entrada. Al introducir un mecanismo de atención, se puede mejorar la atención de la red a diferentes regiones o características y se pueden extraer características más significativas y relevantes, mejorando así el rendimiento y la capacidad expresiva del modelo.

1. Introducción del mecanismo de atención.

Introducimos un mecanismo de atención en CNN, de modo que el modelo de red pueda aprender de forma adaptativa la correlación y la importancia entre diferentes canales y luego enfatizar o suprimir selectivamente las características en algunos canales. Esta adaptabilidad puede hacer que la red sea más flexible y precisa en el procesamiento de diferentes tipos de imágenes.

Ventajas del mecanismo de atención:

1. Centrarse en características importantes: el mecanismo de atención permite que la red se centre en áreas o características importantes en la entrada, mejorando así las capacidades de percepción y expresión del modelo.

2. Adaptabilidad: el mecanismo de atención puede aprender automáticamente la correlación y la importancia entre diferentes canales y adaptarse a las características de diferentes tareas y datos.

3. Mejorar el rendimiento: la introducción del mecanismo de atención puede mejorar el rendimiento del modelo en diversas tareas de visión por computadora (como clasificación de imágenes, detección de objetos, etc.).

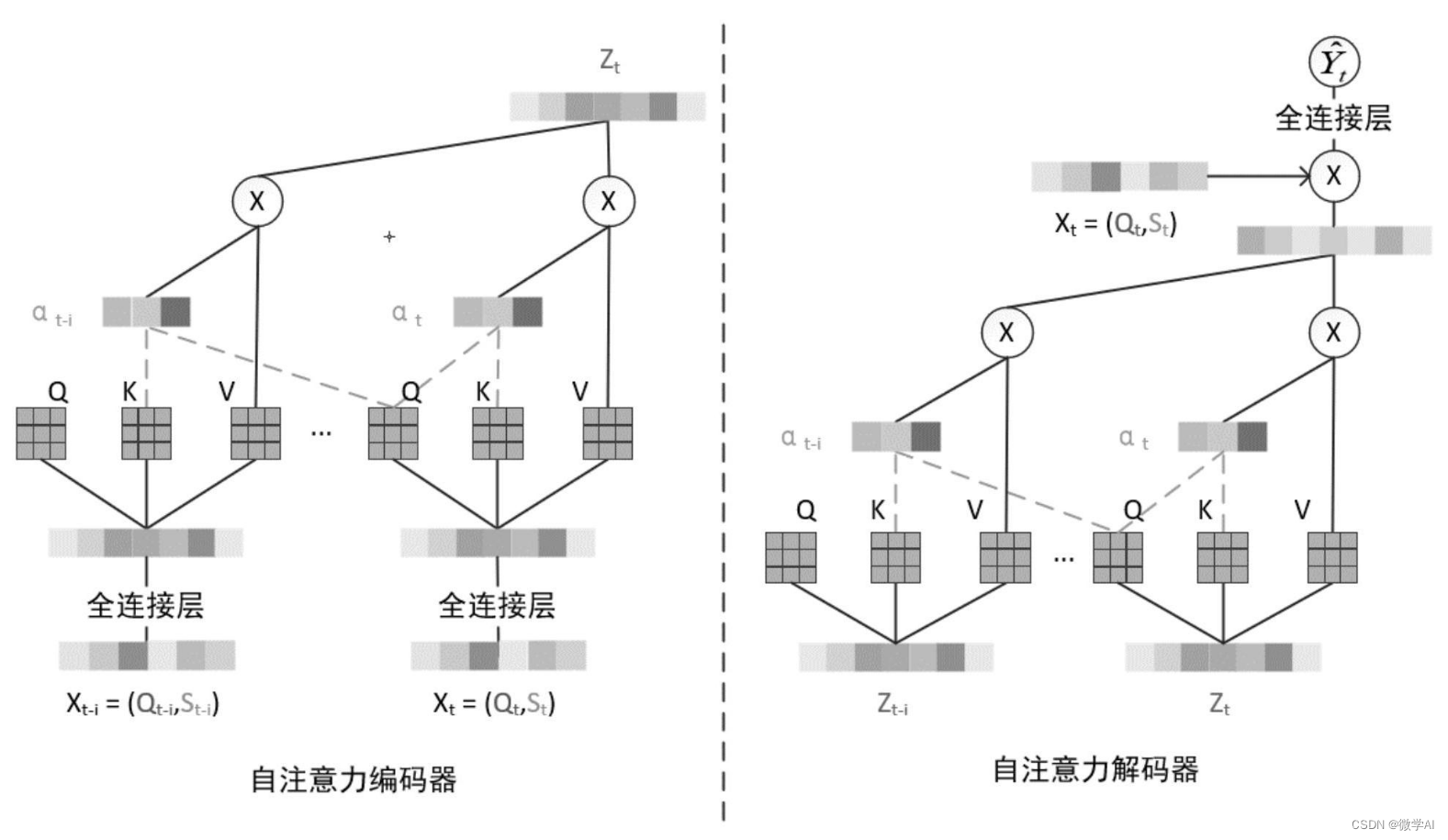

2. Mecanismo de atención de transformación lineal y función softmax.

Ideas de construcción:

Construya la capa de atención SelfAttention y reciba in_channels como entrada, e in_channels representa el número de canales de la característica de entrada. En esta función �