Hola amigos, soy rumor.

Lo que más miente en mi ventana flotante de WeChat es el trabajo de generar imágenes a partir de texto, pensé que podría manejar esta dirección, pero desde que comenzaron a usar el modelo Diffusion, ya no puedo seguirlo, y este tipo de artículos son frecuentes. A partir de la página 20, me dejo llevar lentamente.

Cuando estaba limpiando el inventario de estos informes ese día, de repente tuve una pregunta torturante: ¿ Por qué todos miran en esta dirección? Estas pinturas generadas son asombrosas, pero ¿pueden producir valor real? ¿Cómo debería implementarse o incluso comercializarse?

Con esta pregunta en mente, descargué todos los papeles que conocía, son:

OpenAI的DALLE (21/01)、GLIDE (22/03)、DALLE2 (22/04)

Meta 的 Make-A-Scene (22/03)

Google的Imagen (22/05)、Parti (22/06)

Zhiyuan Enlightenment 2.0 (21/06), CogView (21/11) desarrollado conjuntamente por Zhiyuan Ali Dharma Academy y Tsinghua University

Wenxin de Baidu ERNIE-ViLG (21/12)

Bytes CLIP-GEN (22/03)

Se puede ver cuán animada es esta dirección este año, Google y OpenAI incluso comenzaron a rodar sus propias manos, lanzando diferentes trabajos antes y después.

Volviendo al tema, sobre por qué todos van en esta dirección , después de leer la introducción de los artículos anteriores, descubrí que los puntos de vista están relativamente unificados y el núcleo es buscar constantemente la capacidad de comprender el modelo .

Como Richard Feynman es citado por ERNIE-ViLG:

Lo que no puedo crear, no lo entiendo

Cuando el modelo puede crear una imagen correspondiente precisa basada en el texto, demuestra que tiene las cuatro capacidades enumeradas en CogView:

De los píxeles se extrae una serie de características, como la forma y el color. Es decir, cuando se introduce una imagen en el modelo, este realmente puede "ver" varios objetos y características en ella como un ser humano, en lugar de uno por uno. Uno. Píxeles sin sentido

entender el texto

La alineación de objetos y características en imágenes con palabras (incluidos los sinónimos) significa que el modelo puede relacionar dos modalidades de la misma cosa.

Aprenda a combinar varios objetos y características, esta capacidad generativa requiere un mayor nivel de cognición

Con la inversión continua de recursos, estas imágenes generadas son cada vez más fuertes a una velocidad visible a simple vista. Entonces, aunque estas imágenes son elegantes, ¿cómo se pueden implementar y qué valor real pueden producir?

En primer lugar, el más directo es ayudar a los artistas a crear, o incluso a crear de forma independiente . Por ejemplo, a fines del año pasado, descubrí que cuatro pinturas generadas por un estudiante de doctorado usando IA se vendieron por 2304 yuanes en subastas de Taobao . También investigué algunos sitios web extranjeros.Usar la tecnología AI paga para generar un estilo particular de creación. Cuando estaba escribiendo este artículo, busqué en Taobao nuevamente y descubrí que todavía hay personas que subastan obras de arte generadas por IA, y el precio no es barato:

Para ser honesto, no soy partidario de esta dirección de aterrizaje, creo que el pensamiento y la experiencia de las "personas" detrás de las pinturas son la razón del logro del arte. Pero el valor lo determinan las personas, y sucede que NFT se ha puesto al día recientemente, por lo que se desconoce en qué dirección se desarrollará.

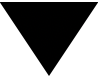

Otra dirección de aterrizaje es la educación infantil . El último trabajo de Meta, Make-A-Scene, es muy adecuado para esta dirección. Deje que los niños dibujen bocetos y describan escenas, y luego pueden generar grandes obras, iluminando así el interés y la imaginación de los niños en el arte. Esta dirección sigue siendo muy práctica y se puede realizar.

Otra dirección es la producción de contenido. La perspectiva de esta dirección es muy amplia. Hablemos primero del 3D. Ahora no hay necesidad de decir más sobre el mercado de la animación y los juegos en 3D (también incluye el metaverso), pero hacer un personaje y una escena en 3D requiere modelado, textura Si la IA puede ayudar en la producción de procesos complejos como colocar huesos, hacer animaciones y agregar efectos especiales, ahorrará muchos costos de mano de obra y aumentará la velocidad de producción de contenido. Además, los objetos reales generados por el modelo actual también son muy realistas. Si lo piensa más a fondo, tal vez pueda ingresar un guión y generar una película en el futuro.

Sin embargo, las capacidades del modelo actual aún están lejos del objetivo final y la capacidad de control del modelo debe mejorarse aún más.

La IA ha estado afectando sutilmente nuestras vidas, tanto para bien como para mal. Por ejemplo, los motores de búsqueda usan algoritmos de IA para ordenar, y algunas personas usan algoritmos de IA para generar una gran cantidad de contenido basura para SEO; otro ejemplo es el software de edición que usa IA para reducir el costo del doblaje manual Robar videos de otras personas, usar IA para cambiar la voz para lavar manuscritos y hacer muchos clips basura.

Aunque suceden cosas malas, afortunadamente, este es un proceso de confrontación, y los algoritmos de ambas partes se harán cada vez más fuertes en la confrontación.

Soy un rumor de dama de algoritmo de IA punk y geek

Graduado de la Universidad de Beihang, ingeniero de algoritmos de PNL, experto en desarrollo de Google

Bienvenido a seguirme, llevarte a aprender y tomar tu hígado.

Girar, saltar y parpadear juntos en la era de la inteligencia artificial

"Espero poder aumentar la velocidad de mi video de la estación B lo antes posible"