Оригинал: Тан Цзин+ChatGPT

От «древнего» до настоящего мир ИИ — это мир, в котором открытый исходный код ведет развитие.

Хотя Stable Diffusion как модель генерации изображений с открытым исходным кодом вывела создание изображений на новый уровень, появление ChatGPT, похоже, пошатнуло убеждения некоторых людей.

Потому что ChatGPT с закрытым исходным кодом, и он самый продвинутый.

Фанаты открытых исходников кричали в небо:

Когда большая модель с открытым исходным кодом (LLM) догонит ChatGPT?

В это время университетская исследовательская группа с большой дырой в мозгу серьезно ответила на сопутствующие вопросы научной статьей:

«Подражайте модели ChatGPT, это сработает?»

25 мая 2023 года исследовательская группа Калифорнийского университета в Беркли представила научную статью на международном веб-сайте с открытым исходным кодом arxiv.

Название диссертации - «Ложное обещание подражать проприетарным LLM».

Мой перевод: «Имитация языковых моделей, кто отвечает за пустые чеки».

Английское слово imitation в этой статье переводится как подражание , вот небольшая модель для изучения вывода ChatGPT. Не может быть переведено как «подражание».

Они начинают с вопроса:

Большая модель LLM с открытым исходным кодом в настоящее время не так эффективна, как закрытая, что мне делать?

Во-вторых, придумайте идеи действий:

В последнем исследовании исследовательская группа попыталась улучшить возможности больших моделей с открытым исходным кодом, заставив их имитировать языковые модели с закрытым исходным кодом (например, ChatGPT).

Затем опишите наблюдение:

Предварительные результаты выглядят хорошо, а способность имитировать большие модели в некоторых отношениях сравнима с ChatGPT. Однако после глубокого анализа выясняется, что эти «имитаторы» лишь поверхностно имитируют и лишены основных возможностей.

В-четвертых, выводы следующие:

Самый эффективный способ — принять вызов ChatGPT и коренным образом улучшить возможности модели с открытым исходным кодом, а не просто имитировать ее.

История неоднократно доказывала, а академические работы доказывали, что в научных исследованиях нет простого способа копировать, а есть только приземленная и кропотливая работа.

Диссертация закончена.

Учитель Тан, я придерживаюсь концепции, согласно которой «ИИ устранит только тех, кто не может использовать ИИ», и объявляю, что научным руководителем этой статьи является ChatGPT.

У меня был простой разговор с ним, и он оказал мне большую, платную академическую поддержку в области ИИ, и это благодарность в моем сердце:

Во-первых, Ctrl+C .

Вставьте реферат статьи «Ложное обещание подражать патентованным LLM» одним щелчком мыши.

Во-вторых, пусть переводит .

«Появившийся метод дешевого улучшения более слабых языковых моделей заключается в точной настройке выходных данных более мощных моделей. Этот подход направлен на дешевую имитацию возможностей проприетарных моделей с использованием более слабых моделей с открытым исходным кодом. В этой работе мы обеспечиваем строгое анализ этого подхода.

«Сначала мы точно настроили серию языковых моделей, имитирующих ChatGPT. Эти модели имеют разные размеры базовой модели (1,5–13 млрд), источники данных и объемы имитационных данных (0,3–150 млн токенов). Затем мы используем Модели оцениваются краудрейтерами и авторитетными тестами НЛП».

«Изначально мы были удивлены качеством выходных данных имитационной модели — казалось, что они лучше следовали инструкциям, а краудсорсинг оценил их результаты как конкурентоспособные с ChatGPT. Однако при выполнении более целенаправленных автоматических оценок мы обнаружили, что имитационная модель почти не сокращает разрыв между базовой языковой моделью и ChatGPT в задачах, где данные для имитации невелики.

«Мы демонстрируем, что эти различия в производительности могут быть упущены оценщиками-людьми, потому что имитационные модели хороши для имитации стиля ChatGPT, но не его фактичности. и языковые модели с закрытым исходным кодом, которые современные методы могут преодолеть только с помощью больших объемов имитационных данных или более функциональных базовых языковых моделей.Поэтому мы считаем, что высший рычаг действия для улучшения моделей с открытым исходным кодом заключается в том, чтобы столкнуться с трудной задачей разработка лучшей базовой языковой модели, а не упрощенная имитация проприетарной системы».

Радости и горести академиков и простых людей неодинаковы.Я просто чувствую, что это многословно.Как уважаемый платящий пользователь, я отпускаю свою сдержанность и говорю откровенно:

«Можете ли вы сделать приведенный выше академический текст более понятным, чтобы его можно было опубликовать в качестве официального отчета?»

ChatGPT ответил мне:

В новом исследовательском подходе был найден способ улучшить качество языковых моделей с меньшими затратами. Проще говоря, это использование более слабой языковой модели, например, с открытым исходным кодом, и возможность изучения результатов более сильной языковой модели, такой как ChatGPT. Это все равно, что сделать модель с открытым исходным кодом «тенью» проприетарной модели, имитируя ее поведение.

Мы провели углубленное исследование этого метода. Мы попробовали ряд моделей и сделали их имитирующими ChatGPT. Эти модели бывают самых разных размеров, источников и объемов смоделированных данных.

Затем мы оценили эти модели с помощью краудсорсинга и тестов НЛП.

Сначала нас удивили результаты имитационного моделирования. Они лучше следуют инструкциям, как клон ChatGPT.

Однако, когда мы использовали более строгие методы тестирования, мы обнаружили, что эти имитационные модели не достигают эффекта ChatGPT в задачах, где недостаточно данных для имитации.

Мы обнаружили, что этот разрыв связан с тем, что имитационная модель имитирует только внешний вид ChatGPT, но не его ядро. Как и люди, мы можем имитировать движения и голос человека, но не его мысли.

Поэтому мы считаем, что полагаться исключительно на подражание бесполезно. Существует явный разрыв в возможностях между моделями с открытым исходным кодом и проприетарными языковыми моделями, и мы не можем просто преодолеть этот разрыв с помощью массивных имитационных данных или более крупных базовых моделей.

Мы считаем, что наилучший подход — принять вызов и разработать более совершенные базовые модели, а не сокращать пути и только имитировать проприетарные системы.

Пришло время рассказать ChatGPT, что значит быть неутомимым.

Итак, я сказал:

Пожалуйста, сократите его дальше, сократите до 3-4 предложений?

ЧатГПТ отвечает:

В нашей последней работе мы пытаемся улучшить возможности языковых моделей с открытым исходным кодом, заставив их имитировать проприетарные модели, такие как ChatGPT.

Предварительные результаты выглядят хорошо, а имитационная модель в некоторых отношениях сравнима с ChatGPT.

Однако углубленный анализ показал, что эти имитационные модели имитировали только поверхность и не имели основных возможностей. Поэтому мы считаем, что наиболее эффективный способ — принять вызов и коренным образом улучшить возможности моделей с открытым исходным кодом, а не просто их имитировать.

Искусственный интеллект — это круто, но я совсем не считаю себя крутым.Если я буду писать подобные статьи в будущем, спросите себя, в чем моя ценность?

Что ж, пришло время показать настоящую технику (показать свою ценность).

После беседы с двумя ведущими учеными в области искусственного интеллекта в Силиконовой долине в США и на фабрике в Китае я узнал о ситуации.

В моей стране также есть группы по исследованию и разработке крупномасштабных моделей, которые используют метод имитации для создания крупномасштабных моделей, что является «имитациями», упомянутыми в этой научной статье.

Конкретный метод включает в себя использование GPT с открытым исходным кодом в качестве базовой модели, то есть использование ее в качестве базовой структуры, а затем лихорадочное задавание вопросов ChatGPT, а затем ввод выходных данных в внутреннюю большую модель.

Будет ли это работать на трудном пути восхождения на «самый интеллектуальный программный продукт человечества»?

Крупные модели находятся в эпицентре бури на исследовательском фронте, и академические точки зрения яростно борются друг с другом.

Калифорнийский университет в Беркли находится в авангарде исследований в области искусственного интеллекта. Две разные исследовательские группы в одном университете придерживаются диаметрально противоположных взглядов.

Как указывалось выше, авторы статьи «Ложное обещание имитации проприетарных LLM» не поддерживают этот подход.

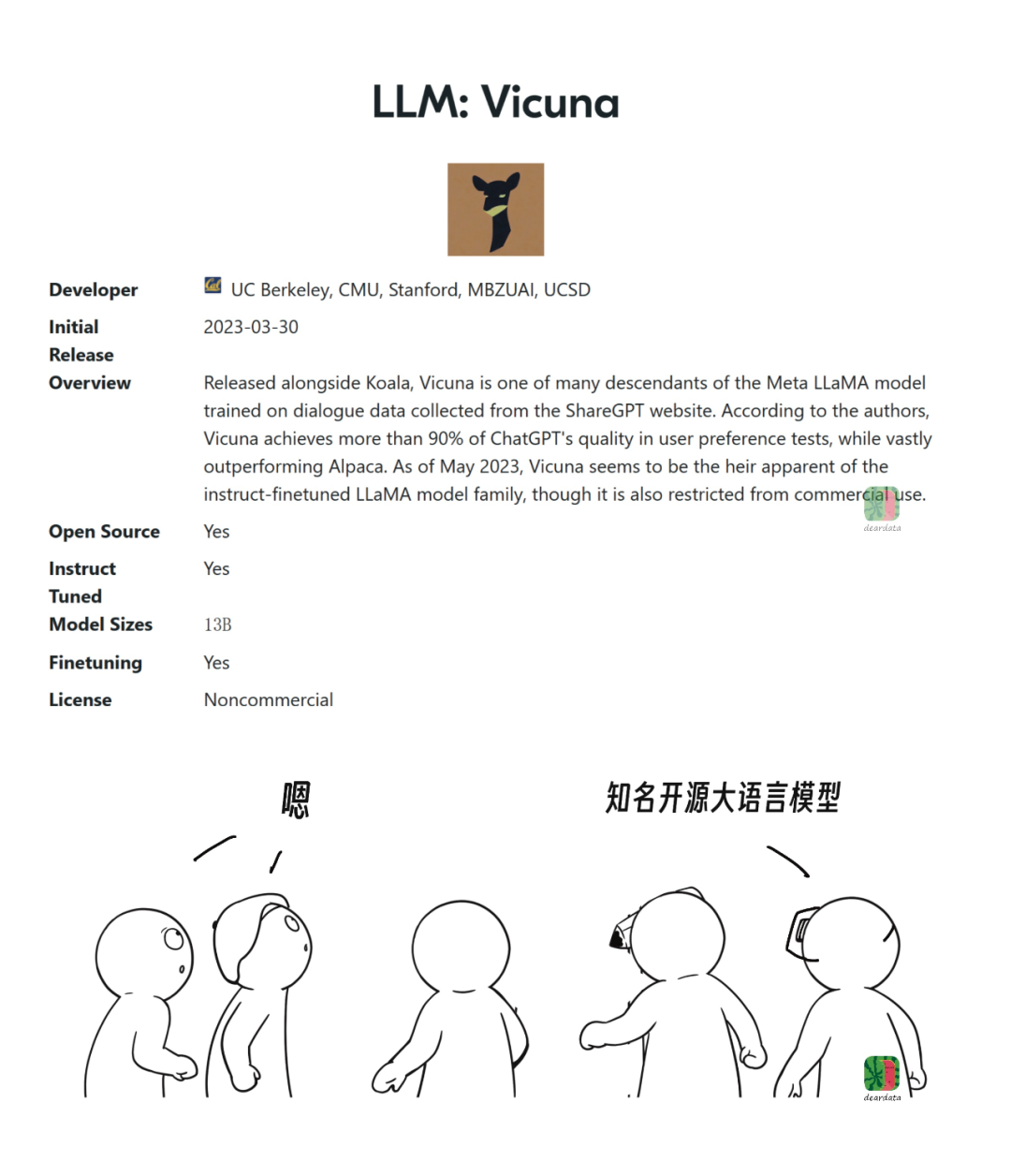

Другая команда, исследовательская группа, стоящая за известной открытой моделью викуньи (Vicuna), согласна с этим подходом.

Хотя «огонь войны» этих академических дебатов еще не разгорелся внутри страны, различия между двумя сторонами стали очень ясными.

«Имитация» оппортунистична?

Нет, это академическая дискуссия, и не следует делать поспешных выводов.

Потребуется время, чтобы развеять сомнения.

-Заканчивать-

читать далее

Серия фреймворков ИИ:

1. Группа людей, которые используют системы глубокого обучения, либо сумасшедшие, либо лжецы (1)

2. Группа людей, занимающихся ИИ-фреймворками 丨 Ляоюаньхуо, Цзя Янцин (2)

3. Те, кто занимается ИИ-фреймворками (3): фанатичный AlphaFold и молчаливые китайские ученые

4. Группа людей, занимающихся ИИ-фреймворком (4): приквел ИИ-фреймворка, прошлое системы больших данных.

Примечание: (3) и (4) еще не опубликованы и будут встречаться с вами в виде книгоиздания.

комическая серия

1. Интерпретация списка венчурных компаний Силиконовой долины A16Z «50 лучших» компаний.

2. Алгоритм ИИ — брат, разве работа и обслуживание ИИ не брат?

3. Как появилось социальное высокомерие больших данных?

4. ИИ для науки: это «наука или нет»?

5. Если вы хотите помочь математикам, сколько лет ИИ?

6. Человек, позвонивший Ван Синьлину, оказался волшебным складом умного озера

7. Получается, что карта знаний — это дойная корова для «нахождения взаимосвязей»?

8. Почему графические вычисления могут положительно повлиять на черную индустрию?

9. AutoML: Копите деньги, чтобы купить «Робота Shan Xia»?

10. AutoML : ваша любимая подставка для горячих блюд автоматически покупается роботами.

11. Обучение с подкреплением: искусственный интеллект играет в шахматы, сделай шаг, сколько шагов ты видишь?

13. Активное обучение: искусственный интеллект на самом деле был ПНП?

14. Cloud Computing Serverless: Стрела, пронзающая облака, тысячи войск встретятся друг с другом

15. Сеть центра обработки данных : данные поступают на поле боя за 5 наносекунд.

16. Опоздать не страшно, страшно то, что больше никто не опаздывает , сетевой "объем" ИИ центра обработки данных:

17. Это радость или печаль? ИИ действительно помог нам закончить офисную работу

Большая модель AI и серия ChatGPT:

18. ChatGPT fire, как создать компанию AIGC, а затем заработать?

19. ChatGPT: никогда не запугивайте студентов-гуманитариев

20. Как ChatGPT учится по аналогии?

21. Эксклюзив 丨От отставки великих богов Алекса Смола и Ли Му до успешного финансирования стартапов AWS, оглянитесь назад на эволюцию «основного оружия» в эпоху крупномасштабных моделей ChatGPT.

23. Это всего лишь выдумка, что большая модель ChatGPT используется для уголовного расследования?

24. Игра престолов Большой модели «Экономика на облаке»

27. Углубленная беседа с Хэ Сяодун: «Отъезд» девять лет назад: закладка основы мультимодальности и борьба за крупномасштабные модели

Наконец, позвольте мне представиться в качестве главного редактора.

Я Тан Цзин, автор научно-технических и научно-популярных тем.

Чтобы открыть истории во времена,

Я гонюсь за богами технологий и блокирую технологические компании.

Иногда пишу романы и рисую комиксы.

Жизнь коротка, не ищи ярлыков.

Оригинальность непростая, спасибо за пересылку

Если вы все еще хотите читать мои статьи, просто обратите внимание на "Уважаемые данные"