En primer lugar, ¿cuál es la red neuronal BP

red neuronal BP se basa en utilizar el algoritmo BP de propagación inversa de error es una multi-capa de alimentación directa a la red neural.

En segundo lugar, el origen de la red neuronal BP

1980 En la historia de la máquina de desarrollo consciente de la red neuronal artificial (Perceptrón multicapa, MLP) de red neuronal artificial de la red habían desempeñado un papel importante, se considera también una verdadera red neuronal artificial se puede utilizar modelo, parece que las personas habían salido auge de la red neuronal artificial. consciente de la red individual (modelo MP) como la primera red neuronal, el modelo que tiene una estructura simple y clara, las ventajas de una pequeña cantidad de cálculo. Sin embargo, con la profundización de la investigación, se descubrió que existe una falta de ella, por ejemplo, no puede manejar los problemas no lineales, incluso si la función de acción unidad de cálculo sin funciones de válvulas y otra función no lineal más complejo, siendo sólo puede resolver resolver linealmente separables problema. No podemos lograr algunas funciones básicas, lo que limita su aplicación. capacidades de clasificación y de reconocimiento mejorada de la red, la única manera de resolver el problema no lineal es el uso de una red de alimentación directa multi-capa, es decir, la adición de la capa oculta entre las capas de entrada y de salida. Antes de la composición de la alimentación directa a la red perceptrón multicapa. A medio plazo, David Runelhart. Geoffrey Hinton y Ronald W-llians, DavidParker, que descubrió de forma independiente el algoritmo de error de propagación hacia atrás (error Volver Formación Propagación), se hace referencia a BP, los resuelve sistema el problema de pesos de conexión de red neural multicapa de aprendizaje capa oculta, ya matemáticamente una derivación completa. personas multicapa para utilizar un algoritmo de corrección de error de este tipo de alimentación hacia adelante denominada red de la red de BP.

El anterior es un extracto Enciclopedia de Baidu, que resumió el problema del perceptrón de una sola capa limitado se puede resolver, entonces debe añadir capa entre la entrada y la salida, lo que llamamos la capa oculta, pero añadiendo más capas después de que se antes de que el método de cálculo que no utiliza el error, por lo que los matemáticos inventaron algoritmo para ser implementado en un algoritmo de propagación inversa de múltiples capas, que llamamos BP algoritmo, el algoritmo usando la red neuronal se llama una red neuronal BP .

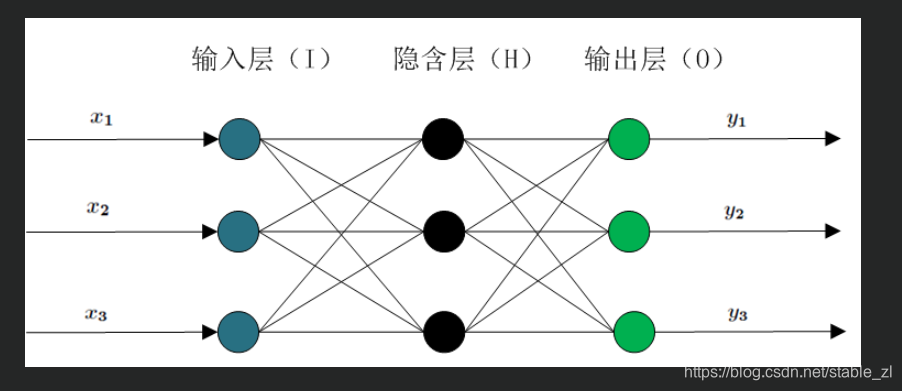

Tres, BP arquitectura de red neuronal

BP arquitectura de red neural y en comparación con un lineal perceptrón red neuronal, es decir, entre la entrada y la salida de añadir más capas. [Imagen volcar la cadena falla, la estación de origen puede tener mecanismo de cadena de seguridad

Como se muestra, la capa oculta, pero de hecho el número de capas es variable, y el número de nodos en cada capa es variable, la precisión del impacto, es decir el número de diferentes capas de la red será.

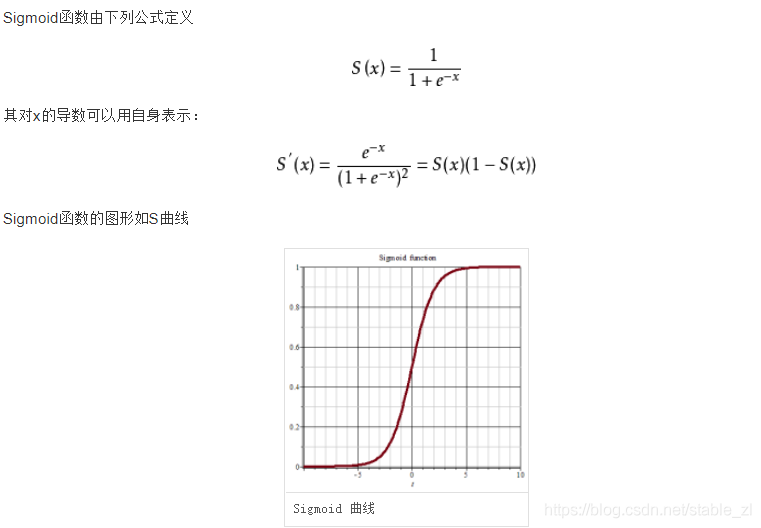

Cuatro, se activa la función de actualización de la red neuronal BP

BP error de cálculo algoritmo se basa en el descenso de gradiente, sabemos que el gradiente es el derivado, mientras que el algoritmo BP en el derivado en una pluralidad de capas, la activación de la función y antes de Si lineal redes neuronales = x, se encuentra la primera derivada es 1, y luego buscar el tiempo es 0, y, obviamente, no puede satisfacer nuestras necesidades, por lo que la red neuronal BP y utilizar otra función de activación:

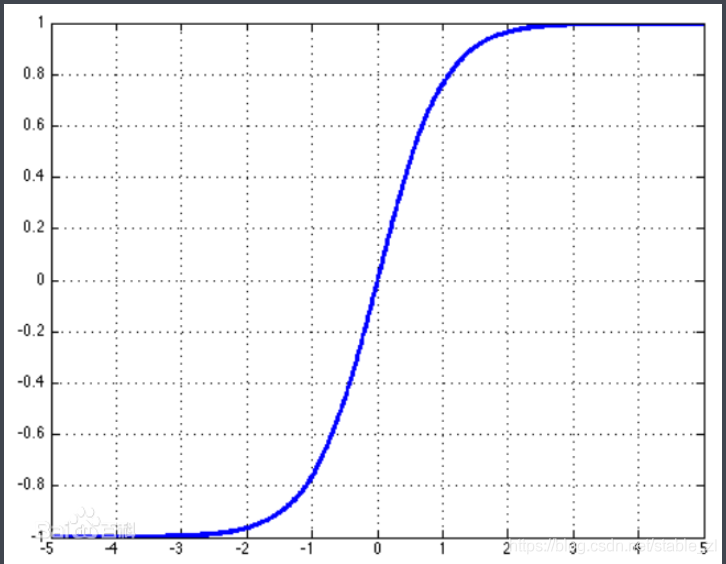

función sigmoide:

función tangente hiperbólica:

Estos tres son comúnmente utilizados por la función de activación BP de red neuronal, por supuesto, hay otras funciones comúnmente usados.

Cuatro, BP ventajas de la red neural y desventajas

4.1 Ventajas:

BP red neuronal en términos de la teoría de redes es más maduro en términos de rendimiento. Su ventaja es la capacidad de mapeo no lineal fuerte y una estructura de red flexible. Las capas intermedias de la red, el número de capas del elemento neural se pueden establecer arbitrariamente dependiendo de las circunstancias, y como la diferencia en el rendimiento de la estructura también es diferente.

4.2 Desventajas:

① velocidad de aprendizaje lento, incluso una simple pregunta, generalmente requieren cientos o incluso miles de aprender a converger.

② fácil caer en mínimo local.

③ capas de red, el número de neuronas no selecciona la teoría correspondiente.

④ capacidad de generalización de red limitada.

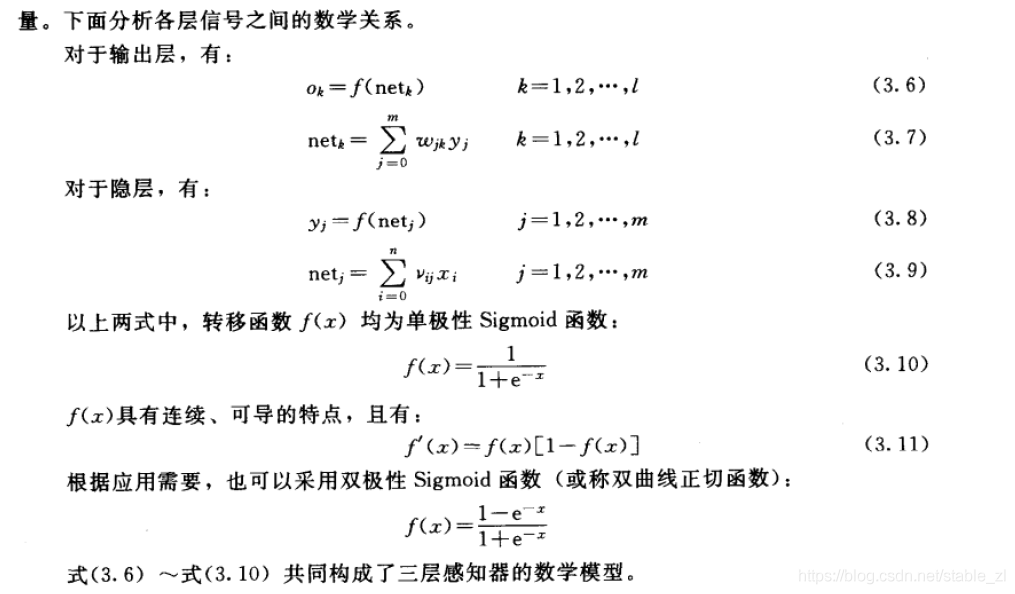

En quinto lugar, el principio de

relación matemática entre cada señal de 5,1

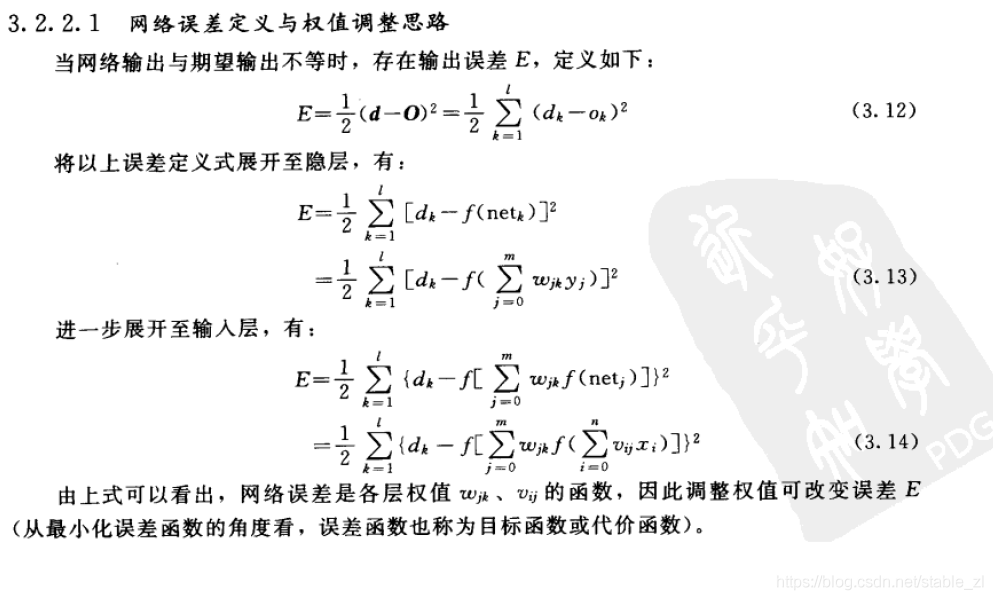

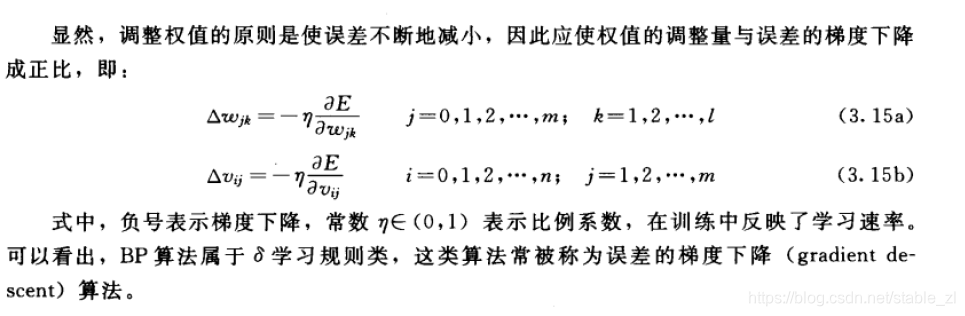

5.2 Ajuste de error y los pesos para ajustar su forma de pensar

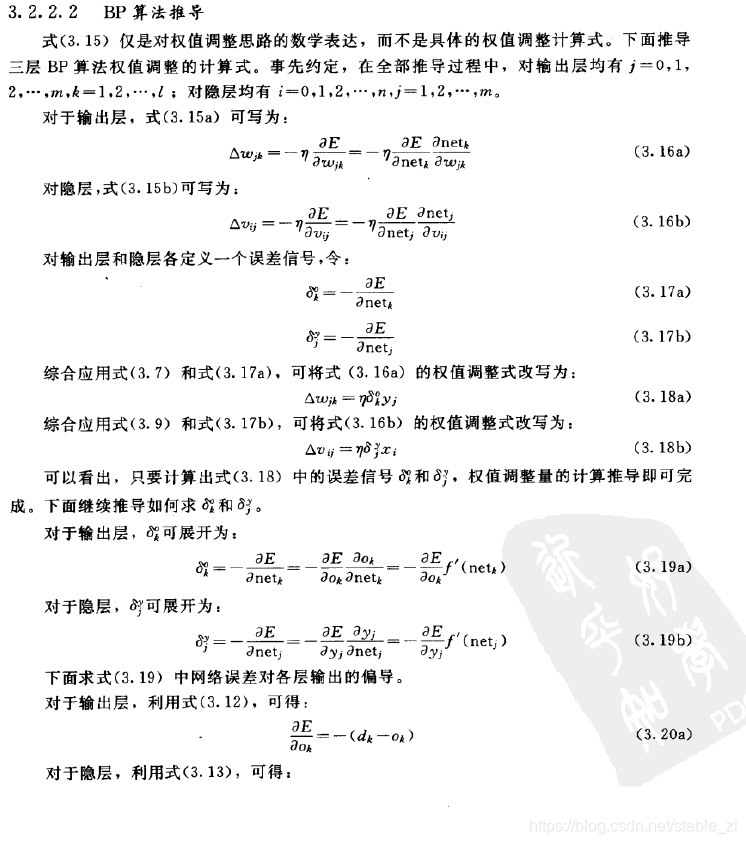

5,3 BP algoritmo deducida

Algoritmo de derivación anterior es sólo una capa oculta, no queremos un estudio en profundidad, sólo recuerda que las dos últimas fórmulas pueden ser.