今天跟大家分享的FoveaBox则是该方向最新的成果,针对的是通用目标检测领域,算法方案简单,结果达到state-of-the-art,代码亦将开源,方便后续其他学者跟进,发展空间极大。

算法思想

FoveaBox的动机来自人眼的中央凹:视野中心(物体)具有最高的视力。

(物体的位置信息能够从中心反应出来——CV君的理解)

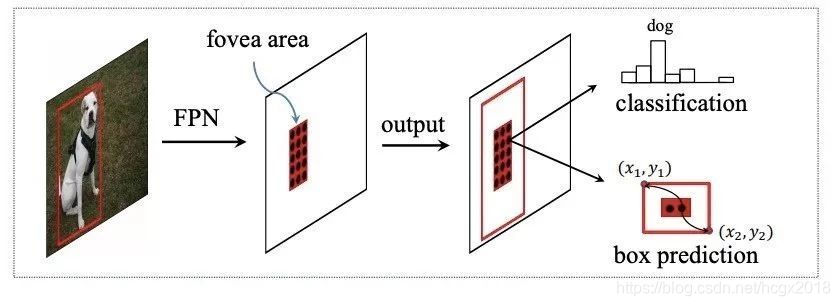

下图展示了FoveaBox目标检测的基本思想,对于可能存在目标的每个输出空间位置,FoveaBox直接预测所有目标类别存在的置信度和边界框。

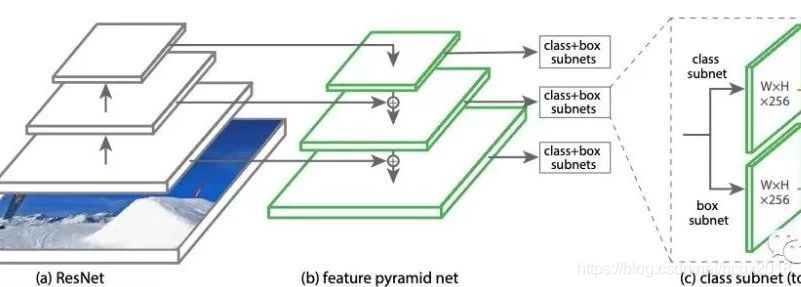

FoveaBox是在RetinaNet目标检测网络基础上做的改进,我们先来看看RetinaNet的网络架构。

如下图,RetinaNet利用了特征金字塔网络检测目标,对于金字塔的每一层,都后接class + box 子网络。最右侧上半部分为class子网络,下半部分为box子网络。

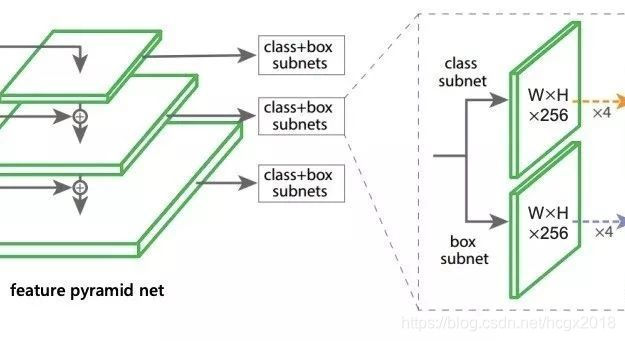

下图是FoveaBox网络的改进,class 子网络计算的是每个输出位置分别存在不同类别目标的置信度,box子网络则是直接计算每个输出位置的与类别无关的目标包围框(左上和右下顶点坐标)。

在论文第三部分从骨干网、训练时目标的尺度分配、训练时目标位置信息内陷、box 预测、网络优化和推断等详细说明了训练和推断的细节。

实验结果

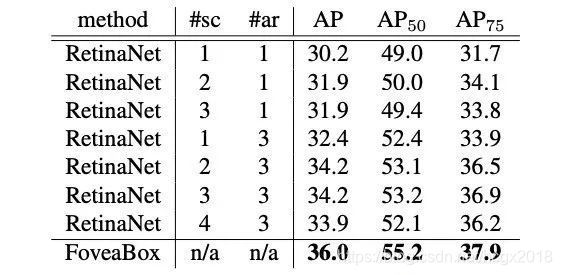

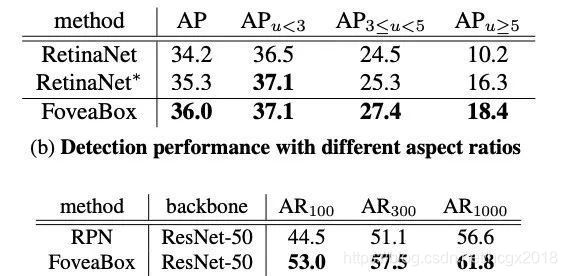

作者首先研究了,FoveaBox算法与RetinaNet在变化anchor密度、目标宽高比后的精度结果,如下图(a)(b),FoveaBox比RetinaNet的最好结果还好。

因为FoveaBox具有自己生成候选目标区域的能力,作者将其与RPN网络相比较,下图(c),发现其生成的目标候选框比RPN的质量更高!

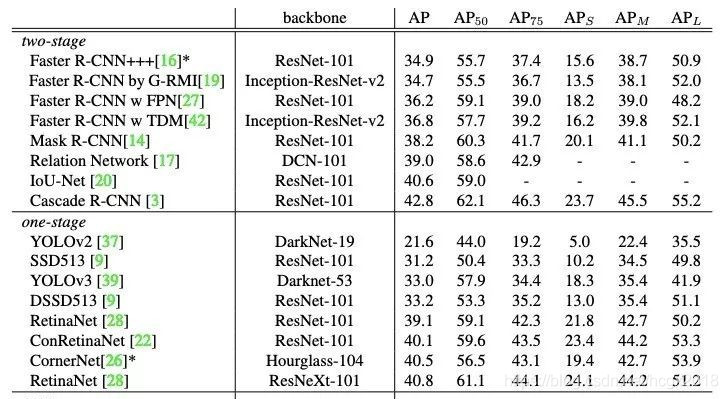

下面表格展示了,FoveaBox与目前两阶段和一阶段state-of-the-art目标检测算法在COCO数据集上检测结果比较,FoveaBox取得了几乎最好的结果,仅三个指标略低于Cascade R-CNN,但作者称许多高级目标检测技巧,FoveaBox还没有使用,后续还有提高的潜力。

下图为FoveaBox与RetinaNet的检测结果示例,可见在宽高比变化较大的目标上,FoveaBox取得了更好的结果。

想要获取更多人工智能方面的资料

可以加V、、信:hcgx0904(备注“人工智能”)

点击《深度学习&计算机视觉精讲》

开始学习吧!!