【fishing-pan:https://blog.csdn.net/u013921430 转载请注明出处】

##常见的统计量

在概率与统计中,最常见的统计量有样本均值、方差、标准差、极差以及中位数等等。这些都是最基础、最常见的统计量。

均值:

方差:

均值也就是一组数据的平均数,它可以理解成为数据分布中心或者物体的质心;而方差是数据距数据中心(也就是均值)的距离的平方的均值,它表示一组数据的离散程度,方差越大,数据分布越离散。

协方差

除了上述常用的统计量以外,有一个在数据分析中也比较常用的统计量,它就是协方差;协方差表示两个变量的总体误差。它的计算公式如下;

根据公式可以判断出,协方差具有以下特性;

从公式中还可以初步判断出协方差的大小与

、

这两个变量的离散程度都有关,而且两个变量互相影响,例如当

的绝对值很小时,如果

的绝对值很大,两者乘积的绝对值也会很小。

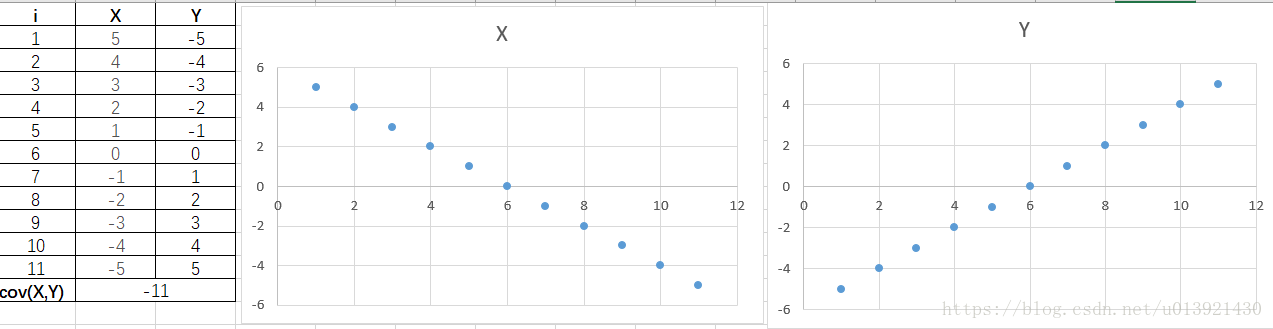

如果两者在变化过程中变化趋势一致,比如, 变大时 也变大,那么协方差是正值,表明两者正相关,例如身高越高的人往往双臂越长,那么身高跟臂长是正相关的;如果两者在变化过程中变化趋势相反,例如 变大时 却变小,那么协方差是负值,两者负相关,Figure 1所示。所以它反映的是变量在变化过程中的协同性。我们可以根据协方差的这种协同性来判断数据在不同“方向”上的离散程度。

强调说明 :

协方差计算 只能 用于计算同一样本的不同属性(或者说是维度)之间的协方差。否则是没有意义的,因为 、 ,对应的是样本中第 个个体的 属性与 属性的值。比如,人的腿长与身高的协方差,这个是可以的。但是要是想计算人的腿长与树木的长度之间的协方差,明显就是没有任何意义的。

相关系数

协方差的值的大小除了一两种变量的相关性有关外,还与变量的量纲有关。如果

是以10为量纲,而

以10万为量纲,而

也是以10为量纲。假设

与

之间具有很强的相关性(比如

),而

、

之间不具有很强的相关性,但是由于量纲的影响,

与

的相关系数要大于

与

的相关系数。

为了能够更好地衡量变量之间的相关程度,引入了相关系数

;

通过让协方差除以两个变量的标准差的乘积

,来消除变量量纲带来的影响。由

不等式;

所以;

因此,

的取值范围为

;当

为正值时,

、

正相关,切值越大相关性越强;同理,当

为负值时,

、

负相关,当

时,

、

不相关。

注:此处所说的相关性都是线性相关性,有可能两者之间存在非线性的相关性

协方差矩阵

对于多维数据

,如果需要计算各个维度两两之间的协方差,就生成了一个

的矩阵,这个矩阵就是协方差矩阵。

由于

,所以协方差矩阵是对称阵。

协方差矩阵的意义

协方差矩阵中的元素是数据各个维度的协方差,而矩阵的特征值与特征向量表示的是对所有元素信息的整合,也就是说协方差矩阵的特征值也是表示协方差,对应的特征向量表示协方差的方向。协方差矩阵最大特征值对应的特征向量,指向数据最大方差的方向(主方向如果将数据在空间中的分布看作高维空间的一个椭球,最大方差方向就是椭球最长轴的方向),次大特征向量与最大特征向量正交(是椭球次长轴方向)。

协方差矩阵的应用

协方差矩阵的用处很多,最常见得用处就是主成分分析(PCA)。主成分分析主要是对数据降维,以减少计算量,方便数据分析。

数据降维就是将高维空间的数据向低维空间投影。但是也要尽量减少数据信息损失,因此需要找到合适投影的正交坐标轴。这时候就需要用到协方差矩阵了, 的矩阵有 个特征值,从大到小依次排序,将 维的数据降维至 维度可以选择从大到小的 个特征值,而这 个特征值对应的 个特征向量构成的特征空间就是最终的 维空间。