目录

1.概念及工作原理

1998年法国学者Yann LeCun将卷积运算与神经网络结合,提出著名的卷积神经网络。随后在2012年深度卷积神经网络一炮而红。卷积神经网络(Convolutional Neural Networks),通常简称为CNN,是一类包含卷积运算且具有深度结构的前馈神经网络,是深度学习的代表算法之一。CNN具有表征学习能力,能够按阶层结构对输入信息进行平移不变分类,也正因此被称为“平移不变人工神经网络”。CNN仿照生物的视觉机制构建,进行监督学习和非监督学习,最早应用于计算机视觉、现在也在自然语言处理等领域被广泛应用。

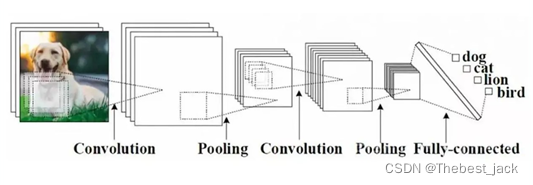

CNN主要分为输入层、隐含层和输出层三层架构。其中隐含层又可以分为卷积层(Convolution,提取特征)、池化层(Pooling,对卷积层输出的特征图进行进一步特征抽样,又可以分为最大池化(Max Pooling)和平均池化(Average Pooling) )、Inception模块和全连接层(Full-connected,将特征集合在一起,结合图片分析可能是某种事物的概率)。多个卷积层共同操作,会作用在同一个位置,所以会变“胖”。

卷积结构:

池化层:

主要原理见下文:

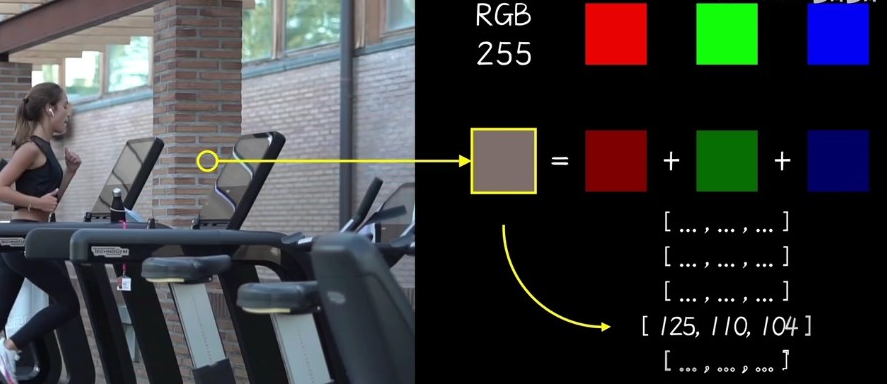

卷积神经网络在把图片交给神经网络之前先要对图片进行至少一轮卷积的操作。(此处要补充一下:其实视频是图片以及快的速度交替出现呈现出的一组图像模式,卷积神经网络就是应用在每一帧图像(照片)上的,而图片是由RGB或其他颜色模型下所有颜色叠加而成的,每种颜色从浅到深又分为0~255,一共256个等级。原始图片经过输入层会变成灰度或者RGB数字填充的矩阵)如下图。

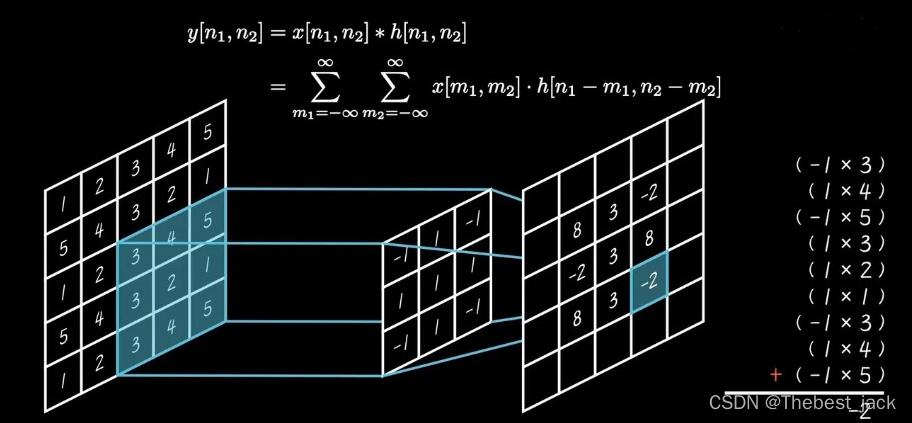

接下来为了提取图像的特征,会构建训练一个正方形的点阵(一般简单设置成3X3矩阵),这个点阵就称为卷积核。具体操作是将卷积核与图片矩阵对齐,依次从左上到右下以一定步长遍历整个图像,格子上重合的数字进行相乘再相加,把新的结果输出填到新矩阵对应卷积核的最中间的位置。得到新矩阵能反映图像的部分特征,因此也被称为特征图,特征图既是这一层的输出,也是下一层的输入。这个过程用数学表达式为二维离散卷积操作。但是这样的话周围是空的,所以就在原图像上外围加上一圈0,继而保证输入输出的维度保持一致。

卷积操作就是用一个输入乘上系统函数然后计算输出。以图像处理为例,输入就是原始图像的像素,系统函数就是卷积核,如图。

通过卷积操作提取图像的特征,为之后的计算提供条件。所以卷积核也常被称为过滤器。

在音频信号处理和自然语言处理上,只不过在处理序列数据时,常用的不是3x3的卷积核而实1xN的一维卷积核

2.(一维、二维、三维)的工作原理及应用领域

一维卷积常用于序列模型,自然语言处理领域;二维卷积常用于计算机视觉、图像处理领域;三维卷积常用于医学领域(CT影响),视频处理领域(检测动作及人物行为)。